1. 引言

视觉-语言-动作(Vision-Language-Action, VLA)模型代表了机器人技术的范式转变,将视觉感知、自然语言理解和动作控制统一在单一的端到端学习框架中。VLA模型使机器人能够直接从自然语言指令和视觉观察中学习操作策略,无需显式的中间表示或分离的感知-规划-控制模块。

自2023年Google DeepMind推出RT-2以来,VLA模型在机器人操作任务中展现出强大的泛化能力和零样本学习潜力。这一技术路线继承了大规模视觉-语言模型(VLM)在跨模态理解方面的优势,并将其扩展到具身智能领域,使机器人能够像理解图像和文本一样”理解”物理世界中的交互任务。

VLA模型在服务机器人、工业自动化、智能制造等领域有着广泛的应用前景。本文旨在系统梳理VLA领域的研究进展,为学习和研究VLA提供全面参考。

1.1 主要缩写

- VLA: Vision-Language-Action(视觉-语言-动作)

- VLM: Vision-Language Model(视觉-语言模型)

- LLM: Large Language Model(大语言模型)

- CoT: Chain-of-Thought(思维链)

- MoE: Mixture-of-Experts(专家混合)

- RL: Reinforcement Learning(强化学习)

- RLHF: Reinforcement Learning from Human Feedback(从人类反馈中强化学习)

- DiT: Diffusion Transformer(扩散Transformer)

- DDPM: Denoising Diffusion Probabilistic Model(去噪扩散概率模型)

- SSM: State Space Model(状态空间模型)

- MPC: Model Predictive Control(模型预测控制)

- OXE: Open X-Embodiment(开放跨具身数据集)

- RLDS: Reinforcement Learning Datasets(强化学习数据集格式)

- CBF: Control Barrier Function(控制屏障函数)

- LoRA: Low-Rank Adaptation(低秩适应)

2. VLA基本概述

2.1 什么是VLA?

VLA(Vision-Language-Action)模型是一类端到端的多模态学习模型,能够直接从视觉输入(相机图像)和语言指令中预测机器人的控制动作。与传统的模块化机器人系统不同,VLA将感知、推理和控制统一在单一的神经网络架构中。

VLA的核心特征

1. 端到端学习:直接从原始传感器数据到低层控制信号的映射,无需手工设计的中间表示。

2. 多模态融合:统一处理视觉、语言和动作三种模态,实现跨模态的语义对齐。

3. 指令驱动:通过自然语言指令指定任务目标,支持灵活的任务切换和零样本泛化。

4. 大规模预训练:继承视觉-语言模型的预训练知识,并在机器人演示数据上微调。

VLA的发展里程碑

VLA研究时间线:从模块化到端到端统一模型的演进历程(2022-2026)

flowchart LR

subgraph G2022 ["2022 早期探索"]

A["RT-1: Transformer控制"] --> B["SayCan: LLM规划"]

end

B --> C

subgraph G2023 ["2023 突破元年"]

C["RT-2: 首个端到端VLA"] --> D["OXE数据集: 跨具身规模化"]

D --> E["Diffusion Policy"]

end

E --> F

subgraph G2024 ["2024 开源与实时"]

F["OpenVLA: 7B开源标杆"] --> G["π₀: 实时Flow Matching"]

end

G --> H

subgraph G2025 ["2025-2026 推理增强"]

H["π₀.5: 思维链推理"] --> I["ACoT-VLA: 动作空间推理"]

end

style C fill:#f96,stroke:#333,stroke-width:2px

style F fill:#69f,stroke:#333,stroke-width:2px

- 2022年:RT-1开创Transformer在真实机器人控制中的应用,SayCan、Inner Monologue探索语言模型规划。

- 2023年7月:Google DeepMind发布RT-2,首次将VLM成功转化为VLA模型,正式开创VLA研究方向。

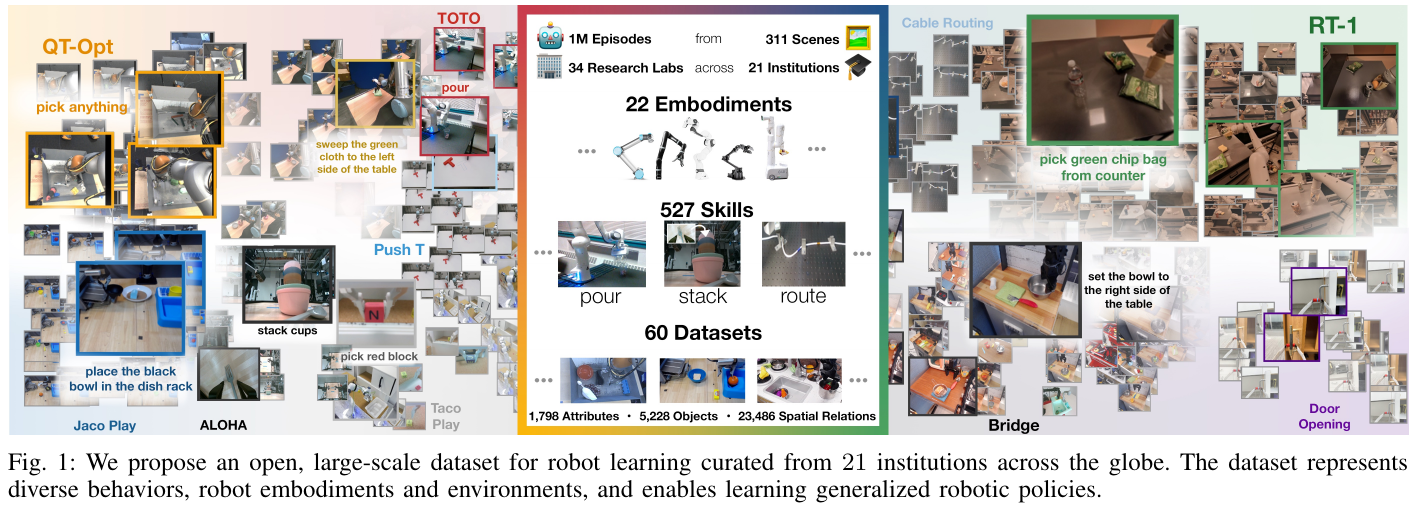

- 2023年10月:Open X-Embodiment (OXE) 数据集发布(970k轨迹,22种机器人),定义了机器人数据标准格式 RLDS。

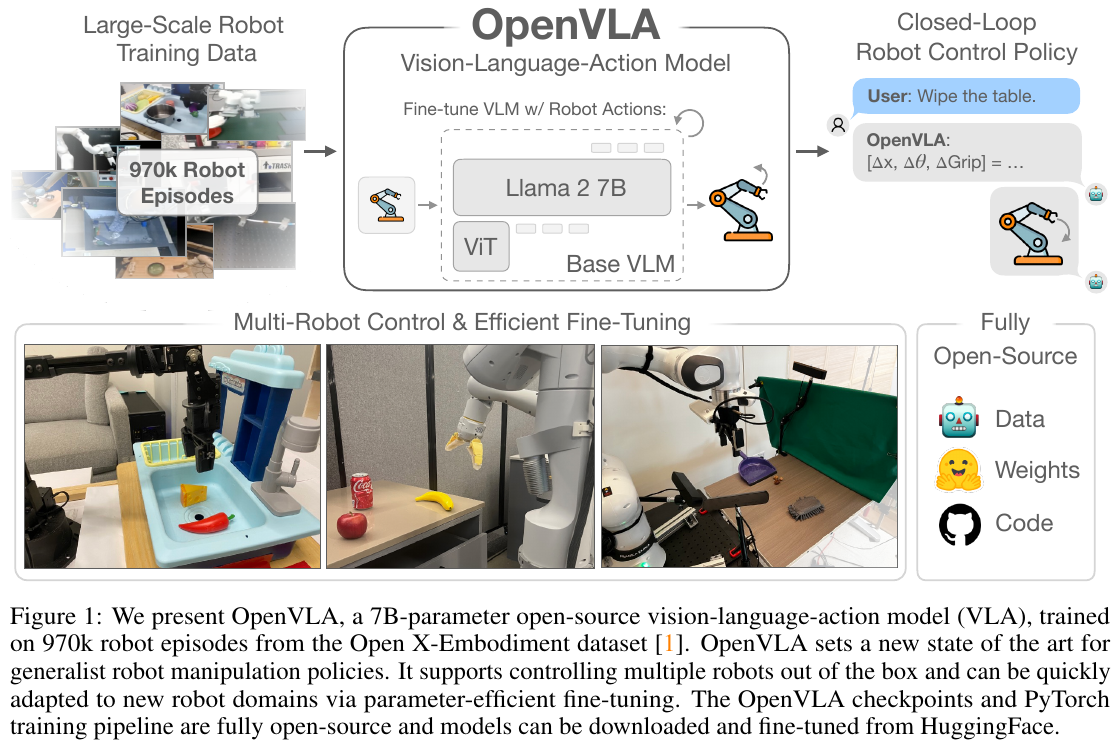

- 2024年6月:斯坦福大学发布 OpenVLA(7B参数),首个开源大规模VLA标杆,在多项任务上超越RT-2。

- 2024年10月:Physical Intelligence 发布 π₀,引入 Flow Matching 实现 50Hz 高频连续控制。

- 2025年2月:开源阵营爆发。小米 (Xiaomi-Robotics-0)、蚂蚁集团 (LingBot-VLA)、阿里达摩院 纷纷发布开源模型。自变量机器人 (Independent Variable) 基于数万小时真机数据扩展 VLA。

- 2025年3月:英伟达发布 GR00T N1,打造完整仿真、合成数据与芯片生态。

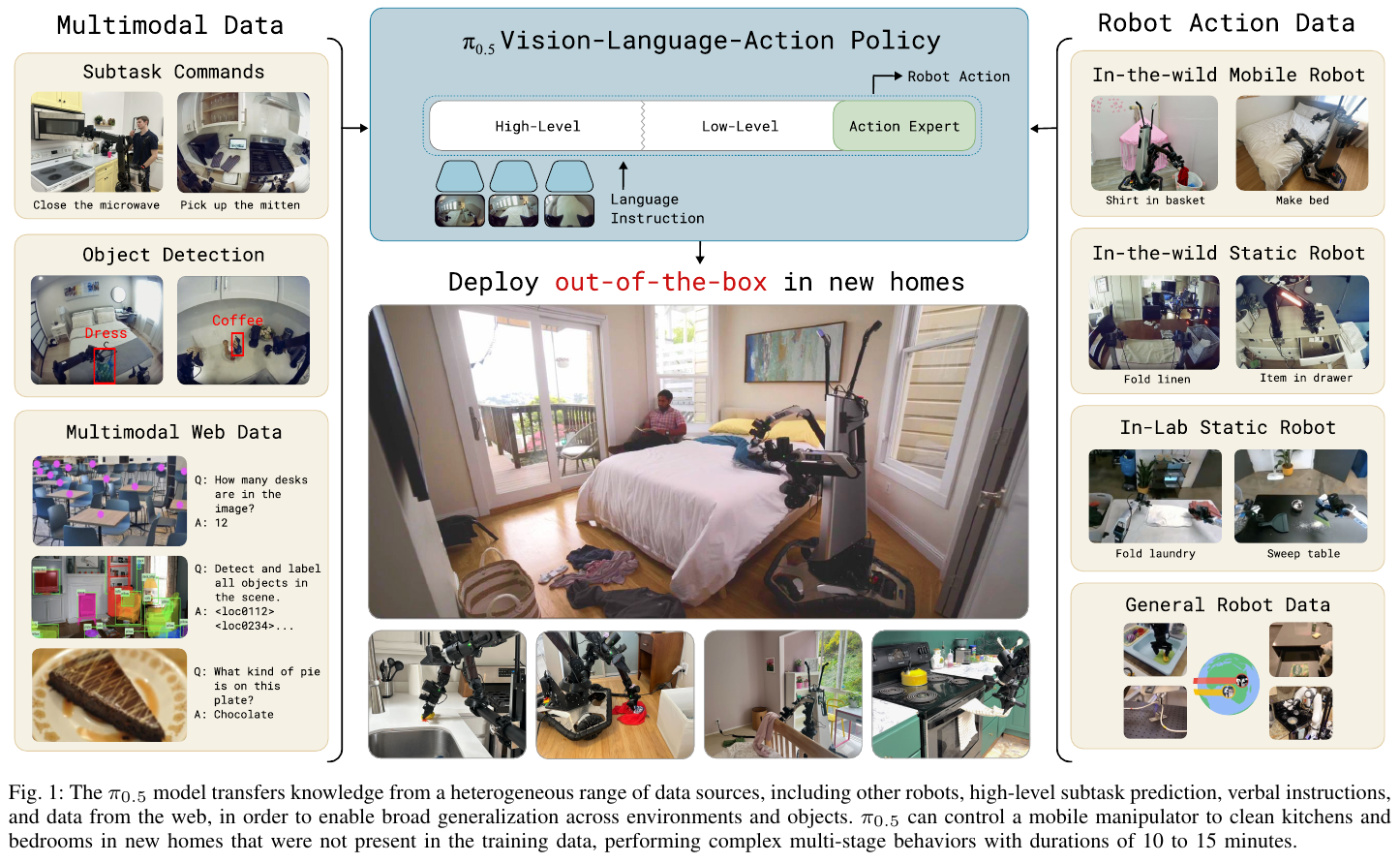

- 2025年4月:π₀.5 实现开放世界家庭长时程任务泛化(10-15分钟连续执行)。

- 2026年1月:ACoT-VLA 引入动作空间推理;ICLR 2026 收录 164 篇相关论文。

2.2 VLA的三个核心要素

一个完整的VLA系统包含三个核心组成部分:

flowchart TD

In["视觉观察 + 语言指令"] --> VE["1. 视觉编码器<br/>Vision Encoder"]

In --> LAB["2. 语言-行动骨干网络<br/>Language-Action Backbone"]

VE --> LAB

LAB --> AD["3. 动作解码器<br/>Action Decoder"]

AD --> Out["机器人控制动作"]

style VE fill:#f9f,stroke:#333

style LAB fill:#bbf,stroke:#333

style AD fill:#dfd,stroke:#333

1. 视觉编码器(Vision Encoder):从单眼到多眼

功能:从相机图像中提取视觉特征表示。

主流架构演进:

- 单编码器(早期/RT-2):使用单一 ViT 或 PaLI-X 处理所有信息,效率相对较低。

- 双编码器(OpenVLA 模式):

- DINOv2:负责提取几何与空间特征(理解“在哪里”)。

- SigLIP:负责提取语义与常识特征(理解“是什么”)。

- 多视角融合:通过融合侧方、腕部等多摄像头输入,解决遮挡与深度感知问题。

2. 语言-行动骨干网络(Language-Action Backbone):System 1 与 System 2 的融合

功能:作为“大脑”层,负责指令理解、推理与动作规划。

flowchart TD

User[用户指令: "帮我洗杯子"] --> S2

Obs[多视角视觉观察] --> S2

Obs --> S1

subgraph S2 ["System 2 (慢思考/脑): 高层规划器"]

VLM[预训练 VLM] --> TaskDecomp[任务分解: 1.移动 2.抓取 3.清洗]

TaskDecomp --> SubGoal[子目标生成: 3D 姿态/语义点]

end

SubGoal -- "低频指令 (~5Hz)" --> S1

subgraph S1 ["System 1 (快思考/小脑): 动作专家"]

Controller[Flow Matching/Diffusion] --> Motor[电机电流/扭矩控制]

Motor --> Feedback[实时触觉/位姿反馈]

Feedback --> Controller

end

Motor --> Act[物理动作执行]

Feedback -.-> S2

style S2 fill:#e1f5fe,stroke:#01579b

style S1 fill:#fff3e0,stroke:#e65100

主流架构:

- Transformer-based LLM:如 Llama-2/3、Phi-3 等。

- 双系统架构(NVIDIA GR00T 范式):

- System 2 (慢思考):基于视觉语言模型负责理解环境、解读指令并作出长时序规划(~5Hz)。

- System 1 (快思考):基于扩散 Transformer (DiT) 或流匹配负责高频、精细的反射性动作(~50Hz)。

3. 动作解码器(Action Decoder):从语言 Token 到高频连续轨迹

功能:将模型的高层决策转化为具体的机器人控制信号。

graph LR

subgraph "第一代: 离散 Token (2022-2023)"

T1[动作离散化 bins] --> T2[语言模型自回归生成]

T2 --> T3[执行频率: 1-5Hz]

end

subgraph "第二代: 扩散模型 (2023-2024)"

D1[高斯噪声] --> D2[迭代去噪 Diffusion]

D2 --> D3[多模态分布建模]

D3 --> D4[执行频率: 10-20Hz]

end

subgraph "第三代: 流匹配 Flow Matching (2024-2026)"

F1[概率路径学习] --> F2[直接生成连续轨迹]

F2 --> F3[极精细控制: 折纸/扑克]

F3 --> F4[执行频率: 50Hz+]

end

T3 -.-> D1

D4 -.-> F1

主流范式比较:

- 离散动作建模(RT-2/OpenVLA):将动作视为语言 Token 预测。优点是架构统一,缺点是难以生成连续流畅的高频动作。

- 连续动作建模(Diffusion Policy):使用扩散过程建模动作分布,能捕获多模态动作可能性,在精细操作中表现更优。

- 流匹配(Flow Matching, π₀):直接生成连续的关节轨迹,支持 50Hz 高频控制。这是实现“折纸、玩扑克牌”等极高精度任务的关键。

2.3 VLA系统的基本组成

VLA系统通常由以下模块构成,呈现出明显的端到端统一建模趋势:

1. 感知模块(Perception Module)—— 多模态视觉编码

功能:从环境中提取视觉和语言的观察信息。

架构演进:

- 早期:单一RGB图像编码

- 现在:多视角、深度图像、点云等多模态输入

- 趋势:引入触觉、力传感等非视觉模态

关键技术:

- 视觉-语言对齐预训练(如CLIP)

- 自监督视觉表示学习(如DINOv2)

- 时序信息编码(处理视频输入)

2. 推理模块(Reasoning Module)—— 语言引导的任务规划

功能:理解任务指令,进行高层次的任务分解和规划。

实现方式:

- 隐式推理:直接在VLA模型内部进行端到端推理

- 显式推理:利用大语言模型进行链式思考(CoT)和子目标分解

推理能力:

- 常识推理:理解物理世界的基本规律

- 因果推理:预测动作的后果

- 组合泛化:处理未见过的物体组合和任务

3. 控制模块(Control Module)—— 精确的动作执行

功能:将高层决策转化为底层电机控制信号。

控制范式:

- 开环控制:直接预测动作序列

- 闭环控制:基于视觉反馈持续调整动作

- 分层控制:高层规划 + 低层控制器(如MPC)

控制频率:

- 传统VLA:10Hz左右

- 优化后的VLA(如OFT):30Hz+,支持双臂高频控制

2.4 VLA与传统机器人控制的区别

VLA代表了机器人控制范式的根本性转变:

flowchart TD

subgraph Trad ["传统机器人控制: 模块化"]

T1["感知/检测"] --> T2["规划/路径"] --> T3["控制/PID"]

end

subgraph VLA_Sys ["VLA: 端到端统一"]

V1["视觉+文本"] --> V2(("单一神经网络模型")) --> V3["动作输出"]

end

style V2 fill:#f96,stroke:#333,stroke-width:2px

从模块化到端到端

传统方法:

- 感知模块:物体检测、位姿估计

- 规划模块:轨迹规划、路径优化

- 控制模块:PID控制、力控制

- 各模块独立设计和优化

VLA方法:

- 单一神经网络直接从像素到控制信号

- 联合优化所有组件

- 减少了模块间的信息损失

从任务特定到通用能力

传统方法:

- 为每个任务设计专门的控制策略

- 难以泛化到新任务和新环境

- 需要大量的工程调试

VLA方法:

- 通过自然语言指令指定任务

- 零样本或少样本泛化到新任务

- 利用预训练知识处理未见场景

从显式建模到隐式学习

传统方法:

- 需要精确的环境模型和物体模型

- 依赖手工设计的特征和规则

- 对模型误差敏感

VLA方法:

- 从数据中隐式学习环境动力学

- 自动发现任务相关的特征

- 对感知噪声和模型不确定性更鲁棒

从工程驱动到数据驱动

传统方法:

- 依赖专家知识和人工调参

- 开发周期长,部署成本高

- 难以处理长尾场景

VLA方法:

- 基于大规模演示数据学习

- 通过数据增强提升泛化能力

- 持续学习和在线适应

2.5 VLA的主要挑战

本节采用挑战驱动分类法(Challenge-Centric Taxonomy),围绕VLA研究的五大核心瓶颈进行组织,而非传统的架构或任务分类。这种分类方式更好地反映了当前VLA领域亟需突破的关键问题。

VLA研究的五大核心挑战体系:

flowchart TD

Root(("VLA 核心挑战体系")) --> C1["1. 表示 Representation"]

Root --> C2["2. 执行 Execution"]

Root --> C3["3. 泛化 Generalization"]

Root --> C4["4. 安全 Safety"]

Root --> C5["5. 数据 Data"]

C1 --> C1a["3D空间表示"]

C1 --> C1b["动态世界模型"]

C2 --> C2a["任务分解规划"]

C2 --> C2b["实时性优化"]

C3 --> C3a["Sim-to-Real 迁移"]

C3 --> C3b["持续技能获取"]

C4 --> C4a["可解释性 CoT"]

C4 --> C4b["人机协作交互"]

C5 --> C5a["多源数据整合"]

C5 --> C5b["标准化评测基准"]

这五大挑战形成了VLA系统的完整开发路径:

💡 核心链路概览:

- 表示 (Representation):建立多模态感知与物理世界的连接(2D → 3D/4D)

- 执行 (Execution):实现指令理解、分层规划与 30Hz+ 实时控制

- 泛化 (Generalization):从仿真迁移(Sim-to-Real)到开放世界持续进化

- 安全 (Safety):确保动作的可解释性(CoT)与人类交互的可靠性

- 数据 (Data):构建多源异构数据集(OXE)与标准化的评测基准(VLABench)

挑战1:多模态对齐与物理世界建模

核心问题:弥合语义感知与物理交互之间的鸿沟,实现从2D图像到时空表示的跨越,并发展动态预测世界模型。

多模态对齐与物理世界建模的三层架构:

- 基础对齐层:语义到物理的接地(Vision-Language-Action对齐)

- 时空表示层:从2D图像到3D空间表示

- 动态预测层:世界模型与物理动力学建模

flowchart TB

L1["第一层:基础对齐层<br/>语义接地(OTTER、LIV、CLIP-RT)"]

L2["第二层:时空表示层<br/>2D→3D 空间表示(PointVLA、OccLLaMA)"]

L3["第三层:动态预测层<br/>世界模型与物理动力学(TriVLA、DreamVLA)"]

L1 --> L2 --> L3

style L1 fill:#ffe0b2,stroke:#e65100

style L2 fill:#e1f5fe,stroke:#0277bd

style L3 fill:#e8f5e9,stroke:#2e7d32

VLA模型需要将视觉-语言模型的语义理解能力转化为对物理世界的准确建模,这涉及三个层次的挑战:

1.1 语义到物理的接地(Semantic-to-Physical Grounding)

问题描述:如何将抽象的语言描述(如”红色的杯子”)映射到物理世界中的具体对象和可执行动作。这涉及三个层次的对齐挑战:

(1)Vision-Language Gap(视觉-语言鸿沟)

- 问题:RGB的高维感知空间与抽象符号语言之间的语义鸿沟

- 解决方案:

- OTTER:文本感知的特征提取机制

- LIV:针对机器人控制数据的对比学习框架

- 符号推理方式:ACT-LLM, Look Leap等利用LLM进行高层符号推理

(2)Vision-Language-Action Gap(视觉-语言-动作三元鸿沟)

- 问题:VLM的感知对齐能力如何转化为实际的物理动作执行

- 解决方案:

- 端到端微调:RT-2, OpenVLA通过动作token化实现VLM到VLA的转化

- 共享中间表示:CLIP-RT, Humanoid-VLA在动作和感知间建立共享语义空间

- 层级架构:引入显式规划层作为语义-动作的桥梁

- VoxPoser:LLM推理生成3D Affordance Map作为中间表示

(3)多模态感觉融合(Sensory Fusion)

- 问题:如何整合触觉、力传感、音频等额外模态

- 解决方案:

- 专业编码器 + 对比学习:TLA, OmniVTLA对齐多感觉模态

- 融合策略:深融合(Tactile-VLA)vs 模块化MoE融合(ForceVLA)

- 生成式方案:MultiGen在模拟器中生成多模态数据

代表性工作:

- CLAP:对齐视频视觉潜在空间与机器人动作空间

- Point-VLA:通过显式视觉提示(边界框)解决指代模糊

- VoxPoser:生成3D可供性图作为强中间表示

- Tactile-VLA/ForceVLA:整合触觉和力传感的多模态VLA

1.2 2D到3D的空间表示(2D-to-3D Spatial Representations)

问题描述:从2D图像输入推断3D空间结构,理解深度、遮挡和空间关系。这是从平面视觉到立体物理世界的关键跨越。

空间表示层次:

- 2.5D深度地图:Depth Helps, RoboFlamingo-Plus利用深度信息增强空间感知

- 点云表示:PointVLA, GeoVLA, FP3直接操作3D点云进行操作规划

- 体素/占据栅格:OccLLaMA, RoboMM使用体素化占据表示学习场景结构

- 4D表示(新方向):ARM4R预测3D点的时序运动轨迹,实现动态空间建模

架构集成策略:

- 适配器方法:PointVLA, GeoVLA保留预训练骨干网络,通过轻量适配器注入3D信息

- 隐式方法:Evo-0 + VGGT, AC-DiT将3D信息作为扩散模型的条件

- 2D投影方式:BridgeVLA, RoboPoint, A0将3D表示投影回2D进行处理

- VLM推理方式:VoxPoser, Gemini Robotics利用VLM的推理能力生成3D表示

代表性工作:

- OccLLaMA:基于占据网络的3D场景理解,学习体素化空间表示

- TraceVLA:3D轨迹追踪与预测,理解物体运动

- PointVLA/GeoVLA:直接在3D点云上进行操作推理

- ARM4R:预测3D点的运动轨迹,实现4D时空建模

1.3 动态世界建模(Dynamic World Modeling)

问题描述:预测物体交互的动态变化,理解物理规律和因果关系。世界模型使VLA能够”想象”动作的后果,进行更智能的规划。

表示空间选择:

- 观察空间预测(高保真):

- TriVLA, UP-VLA:预测未来视觉观察,提供直观的视觉反馈

- CoT-VLA, DreamVLA:生成视觉子目标作为中间推理步骤

- FlowVLA, WorldVLA:基于flow matching的视频预测

- 潜在空间预测(高效):

- VLM-in-the-Loop:在压缩潜在空间中进行快速预测

- MinD:轻量级潜在动力学模型

- WMPO:结合世界模型的策略优化

利用范式:

- 策略增强:短期预测作为辅助信号指导动作生成

- TriVLA, CoT-VLA:视觉预测作为推理链

- DreamVLA:梦境模拟辅助决策

- 显式规划:解耦的内部模拟器进行前瞻规划

- LUMOS:分离的世界模型用于规划

- VLM-in-the-Loop:闭环规划-执行-验证

- MinD:基于模型的强化学习

代表性工作:

- TriVLA:三角形架构融合过去-现在-未来的视觉表示

- VideoVLA:视频条件的世界模型,预测动作后果

- mimic-video:从人类视频中学习物理动力学

- LUMOS:显式世界模型进行长时程规划

- DreamVLA:在”梦境”中模拟和优化动作序列

未来方向:

- 混合潜在-物理-语义世界模型:整合3D几何、物理动力学和语义属性

- 因果世界模型:显式建模动作-结果的因果关系

- 可学习物理先验:在神经网络中编码物理定律(守恒律、碰撞等)

挑战2:指令跟随、规划与鲁棒实时执行

核心问题:解析复杂指令,进行分层任务分解,实现错误检测与自主恢复,并保证实时计算效率。

指令跟随、规划与实时执行的完整流程:

指令理解 → 任务分解与规划 → 动作执行 → 错误检测与恢复 → 实时性优化

flowchart LR

A["指令理解"] --> B["任务分解与规划"] --> C["动作执行"] --> D["错误检测与恢复"] --> E["实时性优化"]

D -->|重规划| B

style A fill:#f3e5f5,stroke:#7b1fa2

style C fill:#e8f5e9,stroke:#2e7d32

style D fill:#ffebee,stroke:#c62828

style E fill:#e3f2fd,stroke:#1565c0

2.1 复杂指令解析与理解

问题描述:理解多样化、组合式的自然语言指令,处理模糊性和不完整性。真实世界的指令往往包含多模态信息、隐含假设和不明确的描述。

开放式多模态指令:

- 混合文本+图像+草图:

- OE-VLA:处理开放式混合模态指令

- Interleave-VLA:交错处理图像和文本序列

模糊和欠指定指令:

- 场景解析与验证:

- ThinkAct:场景分析和反馈验证机制

- DeepThinkVLA:因果CoT推理和结果驱动RL

- 空间推理:

- InSpire:显式空间推理提示,理解”左边”、”上面”等相对位置

- 主动澄清:

- AskToAct:模糊识别模块+主动请求用户澄清

关键技术:

- 大语言模型推理:利用LLM进行语义理解和常识推理

- 上下文学习:通过少样本示例快速适应新指令模式

- 多轮对话:支持交互式指令澄清

代表性工作:

- ThinkAct:思考-行动架构,在执行前进行推理验证

- InSpire:空间推理增强的指令理解

- AskToAct:主动询问机制,处理模糊指令

2.2 分层任务分解与规划

问题描述:将长时序复杂任务分解为可执行的子任务序列,并进行高层规划。这是处理复杂多步骤任务的关键能力。

三大规划范式:

(1)语言驱动规划

- 单推理链方法:

- π0.5:在单一推理链中生成明确的语言子任务

- OneTwoVLA:在关键决策点进行结构化文本推理

- 层级方法:

- Hi Robot:两层架构(VLM规划 + VLA执行)

- LoHoVLA:端到端学习的层级范式,无需显式分解

(2)多模态中间表示规划

- 视觉驱动规划:

- CoT-VLA:生成像素级视觉子目标作为推理步骤

- Embodied-SlotSSM:基于对象中心的表示

- HiP:三层架构(任务-子任务-动作)

- Affordance驱动规划:

- RT-Affordance:预测可操作性作为中间表示

- CoA-VLA:Chain-of-Affordance推理

(3)技能库组合规划

- 显式技能库:

- VLP:预定义技能的组合

- Agentic Robot:技能库管理和选择

- RoboBrain:大规模技能记忆库

- 隐式技能学习:

- DexVLA:billion参数的隐式技能表示

- AgiBot World:从大规模数据中自动发现技能

关键技术:

- 具身数字孪生:使用基于物理的交互式数字孪生作为具身世界模型(如EToT)

- 专家混合(MoE):通过专家混合层将长时序任务分解为专门技能(如MoE-DP)

- 分层强化学习:在不同抽象层次上学习策略

代表性工作:

- π₀.5:增强的推理能力,支持多步骤规划(详见经典论文第7节)

- Hi Robot:显式的两层层级架构

- CoT-VLA:视觉子目标作为思维链

- ACoT-VLA:动作空间推理(详见经典论文第9节)

- DexVLA:billion参数的灵巧操作专家

- WALL-OSS:大规模分层规划系统

2.3 错误检测与自主恢复

问题描述:实时检测执行失败,并自主生成恢复策略。

关键技术:

- 失败预测:基于视觉反馈预测潜在失败

- 重规划机制:动态调整执行计划

- 链式思考推理:通过CoT进行故障诊断(如CoT-VLA)

代表性工作:

- Fast-ThinkAct:实时推理与失败恢复

- CoT-VLA:链式思考增强的VLA

2.4 实时性与计算效率

问题描述:满足高频控制的实时性要求(30Hz+),同时保证推理准确性。大规模VLA模型的计算开销是实时部署的主要瓶颈。

四大优化方向:

(1)静态架构优化

- 压缩量化:

- BitVLA:1-bit量化,极致压缩

- Evo-1:77M参数的超轻量模型

- 轻量级骨干网络:

- NORA, TinyVLA:专为实时控制设计的小型架构

- 线性注意力机制:

- SARA-RT, RoboMamba:用Mamba/SSM替代Transformer的二次复杂度

(2)动态优化解码过程

- 动态推理路径:

- MoLe-VLA:跳层推理,根据任务难度动态调整深度

- CEED-VLA, DeeR-VLA:提前退出机制

- Token处理优化:

- VLA-Cache:自适应KV缓存

- SpecPrune-VLA:token级别剪枝

- CogVLA:认知导向的token选择

- 加速解码:

- OpenVLA-OFT:并行解码,25-50倍加速

- Spec-VLA:推测解码

(3)动作表示和生成范式优化

- 高效token化:

- FAST:频率空间动作序列token化,15倍加速

- XR-1, VQ-VLA:向量量化动作表示

- 异步执行:

- SmolVLA:450M参数实时运行

- Real-Time Action Chunking:动作块异步执行

- 加速扩散:

- Time-Diffusion Policy:时间条件加速

- Discrete Diffusion VLA:离散扩散加速

(4)训练范式优化

- 训练时推理,推断时跳过:

- ECoT-Lite:训练中使用推理,推断时直接输出

- 预测压缩表示:

- V-JEPA 2:预测语义压缩表示而非像素

- 双系统架构:

- Fast-in-Slow:快速System 1 + 慢速System 2

- 联邦学习:

- FedVLA:分布式训练框架

关键技术:

- 模型压缩:量化、剪枝、蒸馏

- 推理优化:动作token压缩、批处理优化

- 边缘部署:轻量化架构设计

代表性工作:

- SmolVLA:450M参数实时运行

- FAST:动作tokenizer,15倍推理加速

- OpenVLA-OFT:优化微调,25-50倍加速

- RoboMamba:Mamba架构的线性复杂度

- MoLe-VLA:动态深度推理

未来方向:

- 自适应架构:根据任务难度自动调整推理深度和模型规模

- 统一决策Token:see-think-act的统一token流

- 硬件协同优化:专用芯片加速VLA推理

挑战3:从泛化到持续适应

核心问题:实现开放世界泛化,支持持续学习与增量技能获取,完成sim-to-real迁移,并启用在线强化学习。

从泛化到持续适应的四层递进体系:

- 开放世界泛化:未见环境/物体/任务的零样本能力

- 持续学习:增量技能获取,避免灾难性遗忘

- Sim-to-Real迁移:缩小仿真与真实的差距

- 在线强化学习:从交互中自主学习和改进

flowchart TB

G1["开放世界泛化<br/>未见环境/物体/任务的零样本能力"]

G2["持续学习<br/>增量技能获取,避免灾难性遗忘"]

G3["Sim-to-Real 迁移<br/>缩小仿真与真实世界的差距"]

G4["在线强化学习<br/>从实时物理交互中自主学习"]

G1 --> G2 --> G3 --> G4

style G1 fill:#e3f2fd,stroke:#1565c0

style G2 fill:#e8f5e9,stroke:#2e7d32

style G3 fill:#fff3e0,stroke:#e65100

style G4 fill:#fce4ec,stroke:#880e4f

3.1 开放世界泛化(Open-World Generalization)

问题描述:在未见环境、未见物体和未见任务组合上的零样本或少样本泛化。这是VLA模型走向通用性的关键。

四大策略:

(1)知识迁移与利用

- 多任务/多机器人预训练:

- Octo:在800k机器人轨迹上预训练,学习通用操作规律

- DexVLA:billion参数扩散专家,跨机器人形态预训练

- RoboCat:异构多机器人数据持续训练

- Dita:leveraging OXE数据集和扩散Transformer

- EO-1:在1.5M-EO-Data上预训练共享骨干

- 互联网/人类视频知识迁移:

- R3M:在Ego4D等人类第一人称视频上预训练视觉编码器

- GR系列(GR-1, GR-2):从人类视角视频迁移物理和交互知识

(2)范式级创新

- In-Context Learning:

- ICIL:从prompt中的少量演示推断任务,无需重新训练

- 涌现组合性:

- TRA:时间对比损失赋予表示空间组合结构

- 概念泛化:

- ObjectVLA:联合训练机器人轨迹和box标注VL数据,实现零样本操作

- LERF:融合CLIP和3D NeRF,实现自然语言定位和抓取

- 自适应范式:

- Align-Then-Steer:非侵入式适应,用轻量潜在空间适配器引导冻结VLA

- Robot Utility Models (RUM):配对大规模家庭演示和VLM推理,实现零样本部署

(3)增强数据多样性

- 数据增强:

- CACTI:扩散修补技术生成多样化场景

- GenAug:文本到图像合成增强训练数据

- 语义增强:

- ROSIE:VLM知识蒸馏到机器人策略

(4)自适应架构设计

- 分层设计:高层抽象语义+低层具体执行

- 多模态融合:BAKU等多模态感知融合架构

- 生成多样性:StructDiffusion等结构化生成方法

关键技术:

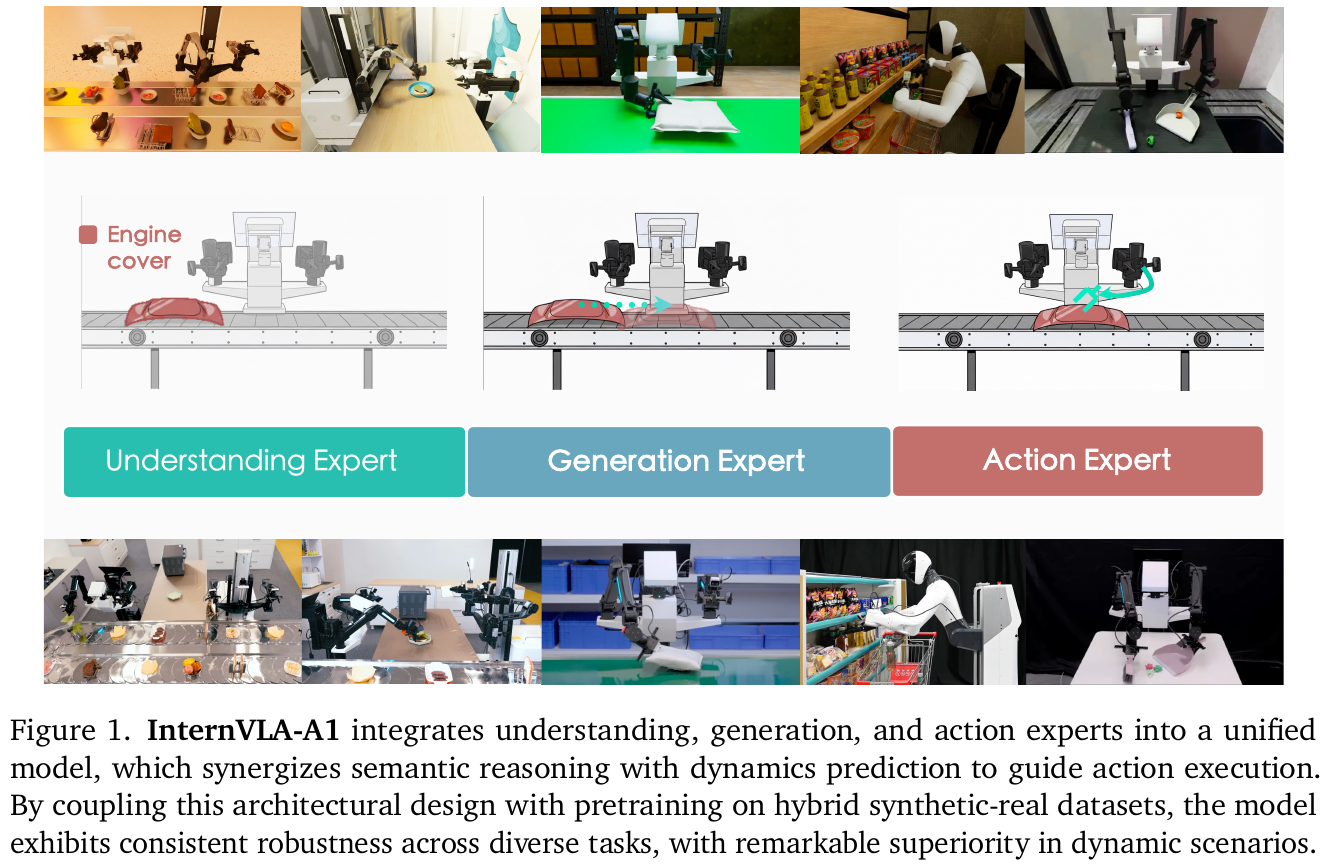

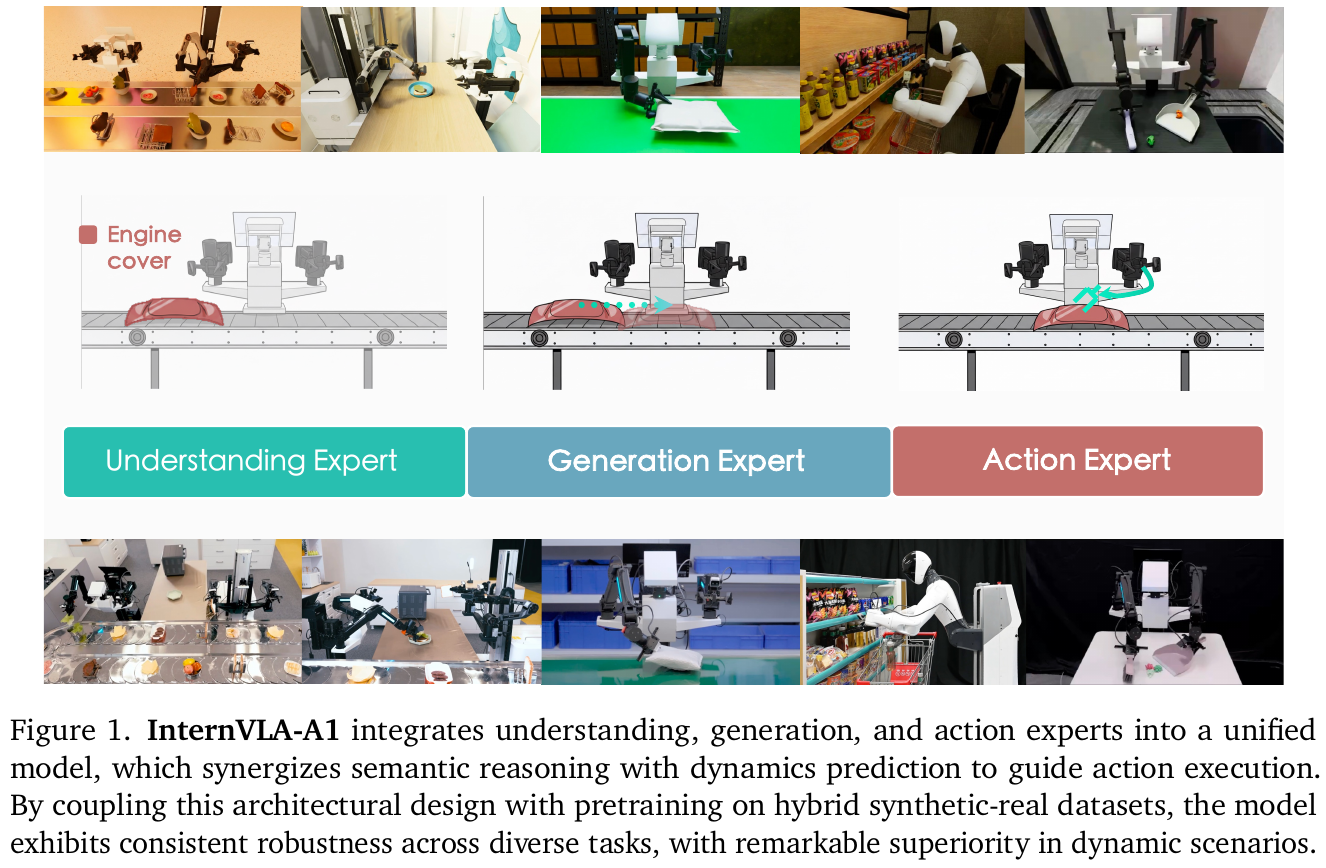

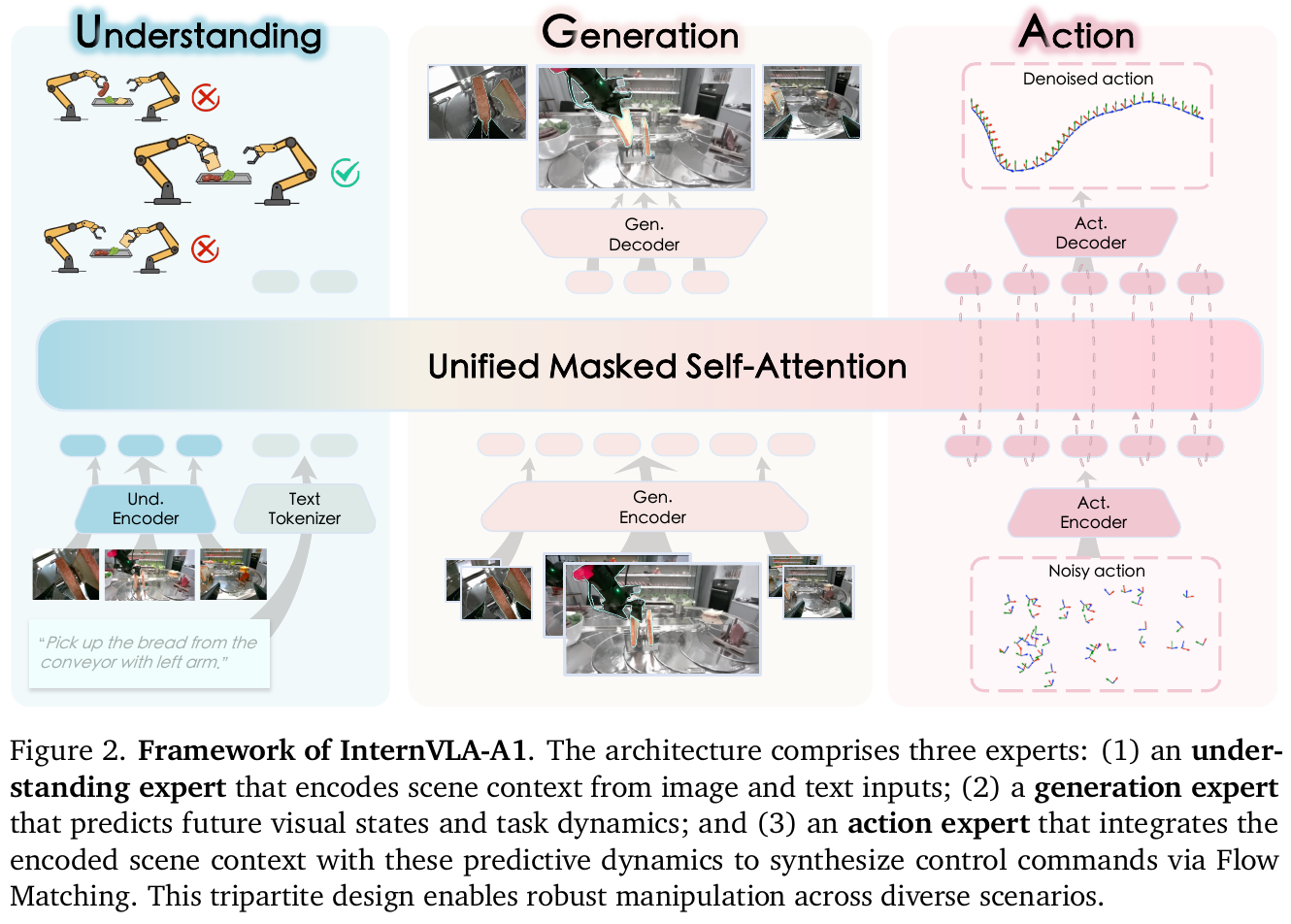

- 空间接地预训练:结合空间引导的动作后训练(如InternVLA-M1)

- 大规模多样化数据:在海量异构数据上预训练

- 元学习:学习快速适应新任务的能力

代表性工作:

- Octo:800k轨迹预训练的通用策略

- DexVLA:billion参数跨形态专家

- R3M/GR-2:从人类视频迁移知识

- ICIL:上下文学习范式

- ObjectVLA/LERF:概念级泛化

- Robot Utility Models:零样本家庭部署

3.2 持续学习与增量技能获取

问题描述:在不遗忘旧技能的前提下持续学习新技能。这是构建终身学习机器人的核心挑战。

两大策略:

(1)参数隔离与扩展

- 基于提示/码书学习:

- 新技能独立编码为提示或码书向量

- 保持核心参数不变,避免灾难性遗忘

- 模块化MoE架构:

- InstructVLA:专家混合架构,每个专家负责特定技能

- iManip:PerceiverIO架构实现模块化技能表示

(2)回放知识巩固

- 压缩经验回放:

- ExpReS-VLA:压缩体验回放,高效存储历史经验

- 时间回放策略:

- iManip:关键帧回放,保留重要状态转移

关键技术:

- 经验回放:保留旧任务数据防止遗忘

- 弹性权重固化:保护重要参数

- 模块化技能库:独立学习和组合技能模块

代表性工作:

- InstructVLA:MoE架构的终身学习

- iManip:模块化技能表示

- ExpReS-VLA:压缩经验回放

评测基准:

- LIBERO:首个终身机器人学习基准,评估技能保留和迁移

3.3 Sim-to-Real迁移

问题描述:缩小仿真训练与真实部署之间的性能差距。仿真器提供了无限的训练数据,但存在现实差距(Reality Gap)。

两大策略:

(1)增强模拟保真度

- 高保真仿真器:

- ManiSkill3:GPU并行渲染+物理模拟,域随机化

- 提升视觉、物理、动力学的真实感

- 稳定中间表示:

- SLIM:使用分割+深度等对光照不敏感的表示

- 减少视觉域差异

(2)数据驱动模拟器

- 生成增强:

- GenAug:无模拟器直接从文本生成训练数据

- 绕过传统仿真流程

- 学习世界模型:

- DreamGen:从真实数据学习生成模型

- RynnVLA-001:神经模拟器

(3)高效真实适应

- 快速微调:

- AdaWorld:在少量真实数据上高效适应

- 利用仿真预训练作为强初始化

- 鲁棒视觉表示:

- 学习对光照、纹理变化不敏感的特征

- 自监督预训练(DINOv2等)

关键技术:

- 域随机化:增强模拟环境的多样性

- 高效适应:快速在真实环境中微调

- 鲁棒视觉表示:学习对外观变化不敏感的特征

代表性工作:

- ManiSkill3:新一代GPU并行仿真器

- SLIM:稳定中间表示减少域差距

- GenAug:生成式数据增强

- AdaWorld:高效sim-to-real适应

未来方向:

- 神经模拟器:完全从数据学习的可微分模拟器

- 双向迁移:real-to-sim用于改进仿真器

3.4 在线强化学习

问题描述:通过与环境交互自主学习和改进策略。相比离线模仿学习,在线RL能够自主探索和优化。

两大方向:

(1)优化学习过程

- 知识迁移加速:

- RLDG:蒸馏预训练VLA知识到RL策略

- Refined Policy Distillation:MSE约束保持预训练能力

- iRe-VLA:阶段性冻结-解冻策略

- 算法内部优化:

- CO-RFT:分块时间差分学习,稳定训练

(2)自动化奖励生成

- 感知对齐奖励:

- VLM-RMs:用VLM作为奖励模型

- RoboCLIP:CLIP对齐的奖励信号

- Affordance-Guided RL:可供性作为奖励

- VLM批评:

- RL-VLM-F:GPT-4V比较不同轨迹

- GRAPE:VLM生成密集奖励信号

- 代码生成奖励:

- Eureka:LLM生成奖励函数代码

- VIP:视觉-语言-策划一体化

- VLA-RL:端到端VLA强化学习

关键技术:

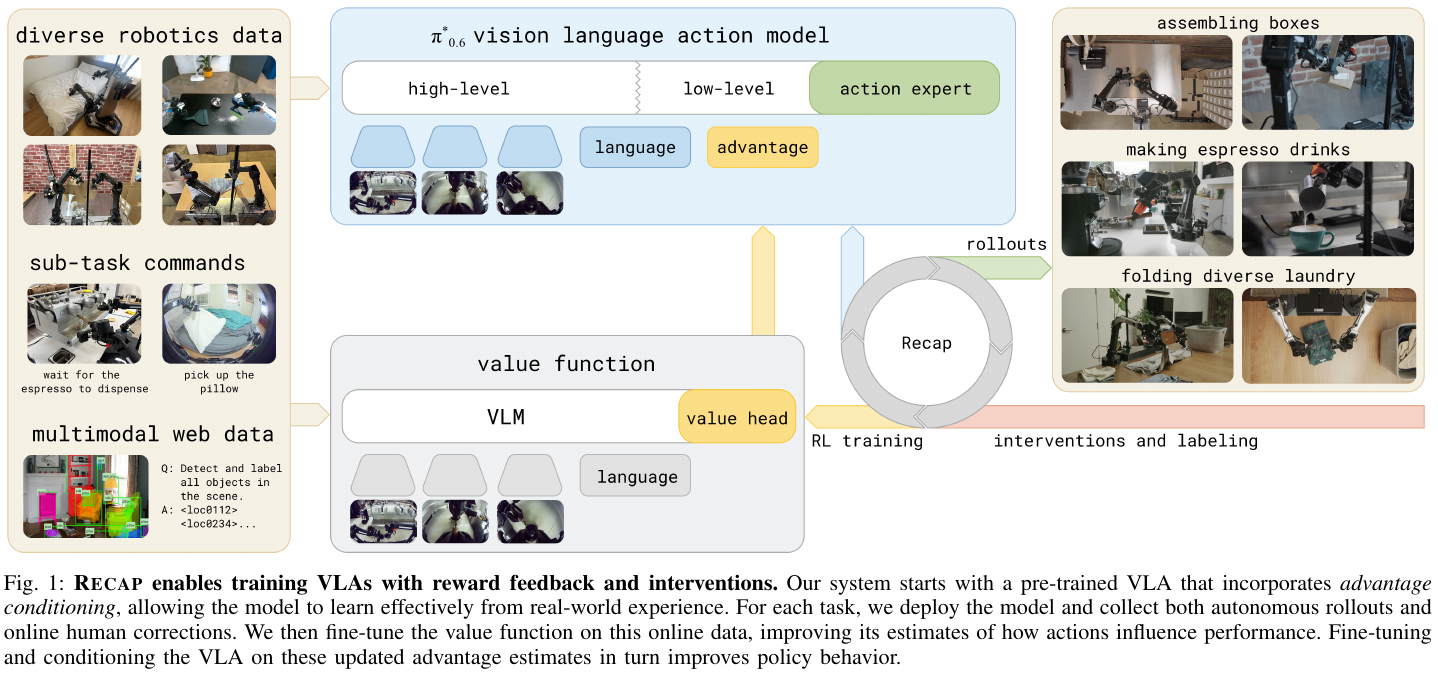

- 离线到在线:先离线预训练再在线微调(π*0.6)

- 安全探索:在保证安全的前提下探索

- 奖励学习:从人类反馈中学习奖励函数

代表性工作:

- π*₀.₆:从经验中学习,整合专家干预的RL(详见经典论文第8节)

- SERL:样本高效的机器人RL套件

- Eureka:LLM自动生成奖励函数

- VLA-RL:端到端VLA强化学习框架

- RLDG:知识蒸馏加速RL训练

未来方向:

- 形态无关表示:跨具身形态的策略迁移

- 零样本跨具身迁移:在一个机器人上学习,直接部署到另一个

- 自主开放式进化:部署→发现→进化的闭环系统

挑战4:安全性、可解释性与可靠交互

核心问题:确保可靠性保证,提升可解释性,实现可信的人机交互,并满足安全约束。

安全性与可解释性的双层结构:

- 第一层:可靠性保证

- 基于约束的安全(规则约束、内部化约束)

- 学习对齐(值对齐、不确定性评估)

- 第二层:透明可信交互

- 增强过程可解释性(CoT、层级结构)

- 行为可预测性(外化决策逻辑)

flowchart TD

subgraph L1 ["第一层:可靠性保证"]

A1["基于约束的安全<br/>AutoRT / SafeVLA / VLSA-AEGIS"]

A2["学习对齐<br/>Gemini Robotics / GPI / RationalVLA"]

end

subgraph L2 ["第二层:透明可信交互"]

B1["增强可解释性<br/>CoT推理 / 层级架构 / ECoT"]

B2["行为可预测性<br/>外化决策逻辑 / CrayonRobo"]

end

L1 --> L2

style L1 fill:#e8f5e9,stroke:#2e7d32

style L2 fill:#e3f2fd,stroke:#1565c0

4.1 可靠性保证

问题描述:保证VLA系统在各种情况下的稳定性和可预测性。机器人与物理世界交互,错误可能导致严重后果。

三大范式:

(1)基于约束的安全范式

- 规则约束:

- AutoRT:宪法提示 (Constitutional Prompting) 硬编码安全规则,为机器人建立底线行为准则。

- 区块链硬约束:OpenMind 提出的前卫方案,将机器人安全规则写入以太坊区块链。由于区块链的不可篡改性,防止机器人(或恶意软件)修改自身的安全日志或绕过核心限制。

(2)学习对齐范式

- 值对齐:

- Gemini Robotics:使用 Constitutional AI 后训练,使机器人决策对齐人类价值观。

- 不确定性评估:

- GPI:置信度估计+回溯机制。

- RationalVLA:可学习的拒绝token,主动拒绝不安全/无效指令。

(3)即插即用安全层

- VLSA-AEGIS:基于控制屏障函数(CBF)的安全层,无需修改 VLA 模型即可添加物理硬约束。

关键技术:

- 形式化验证:数学证明系统满足安全属性

- 冗余机制:多层次的安全保障

- 失效安全:检测异常并进入安全状态

代表性工作:

- SafeVLA:约束MDP框架

- RationalVLA:学习拒绝危险指令

- GPI:不确定性感知的安全回溯

4.2 可解释性与可信赖性

问题描述:使VLA的决策过程透明可理解,增强用户信任。黑盒模型难以调试和信任。

两大方向:

(1)增强过程可解释性

- 链式思维(CoT):

- Diffusion-VLA:自然语言中间推理步骤

- ECoT:可编辑的推理链,用户可修正错误步骤

- CoT-VLA:视觉子目标作为可视化推理链

- 层级结构天然可解释:

- RT-H, HiRobot:高层语言规划+低层执行

- GraSP-VLA:分层规划提供可追溯性

- 解码隐藏符号状态:

- DIARC-OpenVLA:线性探针解释内部表示

(2)行为可预测性

- 外化决策逻辑:

- CrayonRobo:视觉提示(箭头、高亮)外化决策过程

- 结构化任务切换:

- SwitchVLA:显式任务切换机制(回滚+平滑过渡)

关键技术:

- 可编辑推理链:用户可通过语言修正的逐步推理(如ECoT)

- 注意力可视化:展示模型关注的视觉区域

- 反事实解释:说明为何选择某个动作而非其他

代表性工作:

- ECoT:可编辑的链式思考推理

- CoT-VLA:视觉CoT增强可解释性

- RT-H/HiRobot:层级架构的天然可解释性

- CrayonRobo:视觉化决策过程

未来方向:

- 内在不确定性感知:System 2反思层,自我评估决策质量

- 主动风险规避:检测到歧义时主动暂停并请求帮助

- 交互式安全:可介入的透明性,实时人类监督

- 共享心智模型:机器人与人类对任务的共同理解

4.3 安全约束与主动拒绝

问题描述:在不修改 VLA 核心模型的前提下添加安全约束,使机器人能够识别并拒绝危险或无效指令。

两大技术路线:

插件式安全层:

- VLSA-AEGIS:基于控制屏障函数(CBF)的即插即用安全层

- 在不修改VLA模型的前提下添加硬约束

可学习拒绝机制:

- RationalVLA:学习拒绝不安全/无效指令

- 训练模型识别危险行为并主动拒绝

4.4 人机协作交互

问题描述:与人类自然、高效地协作完成任务。机器人需要理解人类意图、接受反馈并主动沟通。

关键能力:

- 意图识别:

- 理解人类的隐含意图和目标

- 从不完整指令中推断完整任务

- 主动询问:

- AskToAct:检测模糊指令时主动请求澄清

- OneTwoVLA:关键决策点主动询问

- 从反馈学习:

- Yell At Your Robot:实时语言反馈纠正

- CLIP-RT:语言反馈引导

- π*₀.₆:从专家干预中学习(详见经典论文第8节)

- 协作规划:

- 共享心智模型:机器人与人类对任务的共同理解

- 预测人类动作:在协作环境中避免冲突

代表性工作:

- AskToAct:主动澄清机制

- Yell At Your Robot:实时语言纠正

- π*₀.₆:整合人类干预的在线学习(详见经典论文第8节)

未来方向:

- 预测式协作:预测人类下一步动作,主动辅助

- 情境感知安全:根据环境动态调整安全边界

- 自然多模态交互:语言+手势+视觉指向的融合理解

挑战5:数据构建与基准测试标准

核心问题:管理多源异构数据整合,建立标准化评测基准。

数据构建与评测标准双轨体系:

- 数据轨:表示层统一对齐 → 数据层增强优化 → 标准化基准构建

- 评测轨:全面性与标准化 → 任务广度与深度扩展 → 真实场景转仿真

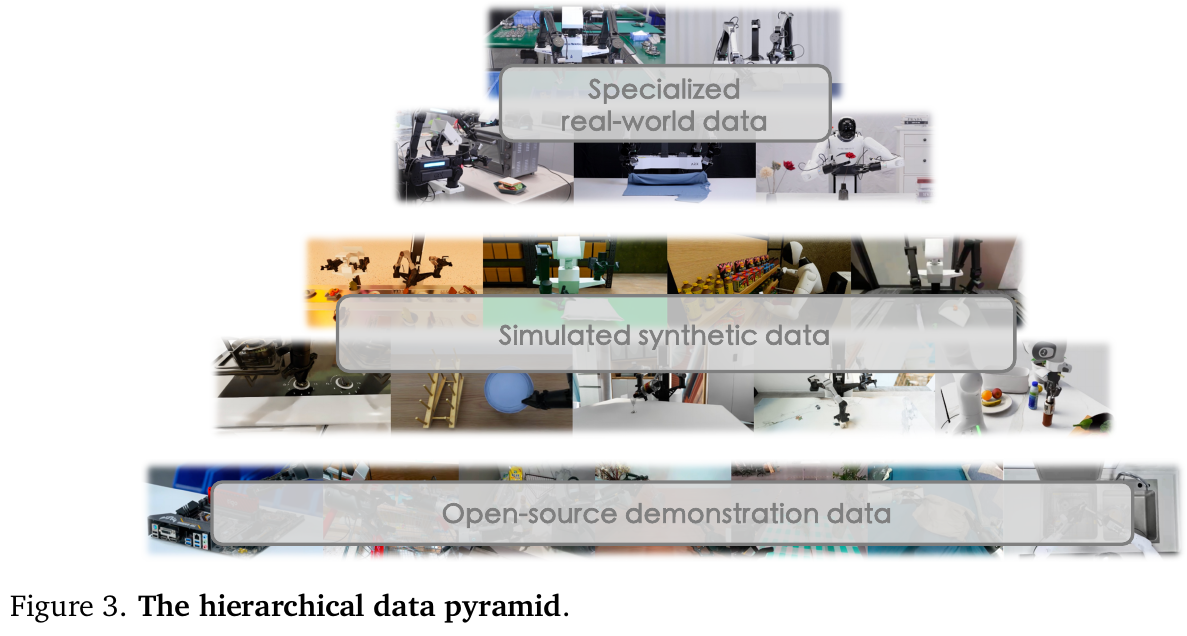

flowchart LR

subgraph DataTrack ["数据轨道"]

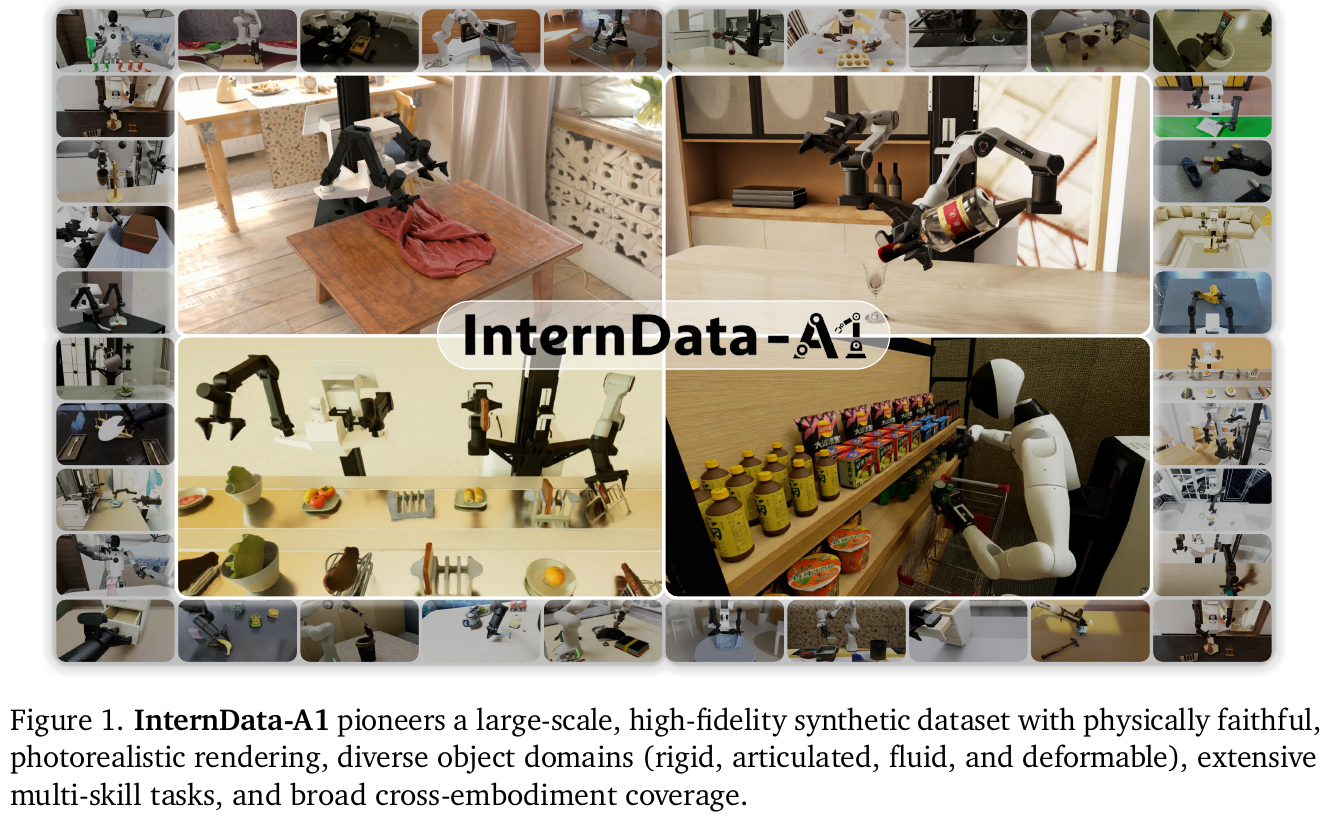

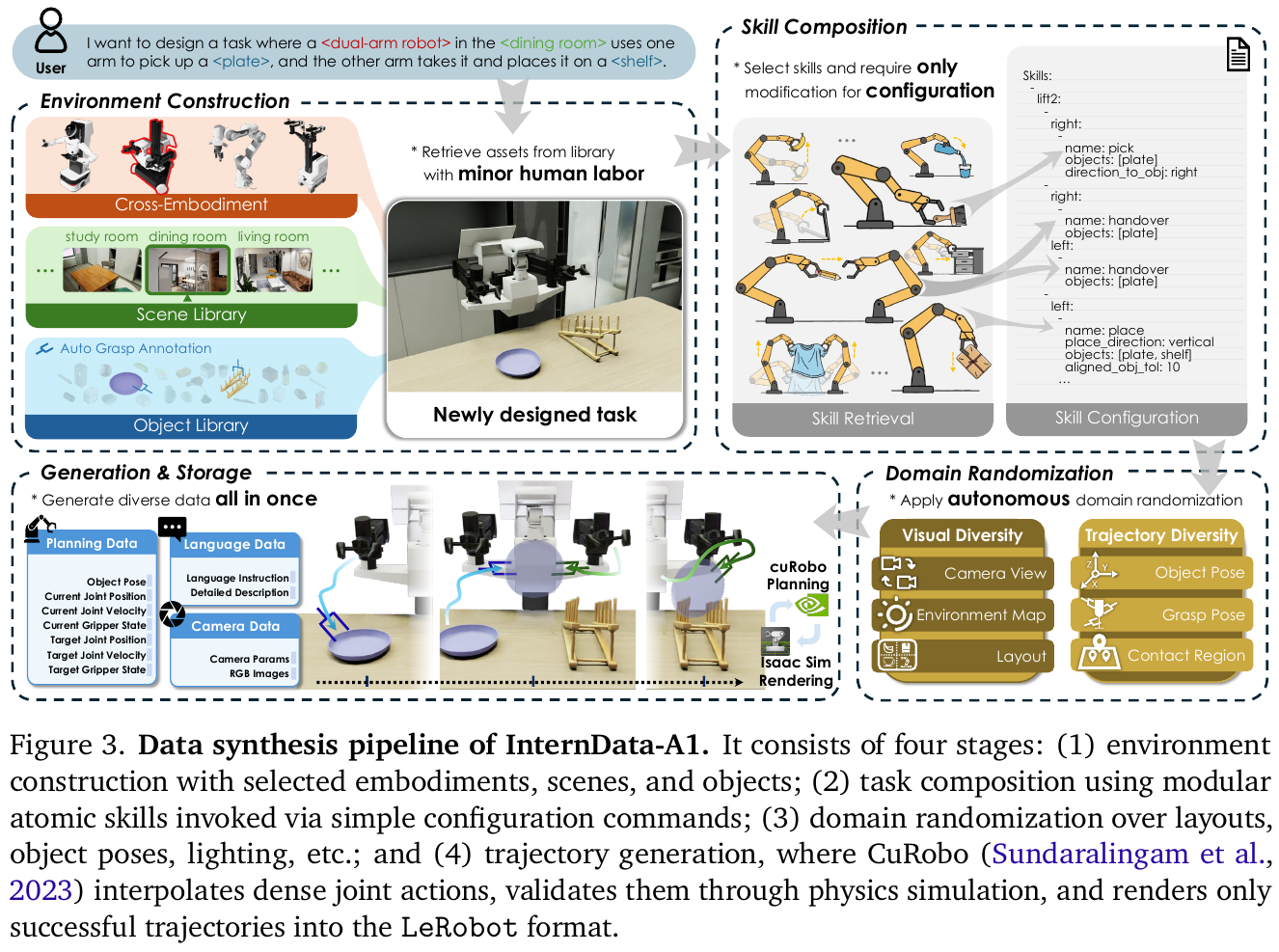

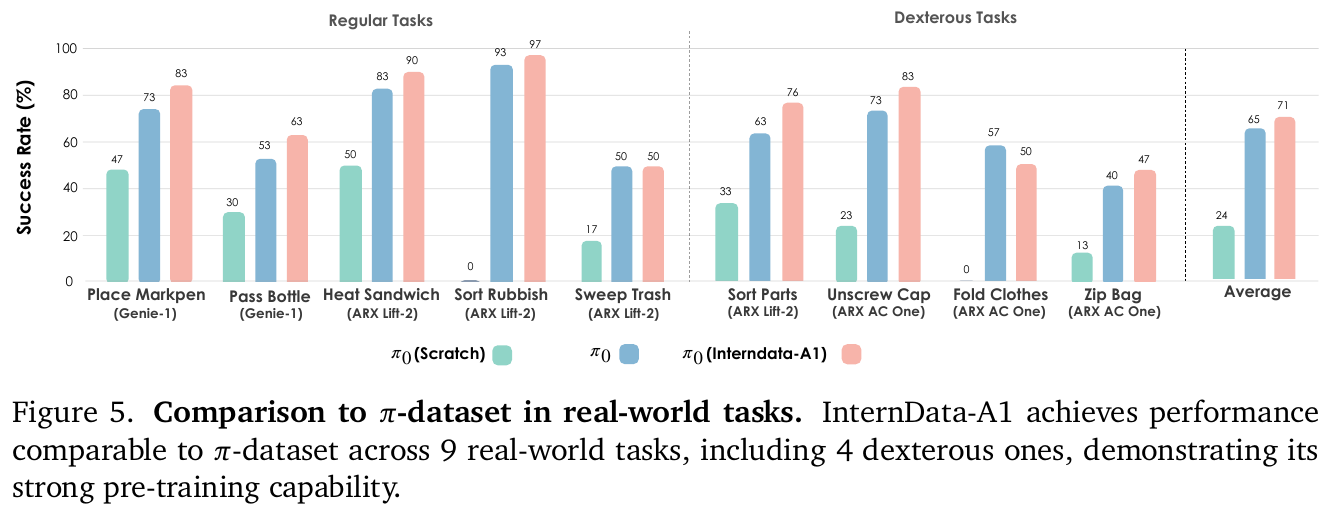

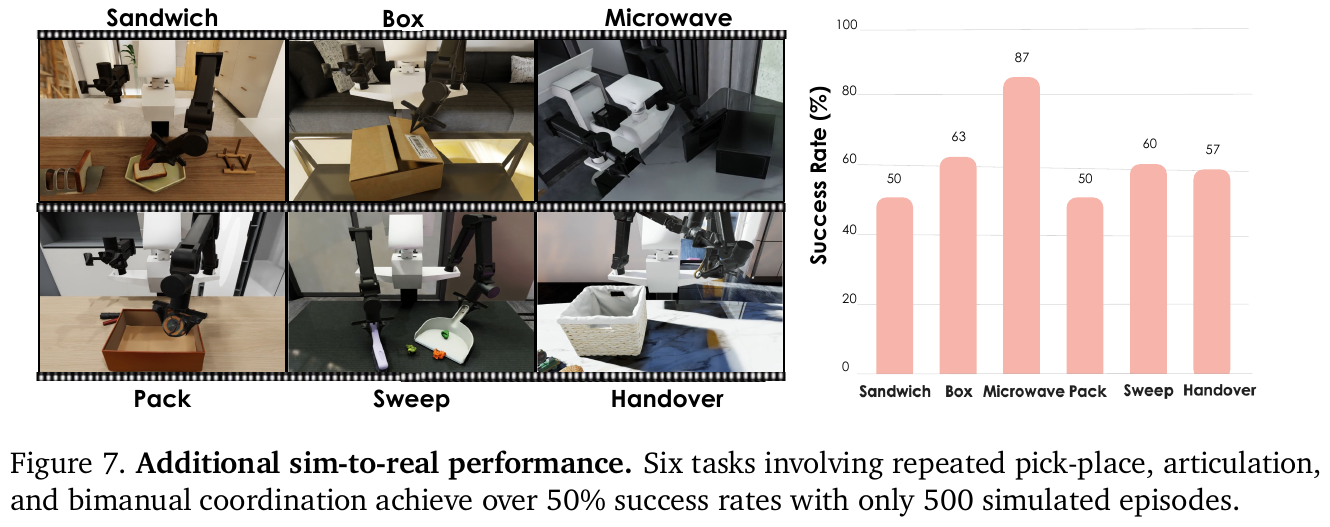

D1["多源整合<br/>OXE / RLDS 格式"] --> D2["跨具身统一<br/>970k 轨迹 / 22 种机器人"] --> D3["合成数据<br/>InternData-A1 / 630k 轨迹"]

end

subgraph BenchTrack ["评测轨道"]

B1["仿真基准<br/>LIBERO / CALVIN"] --> B2["跨场景泛化<br/>SimplerEnv / RoboCasa"] --> B3["开放世界评测<br/>VLABench / 真实机器人"]

end

D3 -.->|"Sim-to-Real"| B3

style DataTrack fill:#fff3e0,stroke:#e65100

style BenchTrack fill:#f3e5f5,stroke:#6a1b9a

5.1 多源异构数据整合

问题描述:有效整合来自不同机器人平台、不同任务、不同采集方式的数据。数据是VLA的基石,但异构性是最大挑战。

三大层面:

(1)表示层统一对齐

- 离散动作表示:

- LAPA, Moto, UniVLA:统一的动作token化方案

- 跨平台的动作空间标准化

- 共享语义空间:

- RDT-1B:扩散Transformer学习跨机器人表示

- AgiBot World:大规模统一语义空间

- Scaling Cross-Embodied Learning:形态无关表示

- 多模态对齐:

- RT-1, GR-2:视觉-动作对齐

- ViSA-Flow:视觉-空间-动作三元对齐

- Humanoid-VLA:全身控制的多模态对齐

(2)数据层增强与优化

- 生成增强:

- CACTI:扩散修补生成多样场景

- GenAug:文本到图像合成

- ROSIE:VLM知识蒸馏

- Residual RL Data Generation:通过残差RL生成数据

- 混合优化:

- Re-Mix:自适应采样权重平衡异构数据源

(3)标准化与基准构建

- 统一采集协议:

- RH20T:严格时间对齐的多模态数据(视觉+触觉+音频)

- BridgeData V2:标准化的桌面操作数据

- 模拟标准化环境:

- RoboCasa:家庭环境仿真基准

- CoVLA:跨机器人仿真平台

- 人类中心多视角:

- Ego4D:3700小时第一人称视频

- EPIC-KITCHENS:厨房活动数据集

- Ego-Exo4D:同步的自我-外部视角

- 跨域标准化:

- Open X-Embodiment:60+数据集,970k轨迹,22种机器人

- RoboMM:多模态跨机器人数据

关键技术:

- 统一数据格式:设计通用的数据表示标准

- 大规模数据聚合:整合海量机器人轨迹

- 数据质量控制:筛选和清洗低质量数据

代表性工作:

- Open X-Embodiment:最大规模的跨机器人数据集

- WALL-OSS:聚合超过10000小时的自收集机器人轨迹

- RH20T:高质量多模态时间对齐数据

- RDT-1B:billion规模的扩散Transformer,统一表示

5.2 评测基准与标准化指标

问题描述:建立公平、全面、标准化的VLA评测体系。缺乏统一评测标准导致模型难以比较。

三大方向:

(1)全面性与标准化

- 统一评测框架:

- Benchmarking VLAs:统一输入/输出接口、标准化指标、多机器人支持

- 消除实现细节差异,公平比较

- 多维度评分:

- EUQ (Evaluating Uncertainty and Quality):人类评估的多维评分

- 超越简单成功率,评估执行质量

- 基础设施:

- ManiSkill3:GPU并行,支持大规模评测

- robosuite:模块化仿真框架

(2)任务广度与深度扩展

- 长视距序列:

- CALVIN:连续多任务执行,评估长期规划

- 5个连续任务成功率作为核心指标

- 终身学习:

- LIBERO:130个任务,4个套件(Spatial, Object, Goal, Long)

- 评估技能保留和前向/后向迁移

- 多视角同步:

- Ego-Exo4D:自我+外部视角,评估多视角理解

- 多维对象/语言复杂度:

- From Intention to Execution (VLABench):分离意图理解和执行能力

- Intention Score + Progress Score双指标

- 零样本多语言:

- SimplerEnv-Instruct:80个零样本任务,多语言指令

(3)真实场景转仿真

- 神经重建:

- PolaRiS:将真实视频转化为交互式仿真环境

- 提供可控的评测环境

关键技术:

- 终身学习基准:LIBERO的4个难度递增套件

- 真实场景转仿真:通过神经重建将真实视频转化为交互仿真环境

- 多维度评估:成功率、泛化能力、鲁棒性、效率、意图理解

代表性工作:

- LIBERO:首个终身机器人学习基准,130个任务

- CALVIN:长时序多任务基准

- VLABench (Intention to Execution):分离意图和执行的评测

- SimplerEnv:标准化VLA评测平台,80个零样本任务

- PolaRiS:真实场景神经重建

- ManiSkill3:GPU并行高效评测

未来方向:

- Simulation-First, Failure-Centric Paradigm:以失败为核心的评测

- Turn Failure into Signal:将失败轨迹用于对比学习

- Comprehensive Diagnostic Stress Testing:超越二元成功率的细粒度诊断

5.3 数据高效学习

问题描述:在有限数据下实现高性能,降低数据收集成本。真实机器人数据获取昂贵且耗时。

三大策略:

(1)数据增强

- 视觉增强:

- CACTI:扩散修补生成多样化背景

- GenAug:文本到图像生成

- 颜色、光照、遮挡变化

- 轨迹增强:

- 时间插值、噪声注入

- 反向轨迹生成

(2)主动学习

- 选择最有价值的数据:

- 不确定性采样

- 多样性采样

- 优先标注难例

(3)迁移学习

- 预训练知识利用:

- VLM预训练(CLIP, SigLIP)

- 人类视频预训练(Ego4D, GR-2)

- 跨机器人迁移(Octo, RoboCat)

- 少样本微调:

- 适配器方法:轻量化微调

- LoRA, AdaLoRA等参数高效微调

代表性工作:

- CACTI:扩散增强数据生成

- Octo:10次演示实现新任务适应

- ROSIE:VLM知识蒸馏减少数据需求

未来方向:

- 自监督预训练:利用大规模无标注视频

- 主动数据收集:机器人自主选择探索策略

- 合成到真实:完全在合成数据上训练,零样本迁移到真实

2.6 VLA开源生态:组合拳力量

开源 VLA 的崛起并非单一模型的功劳,而是 模型 + 数据 + 工具 + 硬件 三层生态形成的“组合拳”效应,使其能够与谷歌、特斯拉等闭源巨头抗衡。

graph TD

Data[OXE 数据集: 跨具身/多场景数据] --> Software[LeRobot: 标准化训练/部署工具]

Sim[Genesis: 极速物理仿真/合成数据] --> Software

Software --> Hardware[SO-100/Reachy Mini: $100-$250 低成本硬件]

Hardware --> Data

subgraph "开源生态闭环"

Data

Software

Sim

Hardware

end

subgraph "模型层"

OpenVLA[OpenVLA: 最强开源标杆]

Pi0[π₀: 高频精细控制]

XVLA[X-VLA: 跨具身软提示]

end

Software -.-> OpenVLA

Software -.-> Pi0

Software -.-> XVLA

1. 数据层:Open X-Embodiment (OXE)

OXE 是开源阵营最宝贵的资源,它打破了实验室之间的数据孤岛:

- 跨平台多样性:整合 22 种机器人形态,涵盖厨房、实验室、办公室等数百种场景。

- 涌现能力:实验证明,即使模型规模不是最大,只要数据够多样(如引入 OXE),模型也能涌现出原有的空间推理能力(如理解 “on” 和 “near” 的空间语义差异)。

- 标准化贡献:定义了统一的 RLDS 数据格式,解决了不同实验室数据格式不一的痛点。

2. 工具层:LeRobot 与 Genesis

- LeRobot (Hugging Face):由前特斯拉工程师 Remi Cadene 打造,统一了数据格式并一键集成多种策略模型,打通了从采集、训练到部署的全流程。

- Genesis (CMU):极速仿真工具,在一张 RTX 4090 上可实现每秒 4300 万帧的模拟速度(实时速度的 43 万倍),将“百万美元级别”的训练门槛降至数百美元。

3. 硬件层:低成本与标准化

- Hugging Face 生态:推出了 $100 的 SO-100 机械臂和 $250 的 Reachy Mini,极大降低了具身智能研究的门槛。

- 通用软件层:如 OpenMind 平台,致力于构建跨厂商兼容的软件层,打破机器人系统的封闭性。

2.7 主流VLA模型横向对比汇总

为了直观展示各阶段代表性 VLA 模型的差异,下表汇总了其核心架构与技术指标:

| 模型 | 发布时间 | 参数规模 | 核心架构/特点 | 开源状态 | 备注 |

|---|---|---|---|---|---|

| RT-1 | 2022.12 | 130M | Transformer + 离散 Token | ✅ 数据+代码 | 奠基之作 |

| RT-2 | 2023.07 | 5B/55B | VLM 直接微调 | ❌ 闭源 | 首次验证 VLM 知识迁移 |

| OpenVLA | 2024.06 | 7B | 双编码器 (DINOv2+SigLIP) | ✅ 权重+代码 | 目前最强开源 VLA 标杆 |

| π₀ | 2024.10 | 3.8B | Flow Matching (50Hz) | ✅ 权重+代码 | 擅长折纸等精细操作 |

| GR00T N1.6 | 2026.01 | 2.2B | 双系统 (System 1+2) | ✅ 权重+代码 | 英伟达全栈生态绑定 |

| Xiaomi-R0 | 2025.02 | 4.7B | MoT 架构(分离脑/小脑) | ✅ 权重+代码 | 中国力量,低延迟优化 |

| LingBot-VLA | 2025.02 | - | 跨形态泛化 (9种机器人) | ✅ 权重+代码 | 蚂蚁集团真机预训练 |

| π₀.5 | 2025.04 | - | 异构任务协同训练 | ❌ 闭源 | 开放世界家庭长时程任务 |

| ACoT-VLA | 2026.01 | - | 动作空间推理 | 📄 仅论文 | 显著减少长时域误差累积 |

2.8 VLA架构分类:End-to-End vs Hierarchical

VLA模型可以从架构层面分为两大类:端到端统一模型和层级架构模型。这种分类反映了不同的设计哲学和应用场景。

End-to-End架构 vs Hierarchical架构对比:

flowchart LR

%% 端到端路径

subgraph E2E ["端到端范式"]

In1["视觉+文本"] --> Model1["单一VLA模型"] --> Act1["底层控制动作"]

end

%% 层级路径

subgraph Hier ["层级范式"]

In2["复杂指令"] --> VLM["高层规划器/VLM"]

VLM -- "语言子任务" --> VLA["低层执行器/VLA"]

Obs["视觉观察"] --> VLM

Obs --> VLA

VLA --> Act2["高频动作流"]

end

style E2E fill:#fff4dd,stroke:#d4a017

style Hier fill:#e1f5fe,stroke:#01579b

| 维度 | End-to-End | Hierarchical |

|---|---|---|

| 设计理念 | 单一统一网络 | 分离规划与执行 |

| 推理方式 | 隐式端到端 | 显式分层推理 |

| 可解释性 | 低 | 高 |

| 适用场景 | 短时域任务 | 长时程复杂任务 |

End-to-End Architecture(端到端架构)

核心思想:直接从视觉+语言输入映射到动作输出,单一神经网络统一学习感知-决策-控制。

主要特点:

- 简洁统一:单一损失函数,联合优化所有组件

- 隐式推理:推理过程隐藏在神经网络内部

- 高度集成:无需显式的中间表示

代表模型:

| 模型 | 动作解码器 | 参数规模 | 特点 |

|---|---|---|---|

| OpenVLA | 离散token化 | 7B | 首个开源大规模VLA(详见第5节) |

| π₀ | Flow Matching | 3B (VLM) + 860M (Action) | 50Hz实时控制(详见第6节) |

| Diffusion Policy | DDPM | - | 多模态动作分布(详见第4节) |

| RDT-1B | Diffusion Transformer | 1B | 大规模扩散VLA |

| SPECI | 离散化 | - | 专门优化的编码 |

| VIMA | 自回归 | - | 多模态prompt |

优势:

- 更简洁的学习目标

- 更好的感知-控制对齐

- 适合短时域任务

劣势:

- 长视距任务推理能力有限

- 缺乏可解释性

- 难以处理复杂任务分解

Hierarchical Architecture(层级架构)

核心思想:分离高层规划和低层执行,VLM负责推理和任务分解,小型控制器负责具体动作生成。

主要特点:

- 显式推理:语言作为高层规划的中间表示

- 模块化设计:规划器和执行器独立训练和优化

- 可解释性强:推理步骤可追溯

代表模型:

| 模型 | 高层规划 | 低层执行 | 特点 |

|---|---|---|---|

| π₀.5 | 增强推理VLM | Flow Matching | 多步骤推理链(详见第7节) |

| RT-H | VLM子任务分解 | RT-1 | 层级任务执行(RT-1详见第1节) |

| Hi Robot | VLM规划器 | VLA执行器 | 两层显式分离 |

| HiRT | 高层策略 | RT-based低层 | 时间抽象 |

| HAMSTER | 语言规划 | 视觉-运动控制 | 混合架构 |

| LoHoVLA | 端到端学习的层级 | - | 隐式层级结构 |

优势:

- 更好的长视距推理能力

- 可解释的决策过程

- 灵活的任务分解

劣势:

- 训练复杂度更高

- 可能存在规划-执行不一致

- 依赖高质量的子任务标注

混合趋势

最新研究表明,纯端到端和纯层级架构各有优劣,混合方法成为新趋势:

(1)端到端学习的层级表示:

- LoHoVLA:通过辅助损失学习隐式层级结构

- 保持端到端训练的简洁性,获得层级推理能力

(2)可切换架构:

- 简单任务:端到端快速执行

- 复杂任务:激活层级推理模块

(3)注意力引导的隐式层级:

- ACoT-VLA:动作空间的推理链(详见经典论文章节)

- 在动作层面进行显式推理,保持统一架构

2.9 VLA研究发展趋势

VLA架构演进时间线(2022-2026):

- 模块化阶段(2022):RT-1独立模块设计

- 端到端阶段(2023-2024):RT-2、OpenVLA、π₀统一框架

- 混合架构阶段(2025-2026):π₀.5、ACoT-VLA结合端到端与层级优势

flowchart TD

M["模块化架构"] --> E["端到端架构"]

E --> H["混合/分层架构"]

subgraph Phase1 ["2022"]

M

end

subgraph Phase2 ["2023-2024"]

E

end

subgraph Phase3 ["2025-2026"]

H

end

从整体发展脉络来看,VLA研究经历了从模块化系统到端到端模型,再到端到端与层级混合的重要转变。

1. 早期阶段:基于VLM的机器人控制探索(2022-2023初)

该阶段的研究主要探索如何将预训练的视觉-语言模型应用于机器人任务,通常采用VLM作为高层规划器,结合传统控制器执行动作。

代表工作:

- PaLM-E、SayCan等工作探索语言模型在机器人规划中的作用

- 主要采用模块化架构,VLM用于语义理解和任务分解

2. 突破阶段:端到端VLA模型的诞生(2023中-2024)

2023年Google DeepMind推出RT-2,标志着VLA作为独立研究方向的确立。RT-2证明了VLM可以通过微调直接输出机器人动作,实现端到端的感知-控制。

关键里程碑:

- RT-2(2023.7):首个将VLM转化为VLA的工作

- RT-X(2023.10):跨机器人数据集和模型

- OpenVLA(2024.6):首个开源大规模VLA模型

3. 快速发展阶段:架构创新与性能优化(2024-2025)

这一阶段出现了大量VLA架构和训练方法的创新,研究重点从证明可行性转向提升性能和效率。

主要进展:

- 扩散模型作为动作解码器成为主流

- 分层VLA架构(高层语言规划 + 低层视觉控制)

- 模型压缩和加速(SmolVLA、OFT等)

- 多机器人数据集和基准测试

4. 创业公司与中国力量

中国在具身智能领域的参与正在从“跟跑”转向“参与定义规则”。

mindmap

root((中国具身智能生态))

巨头派

小米: Xiaomi-Robotics-0 / MoT架构

蚂蚁集团: LingBot-VLA / 跨形态泛化

阿里巴巴: 达摩院 VLA 预训练

创业精英派

智元机器人: Agibot GO-1 / 真机部署

自变量机器人: 空间推理 / 灵巧操作

星海图: G0 Plus / 真实数据集开源

星动纪元: ERA-42 / 人形机器人控制

学术开源派

清华 AIR: X-VLA / 软提示技术

上海 AI Lab: 联合推出 X-VLA / 标准化评测

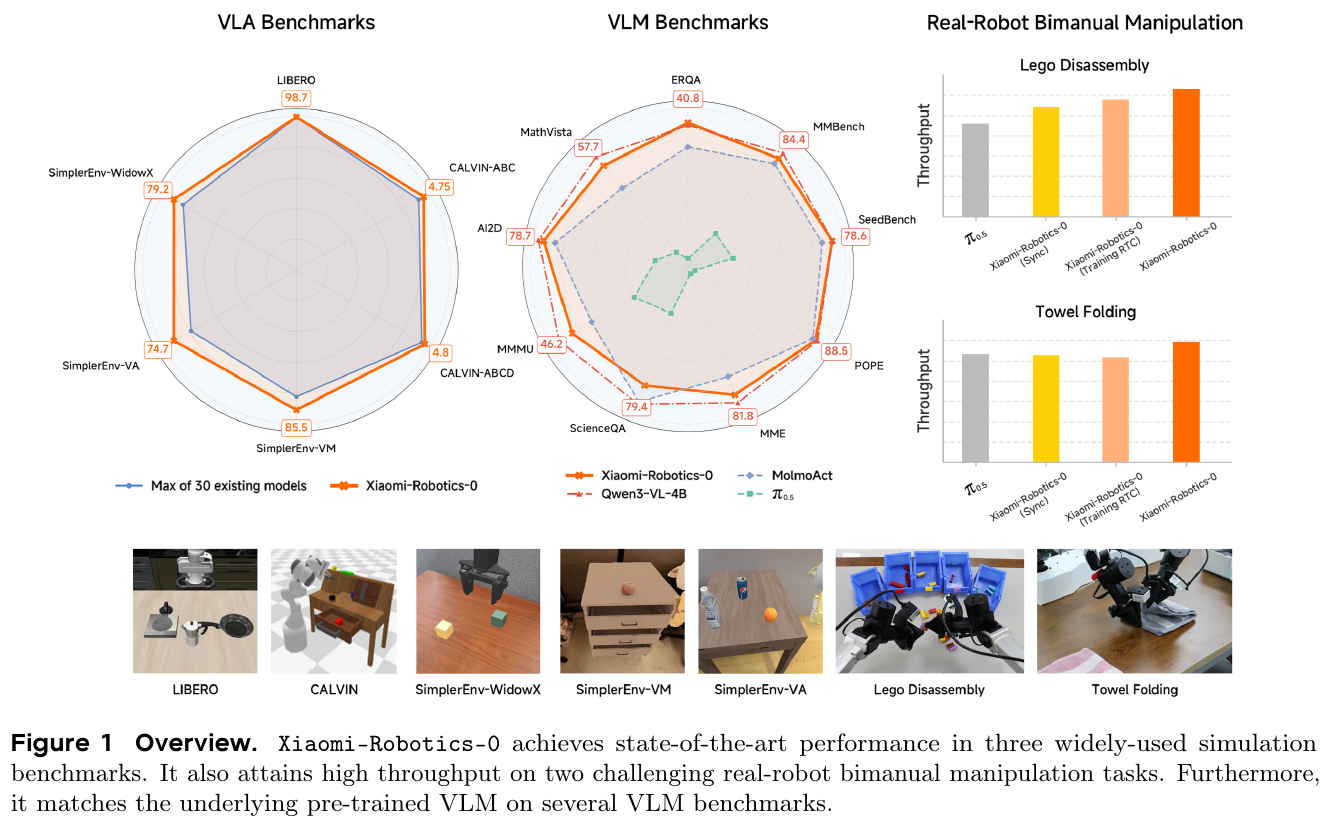

- 小米 (Xiaomi):发布 Xiaomi-Robotics-0,采用 MoT 混合架构将“大脑(推理)”与“小脑(控制)”分离,显著改善了 VLA 模型普遍存在的推理延迟问题,支持在消费级 GPU 上实时运行。

- 蚂蚁集团 (Ant Group):LingBot-VLA 强调跨形态泛化,在 9 种不同双臂机器人上预训练超过 2 万小时真机数据,目标是实现“一个大脑控制所有类型的机器人”。

- 智元机器人 (Agibot):其 GO-1 模型已部署到真机执行任务,展示了极高的工程落地效率。

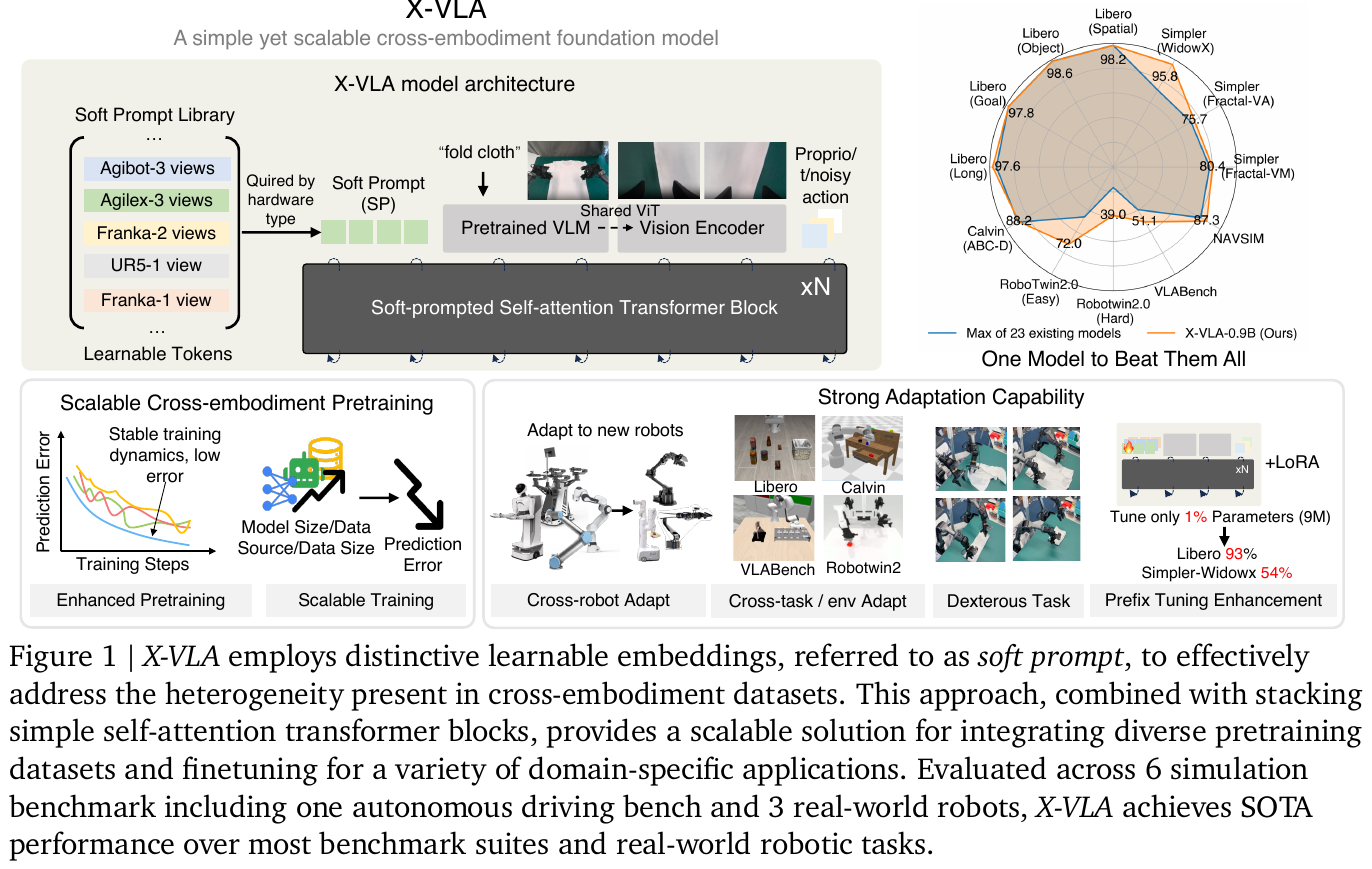

- 学术界标杆:清华 AIR 与上海 AI 实验室联合推出的 X-VLA,刷新了五大仿真基准,且代码、数据、权重全部公开,是学术界彻底开源的范本。

- 垂直领域专家:如星海图 (G0 Plus)、星动纪元 (ERA-42) 以及自变量机器人,均基于数万小时真实世界数据构建了具备强空间推理和高动作精度的 VLA 模型。

2.10 当前阶段:走向通用具身智能(2025-2026)

最新研究趋势表明,VLA正从单一操作任务向通用具身智能体演进,研究重点包括推理能力、全身协调、人机协作等。

前沿方向:

- 基于推理的VLA(Reasoning VLA)

- 多任务、多机器人的统一VLA

- VLA与世界模型的结合

- 从模仿学习到强化学习的转变

2.11 关键技术方向

1. 统一的视觉-语言-动作架构

VLA模型的核心是将视觉编码器、语言模型和动作解码器统一在单一架构中,实现端到端的多模态学习。

主流架构模式:

- VLM + Action Head:在预训练VLM基础上添加动作解码头(如RT-2)

- Modular Fusion:独立训练视觉和语言编码器,通过交叉注意力融合(如OpenVLA)

- Diffusion-based VLA:使用扩散模型作为动作解码器,建模连续动作分布

架构优化:

- 多视角视觉输入的融合

- 时序信息的编码(视频而非单帧)

- 分层表示学习(高层语义 + 低层几何)

2. 大规模数据与预训练

VLA模型的性能高度依赖于大规模、高质量的训练数据。当前研究重点在于如何有效利用多源异构数据。

数据来源:

- 互联网视觉-语言数据:用于预训练视觉和语言编码器

- 机器人演示数据:真实机器人遥操作轨迹(如Open X-Embodiment包含970k轨迹)

- 模拟器数据:在仿真环境中生成大规模数据

- 合成数据:利用生成模型创建训练数据

预训练策略:

- 两阶段预训练:先在VLM任务上预训练,再在机器人数据上微调

- 多任务联合训练:同时学习多个机器人任务

- 跨机器人预训练:在多种机器人平台上训练通用模型

3. 基于扩散模型的动作生成

扩散模型在VLA的动作解码中展现出优越性,能够建模复杂的多模态动作分布。

优势:

- 捕获动作的多模态性(同一状态可能有多种合理动作)

- 生成平滑、连续的动作轨迹

- 优于自回归模型的跨域迁移能力

实现方式:

- DDPM:去噪扩散概率模型

- Discrete Diffusion:离散动作空间的扩散建模

- 条件扩散:以视觉和语言为条件生成动作

4. 分层控制与任务分解

分层架构将VLA系统分为高层规划和低层控制,提升了长时序任务的执行能力。

分层方式:

- 语言分解:使用LLM将复杂指令分解为子任务序列

- 时间抽象:在不同时间尺度上进行规划和控制

- 技能组合:学习可复用的基本技能,通过组合完成复杂任务

实现架构:

- 高层:语言模型进行任务规划和子目标生成

- 低层:VLA模型执行具体的操作技能

- 中间层:目标条件化策略或选项框架

5. 跨机器人泛化

训练能够在不同机器人平台上部署的通用VLA模型是当前的重要研究方向。

关键技术:

- 统一动作表示:设计平台无关的动作空间(如末端执行器速度)

- 迁移学习:从一个机器人迁移到另一个机器人

- 元学习:学习快速适应新机器人的能力

代表工作:

- RT-X:在22个不同机器人上训练统一模型

- Cross-Embodiment Transfer:跨具身形态的策略迁移

6. 推理增强的VLA

将显式推理能力集成到VLA模型中,使其能够进行链式思考和因果推理。

方法:

- 思维链(CoT):生成中间推理步骤

- 世界模型:预测动作的长期后果

- 反事实推理:评估不同动作的可能结果

应用:

- 复杂任务的分解

- 失败检测和恢复

- 零样本任务泛化

7. 高效VLA与模型压缩

为了在实际机器人上实时运行,需要设计轻量化的VLA模型。

优化方向:

- 模型量化:降低参数精度

- 知识蒸馏:将大模型的知识迁移到小模型

- 架构搜索:自动设计高效的网络结构

代表工作:

- SmolVLA:450M参数的轻量化模型

- OFT:优化微调方法,实现25-50倍加速

- FAST tokenizer:动作压缩,实现15倍推理加速

2.12 未来研究方向

1. 通用具身基础模型

未来的VLA模型将不局限于机械臂操作,而是支持全身协调、移动操作、人形机器人等多种具身形态。Google DeepMind CEO Demis Hassabis 曾表示,其终极目标是打造“机器人界的安卓”——一个通用的机器人操作系统,让 Gemini 成为所有机器人的通用“大脑”。为此,Google 甚至从波士顿动力挖角了前首席技术官 Aaron Saunders 担任硬件工程副总裁,并与波士顿动力展开深度合作,将 Gemini 模型整合到 Atlas 人形机器人中。

研究问题:

- 如何设计统一的观察和动作空间

- 如何处理不同形态的运动学和动力学

- 如何实现跨任务、跨场景的泛化

2. 基于世界模型的VLA

结合世界模型使VLA能够进行想象推理和长期规划。

研究方向:

- 学习物理世界的因果模型

- 基于模型的强化学习

- 利用想象轨迹进行规划

3. 人机协作与交互学习

VLA系统需要与人类自然协作,并从人类反馈中持续学习。

关键技术:

- 意图理解和协作规划

- 从人类反馈中学习(RLHF)

- 主动学习和查询策略

4. 安全性与可解释性

提升VLA系统的安全性和决策透明度对于实际部署至关重要。

研究问题:

- 形式化验证VLA的安全性

- 可解释的决策过程

- 失效检测和安全恢复机制

5. 开放世界中的持续学习

VLA系统需要在开放世界中不断遇到新对象、新任务,并持续学习新技能。

研究方向:

- 在线学习和模型更新

- 灾难性遗忘的避免

- 主动探索和自主数据收集

6. 多模态感知整合

除了视觉和语言,整合触觉、听觉、力/扭矩传感等多种模态。

技术挑战:

- 异构模态的融合

- 触觉-视觉对齐

- 多模态预训练

挑战5:数据构建与基准测试标准

… (此处略去已有的挑战5内容) …

2.13 具身智能开源革命的启示

根据 2025-2026 年机器人行业的开源博弈,我们总结出以下三条核心技术与商业启示:

1. 数据多样性重于单一规模

实验(如 RT-2-X)证明,轨迹的多样性(Diversity)比纯粹的数据量更关键。引入 OXE 这种跨平台、跨场景的多样化数据,能让模型涌现出理解“空间语义(如 on vs near)”的能力,而单一机器人的海量重复数据则难以实现这种跨越。

2. 模型、数据、工具的“生态联动”

开源阵营之所以能挑战谷歌、特斯拉,靠的是 OXE (数据) + LeRobot (工具链) + Genesis (极速仿真) + $100 硬件 (SO-100) 形成的闭环。这种“组合拳”将具身智能的研究门槛从百万美元降低到了数百美元,让全球研究者能共同参与测试与改进。

3. 开源与闭源的模糊边界

RT-2-X 虽然是谷歌的闭源模型,但其训练依赖了 OXE 开源数据集;英伟达的 GR00T 介于开源与闭源之间(代码开放但深度绑定芯片生态)。这说明未来的博弈不在于单纯的代码是否公开,而在于谁能定义机器人行业的基础设施标准。

3. VLA任务类型

VLA模型可以应用于多种类型的机器人任务,根据任务特性和复杂度可以划分为以下类别:

3.1 按任务复杂度划分

1. 单步操作任务(Single-Step Manipulation)

任务特征:

- 单一动作即可完成目标

- 不需要长期规划

- 主要考察感知和控制精度

典型任务:

- 抓取指定物体

- 按下按钮

- 打开抽屉

代表数据集:

- RLBench中的简单任务

- 物体抓取基准测试

2. 多步骤操作任务(Multi-Step Manipulation)

任务特征:

- 需要执行一系列有序动作

- 涉及子目标分解

- 需要维护任务进度状态

典型任务:

- 物体重排列

- 多物体组装

- 厨房任务(如准备食物)

代表数据集:

- CALVIN

- LIBERO

- RLBench长时序任务

3. 长时程任务(Long-Horizon Tasks)

任务特征:

- 包含数十到上百个动作步骤

- 需要分层规划能力

- 需要错误检测和恢复机制

典型任务:

- 完整的烹饪流程

- 家具组装

- 房间整理

代表数据集:

- ALFRED

- TEACh

- Habitat 2.0

3.2 按交互对象划分

1. 刚体操作(Rigid Object Manipulation)

专注于操作刚性物体,如抓取、放置、推拉等基本操作。

代表工作:

- RT-2在刚体操作上的应用

- OpenVLA的基础操作任务

2. 可变形物体操作(Deformable Object Manipulation)

涉及衣物折叠、绳索整理等可变形物体的操作。

挑战:

- 物体状态的高维表示

- 复杂的物理交互建模

- 难以在模拟器中准确建模

3. 流体操作(Liquid Manipulation)

包括倒水、搅拌等涉及流体的操作任务。

挑战:

- 流体动力学的建模

- 状态估计的不确定性

- 传感器的限制

4. 工具使用(Tool Use)

要求机器人使用工具完成任务,如使用勺子、刀具等。

关键能力:

- 工具的功能理解

- 工具-物体交互建模

- 灵巧的操作技能

3.3 按控制模式划分

1. 位置控制(Position Control)

特点:

- 直接输出末端执行器的目标位置

- 适用于精确定位任务

- 常用于刚体操作

动作空间:

- 7自由度机械臂位置(xyz + 四元数)

- 夹爪开合状态

2. 速度控制(Velocity Control)

特点:

- 输出末端执行器的移动速度

- 适用于连续跟踪任务

- 更平滑的运动轨迹

动作空间:

- 笛卡尔空间速度(dx, dy, dz, droll, dpitch, dyaw)

- 夹爪速度

3. 力/阻抗控制(Force/Impedance Control)

特点:

- 控制接触力而非位置

- 适用于接触丰富的任务

- 需要力/扭矩传感器

应用场景:

- 组装任务

- 人机协作

- 精细操作

3.4 按环境类型划分

1. 桌面操作(Tabletop Manipulation)

环境特征:

- 相对简单的场景

- 固定的工作台

- 有限的物体种类

应用:

- 工业分拣

- 实验室自动化

- 教学演示

2. 厨房环境(Kitchen Tasks)

环境特征:

- 结构化但复杂的场景

- 多样的物体和工具

- 涉及多种交互类型

应用:

- 服务机器人

- 家庭辅助

- 食品制备

3. 移动操作(Mobile Manipulation)

环境特征:

- 结合移动和操作

- 大范围的工作空间

- 需要导航和操作的协同

应用:

- 仓库物流

- 家庭服务

- 建筑工地

4. VLA的应用场景

4.1 工业制造

VLA模型在工业自动化中展现出巨大潜力,能够处理多样化的生产任务。

工业场景中的VLA应用:

| 应用场景 | VLA能力需求 | 典型任务 |

|---|---|---|

| 质量检测 | 视觉缺陷识别 + 自然语言标准理解 | “检查零件表面是否有划痕” |

| 柔性装配 | 视觉定位 + 精细操作 | “将A部件插入B部件的孔中” |

| 智能分拣 | 多物体识别 + 动态规划 | “将红色零件放入左侧托盘” |

应用示例:

- 智能装配线:基于语言指令调整装配流程

- 质量检测:结合视觉检测和操作反馈

- 柔性制造:快速适应产品变化

优势:

- 减少编程和调试时间

- 提高生产线灵活性

- 降低对专业技术人员的依赖

4.2 服务机器人

在家庭和商业服务场景中,VLA使机器人能够理解和执行多样化的用户指令。

服务机器人应用场景:

典型应用领域:

- 家庭服务:理解”帮我整理客厅”等开放式指令,执行物体重排列、清洁等复合任务(如π₀.5在新家庭环境中的10-15分钟长时程任务)

- 餐饮服务:识别菜品 + 理解点餐指令 → 配送和上菜动作

- 医疗辅助:理解医护人员指令 + 精确操作 → 递送医疗器械、协助护理

关键技术:开放世界泛化、人机交互、安全性保证

应用示例:

- 家庭助理:帮助整理物品、准备食物

- 酒店服务:客房清理、物品配送

- 医疗辅助:协助护理、物品递送

优势:

- 自然的人机交互

- 适应个性化需求

- 持续学习用户偏好

4.3 仓储物流

VLA模型使仓储机器人能够处理更复杂、更灵活的物流任务。

仓储物流中的VLA应用:

| 环节 | VLA优势 | 传统方案痛点 |

|---|---|---|

| 智能拣选 | 自然语言订单理解 + 视觉识别 | 需要预定义所有SKU位置 |

| 动态码垛 | 理解”易碎品放上层”等约束 | 固定码垛模式,缺乏灵活性 |

| 异常处理 | 识别损坏物品并自主决策 | 需要人工介入 |

商业价值:减少人工标注成本,适应SKU快速变化,提升仓储自动化柔性

应用示例:

- 智能分拣:理解包裹描述进行分类

- 货架整理:根据指令调整货物摆放

- 订单拣选:执行复杂的拣选指令

优势:

- 提高操作效率

- 减少人工依赖

- 适应多样化的SKU

4.4 农业自动化

在农业领域,VLA模型使机器人能够进行精准的农业操作。

应用示例:

- 精准采摘:识别成熟果实并采摘

- 植物护理:根据植物状态进行修剪、施肥

- 自动化收获:执行复杂的收获流程

优势:

- 减少劳动力需求

- 提高作业精度

- 降低农产品损伤

4.5 建筑施工

VLA模型在建筑机器人中的应用正在兴起。

应用示例:

- 自动化砌砖

- 焊接作业

- 建筑材料搬运

优势:

- 提高施工效率

- 改善工作安全性

- 标准化施工质量

5. VLA主流数据集

VLA模型的性能高度依赖于高质量的训练数据。以下是VLA领域最具影响力的数据集:

5.1 大规模跨机器人数据集

Open X-Embodiment Dataset

基本信息:

- 发布时间:2023年10月

- 数据规模:970k条真实机器人轨迹,60+个数据集

- 机器人平台:22种不同的机器人(单臂、双臂、移动操作、人形等)

- 任务类型:多样化的操作任务(抓取、放置、组装、厨房任务等)

数据特点:

- 跨机器人统一格式:RLDS (Reinforcement Learning Datasets)标准

- 多模态观察:RGB图像、深度图、本体感觉

- 语言标注:自然语言任务描述

- 动作表示:统一的动作空间定义

- 支持跨具身形态泛化研究

核心贡献:

- 首个大规模跨机器人数据集

- 定义了机器人数据集的事实标准

- 催生了RT-X、OpenVLA等一系列跨机器人模型

应用模型:

- RT-X:在OXE上训练的跨机器人策略

- OpenVLA:7B参数开源VLA模型

- Octo:通用机器人策略

- DexVLA、RDT-1B等最新VLA模型

获取方式:https://robotics-transformer-x.github.io/

EO-1 Dataset

基本信息:

- 数据规模:1.5M轨迹(EO-Data)

- 特点:超大规模预训练数据集

- 应用:EO-1模型的预训练

WALL-OSS Dataset

基本信息:

- 数据规模:超过10,000小时自收集机器人轨迹

- 特点:自主收集的大规模数据

- 应用:大规模分层规划系统

RT-1 Dataset

基本信息:

- 发布时间:2022年12月

- 数据规模:130k条真实机器人轨迹

- 机器人平台:定制的移动操作机器人

- 任务类型:700+种日常操作任务

数据特点:

- 高质量的专家演示

- 真实办公环境数据

- 丰富的语言指令多样性

应用模型:

- RT-1

- RT-2

5.2 模拟器数据集

CALVIN (Composing Actions from Language and Vision)

基本信息:

- 发布时间:2021年

- 环境:PyBullet仿真器

- 任务类型:长时序组合任务

数据特点:

- 多步骤任务链

- 语言条件的任务执行

- 评估长期规划能力

评测指标:

- 连续成功任务数

- 零样本泛化能力

官网:http://calvin.cs.uni-freiburg.de/

LIBERO (Lifelong Benchmark for Robot Manipulation)

基本信息:

- 发布时间:2023年

- 环境:MuJoCo仿真器

- 任务数量:130个多样化任务

数据特点:

- 4个任务套件,难度递增

- 评估持续学习和泛化能力

- 标准化的评测协议

任务套件:

- LIBERO-Spatial:空间推理

- LIBERO-Object:物体泛化

- LIBERO-Goal:目标泛化

- LIBERO-Long:长时序任务

官网:https://libero-project.github.io/

RLBench

基本信息:

- 发布时间:2019年

- 环境:CoppeliaSim(V-REP)

- 任务数量:100+任务

数据特点:

- 涵盖多种操作技能

- 提供视觉观察和状态信息

- 支持多种机器人平台

任务类别:

- 抓取和放置

- 工具使用

- 组装任务

官网:https://sites.google.com/view/rlbench

5.3 真实世界数据集

Bridge Dataset (BridgeData V2)

基本信息:

- 发布时间:2023年

- 数据规模:60k条真实机器人轨迹

- 机器人平台:WidowX 250机械臂

- 环境:多样化的真实场景(办公室、厨房等)

数据特点:

- 多样化的桌面操作任务

- 真实办公和家庭场景

- 人类遥操作演示

- 高质量的标注和清洗

V2更新:

- 标准化采集流程

- 改进的数据质量控制

- 更丰富的场景多样性

应用:

- 模仿学习研究

- Sim-to-Real转移

- 包含在Open X-Embodiment中

官网:https://rail-berkeley.github.io/bridgedata/

RH20T Dataset

基本信息:

- 发布时间:2024年

- 特点:严格时间对齐的多模态数据

- 模态:视觉 + 触觉 + 音频 + 动作

数据特点:

- 微秒级时间同步:所有传感器严格对齐

- 多模态融合:RGB-D、触觉传感、音频

- 高频采集:支持精细操作的高频数据

应用:

- 多模态VLA训练(Tactile-VLA, OmniVTLA等)

- 触觉感知研究

DROID Dataset

基本信息:

- 发布时间:2024年

- 数据规模:76k条真实机器人操作轨迹

- 特点:大规模in-the-wild数据

应用:

- 真实环境操作研究

- 鲁棒性评估

Language-Table

基本信息:

- 发布时间:2022年

- 数据类型:真实桌面操作

- 任务类型:语言条件的物体重排列

数据特点:

- 简化的二维操作任务

- 清晰的语言-动作对应

- 便于快速原型开发

应用:

- 语言理解研究

- 策略学习方法验证

5.4 人机交互数据集

Ego4D

基本信息:

- 发布时间:2022年

- 数据规模:3,600小时第一人称视频

- 场景类型:日常生活活动

数据特点:

- 人类操作演示

- 丰富的语言标注

- 多样化的交互场景

VLA应用:

- 从人类视频中学习操作策略

- 理解人类意图和目标

5.5 评测基准

SIMPLER / SimplerEnv (Simulation Platform for Embodied Learning and Evaluation Research)

基本信息:

- 发布时间:2024-2025年

- 目标:标准化的VLA评测框架

评测内容:

- SimplerEnv-Instruct:80个零样本任务,多语言指令支持

- 跨任务泛化

- 跨环境泛化

- 鲁棒性测试

特点:

- 统一的输入输出接口

- 标准化的评测指标

- 支持多种机器人平台

应用:

- ICLR 2026等会议广泛使用

- 比较不同VLA模型的性能

- π0, OpenVLA等模型的官方评测平台

官网:https://simpler-env.github.io/

VLABench (From Intention to Execution)

基本信息:

- 发布时间:2025年

- 目标:分离评测VLA的意图理解和执行能力

核心指标:

- Intention Score (IS):评估指令理解的准确性

- Progress Score (PS):评估任务执行进度

- 双指标分离意图和执行两个维度

评测维度:

- Seen objects (已见物体)

- Unseen objects (未见物体)

- Unseen colors (未见颜色)

- Unseen textures (未见纹理)

- Unseen scenes (未见场景)

特点:

- 细粒度诊断VLA能力边界

- 超越二元成功率的多维评估

应用:

- ACoT-VLA等最新模型的评测

- 识别模型的弱点和改进方向

ManiSkill3

基本信息:

- 发布时间:2024年

- 特点:GPU并行高性能仿真器

技术特点:

- GPU加速:大规模并行仿真

- 域随机化:自动生成多样化场景

- 物理精度:高保真物理模拟

- 渲染质量:逼真的视觉渲染

应用:

- 大规模数据生成

- 快速策略评估

- Sim-to-Real研究

官网:https://maniskill.ai/

RoboCasa

基本信息:

- 发布时间:2024年

- 环境:标准化的家庭环境仿真

特点:

- 丰富的厨房场景

- 多样的家庭物品

- 标准化的任务定义

应用:

- 家庭机器人评测

- 长时程任务研究

6. 参考资源

6.1 综述与调研

学术综述

- An Anatomy of Vision-Language-Action Models (2512.11362v3) - IEEE TPAMI 2025,本文的核心参考综述,提出挑战驱动的分类法,系统梳理五大核心问题

- VLA-Survey-Anatomy GitHub - 上述综述的项目页面,持续更新

- Vision-Language-Action Models for Robotics: A Review Towards Real-World Applications - 面向真实世界应用的系统性综述

- Multimodal fusion with vision-language-action models for robotic manipulation: A systematic review - ScienceDirect 2025年发表的系统综述

- 10 Open Challenges Steering the Future of Vision-Language-Action Models - 未来十大开放挑战

会议分析

- State of VLA Research at ICLR 2026 - 分析了164篇ICLR 2026的VLA论文

- Muhayyuddin’s VLA Repository - 整合102个模型、26个数据集和12个仿真平台

6.2 开源模型与工具

主要VLA模型

开源模型:

- OpenVLA - 7B参数开源VLA模型(斯坦福大学)

- π0 (openpi) - Physical Intelligence的Flow Matching VLA

- Octo - 通用机器人策略

- LeRobot - Hugging Face的机器人学习库,整合多种VLA模型

- Large VLM-based VLA for Robotic Manipulation - 大规模VLM-based VLA列表

商业/闭源模型:

- RT-2, RT-X - Google DeepMind

- π0.5, π*0.6 - Physical Intelligence

- Gemini Robotics - Google

工具与框架

- RT-1 & RT-2 - Google DeepMind的VLA模型

- Octo - 开源通用机器人策略

- π₀ (Pi-Zero) - Physical Intelligence的通用策略

6.3 数据集与基准

大规模数据集

- Open X-Embodiment - 970k真实机器人轨迹,22种机器人

- RT-1 Dataset - 130k轨迹,700+任务

- Bridge Dataset - 60k桌面操作轨迹

仿真基准

6.4 学习资源

教程与博客

- Vision Language Action Models & Policies - LearnOpenCV

- VLA Models: The AI Brain Behind Next-Gen Robots

- What are Vision Language Action Models? Complete Guide

视频课程

6.5 会议与研讨会

主要会议

- CoRL (Conference on Robot Learning) - 机器人学习顶会

- RSS (Robotics: Science and Systems) - 机器人系统顶会

- ICRA (International Conference on Robotics and Automation) - 机器人与自动化国际会议

- IROS (International Conference on Intelligent Robots and Systems) - 智能机器人与系统国际会议

专题研讨会

- ICLR 2026 VLA Workshop

- NeurIPS/CVPR/ICCV 的具身AI workshop

6.6 实验室与研究组

领先研究团队

- Google DeepMind - RT-1, RT-2, RT-X等

- Stanford Vision and Learning Lab - OpenVLA, LIBERO等

- UC Berkeley RAIL - Bridge, Octo等

- Physical Intelligence - π₀等商业化产品

- Toyota Research Institute - 具身AI研究

6.7 相关领域

扩展阅读

- Vision-Language Models (VLM): CLIP, Flamingo, GPT-4V等

- Diffusion Models for Robotics: Diffusion Policy, 3D Diffuser Actor等

- World Models: Dreamer, Genie, VideoGPT等

- Embodied AI: Habitat, AI2-THOR, iGibson等平台

7. 总结与展望

Vision-Language-Action (VLA) 模型代表了机器人技术的重要范式转变,通过统一视觉、语言和行动三个模态,实现了从自然语言指令到机器人控制的端到端学习。自2022年RT-1和2023年RT-2开创这一方向以来,VLA研究取得了爆发式进展。

7.1 核心成就

架构创新:

- 从模块化系统演进到端到端统一模型

- 端到端与层级架构的混合趋势

- 动作表示从离散token到扩散模型再到Flow Matching的演进

规模扩大:

- 模型参数从130M (RT-1) 到7B (OpenVLA) 再到billion级 (DexVLA, RDT-1B)

- 数据规模从130k轨迹到970k (OXE) 再到1.5M+ (EO-Data)

- 支持的机器人从单一平台扩展到22+种形态

能力提升:

- 零样本泛化能力大幅提升(π₀.5开放世界泛化,详见第7节)

- 推理能力增强(CoT-VLA, ACoT-VLA第9节, π₀.5第7节)

- 实时性改善(SmolVLA 450M, Evo-1 77M, FAST 15x加速)

- 多模态感知(触觉、力传感、3D空间表示)

标准建立:

- 数据集标准(RLDS, Open X-Embodiment)

- 评测基准(LIBERO, CALVIN, SimplerEnv, VLABench)

- 开源生态(OpenVLA, LeRobot, ManiSkill3)

7.2 五大核心挑战的进展与未来

1. 表示(Representation)

当前进展:

- 多模态对齐方法日益成熟(对比学习、共享语义空间)

- 3D空间表示突破(点云、体素、4D轨迹)

- 世界模型快速发展(观察空间/潜在空间预测)

未来方向:

- 原生多模态架构(所有模态统一token化)

- 混合潜在-物理-语义世界模型

- 因果世界模型显式建模动作-结果关系

2. 执行(Execution)

当前进展:

- 推理增强VLA(CoT, ACoT)

- 层级规划方法成熟(语言/视觉/技能驱动)

- 实时性大幅提升(轻量模型、高效解码)

未来方向:

- 自适应架构(根据任务难度动态调整)

- 统一决策Token(see-think-act一体化)

- 自主性闭环(自感知、自纠正、自改进)

3. 泛化(Generalization)

当前进展:

- 跨机器人预训练成为标准

- 人类视频知识迁移有效

- Sim-to-Real差距缩小

- 在线RL与VLA结合(π*0.6)

未来方向:

- 形态无关表示(真正的跨具身迁移)

- 零样本跨形态部署

- 自主开放式进化(部署-发现-进化闭环)

4. 安全(Safety)

当前进展:

- 基于约束和学习对齐的双范式

- 可学习拒绝机制(RationalVLA)

- 层级架构提供天然可解释性

未来方向:

- 内在不确定性感知(System 2反思)

- 主动风险规避

- 交互式安全(可介入的透明性)

- 共享心智模型

5. 数据与评测(Data & Evaluation)

当前进展:

- 大规模跨机器人数据集(OXE, EO-Data)

- 标准化评测框架(SimplerEnv, VLABench)

- 多维度评估指标

未来方向:

- Simulation-First范式(模拟为主要数据源)

- Failure-Centric评测(失败作为信号)

- 细粒度诊断测试(超越二元成功率)

7.3 VLA研究的发展趋势

1. 从通用VLA到通用具身基础模型

- 支持全身协调(人形机器人、四足机器人)

- 移动操作一体化

- 跨任务、跨场景、跨形态的统一模型

2. 从模仿学习到自主学习

- 在线强化学习成为主流

- 自主数据收集和探索

- 从人类反馈中持续改进

3. 从单体智能到协作智能

- 多机器人协作

- 人机协作交互

- 预测式协作

4. 从实验室到真实世界

- 生产级可靠性

- 长时间稳定运行

- 商业化部署(家庭、工业、服务)

5. 从数据驱动到知识驱动

- 整合符号推理

- 物理常识先验

- 因果理解能力

7.4 关键开放问题

- 如何实现真正的开放世界泛化? 当前模型仍依赖有限的训练分布

- 如何在保持性能的同时大幅降低计算开销? 实时性vs准确性的权衡

- 如何建立形式化的安全保证? 超越启发式的数学验证

- 如何实现持续终身学习? 无遗忘的增量技能获取

- 如何从少量演示快速适应新任务? 真正的少样本学习

- 如何整合符号推理和神经感知? 神经-符号混合系统

- 如何实现人机共享的心智模型? 机器人理解人类意图,人类预测机器人行为

7.5 结语

VLA领域正处于快速发展期,ICLR 2026收录的164篇VLA论文标志着这一领域的爆发式增长。从RT-1的模块化系统,到RT-2的VLM转VLA,再到OpenVLA的开源生态,π₀的Flow Matching创新,π*₀.₆的在线学习突破,以及ACoT-VLA的动作空间推理,每一步都在推动具身智能向前发展。

随着大规模预训练模型、高质量机器人数据集、先进训练方法和标准化评测体系的不断完善,VLA模型有望成为下一代智能机器人的”大脑”。我们正站在通用具身智能的门槛上,未来的机器人将能够像人类一样理解世界、规划任务、精确执行,并在真实环境中持续学习和进化。

VLA不仅是技术突破,更代表了机器人研究范式的根本转变——从手工设计到数据驱动,从任务特定到通用能力,从离线学习到在线适应,从单一模态到多模态融合。这一转变正在重新定义机器人技术的未来。

声明:本文旨在为VLA领域的研究者和学习者提供全面的技术综述。由于该领域发展迅速,部分内容可能随时间推移而更新。欢迎读者在评论区讨论和补充最新进展。

8. 经典论文深度解析

为了帮助读者深入理解VLA领域的关键突破,本节精选11篇奠基性和前沿论文进行详细解读。这些论文代表了VLA研究从诞生(2022年RT-1)到快速发展(2026年最新工作)的完整脉络,涵盖了架构创新、训练范式、推理增强、开放世界泛化等核心方向。

论文选择标准:

- 奠基性工作:开创新方向或范式(RT-1, RT-2, Diffusion Policy)

- 里程碑模型:显著提升性能或开源影响力(OpenVLA, π₀系列)

- 前沿突破:2025-2026年的最新进展(π*₀.₆, ACoT-VLA, VLM4VLA, TwinBrainVLA)

- 技术多样性:覆盖不同架构、训练方法和应用场景

每篇论文的解读包括:精华提炼、研究背景、核心方法、关键结果和局限性分析,帮助读者快速把握要点并理解技术演进脉络。

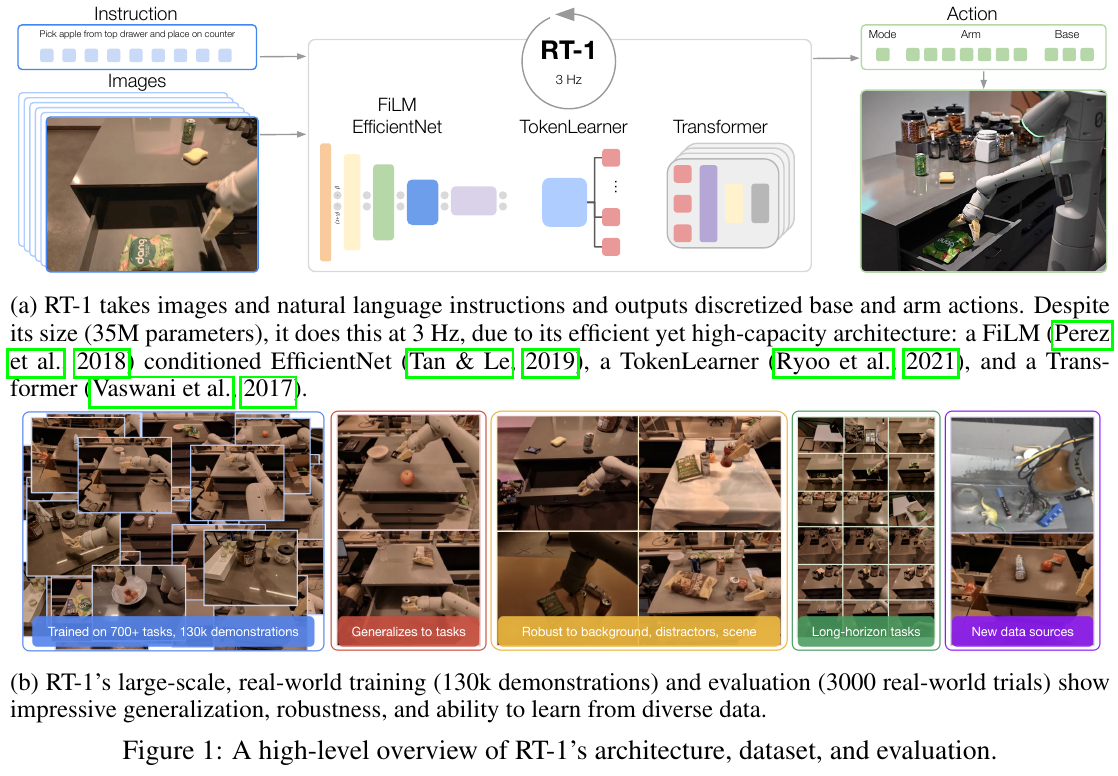

8.1 RT-1 (2022) {#1-rt-1-2022}

Robotics Transformer for Real-World Control at Scale

📄 Paper: https://arxiv.org/abs/2212.06817

精华

RT-1 的核心贡献在于证明了 Transformer 架构结合大规模真实机器人数据可以在数百种任务上达到实用水平的性能。其关键设计哲学——”大规模数据 + 适度架构”——打破了当时”机器人需要精心设计专用网络”的固有认知。Token Learner 的引入将视觉 token 从 512 压缩到 8,实现了高效推理;动作离散化(256 bins)与自回归生成的组合为后续 VLA 研究奠定了动作建模范式。

研究背景/问题

2022 年以前的机器人控制方法普遍依赖小规模数据训练的专用网络,难以泛化到新任务和新场景。语言和视觉领域已验证 Transformer + 大规模数据的有效性,但能否将同样范式迁移到真实世界机器人控制尚未被证明。核心问题:能否通过大规模多任务真实机器人数据训练单一 Transformer 网络,使其在数百种任务上达到高成功率并泛化到未见任务?

主要方法/创新点

架构设计:

| 模块 | 设计 | 作用 |

|---|---|---|

| 视觉编码 | EfficientNet-B3 + Token Learner | 将图像压缩为 8 个视觉 token,高效提取语义特征 |

| 语言编码 | Universal Sentence Encoder (USE) | 将任务指令映射为固定长度嵌入 |

| 骨干网络 | Transformer(11层,38M 参数) | 融合视觉和语言 token,自回归生成动作 token |

| 动作建模 | 离散化(256 bins/维) | 11 维动作空间(7-DOF 臂 + 2 夹爪 + 终止标志)均匀量化 |

数据规模:在 Everyday Robots 机器人上采集 130k 条真实轨迹,覆盖 700+ 任务、多种物体和场景,历时 17 个月人工遥操作。

推理效率:Token Learner 将 EfficientNet 输出的 512 个空间 token 压缩为 8 个,使单步推理速度达到 3Hz,满足实时控制需求。

核心结果/发现

已见任务(training distribution):

- 平均任务成功率 97.0%,显著超过 BC-Z(66.0%)和 SayCan(65.8%)

- 在 700+ 不同任务上保持稳定高性能,证明大规模多任务训练的有效性

未见任务(zero-shot generalization):

- 未见任务成功率 76.0%,远超先前方法的 20-40% 水平

- 证明 Transformer 架构能从多任务训练中习得可迁移的底层技能

数据规模消融:

- 使用全量数据(130k)vs 1/3 数据:成功率从 97% 降至 68%

- 明确的数据规模收益曲线,验证”更多数据→更好性能”假设

局限性

- 语言指令仅用于任务选择(”pick up the apple”),缺乏真正的语义理解和推理能力

- 数据采集代价高昂(需要专业操作员和特定机器人硬件),难以复现

- 视觉编码器采用固定分辨率,不擅长细粒度精细操作

- 动作量化引入精度损失,在精细接触任务中性能下降明显

- 依赖单一固定机器人平台,不具备跨具身迁移能力

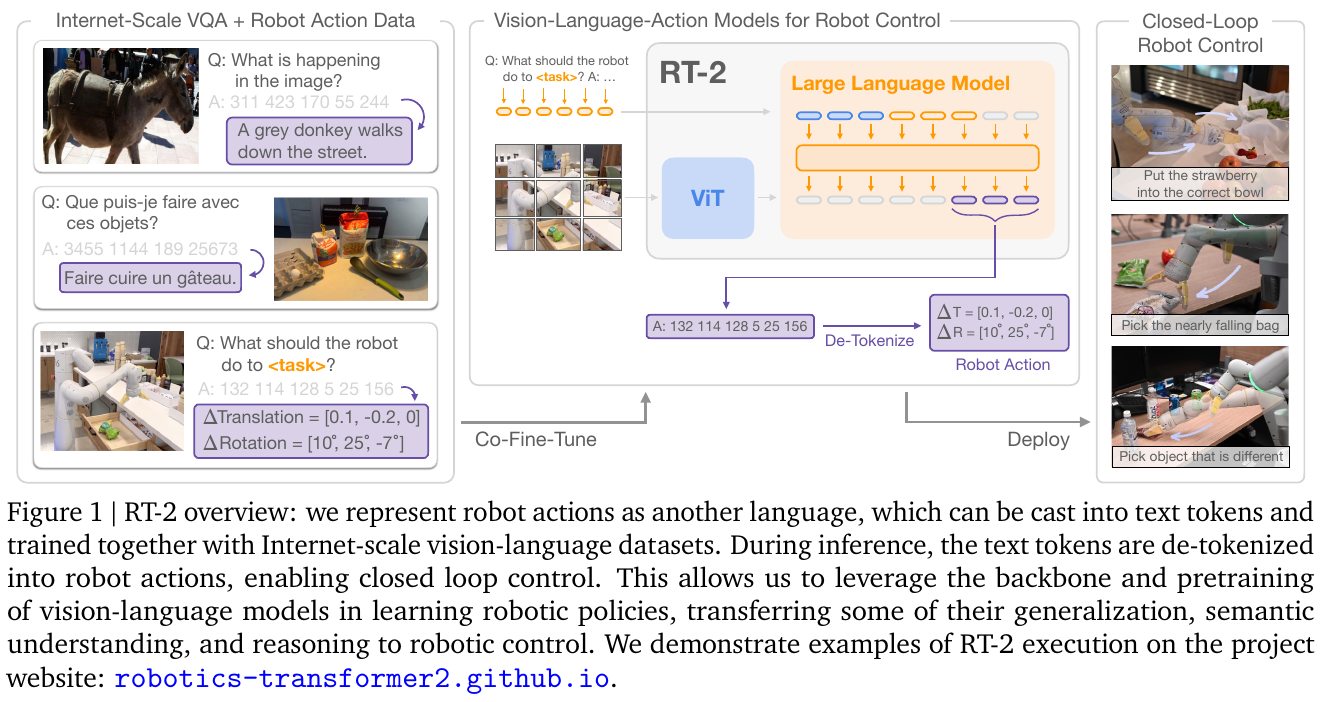

8.2 RT-2 (2023) {#2-rt-2-2023}

Vision-Language-Action Models Transfer Web Knowledge to Robotic Control

📄 Paper: https://arxiv.org/abs/2307.15818

精华

RT-2 是 VLA 领域真正的范式突破:通过将机器人动作表示为语言 token,VLM 的 next-token prediction 能力被无缝扩展到动作生成,无需修改模型架构。最关键的发现是”涌现能力”(emergent capabilities)——RT-2 可以执行从未在机器人数据中出现过的新型推理任务(如”拿起可以灭火的物体”),这直接来自 VLM 的互联网知识。这一发现重新定义了机器人学习的可能性边界。

研究背景/问题

大型视觉-语言模型(VLM)已在跨模态理解和常识推理方面表现出色,但这些能力无法直接用于机器人控制。传统做法是将 VLM 用于高层规划,再配合低层控制器执行——这引入了模块间的信息损失和对齐误差。核心问题:能否直接将 VLM 微调为能执行物理动作的 VLA 模型,同时保留预训练的语义理解和推理能力?

主要方法/创新点

核心创新:动作作为语言 token

传统方式: 视觉 + 语言 → VLM → 文本规划 → 低层控制器 → 动作

RT-2方式: 视觉 + 语言 → VLA → 动作token序列(直接控制)

架构:

- 基础模型:PaLI-X(5B 参数)或 PaLM-E(55B 参数)

- 将 7-DOF 机器人动作(末端执行器位姿 + 夹爪)离散化为 256 个 bin,表示为整数字符串 token(如 “128 97 234 45 189 203 1”)

- 与视觉-语言数据联合微调(co-fine-tuning):交替在机器人演示数据和互联网 VL 数据上训练,防止灾难性遗忘

关键设计决策:

- 机器人数据(约 100k 轨迹)与互联网 VL 数据(约 100B token)混合训练

- 动作 token 直接插入语言词表,利用自回归解码生成动作序列

- 支持 chain-of-thought reasoning:在生成动作前先生成推理文本

核心结果/发现

基础性能:

- 在已见任务上成功率 62%(RT-2, 5B),与 RT-1(71%)相近但模型参数增加了 38 倍

- RT-2-X(55B)在 Google 机器人评测上平均成功率 78.3%

涌现推理能力(关键发现): | 评估类型 | RT-2-X 成功率 | RT-1 成功率 | |———|————-|———–| | 场景理解推理(”将最近的物体放到纸板上”) | 55% | 22% | | 符号推理(”执行加法后把结果数量的物体放入碗”) | 50% | 10% | | 常识知识(”拿起可以灭火的物体”) | 60% | 25% |

Chain-of-Thought 推理:

- 在执行动作前先生成自然语言推理步骤,成功率在部分任务上提升 13%

局限性

- 55B 参数模型计算代价极高,无法在边缘设备部署,推理速度仅约 1-3Hz

- 完全闭源(Google 内部),外部研究者无法复现或微调,推动了后续开源工作(OpenVLA)

- 动作 token 化引入精度损失,难以执行需要亚毫米精度的精细操作

- co-fine-tuning 对数据混合比例敏感,调试复杂

- 在全新机器人平台上的跨具身迁移能力仍有限

8.3 RT-X / Open X-Embodiment Dataset (2023) {#3-rt-x-2023}

Scaling Up and Distilling Down: Language-Guided Robot Skill Acquisition

📄 Paper: https://arxiv.org/abs/2310.08864

精华

OXE 和 RT-X 共同验证了一个重要假设:来自不同机器人的数据可以相互增益,跨具身训练不会因为形态差异而造成干扰,反而带来正迁移。这为机器人学习从”实验室孤岛”走向”共享数据生态”提供了关键证据,是 AgiBot World、InternData-A1 等后续大规模数据集建设的理论基础。

研究背景/问题

机器人学习数据极度碎片化:每个实验室独立采集数据,使用不同机器人、不同任务定义、不同存储格式,导致数据无法共享和复用。即便单个实验室拥有足够的数据,也只能训练适用于本实验室机器人的专用模型。核心问题:能否将来自全球多个实验室、22 种不同机器人的数据统一整合,并证明联合训练的模型优于仅在单一机器人数据上训练的模型?

主要方法/创新点

Open X-Embodiment 数据集:

- 规模:970k 条机器人轨迹,22 种不同机器人平台,来自全球 21 个机构

- 统一格式:采用 RLDS(Reinforcement Learning Datasets)格式标准化异构数据,包含 RGB 图像、语言指令、机器人关节角度/末端执行器动作

- 覆盖范围:从 7-DOF 桌面机械臂(WidowX、Franka)到移动机器人(Hello Stretch),涵盖抓取、推拉、翻转等多种操作技能

RT-X 训练策略:

- 分别在 OXE 数据上训练 RT-1 骨干(RT-1-X)和 RT-2 骨干(RT-2-X)

- 跨具身共训:模型在推理时通过语言指令和视觉观察推断任务,无需机器人类型标识

- 针对不同数据集采用加权混合采样策略,平衡数据规模差异

核心结果/发现

跨具身正迁移(核心发现):

- RT-1-X(130M)在 5/6 个评估机器人上优于仅在该机器人数据上训练的 RT-1

- RT-2-X(55B)在新型任务评估中成功率 62%,比原始 RT-2 的 55% 提升 7%

迁移效率对比: | 模型 | 训练数据 | WidowX 成功率 | Google 机器人成功率 | |——|———|————-|—————–| | RT-1(单机器人) | 仅 Everyday Robots | – | 71% | | RT-1-X(OXE联合) | 22 种机器人 | +15% vs 单训 | +10% vs 单训 | | RT-2-X | OXE + 互联网 | 显著提升 | 78.3% |

数据格式标准化:RLDS 格式成为此后机器人数据集的事实标准,被 AgiBot World、InternData-A1 等大规模数据集采用。

局限性

- 22 种机器人平台中数据量严重不均衡,长尾机器人的性能提升有限

- 原始数据质量参差不齐(不同实验室采集标准不同),引入噪声

- 未包含双臂、全身人形等新兴形态,覆盖面仍有局限

- RLDS 统一格式损失了部分传感器细节(如触觉、力传感数据)

- 评估协议不统一,不同实验室间的性能比较存在偏差

8.4 Diffusion Policy (2023) {#4-diffusion-policy-2023}

Visuomotor Policy Learning via Action Diffusion

📄 Paper: https://arxiv.org/abs/2303.04137

精华

Diffusion Policy 的核心洞见是:机器人动作分布本质上是多峰的(同一任务有多种合理执行方式),而传统的均方误差损失函数会将这些模式平均掉,导致”平均动作”——既不像任何一种合理动作。扩散模型天然能够表达多峰分布,Action Chunking(一次预测多步动作)进一步提升了长时序任务的流畅性。这两个设计已成为后续 VLA 动作解码(π₀ 的 Flow Matching、ACoT-VLA 的动作推理)的共同基础。

研究背景/问题

模仿学习方法(如 BC-RNN、IBC)在精细操作任务上性能不稳定。核心问题在于机器人演示数据天然具有多模态性:同一任务,专家可以从左侧抓取也可以从右侧抓取,两种轨迹都是正确的。传统回归损失(MSE)会将两种模式平均,导致输出”模糊中间状态”动作而失败。核心问题:如何为机器人策略学习建模多模态、高维的动作分布,使其能够可靠执行需要精细接触的复杂操作?

主要方法/创新点

扩散模型作为策略:

传统策略: π(o_t) → a_t (确定性映射)

扩散策略: a_t ~ p_θ(·|o_t) (条件分布采样)

通过迭代去噪: a^K → a^(K-1) → ... → a^0

两种架构变体:

| 架构 | 视觉骨干 | 去噪网络 | 推理速度 |

|---|---|---|---|

| CNN-Diffusion | ResNet-18(时序堆叠) | 1D-UNet | 快(~20Hz) |

| Transformer-Diffusion | ViT + 位置编码 | Transformer | 稳定但较慢 |

关键设计:

- Action Chunking:一次预测 $T_p=16$ 步动作序列(而非单步),缓解 compounding error,提升长任务流畅性

- DDIM 加速推理:使用 DDIM 从原始 100 步 DDPM 压缩到 10 步,满足实时控制需求

- Receding horizon 执行:每次仅执行预测动作序列的前 $T_a=8$ 步,保持闭环反馈

训练目标: \(\mathcal{L} = \mathbb{E}_{t, a_0, \epsilon}\left[\|\epsilon - \epsilon_\theta(a_t, t, o_t)\|^2\right]\)

核心结果/发现

仿真基准(与 BC-RNN、IBC 对比):

| 任务 | Diffusion Policy(CNN) | Diffusion Policy(Trans) | BC-RNN |

|---|---|---|---|

| Push-T(轨迹精度) | 91.5% | 95.0% | 82.5% |

| Block Pushing | 99.0% | 98.0% | 78.0% |

| Kitchen(多步序列) | 79.7% | 86.0% | 66.1% |

真实机器人实验(Franka 臂):

- 在 6 个精细操作任务(餐具摆放、罐头开盖、插头连接等)上平均成功率 76.3%

- 显著优于 BC-RNN(56.2%)和 IBC(51.0%)

多峰性验证:在”杯子放置”任务中,Diffusion Policy 稳定生成两种不同的合理轨迹(正面放/侧面放),而 BC-RNN 只能生成”中间状态”失败动作。

局限性

- 扩散推理需要多步迭代(即使用 DDIM 也需 10 步),与直接预测相比推理延迟更高,限制了超高频控制(>50Hz)

- 仅使用视觉和本体感知输入,没有语言指令跟随能力,无法处理多任务场景

- 在语义场景理解和任务泛化方面没有改善(专为低层动作建模设计)

- 对演示数据质量敏感,噪声或不一致的演示会影响分布建模质量

- 缺乏显式的任务推理机制,不适合需要长时程规划的复杂多步骤任务

8.5 OpenVLA (2024) {#5-openvla-2024}

———开源视觉-语言-动作模型

📄 Paper: https://arxiv.org/abs/2406.09246v3

精华

这篇论文展示了如何构建开源的大规模机器人控制模型,值得借鉴的核心思想包括:

- 利用预训练的视觉-语言模型作为基础,通过将机器人动作视为语言token的方式实现端到端训练

- 在大规模多样化机器人数据集(97万条轨迹)上训练可以显著提升泛化能力

- 融合多个视觉编码器(SigLIP + DINOv2)能够同时捕获语义和空间信息,提升机器人控制性能

- 参数高效微调(LoRA)和量化技术使得7B参数模型可以在消费级GPU上部署和微调

- 完全开源模型、代码和训练流程为社区研究提供了重要基础设施

研究背景/问题

现有的机器人操作策略难以泛化到训练数据之外的物体、场景和任务。虽然视觉-语言基础模型在互联网规模数据上展现了强大的泛化能力,但现有的视觉-语言-动作模型(VLA)要么是闭源的,要么缺乏高效微调到新机器人设置的方法,阻碍了VLA在机器人领域的广泛应用。

主要方法/创新点

OpenVLA是一个7B参数的开源视觉-语言-动作模型,在Open X-Embodiment数据集的97万条机器人演示轨迹上训练。模型架构包含三个关键组件:

- 融合视觉编码器(“三个臭皮匠”协作逻辑): 采用多骨干视觉编码策略,将视觉特征物理隔离并各自优化:

- DINOv2: 提供强大的几何和空间特征(理解“在哪里”,擅长物体定位与深度感知)。

- SigLIP: 提供强大的语义理解(理解“是什么”,擅长对齐自然语言指令)。

- CLIP/其他: 提供互补的视觉特征。 这种“组合拳”模式使得 7B 的模型在信息处理效率上击败了单一编码器的 55B 巨量模型。

-

投影器: 2层MLP将视觉特征投影到语言模型的输入空间。

- 语言模型骨干(“诸葛亮”大脑): 基于Llama 2 7B,作为统一决策中心,融合空间信息与语义信息进行指令推理。

训练策略:

- 动作离散化:将连续动作的每个维度量化为256个bin,使用1-99分位数作为量化范围

- 使用Llama tokenizer中最少使用的256个token表示离散化动作

- 端到端微调所有参数(包括视觉编码器),在64个A100 GPU上训练14天

- 完成27个epoch,直到动作token准确率超过95%

数据处理:

- 从Open X-Embodiment筛选具有第三人称相机和单臂末端执行器控制的数据集

- 采用Octo的数据混合权重,对多样性高的数据集上采样

- 过滤Bridge数据集中的全零动作,提升模型性能

OpenVLA训练流程:在970k条机器人轨迹(Open X-Embodiment数据集)上微调预训练VLM(Llama-2 7B)以预测机器人动作,采用动作token化表示实现端到端学习。详见论文Figure 2。

flowchart LR

A["预训练 VLM<br/>Prismatic-7B(Llama-2)"] --> B["动作 Token 化<br/>256 bins 均匀离散化"]

B --> C["OXE 数据微调<br/>970k 机器人轨迹"]

C --> D["自回归动作预测头<br/>next-token prediction"]

D --> E["7-DOF 连续动作<br/>Δxyz + ΔRxyz + gripper"]

style A fill:#e3f2fd,stroke:#1565c0

style C fill:#e8f5e9,stroke:#2e7d32

style E fill:#fff3e0,stroke:#e65100

微调和部署优化:

- LoRA微调: rank=32的LoRA可以匹配全参数微调性能,仅需训练1.4%参数,单个A100 GPU即可完成

- 量化推理: 4-bit量化将GPU内存需求从16.8GB降至7.0GB,性能无明显下降

- 推理速度: 在RTX 4090上以6Hz运行(bfloat16),4-bit量化可进一步提升速度

核心结果/发现

- 跨机器人泛化能力:

- 在BridgeData V2 WidowX机器人上,OpenVLA达到70.6%平均成功率,比RT-2-X(55B参数)高16.5%,参数量仅为其1/7

- 在Google机器人上与RT-2-X性能相当(85.0% vs 78.3%)

- 显著优于Octo(20.0%)和RT-1-X(18.5%)等开源方法

- 多种泛化能力测试:

- 视觉泛化(未见背景、干扰物):52.0% vs RT-2-X 29.0%

- 运动泛化(未见物体位置/方向):60.0% vs RT-2-X 25.0%

- 物理泛化(未见物体尺寸/形状):55.0% vs RT-2-X 26.7%

- 语义泛化(未见物体和概念):36.3% vs RT-2-X 38.8%

- 语言grounding(多物体场景):85.0% vs RT-2-X 76.7%

BridgeData V2评估结果:OpenVLA在多种泛化任务上均优于现有方法(Octo、RT-2等),特别是在未见物体和场景的零样本泛化上表现突出。详见论文Figure 3。

| 任务类型 | OpenVLA | Octo | RT-2 |

|---|---|---|---|

| 已见任务 | ✅ 高 | ✅ 中 | ✅ 高 |

| 未见物体 | ✅ 高 | ⚠️ 低 | ✅ 中 |

| 未见场景 | ✅ 高 | ⚠️ 低 | ⚠️ 中 |

- 数据高效适应:

- 在Franka机器人7个任务上(10-150条演示),OpenVLA微调后平均成功率63.8%

- 在单指令任务上,Diffusion Policy表现更好(66.7% vs 53.5%)

- 在多指令任务上,OpenVLA显著优于Diffusion Policy(91.7% vs 19.4%)

- OpenVLA是唯一在所有任务上达到≥50%成功率的方法

数据高效适应实验:OpenVLA高度多样化多指令任务上表现最佳,仅需少量演示(10-50条)即可在新任务上实现高成功率,显著优于从头训练和其他预训练VLA模型。详见论文Figure 4。

- 计算效率:

- LoRA微调(rank=32)匹配全参数微调性能,GPU内存需求从163.3GB降至59.7GB

- 4-bit量化推理性能无下降(71.9% vs 71.3%),内存占用减半

- 在消费级GPU上即可部署和微调

- 开源影响:

- 首个开源的大规模VLA模型,包含完整训练代码和流程

- 支持HuggingFace集成,提供微调notebook

- 为社区研究VLA提供重要基础设施

开发者快速开始 (OpenVLA 使用示例):

import torch

from transformers import AutoModelForVision2Seq, AutoProcessor

# 加载预训练模型

model_id = "openvla/openvla-7b"

processor = AutoProcessor.from_pretrained(model_id, trust_remote_code=True)

model = AutoModelForVision2Seq.from_pretrained(

model_id, torch_dtype=torch.bfloat16, low_cpu_mem_usage=True, trust_remote_code=True

).to("cuda")

# 准备指令和图像

prompt = "In: What action should the robot take to pick up the red bowl?\nOut:"

inputs = processor(images=image, text=prompt, return_tensors="pt").to("cuda", dtype=torch.bfloat16)

# 生成动作

action = model.predict_action(**inputs, unnorm_key="bridge_orig")

print(f"Predicted Action: {action}")

局限性

模型目前仅支持单图像观察输入,不支持多相机视角、本体感知信息或观察历史。推理速度(6Hz)对于高频控制任务(如50Hz的ALOHA)仍不够快。虽然优于现有泛化策略,但在测试任务上的成功率通常<90%,可靠性还有提升空间。由于计算限制,许多VLA设计问题(如基础VLM规模、协同训练策略、最佳视觉特征等)尚未充分探索。

8.6 π₀ (2024) {#6-π₀-2024}

: A Vision-Language-Action Flow Model for General Robot Control ———首个基于 Flow Matching 的通用机器人策略基础模型

📄 Paper: https://arxiv.org/abs/2410.24164

精华

这篇论文展示了如何构建真正的通用机器人策略基础模型,值得借鉴的点包括:在预训练 VLM 之上通过 flow matching 添加连续动作输出能力、利用互联网规模的语义知识指导机器人控制、设计专门的注意力掩码处理视觉-语言-动作的异构 token、在多个机器人平台上联合训练实现跨平台泛化。这种方法论为构建能够快速适应新任务的通用机器人智能提供了清晰路径,特别是 flow matching 相比扩散模型在实时控制中的优势值得在其他具身 AI 系统中借鉴。

研究背景/问题

现有的机器人学习方法主要依赖针对特定任务和特定机器人平台的专门训练,难以实现跨任务和跨平台的泛化。虽然大规模视觉语言模型展示了强大的语义理解能力,但如何将其应用于需要实时、精确、连续动作输出的机器人控制仍是挑战。本文探索如何构建能够处理多样化任务的通用机器人策略基础模型。

主要方法/创新点

论文提出了 π₀ (Pi-Zero),一个基于 flow matching 的视觉-语言-动作 (VLA) 模型,用于通用机器人控制。

1. 整体架构设计

预训练 VLM 骨干网络:

- 使用 PaliGemma 作为基础,这是一个结合了 SigLIP (视觉编码器) 和 Gemma (语言编码器) 的 3B 参数 VLM

- 继承互联网规模的语义知识,理解自然语言指令和视觉场景

Flow Matching 动作专家:

- 在预训练 VLM 之上添加专门的动作生成模块

- 使用 flow matching 技术生成连续、平滑的动作轨迹

- 实现 50Hz 的实时控制频率,满足灵巧操作需求

2. Flow Matching 方法

核心原理:

- 从随机噪声开始,通过学习的流场逐步变换到目标动作序列。

- 相比扩散模型,flow matching 提供更平滑的轨迹和更快的采样速度。

- 实现 50Hz 的实时控制频率(每秒更新约50次动作),这是实现代际跨越的关键。

性能飞跃:

- 极高精度: 能够执行 折纸、玩扑克牌、折叠衣物 等 OpenVLA 和 Octo 难以胜任的灵巧任务。

- 动作连续性: 生成一段长度约 1 秒(50 步)的平滑控制计划,大幅减少了机器人的抖动和迟滞。

- 避免了扩散模型多步采样带来的延迟问题,使得控制质量更接近传统控制系统。

3. 专门的注意力机制

VLA vs VLM 的关键区别:

| 特性 | VLM | VLA |

|---|---|---|

| 输入 | 图像、文本 | 图像、文本、观察状态 |

| 输出 | 文本、嵌入 | 连续动作序列 |

| 注意力模式 | 标准因果 | 块稀疏因果 |

Token 类型设计:

- 前缀 Token (图像 + 文本指令):

- 完全双向注意力,类似标准 Transformer

- 编码场景理解和任务描述

- 状态 Token (机器人观察):

- 可访问所有前缀 token

- 与之前时间步的状态呈三角形因果关系

- 编码当前机器人状态

- 动作 Token (电机命令):

- 可访问所有非 padding 的 token

- 完全可见的因果注意力

- 生成具体的控制信号

FlexAttention 优化:

- 使用 PyTorch 的 FlexAttention 高效处理 VLA 的块稀疏注意力模式

- 相比 FlashAttention2(设计用于严格因果模式),FlexAttention 更适合不规则块掩码

- 提供纯 PyTorch 接口,易于定制和优化

4. 大规模多任务训练

训练数据来源:

- Open X-Embodiment Dataset: 开源机器人轨迹数据

- 互联网规模预训练: 从 PaliGemma 继承的视觉语言知识

- π Dataset: Physical Intelligence 自己收集的多机器人数据

多平台训练:

- 7-8 个机器人平台: 单臂(UR5e)、双臂(Franka)、移动操纵器

- 68 个独特任务: 覆盖灵巧操作、物体取回、整理等多样场景

- 跨平台联合训练实现形态无关的通用策略

数据整合策略:

- 统一的观察-动作序列表示

- 处理不同机器人平台的动作空间差异

- 利用 VLM 的语义理解能力实现跨任务知识迁移

5. π₀-FAST:加速版本

FAST (频率空间行动序列标记化):

- 将连续动作序列转换为离散 token,支持自回归生成

- 通过 DCT 变换到频域,保留低频重要系数

- 使用 BPE 编码频域系数,实现高效压缩

FAST 优势:

- 比基于扩散的 VLA 快 5 倍

- 改进的动作表示减少冗余

- 更强的跨环境和机器人形态泛化

- 已在 100 万个动作序列上训练,支持多种机器人类型

主要创新包括:

- 首次将 flow matching 应用于大规模通用机器人策略

- 设计了适合 VLA 的块稀疏注意力机制

- 实现了真正的多平台、多任务联合训练

- 开源了模型权重和代码(openpi repository)

核心结果/发现

零样本性能(无任务特定微调)

在 5 个零样本评估任务上的平均成功率:

| 任务 | π₀ | OpenVLA | Octo |

|---|---|---|---|

| Bussing Easy (收拾桌子-简单) | 97.1% | 34.3% | 4.3% |

| Shirt Folding (折叠衬衫) | 100% | 0% | 0% |

| Grocery Bagging (装袋杂货) | 78.6% | 0% | 0% |

| Box Assembly (组装盒子) | 高成功率 | - | - |

| Object Retrieval (物体取回) | 高成功率 | - | - |

关键发现:

- π₀ 在所有任务上显著优于开源模型 OpenVLA 和 Octo

- 即使在最简单的任务上,π₀ 也展示了 2-3 倍的性能优势

- 在复杂任务(如折叠衬衫、装袋杂货)上,其他模型完全失败而 π₀ 仍保持高成功率

微调性能(少量任务特定数据)

在相同微调数据下,与其他机器人学习方法对比:

| 模型 | Bowl Stacking (碗堆叠) | 平均跨任务成功率 |

|---|---|---|

| π₀ | ~100% | ~80% |

| Diffusion Policy | ~55% | ~35% |

| ACT | ~45% | - |

| OpenVLA | <10% | - |

| Octo | <10% | - |

关键观察:

- π₀ 微调后在几乎所有任务上接近完美表现

- 相比专门的行为克隆方法(ACT、Diffusion Policy),性能提升超过 2 倍

- 预训练带来的零样本能力使微调更高效

消融实验

VLM 预训练的价值:

- π₀-small(无 VLM 预训练)vs 完整 π₀:性能差距超过 2 倍

- 证明了互联网规模语义知识对机器人控制的重要性

Flow Matching vs 扩散模型:

- 实时性:50Hz 控制频率,满足灵巧操作需求

- 平滑性:生成的动作轨迹更连续、更适合物理系统

- 效率:相比多步扩散采样,推理速度显著提升

真实世界长时运行

部署验证:

- 在真实家庭环境中折叠多种衣物(T恤、毛巾、裤子)

- 收拾真实餐桌,处理不同大小和形状的餐具

- 在超市场景中装袋杂货,处理软硬不同的物品

- 组装各种尺寸的纸箱,展示精细操作能力

跨平台泛化:

- 在未见过的机器人平台上通过少量微调实现高性能

- 展示了通用策略基础模型的实用价值

开源影响

- 2025 年 2 月开源代码和权重(GitHub: Physical-Intelligence/openpi)

- 集成到 Hugging Face LeRobot 框架

- FAST 标记器已集成到 Hugging Face Transformers

局限性

当前模型仍需要针对具体任务进行微调才能达到生产级别的可靠性,特别是在处理完全未见过的任务类型时。模型的成功依赖于高质量的训练数据,在数据分布外的长尾场景(如极端光照、复杂遮挡)下性能可能下降。50Hz 的控制频率虽然适合大多数操作任务,但对于需要更高频率反馈的动态任务(如接球、快速避障)可能不够。未来工作可以探索更大规模的预训练、主动学习策略和更高效的在线适应机制。

Sources:

8.7 π₀.5 (2025) {#7-pi05-2025}

副标题: A Vision-Language-Action Model with Open-World Generalization 中文标题: 具有开放世界泛化能力的视觉-语言-动作模型

📄 Paper: arXiv:2504.16054 🌐 Blog: Physical Intelligence Blog

精华

π₀.5是Physical Intelligence在π₀基础上的重大升级,首次实现了端到端学习机器人系统在全新家庭环境中执行长时程(10-15分钟)复杂任务的能力。其核心创新在于:通过异构任务协同训练(co-training)和知识隔离(knowledge insulation)技术实现开放世界泛化;整合多机器人数据、高层语义预测、网络数据等多源信息;使用混合多模态样本(图像观察、语言指令、物体检测、语义子任务预测和底层动作)进行训练。

研究背景/问题

现有的通用机器人策略模型虽然在特定环境下表现良好,但在完全未见过的新环境中执行长时程、多阶段的复杂任务时仍面临巨大挑战。特别是在家庭服务场景中,机器人需要在从未训练过的新房间里完成清洁厨房或卧室这样的复杂任务,这要求模型具备强大的开放世界泛化能力。

主要方法/创新点

1. 异构任务协同训练(Heterogeneous Task Co-training)

- 整合来自多个机器人平台、不同任务场景的数据

- 通过多任务学习提升模型的通用性和鲁棒性

- 利用任务间的知识迁移增强泛化能力

2. 知识隔离(Knowledge Insulation)

- 在训练过程中保护预训练知识不被特定任务数据污染

- 允许模型在学习新技能时保留已有的通用能力

- 实现更好的前向迁移和零样本泛化

3. 混合多模态输入

- 图像观察: 来自多视角相机的RGB图像

- 语言指令: 自然语言任务描述

- 物体检测: 场景中关键物体的识别和定位

- 语义子任务预测: 高层任务分解和规划

- 底层动作: 具体的机器人控制信号

4. 高层语义预测

- 预测任务执行过程中的语义子目标

- 作为中间表示指导底层动作生成

- 提升长时程任务的规划能力

核心结果/发现

开放世界家庭任务:

- 能够在训练数据中从未见过的全新家庭环境中成功执行复杂任务

- 典型任务包括清洁厨房和整理卧室,持续时间10-15分钟

- 涉及多阶段行为:物体识别、导航、抓取、擦拭、放置等

移动操作能力:

- 控制移动机械臂机器人在新环境中自主导航

- 执行灵巧操作技能(如擦拭、抓取、整理)

- 展示了端到端学习系统的实用化潜力

关键突破:

- 首次证明端到端学习机器人可在完全未见的环境中执行长时程复杂任务

- 显著提升了对新场景、新物体的泛化能力

- 为家庭服务机器人的实际部署提供了可行路径

局限性

虽然π₀.5在开放世界泛化方面取得重大突破,但仍存在一些限制:模型在极端新颖场景或完全未知物体类别上可能表现不稳定;长时程任务的失败恢复机制仍需改进;计算资源需求较高,限制了在边缘设备上的实时部署。未来研究方向包括进一步提升样本效率、增强在线适应能力、以及在更广泛的机器人平台上验证。

8.8 π*₀.₆ (2025) {#8-pi06-2025}

副标题: A VLA That Learns From Experience 中文标题: 通过真实部署经验实现自我改进的视觉-语言-动作模型

📄 Paper: https://arxiv.org/abs/2511.14759

精华

这篇论文展示了如何让通用机器人策略模型通过真实世界部署数据实现持续自我改进,值得借鉴的点包括:通过优势条件化(advantage conditioning)避免传统 RL 算法中复杂的梯度计算和对数似然估计问题、整合异构数据源(演示数据、自主收集数据、专家干预数据)到统一训练框架、使用 Knowledge Insulation 技术实现端到端 RL 训练而无需回传梯度到动作专家模块。这种方法论特别适合需要在真实环境中持续改进的具身 AI 系统,为 VLA 模型的实用化部署提供了可行路径。

研究背景/问题

现有的 Vision-Language-Action (VLA) 模型通常依赖离线数据集进行监督学习,难以通过真实世界的部署经验实现持续改进。虽然强化学习理论上可以实现在线优化,但传统 RL 算法(如 PPO)在大规模流匹配(flow-matching)动作模型上难以计算梯度和对数似然,限制了其在真实机器人系统中的应用。本文探索如何让 VLA 模型通过部署经验和专家纠正实现自我改进。

主要方法/创新点

论文提出了 RECAP (RL with Experience and Corrections via Advantage-conditioned Policies) 方法,核心思想是通过优势条件化策略实现强化学习训练。整个流程包含三个关键步骤:

- 异构数据收集:

- 自主执行任务并记录结果(成功/失败)

- 允许人类专家在执行过程中进行遥操作干预

- 收集三类数据:初始演示、自主收集的在线数据、专家纠正数据

- 价值函数训练:

- 训练一个多任务分布式价值函数 V(o,ℓ),预测当前观察下完成任务 ℓ 还需要多少步

- 使用 670M 参数的独立 VLM 作为价值函数网络

- 基于任务成功/失败标签计算每个动作的优势(advantage)

- 优势条件化策略提取:

-

关键创新:训练策略网络 π̂(a o,ℓ,I) 时加入二值化的优势指示器 I -

数学形式:π̂(a o,ℓ) ∝ π_ref(a o,ℓ) × (π_ref(a I,o,ℓ)/π_ref(a o,ℓ))^β - I 表示该动作的优势是否超过任务相关阈值 ε_ℓ

- 推理时强制 I=true,引导模型选择高优势动作

-

模型架构 π*₀.₆:

- 基于 Gemma 3 的 4B 参数 VLM 骨干网络

- 860M 参数的 flow-matching 动作专家模块

- 使用 Knowledge Insulation 技术:冻结动作专家的梯度,仅训练 VLM 部分

- 这避免了计算 flow-matching 模型对数似然的难题

数据整合策略:

- 演示数据: 在监督微调阶段,将优势固定为 “true”

- 自主收集数据: 通过价值函数计算真实优势

- 专家干预数据: 假设人类专家动作总是好的,强制优势为 “true”

- 所有数据统一通过优势条件化框架训练

主要创新包括:

- 首次将优势条件化方法应用于大规模 VLA 模型的在线 RL 训练

- 避免了传统策略梯度方法对可微分对数似然的依赖

- 充分利用所有数据而不需要对次优样本进行下采样或降权

- 支持人类专家实时干预并将其有效整合到训练过程

研究背景/问题

现有的 Vision-Language-Action (VLA) 模型通常依赖离线数据集进行监督学习,难以通过真实世界的部署经验实现持续改进。虽然强化学习理论上可以实现在线优化,但传统 RL 算法(如 PPO)在大规模流匹配(flow-matching)动作模型上难以计算梯度和对数似然,限制了其在真实机器人系统中的应用。

核心结果/发现

与基线 π₀.₆ 的性能对比:

- 任务吞吐量: 在多样化的洗衣和咖啡任务上提升超过 2 倍

- 失败率: 在困难任务上降低约 50%(降低约 2 倍)

- 成功率: 经过单次迭代后,大多数任务达到 90%+ 成功率

真实部署验证:

- 在真实家庭环境中折叠各种衣物,连续运行超过 2 小时

- 使用专业咖啡机制作浓缩咖啡,连续运行 13 小时

- 可靠地组装纸箱,展示精细操作能力

与其他 RL 算法对比:

- 相比 PPO 和 AWR (Advantage Weighted Regression) 等基线方法,优势条件化方法:

- 无需计算 flow-matching 模型的可微分对数似然

- 能够充分利用所有数据,包括次优轨迹

- 在大规模模型上训练效率更高

消融实验:

- 验证了 Knowledge Insulation 技术的有效性(端到端 RL 无需回传到动作专家)

- 证明了整合专家干预数据对性能提升的重要性

- 展示了多任务价值函数对跨任务泛化的贡献

实际部署统计:

- 论文展示了模型在无人监督情况下长时间稳定运行的能力

- 在复杂的真实世界环境中处理新颖物体(未见过的衣物款式等)

局限性

该方法目前仍依赖人类提供奖励标签(成功/失败判断)和场景重置,尚未实现完全自主的端到端 RL。探索策略依赖于策略的随机性和人类干预,而非主动探索机制。当前实现为迭代式离线更新而非完全在线的 RL,在大规模自主学习方面仍有提升空间。未来工作可以探索自动奖励标注、场景自动重置和更高效的探索策略。

Sources:

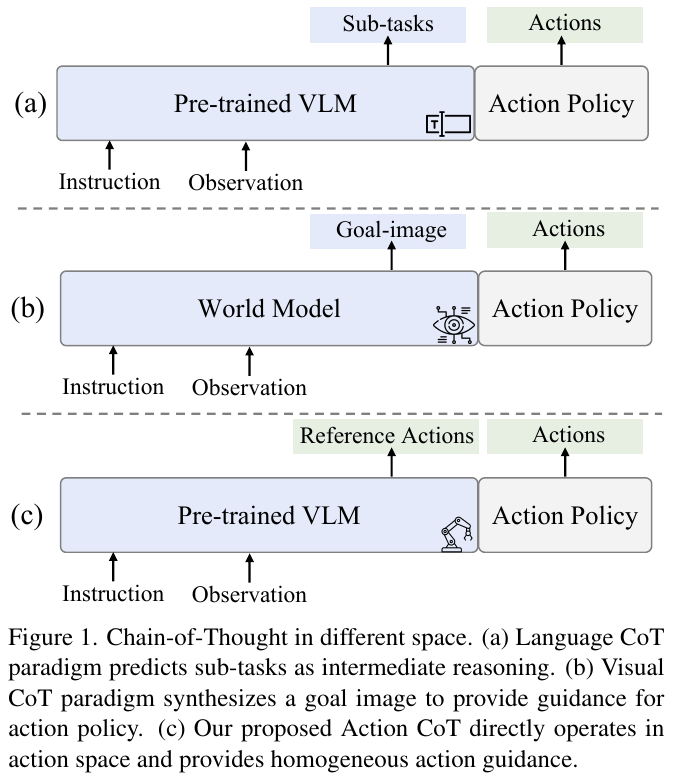

8.9 ACoT-VLA (2026) {#9-acot-vla-2026}

副标题: Action Chain-of-Thought for Vision-Language-Action Models 中文标题: 在动作空间中进行推理的视觉-语言-动作模型

📄 Paper: arXiv:2601.11404

精华 这篇论文的核心创新在于将推理过程从语言/视觉空间转移到动作空间,值得借鉴的点包括:(1) 直接在动作空间进行推理,提供同质化的运动指导,弥合语义与运动学之间的鸿沟;(2) 显式推理器(EAR)与隐式推理器(IAR)的互补设计,同时提供轨迹级和语义级指导;(3) Teacher Forcing稳定化训练策略,避免推理模块对动作头的优化干扰;(4) 通过action-level guidance大幅提升长时域任务的鲁棒性和误差抗累积能力。 不同CoT范式对比:

| 范式 | 中间表示 | 优势 | 局限 |

|---|---|---|---|

| (a) 语言CoT | 子任务描述 | 可解释性强 | 语义-动作鸿沟大 |

| (b) 视觉CoT | 目标图像 | 视觉直观 | 缺少运动学信息 |

| (c) 动作CoT(本文) | 粗粒度动作轨迹 | 同质化指导,直接可执行 | 需要额外推理模块 |

研究背景/问题 现有VLA模型主要在视觉-语言空间进行推理(如语言CoT预测子任务、视觉CoT合成目标图像),但这些推理形式对动作执行的指导是间接且次优的。VLM预训练主要聚焦语义理解而非物理动力学,世界模型虽能预测未来视觉状态但仍局限于视觉表征,两者都存在语义-运动学鸿沟(semantic-kinematic gap),难以为精确的低层动作生成提供充分的细粒度指导。

主要方法/创新点

本文提出 Action Chain-of-Thought (ACoT) 范式,将推理过程重新定义为结构化的动作意图序列,直接在动作空间进行deliberation。ACoT-VLA框架包含三个核心组件:

ACoT-VLA整体架构(三大核心模块):

VLM特征 ────┬─→ EAR (Explicit Action Reasoner)

│ ↓ 粗粒度参考轨迹 Z^ex

│

noisy action├─→ IAR (Implicit Action Reasoner)

│ ↓ 隐式动作先验 Z^im

│

└─→ AGP (Action-Guided Prediction)

↓ 融合显式+隐式指导

最终动作预测

详细架构图见ACoT-VLA论文Figure 2

1. Explicit Action Reasoner (EAR)

- 设计为轻量级Transformer,以noisy action sequence作为输入

- 通过self-attention捕获时序依赖,cross-attention从VLM的key-value cache注入多模态上下文

- 采用flow matching训练,自主生成粗粒度参考轨迹 $a^{ref}_{t:t+H^{ref}-1}$

- 参考轨迹编码后形成显式动作空间指导 $Z^{ex}$

2. Implicit Action Reasoner (IAR)

- 直接操作VLM的key-value cache,提取隐式运动线索

- 对每层VLM特征,使用可学习query矩阵 $Q_i$ 通过cross-attention提取动作相关信息

- 下采样策略降低计算开销:将KV cache降维至 $d’ \ll d$

- 跨层聚合后形成隐式动作指导 $Z^{im}$,捕获visual affordances和action semantics

3. Action-Guided Prediction (AGP)

- 将noisy action embedding视为query $Q_{action}$,与 $Z^{ex}$ 和 $Z^{im}$ 进行dual cross-attention

- 通过self-attention融合显式与隐式指导:$\bar{h} = \text{Self-Attn}([S^{ex}; S^{im}])$

- 最终action head $\pi^{head}_\theta$ 基于聚合表征预测去噪动作序列

训练策略:

- Flow matching损失同时优化EAR和action head

- Teacher Forcing稳定化:训练时 $Z^{ex}$ 直接从ground-truth轨迹计算,推理时切换为自条件模式

核心结果/发现

仿真实验:

- LIBERO: 98.5%平均成功率(SOTA),相比π0.5提升1.6%,在LIBERO-Long(长时域)提升最显著(96.0% vs 92.4%)

- LIBERO-Plus: 84.1%,在鲁棒性测试中大幅超越,尤其在相机视角变化(+11.6%)、机器人初始状态扰动(+16.3%)、传感器噪声(+12.5%)上表现突出

- VLABench: Intention Score 63.5%、Progress Score 47.4%,在unseen-texture track上获得+12.6% IS和+7.2% PS的显著提升

真实世界部署:

- 在AgiBot G1机器人上平均成功率66.7%(vs π0.5的61.0%、π0的33.8%)

- 跨embodiment验证:在AgileX平台上同样有效,证明方法的通用性

真实世界实验:在AgiBot G1机器人上评估三项操作任务

| 任务 | 描述 | ACoT-VLA | π₀.5 | π₀ |

|---|---|---|---|---|

| 擦拭污渍 | 检测并擦除桌面污渍 | 70.0% | 65.0% | 38.0% |

| 倒水 | 抓取水瓶倒入杯中 | 66.7% | 60.0% | 32.0% |

| 开放集抓取 | 根据指令抓取未见物体 | 63.3% | 58.0% | 31.5% |

| 平均成功率 | - | 66.7% | 61.0% | 33.8% |

关键发现:ACoT-VLA在跨具身平台(AgiBot G1、AgileX)上均表现优异,证明动作空间推理的通用性。

消融研究关键发现:

- EAR单独使用提升1.4%(LIBERO),IAR单独提升1.2%

- EAR+IAR联合使用达到最优,证明显式与隐式指导的互补性

- 参考动作horizon在15-30时效果最佳,过长或过短均不利

- EAR参数量在300M时性能最优,过度参数化反而导致过拟合

- 推理延迟仅增加约20ms(91ms→112ms),性能-效率权衡优秀

局限性 该方法需要额外的推理模块,虽然计算开销相对较小但在资源受限平台上可能存在挑战。此外,当前动作表征仍采用action chunks(关节角度/末端执行器位姿),缺乏显式几何结构,未来可将动作表征扩展至几何可解释的3D空间,进一步释放ACoT的推理潜力。

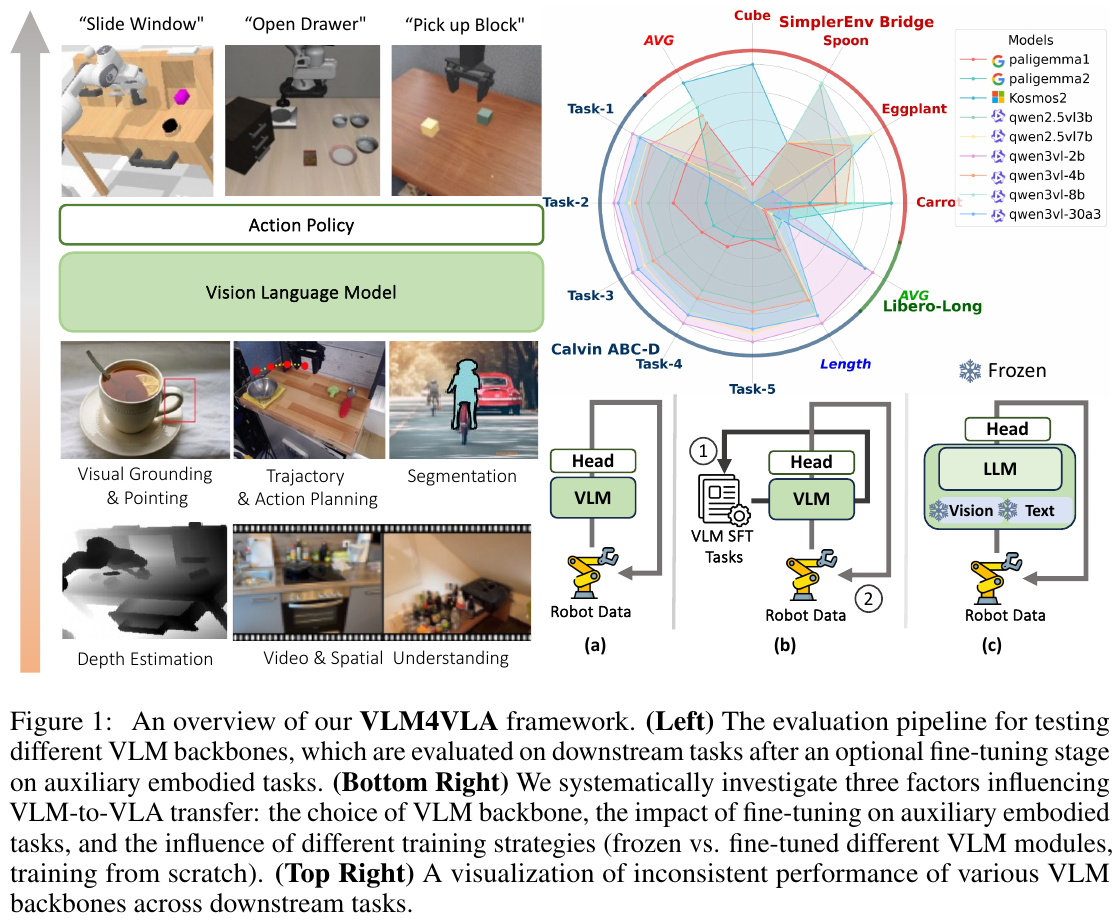

8.10 VLM4VLA (2026) {#10-vlm4vla-2026}

副标题: Revisiting Vision-Language Models in Vision-Language-Action Models 中文标题: 重新审视视觉-语言-动作模型中的视觉-语言模型

📄 Paper: arXiv:2601.03309

精华

这篇论文最值得借鉴的核心思想包括:通过最小化适配管道公平评估不同 VLM 对下游任务性能的影响;发现 VLM 的通用能力与具身控制性能并不强相关,挑战了常见假设;识别出视觉编码器(而非语言组件)是性能瓶颈,揭示了 VLM 预训练目标与具身动作规划需求之间存在领域差距;提出通过向视觉编码器注入控制相关监督信号可获得持续性能提升的策略。

研究背景/问题

当前 Vision-Language-Action (VLA) 模型研究主要关注网络架构、训练范式和动作解码方案的改进,但很少系统研究一个核心问题:底层 Vision-Language Model (VLM) 的选择和能力如何影响 VLA 策略的性能。现有工作缺乏公平的实验框架来评估不同 VLM 对下游机器人任务性能的贡献。

主要方法/创新点

论文提出了 VLM4VLA 框架,这是一个最小化适配管道,通过引入少于 1% 的新参数将通用 VLM 转换为 VLA 策略,确保公平高效的比较。

VLM4VLA 框架概览:最小化适配管道,公平评估不同VLM对VLA性能的影响

评估流程:

- VLM骨干网络选择(Qwen2.5VL、Paligemma、Kosmos-2等9种)

- 可选辅助具身任务微调(visual pointing、depth estimation等)

- 下游控制任务评估(Calvin、SimplerEnv、Libero)

- 系统性分析(通用能力相关性、模态级消融、训练策略影响)

核心架构设计:

VLM4VLA 网络架构:

图像 + 语言指令

↓

[VLM Encoder] (冻结或微调)

↓

Action Query Token (可学习,<1%参数)

↓

[MLP Policy Head] (L1/L2 loss,非扩散)

↓

动作块输出

设计原则:最小化新增参数(<1%),使用简单MLP而非diffusion,确保公平比较。

- 引入可学习的 Action Query token 从 VLM 中提取具身相关知识

- 使用简单的 MLP-based policy head 解码动作,避免 diffusion/flow-matching 引入的随机性

- 采用 L1/L2 loss 而非 diffusion loss,提高推理稳定性和评估鲁棒性

- 所有 VLM 参数(vision encoder、LLM、word embeddings)在下游任务微调时全部训练

三维实验设计:

- 通用能力评估: 比较 9 个开源 VLM(1B-30B 参数)作为 VLA 骨干网络的性能,包括 Qwen2.5VL/Qwen3VL 系列、Paligemma 系列、Kosmos-2

- 具身特定能力评估: 使用 7 种辅助具身任务(visual grounding、depth estimation、trajectory prediction 等)微调 VLM,测试对下游控制任务的影响

- 模态级消融: 独立冻结/微调视觉和语言编码器,并测试向 vision encoder 注入控制相关信息(FAST tokenizer)的效果

评估基准: 在三个模拟环境上测试

- Calvin ABC-D: 训练于 ABC 场景,测试于 D 场景(跨场景泛化)

- SimplerEnv-Bridge: 训练于真实 BridgeV2 数据,测试于仿真环境

- Libero-Long: 10 个长视距操作任务

核心发现:

核心发现:VLM通用能力与VLA性能的相关性分析

| 评测基准 | VLM能力相关系数 | 结论 |

|---|---|---|

| Calvin ABC-D | r = 0.839 (强正相关) | VLM通用能力对跨场景泛化有帮助 |

| SimplerEnv-Bridge | r ≈ 0 (无相关) | VLM通用能力无法预测控制性能 |

| Libero-Long | r ≈ 0 (无相关) | VLM通用能力无法预测控制性能 |

启示:VLM预训练是必要但不充分的,通用VQA能力不等同于具身控制能力。

- VLM 通用能力是必要但不充分的: VLM 初始化相比从头训练提供一致性收益,但 VLM 的通用 VQA 能力无法预测其在具身控制任务上的表现

- 辅助具身任务微调效果有限: 在 visual pointing、spatial understanding、embodied VQA 等任务上微调 VLM 并未提升下游控制性能,甚至略有下降

辅助具身任务微调效果:令人意外的发现

| 辅助任务 | 理论预期 | 实际效果 |

|---|---|---|

| Visual Pointing | ✅ 应该提升空间理解 | ❌ 性能略降 |

| Depth Estimation | ✅ 应该增强3D感知 | ❌ 性能略降 |

| Trajectory Prediction | ✅ 应该改善动作规划 | ❌ 性能略降 |

| Embodied VQA | ✅ 应该强化具身理解 | ❌ 性能略降 |

结论:辅助具身任务微调未能提升下游控制性能,甚至略有负面影响。这挑战了”具身预训练有益”的常见假设。

- Vision encoder 是关键瓶颈: 冻结视觉编码器导致显著性能下降(Calvin 上下降 1.0-3.0 分),而冻结 word embeddings 几乎无影响

- 存在视觉-语言理解与低级控制的语义差距: 通过向 vision encoder 注入动作 token 预测任务,即使冻结 encoder 也能获得 +18.1% 性能提升,证明 VLM 视觉特征与控制需求存在根本性不对齐

VLM与VLA训练轨迹分歧:

参数空间

VLM任务最优区域 ←──────┐

│ 分歧点

共同起点 ──→ ○ ────┘

│

VLA任务最优区域 ←──────┘

关键洞察:

- VLM和VLA训练初期沿相同方向学习(共享视觉-语言理解)

- 但在某个时间点产生分歧,走向不同的最优区域

- 这解释了为何冻结vision encoder会导致性能下降

- 视觉-语言理解与低级控制存在本质差异

核心结果/发现

- Calvin ABC-D: Qwen3VL-2B 达到最佳性能(平均完成 4.142 个任务),接近 SOTA VLA(pi0: 3.509)

- SimplerEnv-Bridge: 最小的 Kosmos-2 (1.7B) 达到最高成功率(60.4%),超越更大的 Qwen 系列模型

- Libero-Long: Qwen3VL-2B 和 Kosmos-2 均达到 55%+ 成功率,优于其他 VLM

- 从头训练性能崩溃: 不使用 VLM 预训练的模型性能下降 60-70%,证明 VLM 预训练对 VLA 泛化至关重要

- Real-to-Sim 差距非主因: 在真实图像上微调 VLM 的动作预测任务后,冻结 vision encoder 仍导致性能下降,表明问题源于视觉-语言任务与低级控制任务的本质差异

- Vision encoder 微调必要性: 在 SimplerEnv-Bridge 任务上,解冻 vision encoder 并注入控制信息使性能从 27.6% 提升至 45.7%(+18.1%)

局限性

研究未在物理机器人上进行实验,主要受限于公平性和可重复性考虑。虽然分析表明 VLM-VLA 差距源于任务异质性而非简单的 sim-to-real 差距,但真实世界部署仍是最终目标。论文的全面模拟基准结果可为未来研究提供有价值的参考。

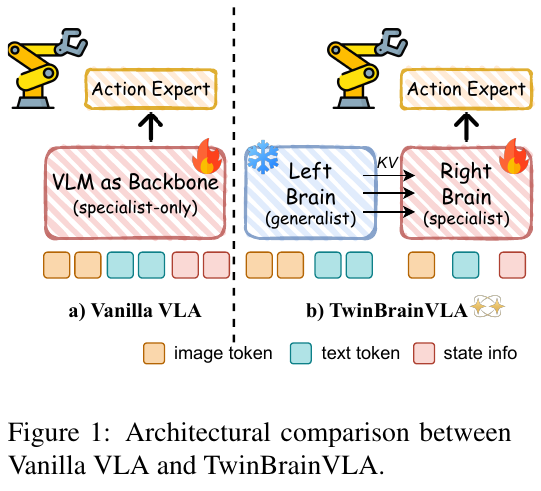

8.11 TwinBrainVLA (2026) {#11-twinbrain-vla-2026}

副标题: Unleashing VLM Potential in Embodied Tasks via Asymmetric Dual-Transformer Mixture 中文标题: 通过非对称双Transformer混合机制释放通用VLM在具身任务中的潜力

📄 Paper: arXiv:2601.14133

精华

这篇论文展示了如何通过结构化解耦来解决VLA模型中的灾难性遗忘问题,值得借鉴的核心思想包括:利用双流架构分离高层语义理解和低层运动控制、通过冻结”通才”分支保留预训练知识同时训练”专才”分支学习具身技能、采用非对称注意力机制实现知识迁移而不破坏原始能力、使用Flow-Matching生成连续动作而非离散token化。这种”左右脑”设计哲学为构建既有认知能力又有物理灵巧性的通用机器人提供了新范式。

研究背景/问题

当前的Vision-Language-Action (VLA)模型通常直接对预训练的Vision-Language Model (VLM)进行机器人控制任务的微调。然而,这种方法在维持高层语义理解和学习低层精细运动技能之间存在根本性冲突,导致”灾难性遗忘” (catastrophic forgetting)——模型为适应机器人操作而牺牲了原有的开放世界语言能力和视觉推理能力。

主要方法/创新点

Vanilla VLA与TwinBrainVLA架构对比:

| 架构 | VLM使用 | 灾难性遗忘 | 本体感知 | 性能 |

|---|---|---|---|---|

| Vanilla VLA | 单一VLM微调 | ✅ 严重 | ❌ 有限 | ⚠️ 中等 |

| TwinBrainVLA | 双VLM(冻结+可训练) | ❌ 避免 | ✅ 专门编码 | ✅ 优异 |

论文提出了 TwinBrainVLA,一个受大脑半球侧化 (hemispheric lateralization) 启发的双流VLA架构,通过协调”通才VLM”和”具身专才VLM”来实现联合机器人控制:

1. 非对称双VLM骨干网络 (Asymmetric Dual-VLM Backbone)

-

Left Brain (左脑 - 通才): 冻结的预训练VLM,保留开放世界知识和指令跟随能力。输入仅包含视觉和语言token:

H⁰_L = [V(I); T(T)] -

Right Brain (右脑 - 专才): 可训练的VLM,专门用于具身运动控制。输入融合视觉、语言和本体感受状态信息: