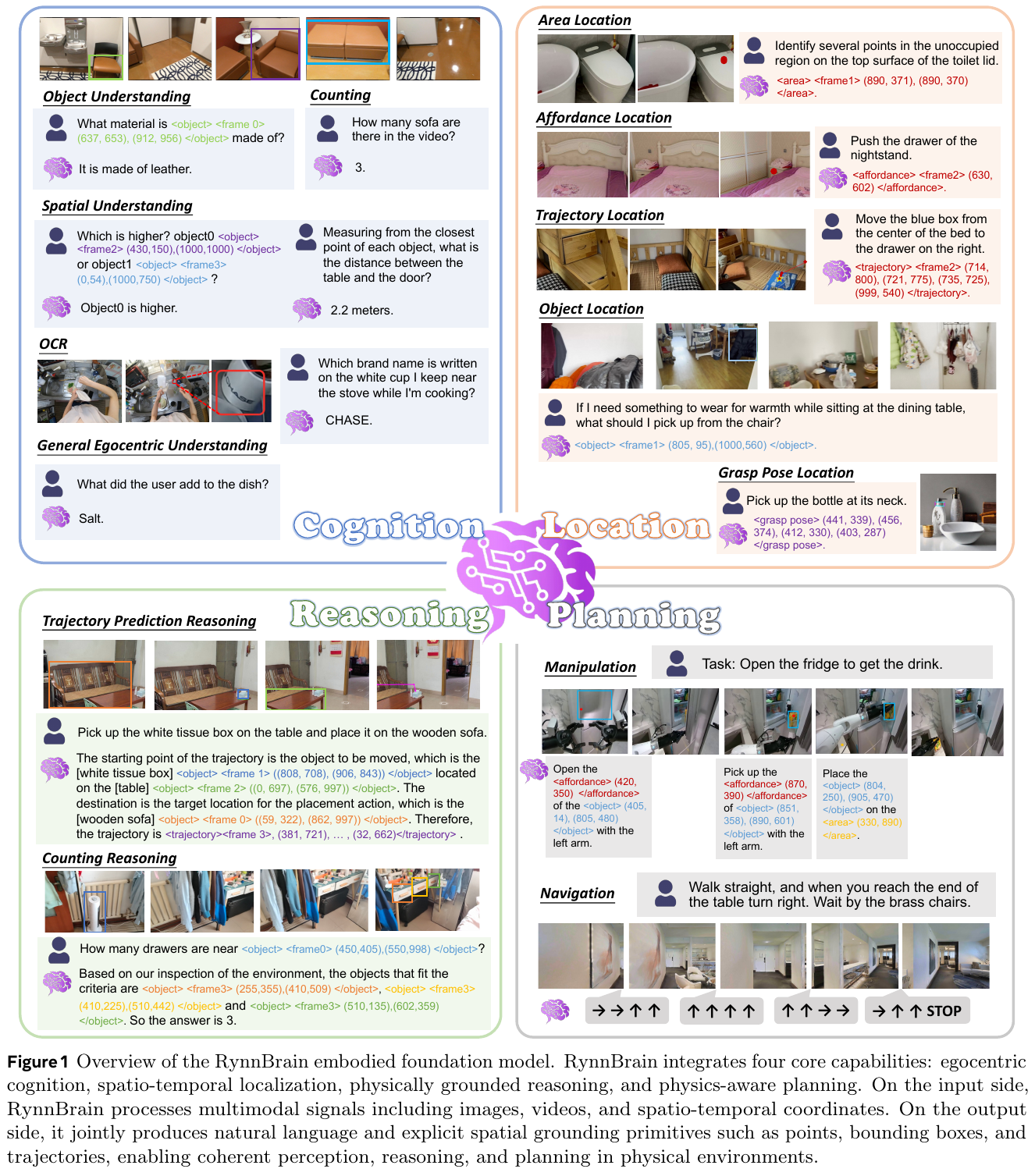

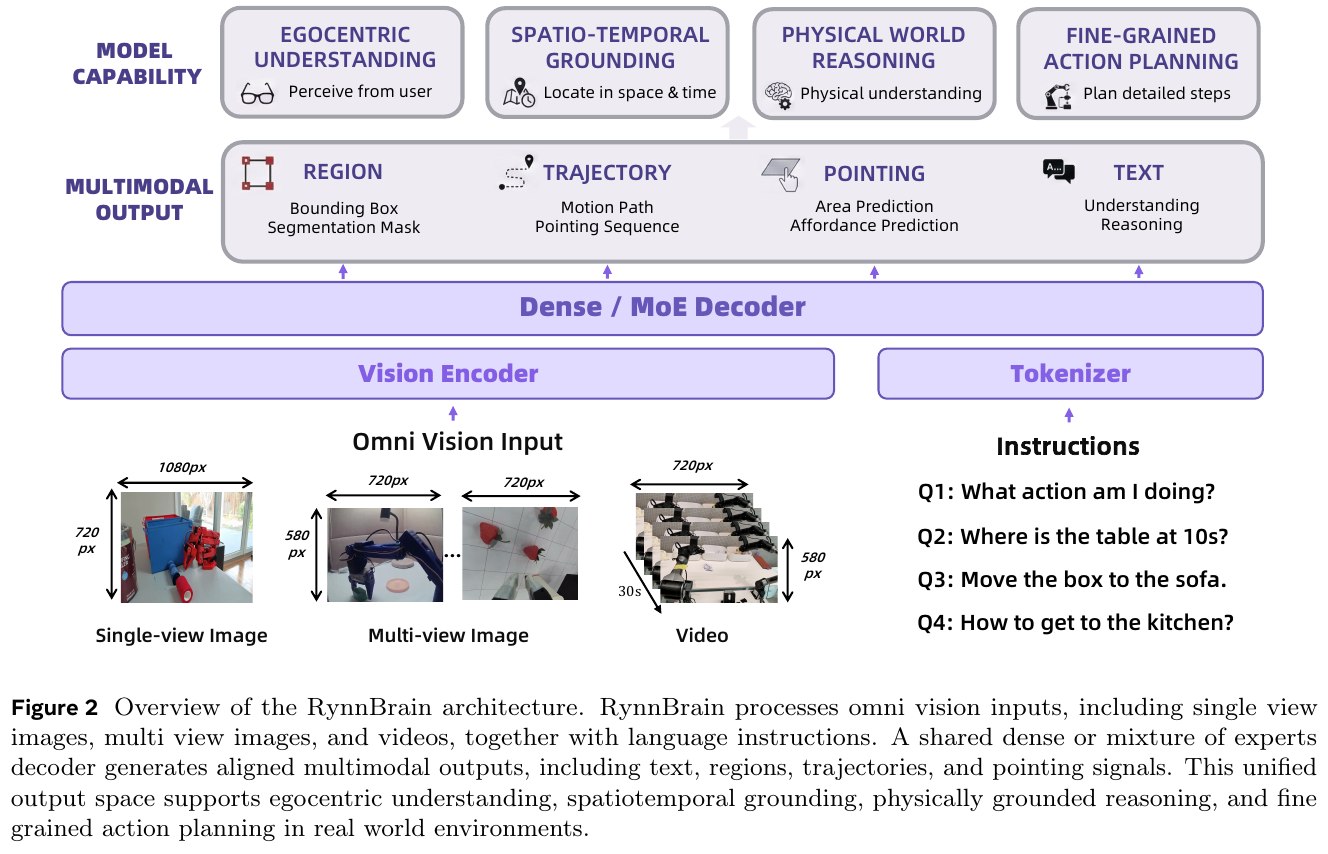

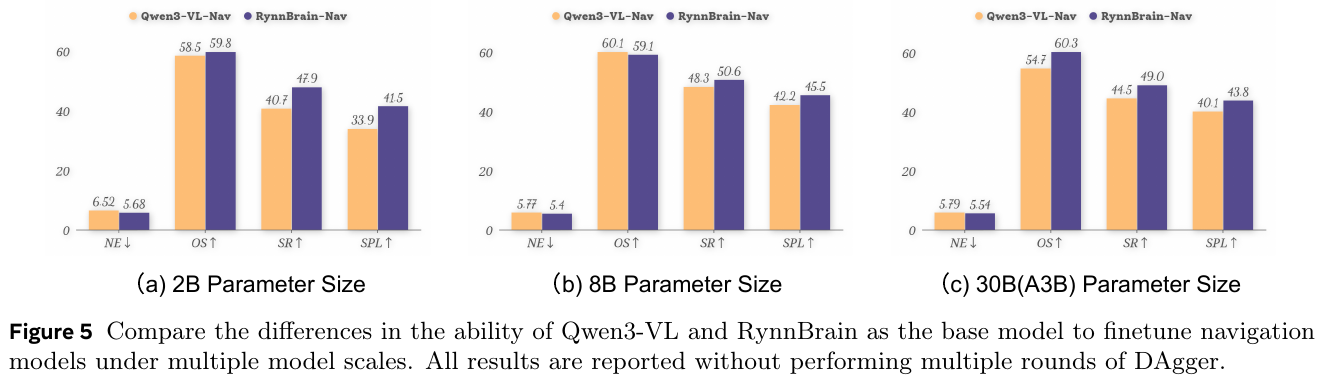

本文是 VLN综述:基于视觉语言的导航 的配套论文精读,收录 VLN 经典论文与依赖基础工作。

VLN经典论文

1. DualVLN/InternVLN (2025)

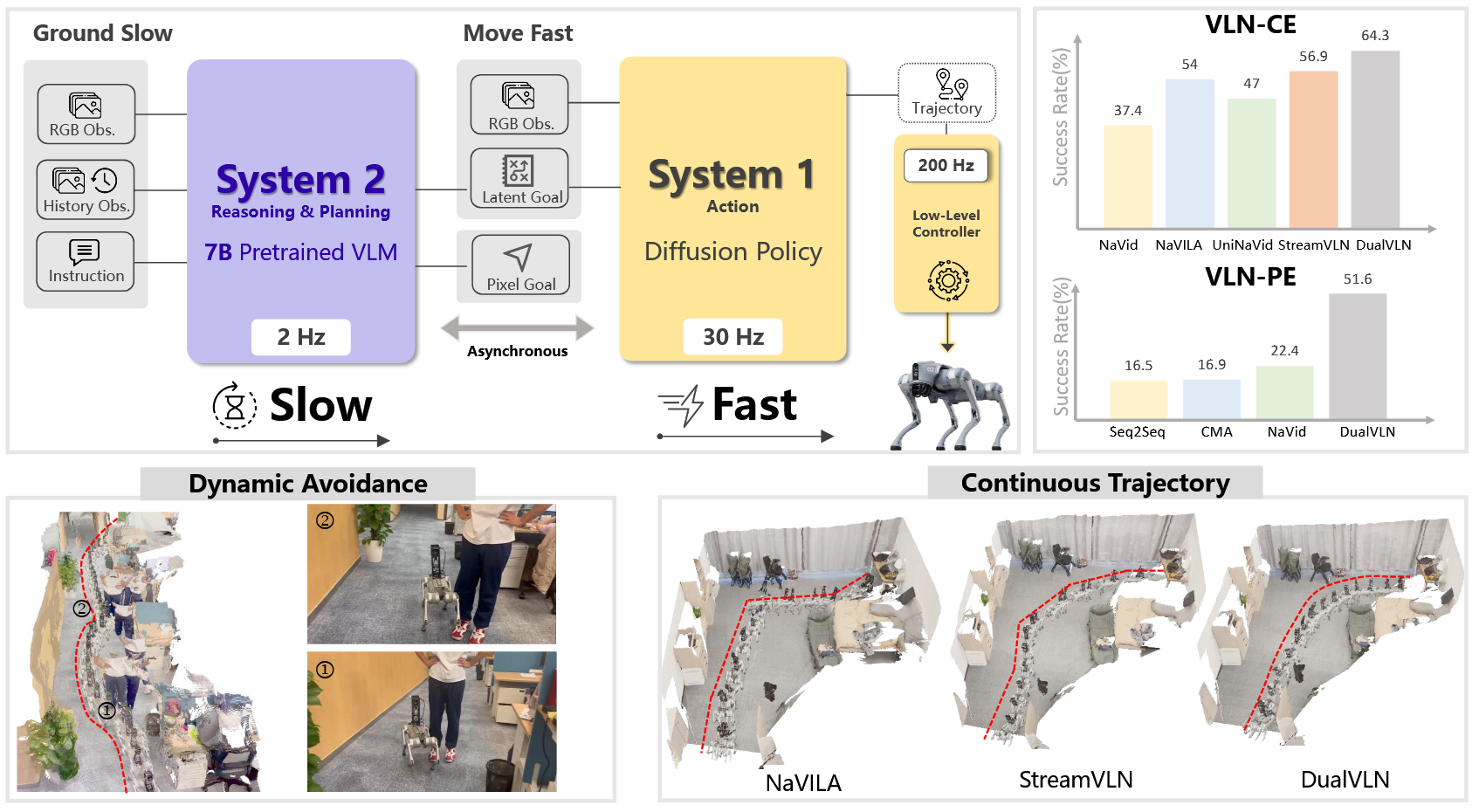

——Ground Slow, Move Fast

📄 Paper: arXiv:2512.08186

研究背景/问题

VLN领域存在基本矛盾:强大的推理能力需要”慢思考”,而流畅的导航行动需要”快反应”。传统端到端模型存在三大瓶颈:

- 动作碎片化:每一步都需调用大模型,产生离散的短视野动作(如”前进0.25m”)

- 响应延迟高:无法实现高频控制(30Hz+),导致运动不自然

- 缺乏层次协调:语义理解、全局规划和局部避障耦合在一起,难以应对动态障碍物

主要方法/创新点

DualVLN提出首个双系统VLN基础模型,将高级语义理解与低级轨迹执行解耦,形成互补的快慢系统:

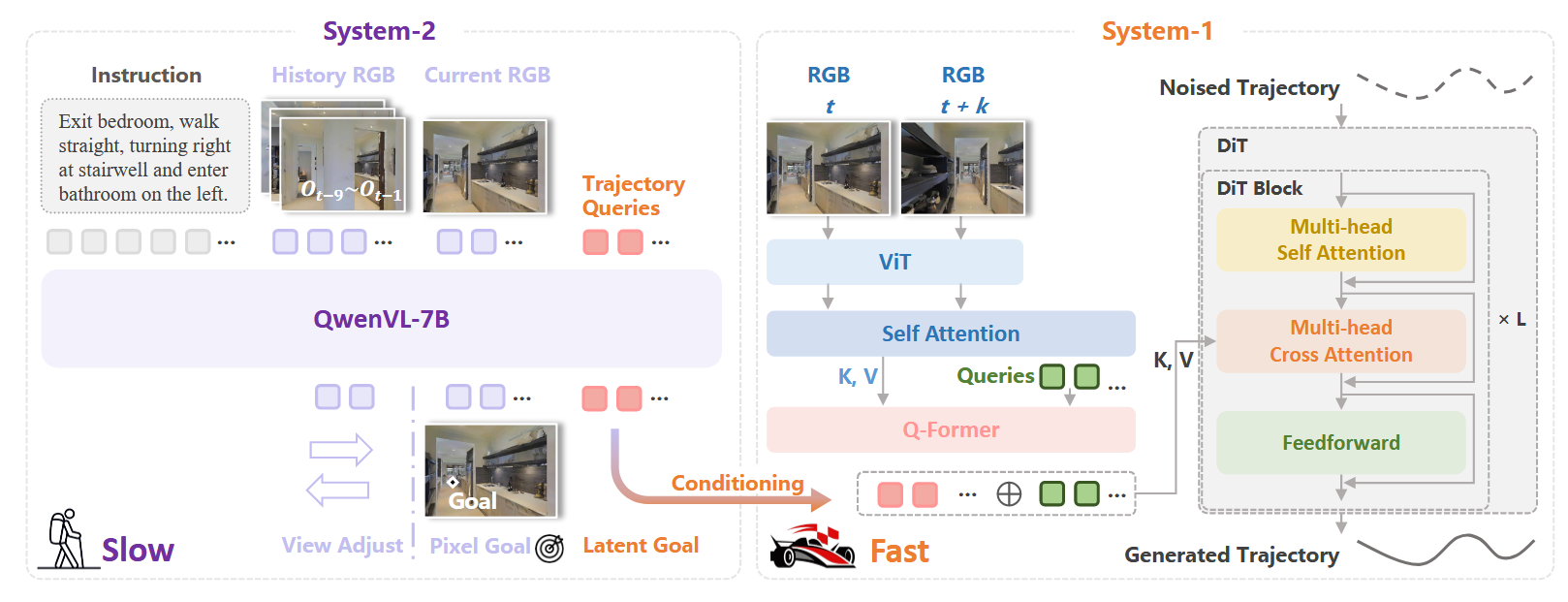

系统2(慢思考的”大脑”)

核心功能:

- 全局规划器:基于Qwen-VL-2.5(7B参数),以约2 Hz频率运行

- 像素级目标预测:将3D导航任务转化为2D像素级目标定位问题

- 自动生成训练数据:

- 通过3D→2D投影,将未来轨迹点投影到当前视角

- 利用深度图过滤遮挡点(距离>深度值的点被视为不可见)

- 选择最远可见点作为”像素目标”(farthest pixel goal)

- 智能视角调整:

- 当未来轨迹无法投影到当前视角时(如连续转弯动作的起点)

- 自主预测视角调整动作(Turn Left/Right 15°, Look Up/Down 15°)

- 最多支持4次连续视角调整,模仿人类”环顾四周、低头看路”的行为

训练策略:

- 完全解冻视觉编码器和LLM骨干网络,进行一个epoch的全量微调

- 使用StreamVLN的数据配方(多源VLN数据集)

- 优化器:AdamW,学习率2e-5,批量大小128,训练14,000步

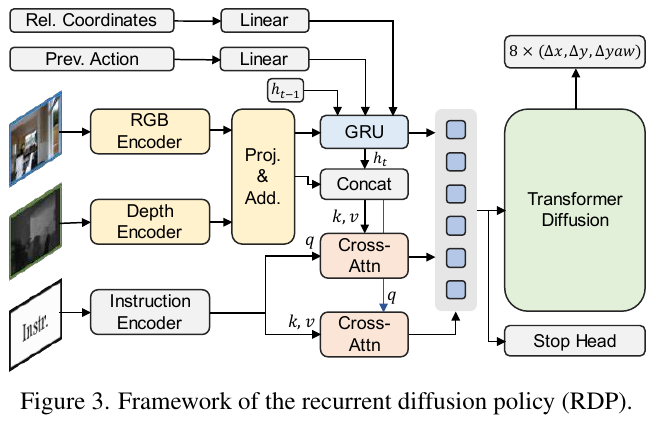

系统1(快行动的”小脑”)

核心功能:

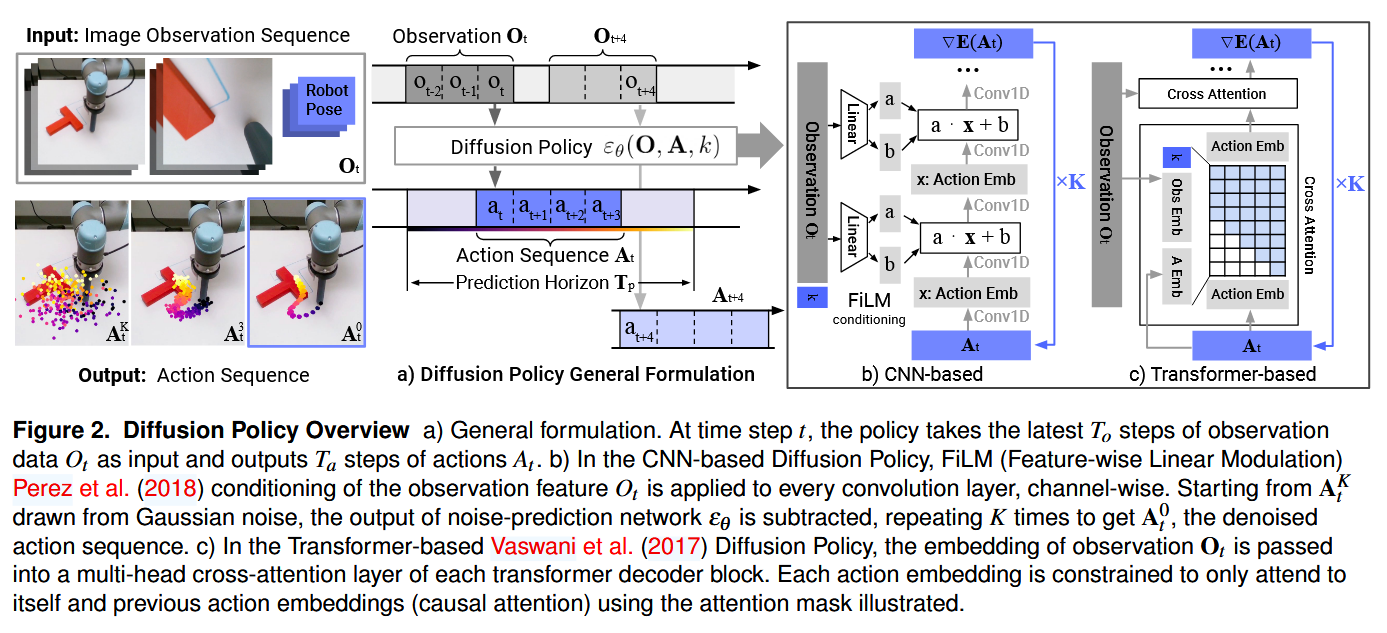

- 高频轨迹生成:轻量级扩散Transformer策略,以30 Hz频率运行

- 多模态条件扩散:

- 显式像素目标:提供可解释的空间引导

- 隐式潜在目标:从系统2的隐藏状态中提取丰富的任务相关语义

- 语义特征提取:

- 在像素目标文本后追加4个可学习的特殊token

<TRAJ> - 通过prompt tuning优化这些潜在查询向量

- 从冻结的VLM最后一层隐藏状态中提取紧凑特征

- 在像素目标文本后追加4个可学习的特殊token

- 双时间步RGB融合:

- 编码系统2最后一帧(时间t)和当前帧(时间t+k)

- 通过自注意力融合两个时间步的ViT特征

- 用Q-Former压缩为32个token,作为高频视觉条件

- Flow Matching训练:

- 噪声轨迹:$X_u = \alpha_u X_0 + \sigma_u \epsilon$

- 速度预测:$\hat{\dot{X}}u = f\theta(X_u, u, Z’ \oplus F)$

- 损失函数:$\mathcal{L}{flow} = \mathbb{E}{u,X_0,\epsilon}[|\hat{\dot{X}}_u - \dot{X}_u|_2^2]$

架构细节:

- RGB编码器:DepthAnythingV2-Small的ViT骨干

- DiT设计:隐藏维度384,12层Transformer,6个注意力头

- 潜在嵌入:从3584维线性投影到768维后进行交叉注意力

- 输出:32个密集路径点的平滑轨迹

训练策略:

- 冻结系统2(Qwen-VL),仅训练潜在查询和DiT策略

- 优化器:AdamW,学习率1e-4,批量大小128,训练15,000步

- 关键设计:仅使用像素目标grounding样本进行监督(不包含视角调整样本)

协同机制

异步推理流水线:

- 系统2(2Hz):每0.5秒生成新的像素目标和潜在特征

- 系统1(30Hz):每0.03秒基于最新RGB和缓存的潜在特征更新轨迹

- 低级控制器(200Hz):MPC控制器跟踪系统1生成的轨迹

- 关键优势:利用KV-cache复用,将系统2推理时间从1.1s降至0.7s;系统1用TensorRT并行生成32个轨迹点仅需0.03s

核心结果/发现

1. 仿真基准测试(VLN-CE)

R2R Val-Unseen(仅单视角RGB输入)

| 方法 | SR ↑ | SPL ↑ | NE ↓ | OS ↑ |

|---|---|---|---|---|

| StreamVLN(前SOTA) | 56.9% | 51.9% | 4.98m | 64.2% |

| DualVLN | 64.3% | 58.5% | 4.05m | 70.7% |

| 提升幅度 | +7.4% | +6.6% | -0.93m | +6.5% |

RxR Val-Unseen(多语言指令)

| 方法 | SR ↑ | SPL ↑ | NE ↓ | nDTW ↑ |

|---|---|---|---|---|

| NaVILA(前SOTA) | 49.3% | 44.0% | 6.77m | 58.8% |

| DualVLN | 61.4% | 51.8% | 4.58m | 70.0% |

| 提升幅度 | +12.1% | +7.8% | -2.19m | +11.2% |

关键观察:

- 在RxR基准上,DualVLN的优势更明显(+12.1% SR),说明双系统设计对复杂多语言指令有更好的泛化能力

- 与使用全景RGB+深度+里程计的多传感器方法(如ETPNav)相比,DualVLN仅用单视角RGB即达到更高的64.3% SR(ETPNav仅57.0%)

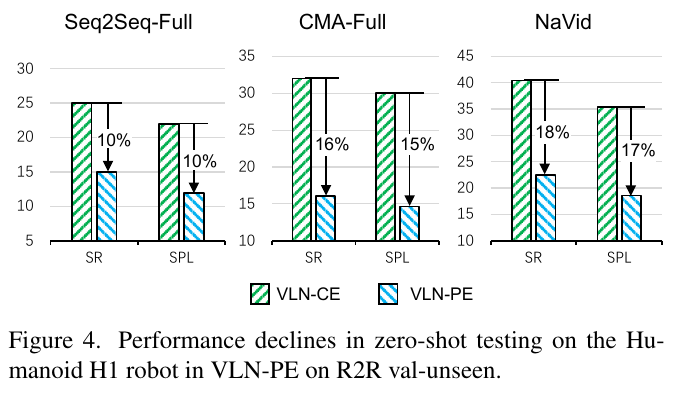

2. 物理仿真基准(VLN-PE)

R2R Val-Unseen(Humanoid H1机器人)

| 方法 | SR ↑ | SPL ↑ | NE ↓ | FR ↓ | StR ↓ |

|---|---|---|---|---|---|

| NaVid(零样本迁移) | 22.42% | 18.58% | 5.94m | 8.61% | 0.45% |

| RDP(在VLN-PE上训练) | 25.24% | 17.73% | 6.72m | 24.57% | 3.11% |

| DualVLN(零样本迁移) | 51.60% | 42.49% | 4.66m | 12.32% | 2.23% |

关键发现:

- 尽管DualVLN未在VLN-PE上微调,但仍大幅超越所有基线(包括在VLN-PE上训练的方法)

- 成功率提升超过2倍(51.60% vs 22.42%),证明双系统设计对物理真实环境有更强的泛化能力

- 跌倒率(FR)虽高于NaVid,但成功率显著提升,表明DualVLN在探索效率和安全性之间取得了更好的平衡

3. Social-VLN基准(动态障碍物)

新基准设计:

- 在R2R-CE基础上,沿ground-truth轨迹放置动态人形机器人(Habitat 3.0)

- 引入Human Collision Rate(HCR)指标,量化与行人的不安全交互

- 收集763K社交导航样本(60个MP3D场景),用改进的A*算法生成避障轨迹

性能对比(R2R Val-Unseen):

| 方法 | 静态VLN SR | Social-VLN SR | SR下降 | HCR |

|---|---|---|---|---|

| StreamVLN | 56.9% | 31.4% | -25.5% | 36.4% |

| DualVLN | 64.3% | 37.2% | -27.1% | 35.4% |

关键观察:

- 两种方法的成功率都大幅下降(~26%),说明Social-VLN极具挑战性

- DualVLN在动态场景中仍保持6%的绝对优势,HCR略低于StreamVLN

- 改进空间:尽管DualVLN表现最佳,但仍有很大提升空间(37.2% SR远低于静态场景的64.3%)

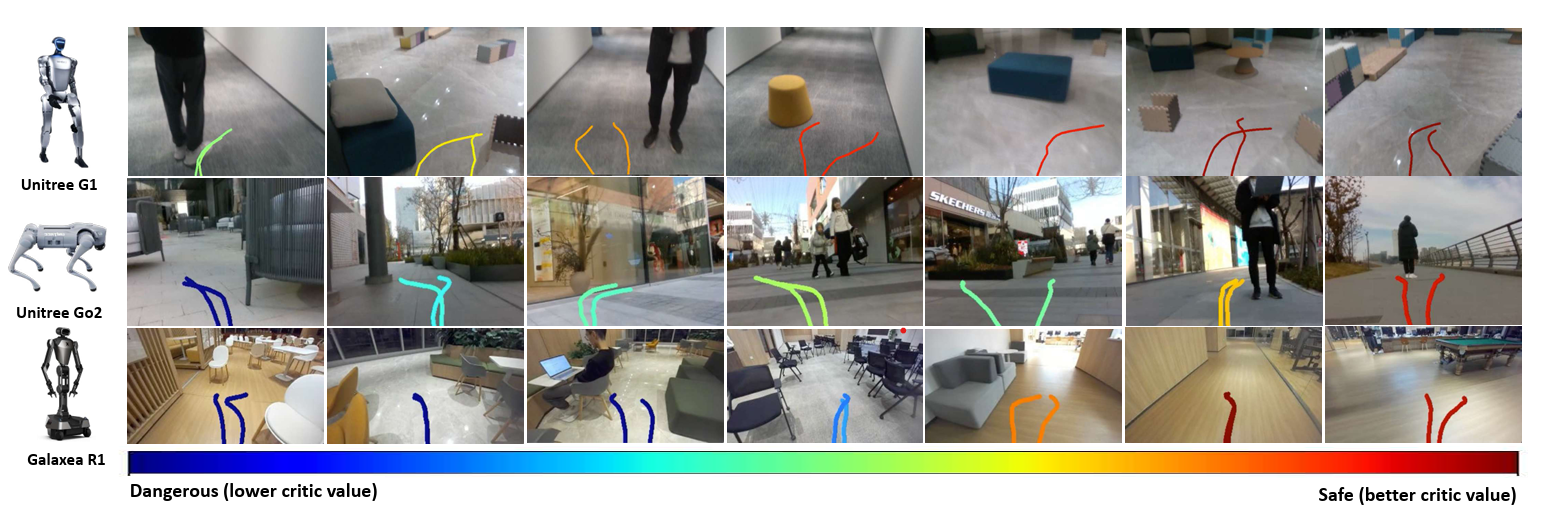

4. 真实世界跨具身实验

实验设置:

- 机器人平台:轮式(Turtlebot4)、四足(Unitree Go2)、人形(Unitree G1)

- 传感器配置:Intel RealSense D455(不同安装高度,下倾15°)

- 推理硬件:远程服务器(RTX 4090 GPU,占用20GB显存)

- 控制流程:机器人流式传输RGB-D图像 → 服务器异步推理 → MPC控制器跟踪轨迹

定量评估(3种场景难度):

- 走廊(简单):DualVLN SR 100% vs 基线25%-80%

- 单卧室(中等):DualVLN SR 100% vs 基线0%-70%

- R2R办公室(困难,跨房间):DualVLN SR 85% vs 基线0%-60%

导航误差对比:

| 场景 | CMA | NaVid | NaVILA | StreamVLN | DualVLN |

|---|---|---|---|---|---|

| 走廊 | 3.2m | 0.9m | 0.3m | 0.2m | 0.2m |

| 卧室 | 5.3m | 2.5m | 0.6m | 0.3m | 0.3m |

| 办公室 | 15.4m | 10.1m | 2.2m | 0.5m | 0.4m |

定性分析(见补充视频):

- 场景多样性:办公室、食堂、街道、便利店,零样本设置(无场景特定微调)

- 像素目标精准:准确选择安全、可达的像素目标

- 轨迹流畅性:生成平滑、避障的连续轨迹,避免频繁停止或转向

- 地形适应性:成功处理楼梯、斜坡、门槛等复杂地形

- 动态避障:实时躲避行走的行人,保持任务轨迹

- 跨平台鲁棒性:在不同相机高度、振动、跟踪精度下表现稳定

5. 消融实验

5.1 目标表征的作用

实验设计(R2R Val-Unseen):

- w/o Sys.2 Train:系统1和系统2联合端到端训练,不使用显式像素目标

- w/o Pixel Goal:训练系统1时,移除像素目标文本(潜在查询无法关注显式目标)

- w/o Latent Goal:仅使用冻结VLM的像素目标文本的最后一层隐藏状态

结果对比:

| 配置 | SR | SPL | OS | NE |

|---|---|---|---|---|

| DualVLN(完整) | 64.3% | 58.5% | 70.7% | 4.05m |

| w/o Sys.2 Train | 55.2% | 51.5% | 60.9% | 4.98m |

| w/o Pixel Goal | 62.2% | 55.8% | 68.0% | 4.22m |

| w/o Latent Goal | 60.9% | 55.1% | 67.7% | 4.26m |

关键发现:

- 解耦训练至关重要(w/o Sys.2 Train -9.1% SR):

- 联合训练导致扩散策略收敛缓慢

- 系统2的泛化能力严重退化

- 证明了显式像素目标作为中间监督的必要性

- 显式像素目标增强可解释性(w/o Pixel Goal -2.1% SR):

- 为扩散策略提供明确的空间引导

- 提升系统2的可解释性和泛化能力

- 仅依赖隐式特征会损失部分性能

- 隐式潜在目标提供丰富语义(w/o Latent Goal -3.4% SR):

- 被动使用固定VLM特征限制了信息流

- 可学习的潜在查询能主动提取任务相关表征

- 两种目标表征互补,缺一不可

5.2 与SOTA点目标导航策略对比

实验设计(VLN-PE R2R Val-Unseen):

- 移除隐式潜在目标,将显式像素目标转换为点目标(使用额外深度信息)

- 用SOTA点目标导航策略替换系统1:

- iPlanner:命令式路径规划(Yang et al., 2023)

- NavDP:导航扩散策略(Cai et al., 2025)

结果对比:

| 局部规划器 | SR | SPL | NE | OS |

|---|---|---|---|---|

| iPlanner | 47.07% | 41.09% | 4.91m | 55.53% |

| NavDP | 58.72% | 50.98% | 4.22m | 67.33% |

| System 1(完整) | 63.62% | 56.49% | 3.90m | 69.93% |

性能差距分析:

- 轨迹分布不匹配:

- 点目标规划器生成的轨迹与系统2训练数据分布不同

- 导致系统2的像素目标预测质量下降

- 像素目标误差的鲁棒性差异:

- 系统1:对方向正确但位置偏差的像素目标具有鲁棒性,能通过实时RGB修正轨迹

- 点目标方法:直接将像素投影到世界坐标,对微小像素误差高度敏感

- 特例:当像素目标语义错误(如目标在障碍物上)或机器人靠近障碍物时,系统1的鲁棒性也会失效

- 避障能力:

- 系统1展现出强大的视觉避障行为(基于高频RGB输入)

- 点目标方法更依赖精确的几何信息,对传感器噪声更敏感

5.3 系统1的数据缩放规律

实验设计:

- 使用系统2轨迹数据的不同比例训练系统1:1%, 5%, 10%, 30%, 50%

- 评估SR和SPL在R2R Val-Unseen上的变化

结果曲线:

- 1%:SR ~54%, SPL ~54%(已具备竞争力)

- 10%:SR ~62%, SPL ~58%(接近饱和)

- 50%:SR ~64%, SPL ~58.5%(边际收益递减)

关键洞察:

- 系统1是轻量级的:

- 设计为快速、简单的轨迹生成器

- 目标跟踪任务本质上比语义理解简单

- 与系统2的数据缩放对比:

- 系统2遵循VLM的数据饥饿特性(更多多样化数据→更好泛化)

- 系统1快速饱和,表明其性能上限取决于系统2的质量

- 训练效率:

- 仅需系统2数据的10%即可训练出高性能系统1

- 进一步证明了解耦训练的优势

5.4 像素目标与轨迹的一致性分析

实验设计:

- 随机采样1000个样本,来自不同成功率的DualVLN模型(64.3%, 60.9%, 58.2%, 56.8%)

- 将预测轨迹投影到图像平面,计算与像素目标的:

- 像素距离:投影轨迹点到像素目标的欧氏距离

- 角度偏差:轨迹方向与像素目标方向的夹角

可视化结果(见Figure 10):

- 密度集中在左下角:大多数点的像素距离和角度偏差都很小

- 趋势一致:所有成功率模型都显示轨迹朝向像素目标并到达其附近区域

- 性能相关性:成功率越高的模型,密度集中度越高(轨迹-目标一致性越强)

结论:

- 系统1的轨迹预测强烈受像素目标引导

- 验证了双系统设计的有效性:系统2提供明确目标,系统1忠实执行

6. 注意力机制分析

可视化方法(见Supplementary Material Figure 11):

- 提取Qwen-VL不同层(第6、15、24层)的注意力图

- 关注两个模态:语言指令token 和 视觉token(历史帧+当前观察)

层级分析:

- 浅层(Layer 6):

- 注意力分散在整个场景和指令的多个词汇

- 关注通用的上下文和空间线索(如物体、场景布局、方向词)

- 中层(Layer 15):

- 注意力开始聚焦到目标相关区域

- 指令中的关键词(如”table”, “bridge”)获得更高权重

- 深层(Layer 24):

- 注意力高度集中在精确的像素目标区域

- 同时对STOP token分配显著权重(用于任务完成判断)

- 证明模型在最后阶段整合视觉和语言线索进行最终决策

关键发现:

- 逐层精化:从广泛的语义理解 → 逐步精确的空间定位

- 多模态融合:深层同时关注视觉目标和语言指令(特别是STOP信号)

- 任务完成感知:模型能自主判断何时到达目标(通过STOP token的注意力)

7. 推理效率分析

系统2优化:

- KV-cache复用:将轨迹token推理时间从1.1s降至0.7s(提速36%)

- 视角调整缓存:连续视角调整时重用已编码的历史图像特征

系统1优化:

- TensorRT加速:并行生成32个轨迹点仅需0.03s

- 异步推理:系统1持续运行在30Hz,不等待系统2更新

端到端延迟:

- 系统2更新周期:0.5s(2Hz)

- 系统1更新周期:0.033s(30Hz)

- 控制器频率:200Hz(MPC跟踪)

- 实际效果:机器人始终有最新轨迹可用,实现近实时、流畅的导航

局限性与未来方向

- 极端扰动鲁棒性:

- 在强烈相机抖动、光照剧变、遮挡等极端情况下性能下降

- 未来可引入更鲁棒的视觉编码器(如事件相机、多模态传感器融合)

- Sim-to-Real迁移效率:

- 虽然DualVLN展现出强大的零样本泛化能力,但仿真到真实的域差距仍存在

- 可探索域随机化、域自适应等技术进一步缩小差距

- 跨层表征对齐:

- 当前的潜在查询机制是单向的(系统2 → 系统1)

- 未来可探索双向反馈机制,让系统1的执行结果反馈到系统2的规划

- Social-VLN性能:

- 在动态场景中成功率仍有很大提升空间(37.2% vs 静态64.3%)

- 需要更多社交导航数据和显式的人-机器人交互建模

- 长视程泛化:

- 论文未详细评估超长指令(如跨楼层导航)的性能

- 未来可扩展到更大规模环境(如整栋建筑、园区级导航)

- 计算资源需求:

- 系统2(7B VLM)需要20GB显存,限制了边缘设备部署

- 可探索模型压缩、量化、知识蒸馏等技术实现轻量化

方法论贡献总结

- 首个双系统VLN基础模型:将认知科学的”双过程理论”引入具身导航

- 解耦训练范式:保留VLM泛化能力的同时,高效训练低级策略

- 显隐式目标协同:兼顾可解释性(像素目标)和表征丰富性(潜在特征)

- 异步推理架构:实现高频控制(30Hz)的同时保持低级别的感知-行动延迟

- Social-VLN基准:填补了VLN领域在动态场景评估上的空白

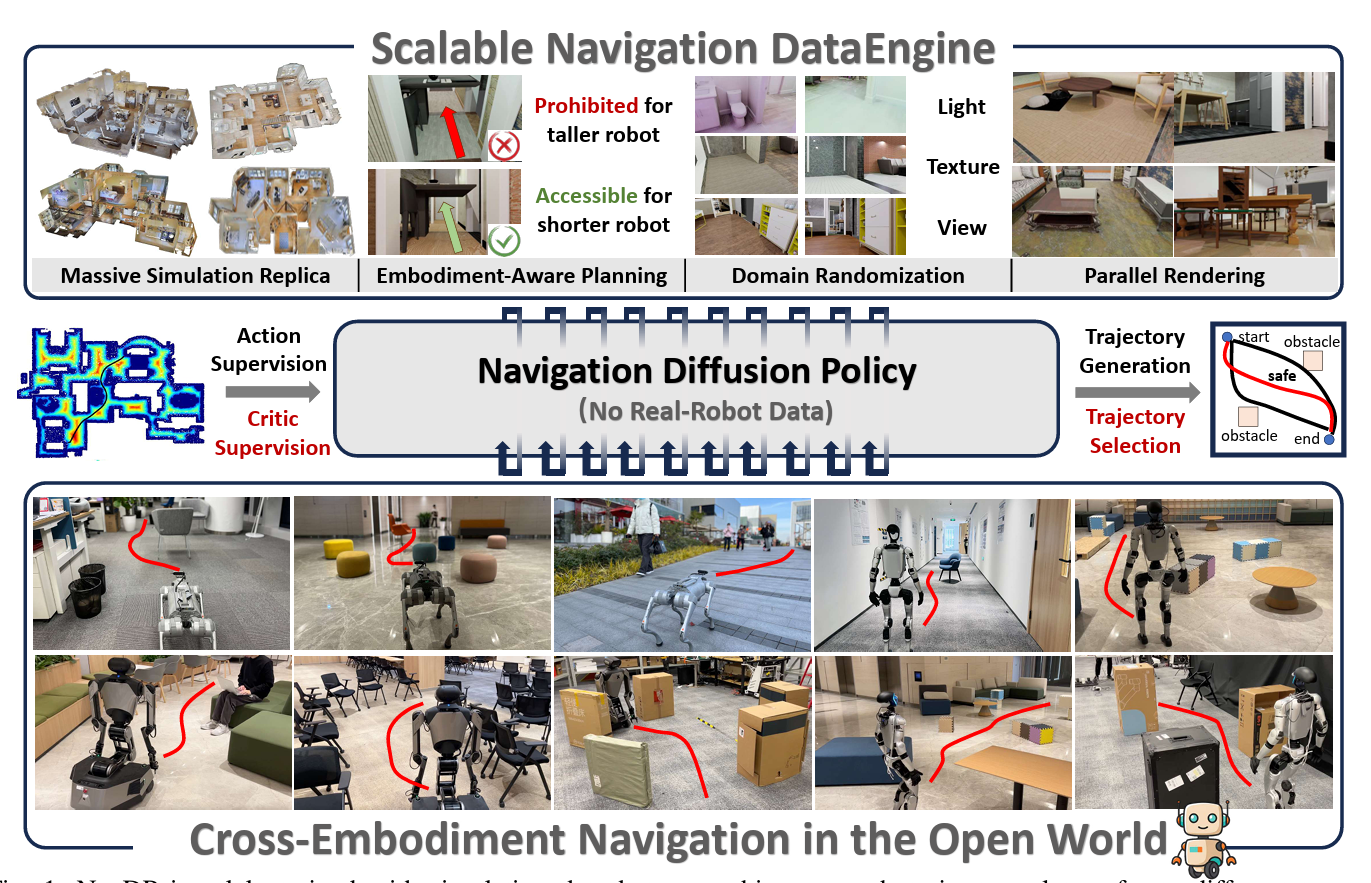

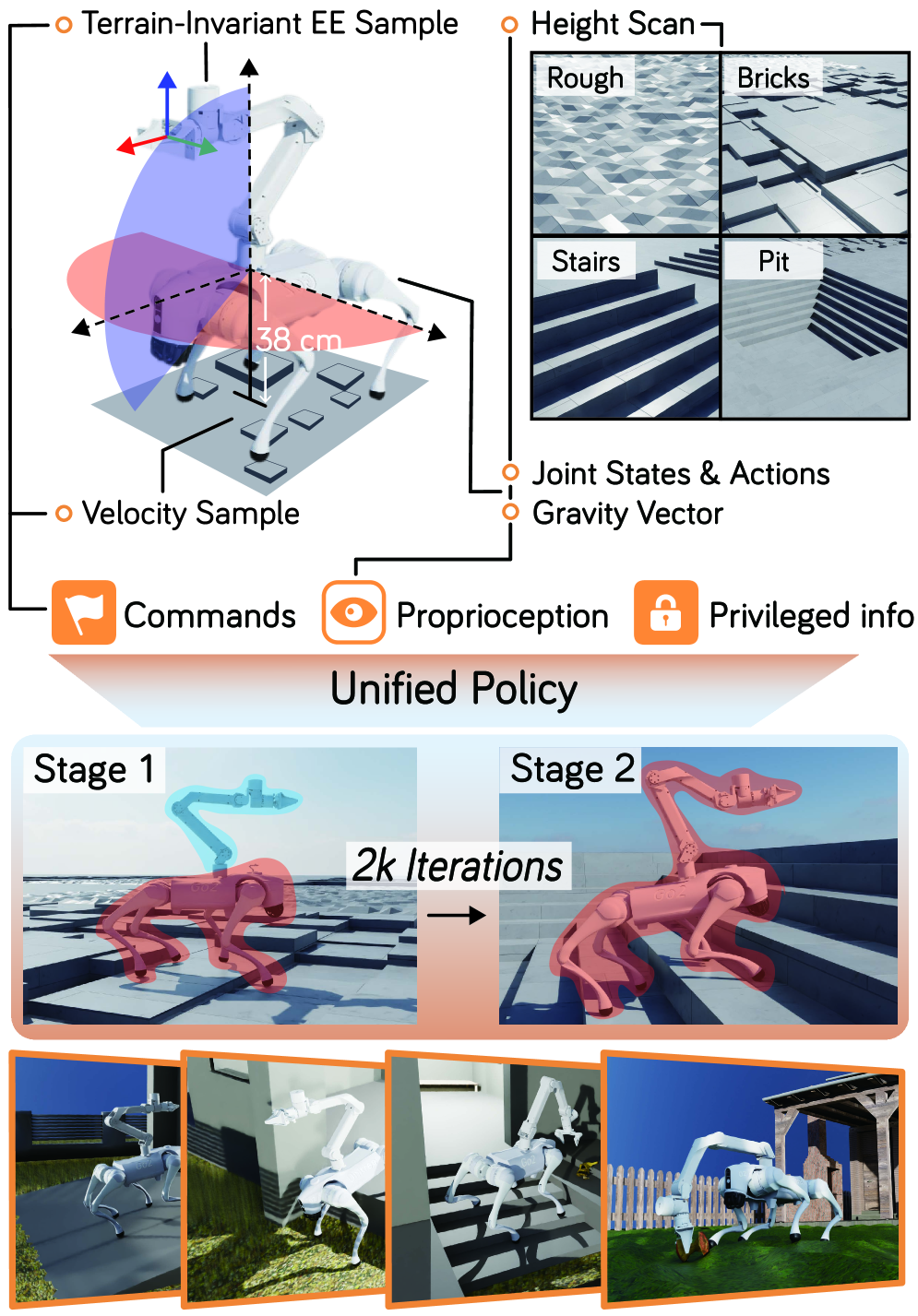

2. NavDP (2025)

——基于扩散模型的零样本导航规划

📄 Paper: arXiv:2505.08712

研究背景/问题

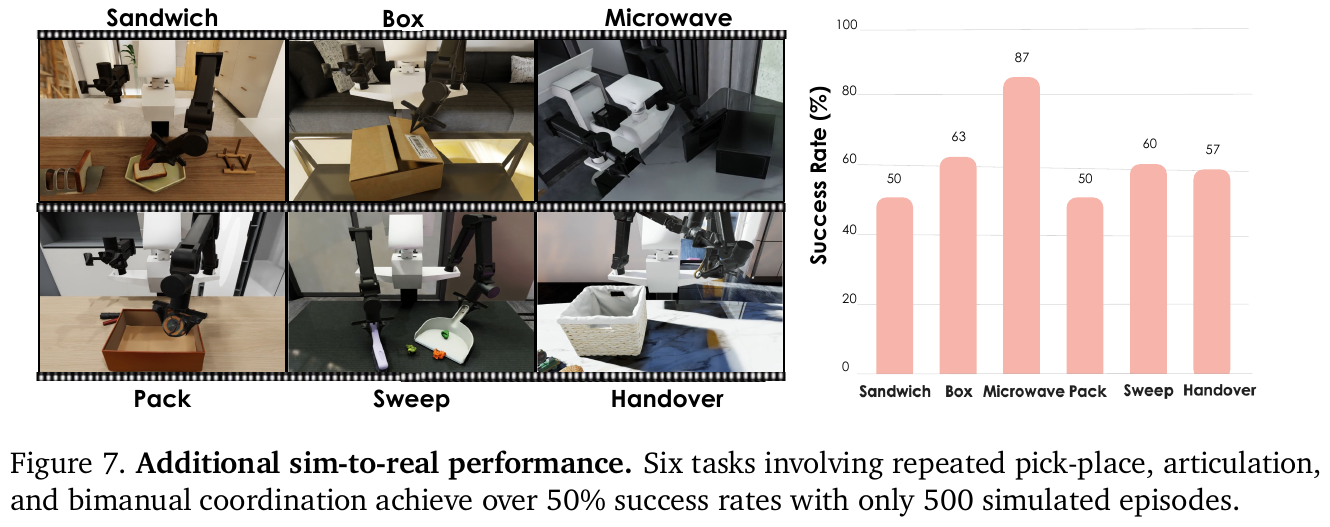

机器人导航面临的核心挑战是如何在保证安全的前提下实现跨场景、跨平台的泛化能力。传统的导航方法往往依赖于显式地图构建或需要在目标环境中大量采集真实数据,这限制了其在实际场景中的部署效率。NavDP(Navigation with Diffusion Policy,上海AI Lab)提出通过大规模模拟数据训练,结合扩散模型生成候选轨迹和Critic网络评估安全性,实现零样本sim-to-real迁移。

NavDP 在双系统框架中的定位:NavDP 是一个快慢双系统(Fast-Slow System)中的 System 1——负责高频、实时的局部避障与路径规划(>10Hz)。System 2 由 VLM 驱动(如 UniNav、NavA 系列),负责语义理解、任务分解与长期记忆。两者协同完成完整的开放世界导航流程。今天介绍的 NavDP 专注于 System 1 的工作。

为何仿真数据对导航特别有效:不同于 manipulation 需要精确的物理接触,导航任务的核心是路径规划与避障,涉及物理交互极少。因此仿真与现实之间的 sim-to-real gap 相对更小,这是 NavDP 选择纯仿真数据路线的核心依据。

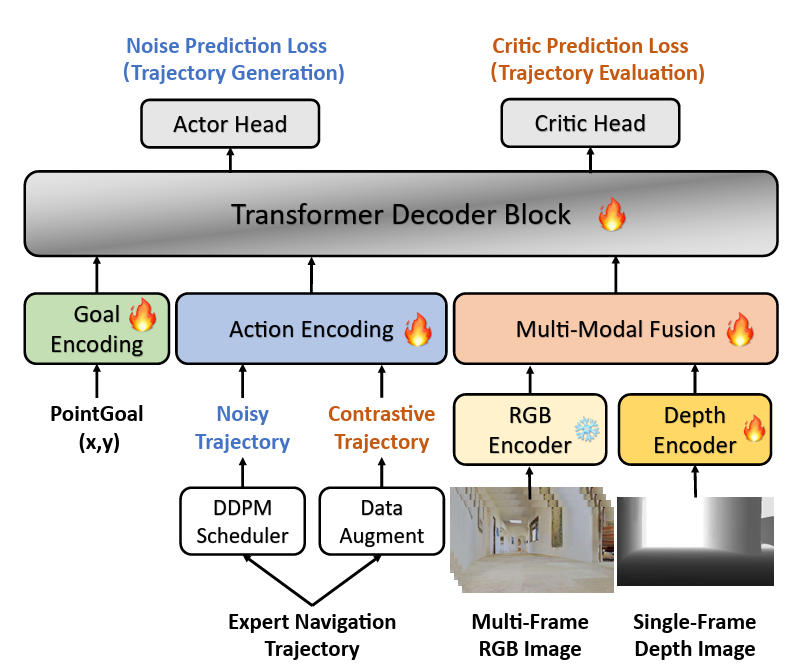

主要方法/创新点

核心思路

扩散模型负责生成候选轨迹,Critic负责挑选安全路线

两阶段推理框架

- 第一阶段(策略生成):用RGB-D图像+导航目标,经策略Transformer编码后,通过扩散生成候选轨迹

- 第二阶段(安全评估):将生成轨迹与RGB-D token融合,再经共享Transformer与critic head,选择与目标无关的安全轨迹

模拟特权信息利用

- 生成器训练:利用模拟环境中的全局最优规划器指导轨迹生成

- Critic训练:利用模拟环境的全局ESDF,从负样本轨迹中学习精细空间理解。关键 insight:专家轨迹生成时超参难以完美调整,轨迹往往会有轻微”贴边”现象;Critic 的真实价值在于从这批轨迹中选出安全距离最大的一条,而非仅过滤碰撞,从而系统性地提升泛化性

- 轨迹数据增强:对原始轨迹进行随机旋转和插值,生成混合轨迹增加多样性

- 渲染层数据增强(三类视觉随机化,提升 sim-to-real 适应性):

- 视角随机化:模拟不同机器人相机安装位置与俯仰角度

- 光照随机化:布置不同颜色和强度的灯光

- 纹理随机化:为地板、墙面、天花板随机贴图

多模态输入编码

- 输入:单帧RGB-D图像+导航目标(四种类型:点目标、图像目标、轨迹目标、无目标)

- 深度处理:裁剪至0.1-3.0 m,RGB经预训练DepthAnything ViT编码,深度由自训练ViT编码

- Transformer解码器:将512个RGB-D token压缩为16个融合token

Real-to-Sim增强

- 采用Gaussian Splatting重建真实环境,提供高真实感的训练与评测平台

- 在训练集中加入27%的real-to-sim样本,可使目标场景成功率提升30%,且不损害泛化能力

核心结果/发现

- 跨机器人平台泛化:在不同机器人(Dingo、Go2、Galaxea R1)上稳定高于基线(GNM, ViNT, NoMad, iPlanner, ViPlanner, EgoPlanner)

- 零样本Sim-to-Real:成功在Unitree Go2、Galaxea R1、Unitree G1上部署,室内外场景均表现良好,含动态行人干扰

- 数据规模与效率:模拟数据生成速度约2,500条轨迹/GPU/天,比真实采集快20倍;论文版数据集覆盖1244个场景、总长度363.2 km;随 InternData 一起发布的扩展版本已 scale up 至 3000+ 场景、400小时、4000万张图片,并附带 60万条 VLM 自动生成的语言标注(可用于 VLN/VLA 微调)

- 模型组件贡献:Critic模块是性能提升的关键,移除后性能显著下降;No-goal训练目标对整体避障行为影响最大

- Real-to-Sim效果:真实场景成功率提高30%,证明real-to-sim数据能显著提升sim-to-real成功率

- 高速避障:>10Hz推理,支持2.0 m/s高速避障,动态场景下优于传统地图规划方法

局限性与未来方向

NavDP的性能高度依赖于高质量的模拟数据训练,Real-to-Sim数据比例需要仔细平衡以避免过拟合特定场景。此外,扩散模型的多步推理虽然提供了多样化的轨迹候选,但相比直接回归方法计算开销更大,对实时性要求极高的应用场景可能存在挑战。

作者指出了两个具体的未来方向:

- 显式本体信息编码:当前模型仅从数据分布中隐式学习运动约束,无法明确感知自身体型。理想系统应能判断”这条缝我过不去”——这需要将机器人几何参数作为显式条件引入决策

- 运动技能与路径规划的联合设计:当前避障假设机器人只能行走绕行。在极端地形下(如需要跳跃、跨越障碍),规划器应结合自身运动能力上限(如”最大跳越高度1m”)做出更合理的绕行或通过决策,而非盲目尝试

Scaling 实验结论(Q&A 中补充):对导航问题而言,场景多样性维度的 scaling 效果显著优于轨迹数量的 scaling;在架构选择上,Transformer 的 scaling 性能优于 Conditional UNet,这是后续版本迭代的核心方向。

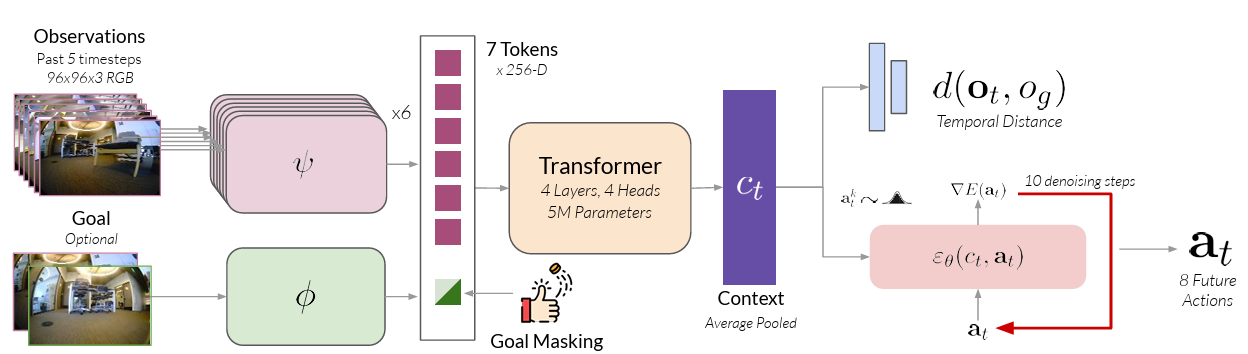

3. NoMaD (2023)

——目标掩码扩散策略实现统一导航

📄 Paper: arXiv:2310.07896

研究背景/问题

传统机器人导航系统通常为探索(exploration)和目标导航(goal-conditioned navigation)分别训练独立的策略模型,这不仅增加了系统复杂度,也限制了跨任务的知识共享和泛化能力。NoMaD(Nomadic Multi-task Agent with Diffusion,伯克利,ICRA2024 Best Paper)提出通过统一的扩散策略框架,使用目标掩码机制同时建模任务特定行为(目标导向)和任务无关行为(探索),实现单一策略胜任多种导航任务。

主要方法/创新点

核心思路

通过统一的扩散策略,同时建模任务特定和任务无关行为

两个关键组件

目标掩码(Goal Masking)

- 通过二值掩码控制策略是否关注目标图像,实现任务条件的灵活切换

- 训练时:目标掩码以50%概率随机设置,使模型同时学习目标导向行为和探索行为

- 推理时:根据任务需要设置掩码(探索时掩盖目标,导航时提供目标)

扩散策略(Diffusion Policy)

- 利用扩散模型生成多模态、无碰撞的动作序列

- 从随机噪声逐步迭代生成预测动作序列

- 动作分布既可在无目标条件下表达探索行为,也可在提供目标条件下收敛到目标导向行为

统一框架设计

- 通过Transformer编码视觉观测并结合扩散模型生成未来动作序列

- 同时支持任务特定行为(目标导向)和任务无关行为(探索)

- 使用大规模多样化数据集(GNM和SACSoN)进行端到端监督训练

核心结果/发现

- 探索未知环境:成功率达到98%,平均碰撞数仅0.2,超过最优基线Subgoal Diffusion约25%,且参数量仅为其1/15

- 目标导航:在已知环境的目标导航任务中,成功率与最优基线相当,但计算资源需求更少

- 计算效率:比现有方法计算效率提升约15倍,是首个成功在物理机器人上部署的目标条件动作扩散模型

- 统一策略优势:联合训练能够学习共享表示和环境可操作性,单一策略即可胜任多种行为

- 编码器选择:ViNT编码器配合注意力目标掩码效果最佳,成功率98%,碰撞数最少

- 多场景验证:在6个复杂的室内外环境中表现优异

局限性

NoMaD的视觉编码器选择对性能影响较大,需要仔细调优以达到最佳效果。虽然ViT编码器具有更大的容量和表达能力,但其训练优化难度较高,收敛速度相对较慢。此外,目标掩码机制的随机采样比例(训练时50%)是一个关键超参数,在不同场景下可能需要针对性调整。尽管在多个室内外环境中表现优异,但在极端复杂、高度动态的场景(如密集人流、快速变化的障碍物)下的鲁棒性仍有进一步提升空间。

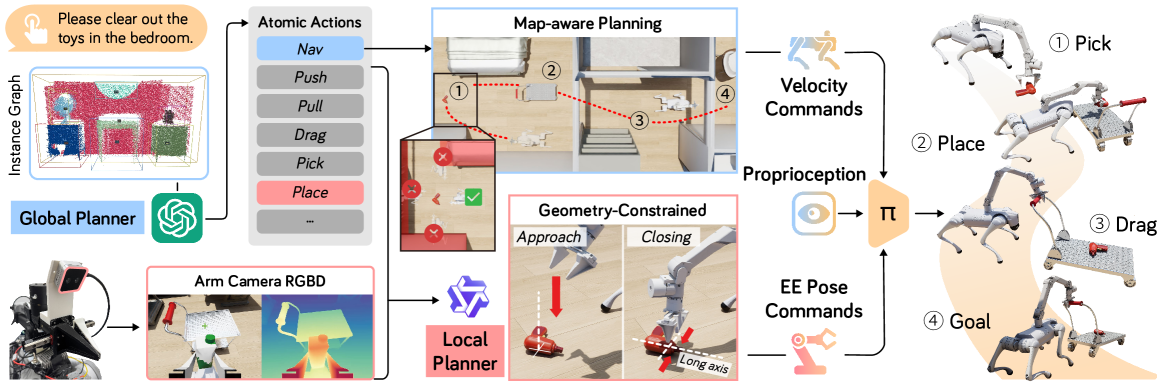

4. ODYSSEY (2025)

——Open-World Quadrupeds Exploration and Manipulation for Long-Horizon Tasks

📄 Paper: arXiv:2508.08240

研究背景/问题

在动态、非结构化环境中,机器人需要将移动性、操作和实时感知紧密结合才能执行复杂任务。现有研究大多局限于桌面场景,未能解决移动平台特有的感知受限和执行器范围有限的问题,且在开放世界环境中的泛化能力不足。

主要方法/创新点

ODYSSEY提出了一个统一的移动操作框架,包含分层规划和全身控制两大核心模块:

长期任务规划器:

- 全局任务级规划:融合RGB和LiDAR流构建场景的空-语义表示,利用预训练基础模型将实例图映射到场景中

- 使用GPT-4.1将自然语言指令分解为原子动作序列(导航、抓取、放置等),并输出粗略目标航路点

- 航路点投影到2D占用图,通过局部搜索确定无碰撞目标姿态

局部操作:

- 使用腕部安装的深度观测数据指导视觉-语言模型生成精确末端执行器姿态

- Qwen2.5-VL-72B-Instruct模型根据RGB观测和文本描述推断任务相关接触点

- 根据目标物体主轴和表面法线施加几何约束,确定末端执行器朝向

全身控制策略:

- 单一网络将观测向量(运动指令、末端执行器目标、地面高度图、重力向量、本体感知状态等)映射到目标动作

- 两阶段训练:第一阶段固定机械臂关节训练运动;第二阶段控制全部18个关节,采用地形不变末端执行器采样策略

- 引入步态奖励、频率奖励和末端执行器跟踪项,运用领域随机化增强适应性

模拟基准测试:

- 构建包含50个刚体物体、15个容器、30个关节结构、10个可拖动物体的多样化资产库

- 基准测试包括10个真实场景(室内家居、超市、餐厅、室外庭院等)

- 长期任务包含246个室内和58个室外变化,涉及抓取、重新定向、容器放置、关节操作等多种技能

核心结果/发现

- 短期任务:在ARNOLD基准测试上优于PerAct基线,仅依赖单个自我中心摄像头实现更强的泛化能力,在未见数据集上性能保持稳定

- 长期任务:在8个长期移动操作任务上实现40%以上整体成功率,每个原子技能类别保持60%以上成功率,展现出可靠的协调能力

- 低层策略:在基座速度跟踪方面优于RoboDuet基线,末端执行器姿态跟踪性能相当,且在不同地形上具有更强的适应性

- Sim-to-Real迁移:成功在Unitree Go2+Arx5平台上实现现实世界部署,在”导航到抓取”和”抓取和放置”任务中验证了框架的实用性

局限性

模型在物体几何形状的空间推理方面存在局限,导致夹爪对齐不佳和细长手柄或部分遮挡物品的定位不准确。此外,抓取小物体时偶尔失败,主要由于末端执行器跟踪和视觉感知精度不足。

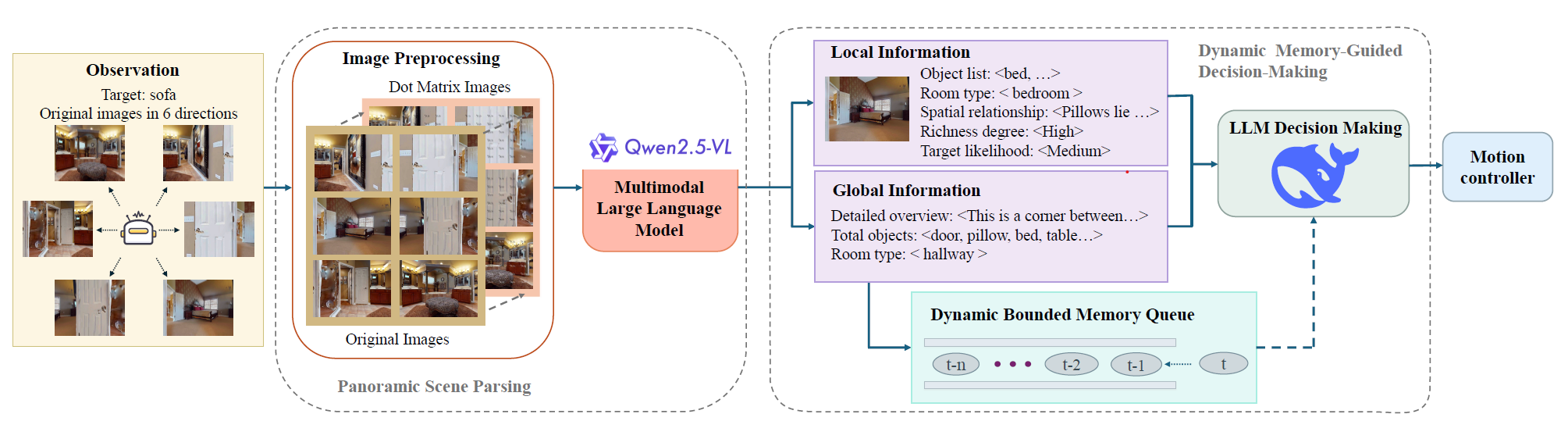

5. PanoNav (2025)

——Mapless Zero-Shot Object Navigation

📄 Paper: arXiv:2511.06840

研究背景/问题

现有目标导航方法大多依赖深度传感器或预建地图来构建2.5D场景表示,限制了在真实环境中的适用性和泛化能力。零样本目标导航要求机器人识别和导航到超出预定义类别范围的对象,现有方法在开放词汇场景中表现有限。无地图方法通常只基于当前观测进行决策,忽略历史轨迹信息,容易陷入局部死锁。

主要方法/创新点

PanoNav是一个无地图、仅使用RGB图像的零样本目标导航框架,包含两个核心模块:

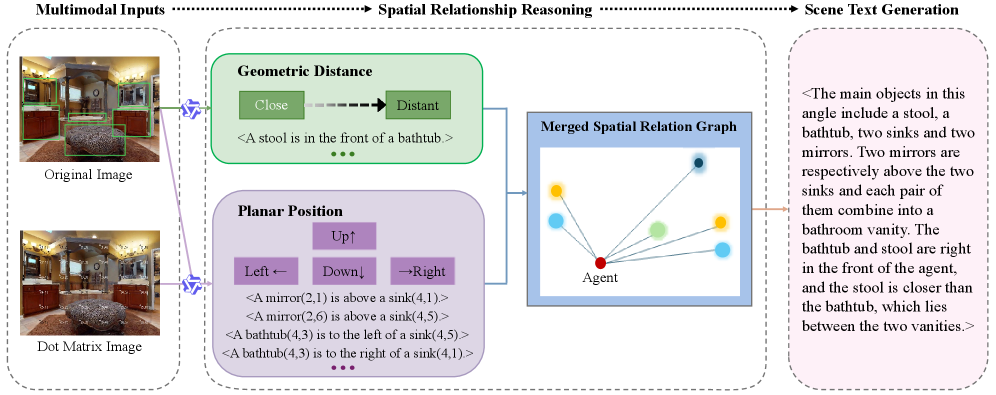

全景场景解析(Panoramic Scene Parsing):

局部方向解析:

- 点阵图像增强:将每个RGB图像转换为点阵图像,通过Scaffold方法增强平面位置理解,与RGB图像共同作为MLLM输入

- 空间关系图构建:MLLM利用几何距离关系和平面位置关系,构建空间关系图,生成每个方向的详细描述(物体存在、空间关系、房间类型等)

全局全景总结:

- 环境整体感知:对机器人周围环境进行整体分析,识别环境中存在的物体类型和当前房间类型(如厨房、走廊)

- 隐式自我定位:通过全局总结提供隐式自我定位信息,帮助机器人理解其在更大环境中的位置

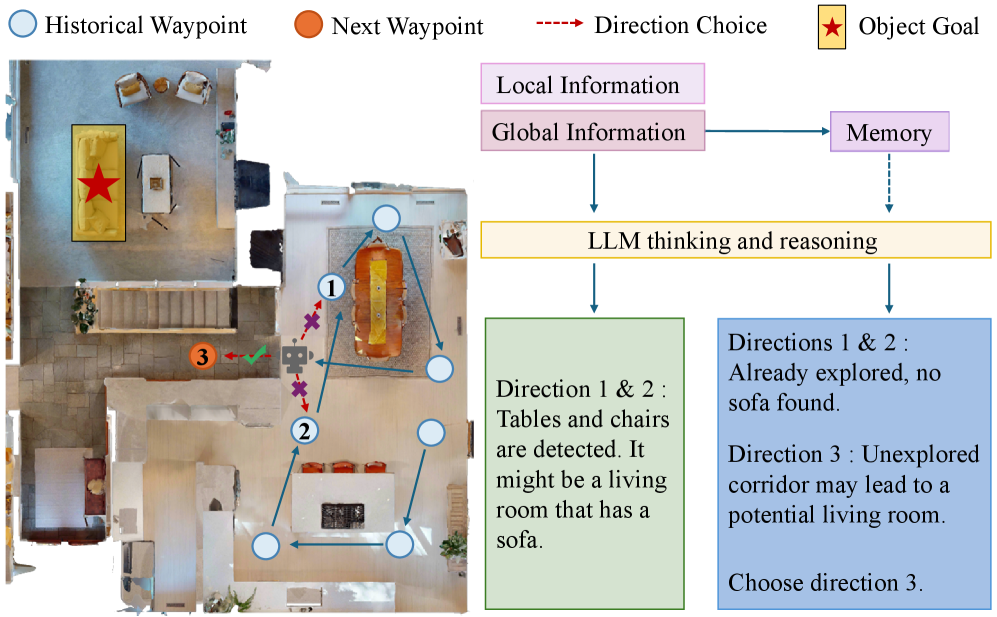

动态记忆引导决策(Dynamic Memory-guided Decision-Making):

- 动态有界记忆队列:存储最近的全局场景总结,队列长度固定,当队列满时新元素加入会移除最旧元素

- 决策过程:

- 记忆队列未满时:决策仅基于当前的局部描述和全局总结

- 记忆队列满时:决策结合当前信息和历史记忆信息,避免重复探索已访问区域

- 动作选择:决策结果包括导航方向和是否找到目标的标志,由运动控制器执行相应动作

任务设置:

- 观测数据:每个时间步获取六个方向的RGB图像(间隔60度),形成全景视图,不依赖深度传感器或GPS

- 动作空间:停止、前进(0.25米)、左转/右转(30度)、抬头/低头

- 任务目标:在未见过的环境中根据语言指令找到目标对象,并导航至目标位置

核心结果/发现

- 性能优势:在HM3D数据集上,PanoNav的成功率(SR)达到43.5%,SPL达到23.7%,显著优于PixNav(SR=37.9%,SPL=20.5%)和ZSON(SR=25.5%,SPL=12.6%),甚至超过部分依赖地图和闭词汇表的方法

- 死锁避免:在高度欺骗性环境中,通过动态记忆机制实现48.0%成功率和19.2% SPL,逃离局部区域的逃逸率达82.0%

- 消融实验验证:

- 全景视图的重要性:仅使用三视图时性能显著下降(SR=19.5%,SPL=9.97%)

- 解耦解析与决策的优势:解耦方法(SR=43.5%,SPL=23.7%)优于直接从MLLM输出决策(SR=38.5%,SPL=22.57%)

- 动态记忆的关键作用:移除动态记忆后性能大幅下降(SR=38.5%,SPL=22.57%)

局限性

虽然PanoNav显著提升了无地图零样本导航性能,但未来仍需探索利用多模态信息(如语音、手势等)构建更强大的记忆队列,以进一步提高无地图目标导航的鲁棒性和泛化能力。

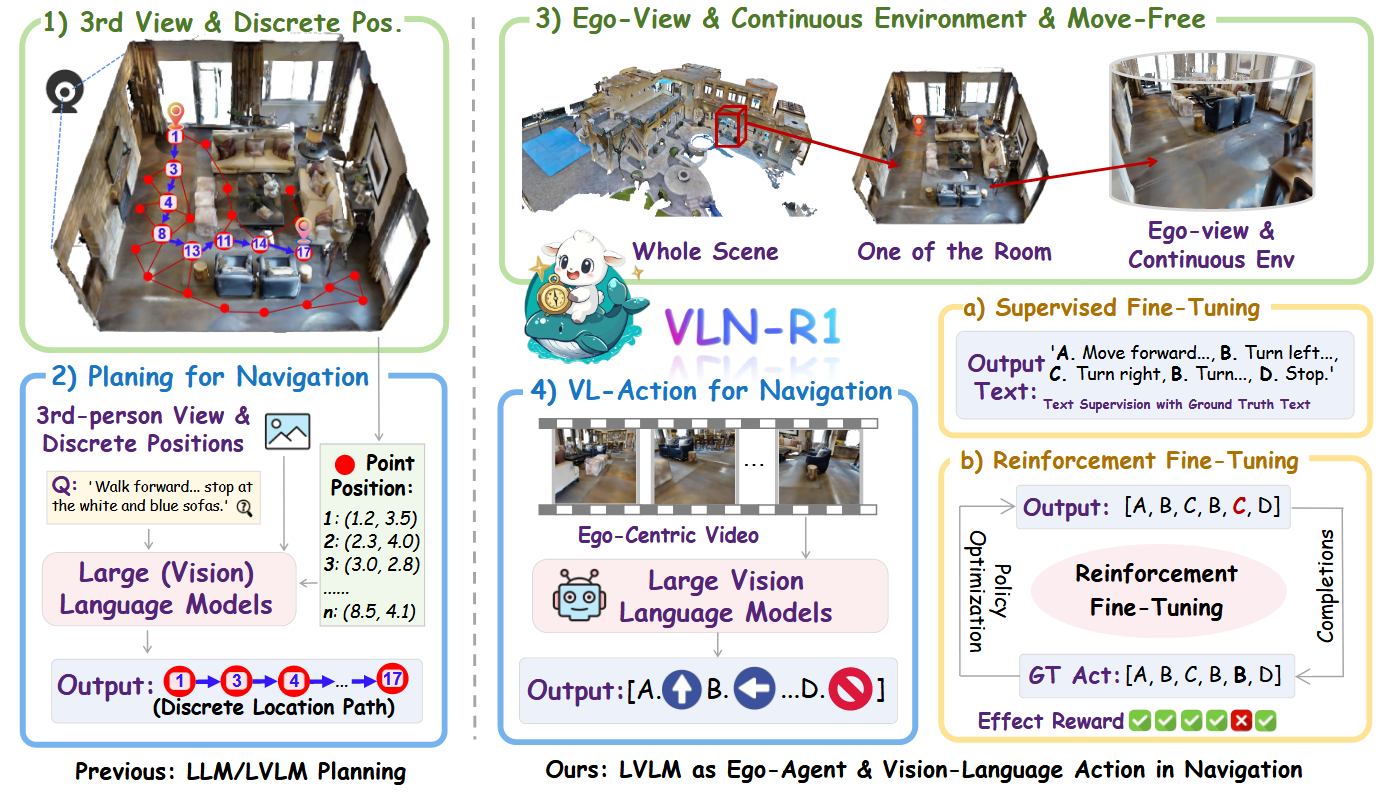

6. VLN-R1 (2025)

——基于GRPO与Time-Decayed Reward的端到端导航

📄 Paper: arXiv:2506.17221

研究背景/问题

VLN是具身人工智能领域的一项核心挑战,要求智能体根据自然语言指令在真实世界环境中进行导航。传统的导航方法通常依赖离散的拓扑图和预定义的节点连接,限制了智能体在连续环境中的泛化能力。

主要方法/创新点

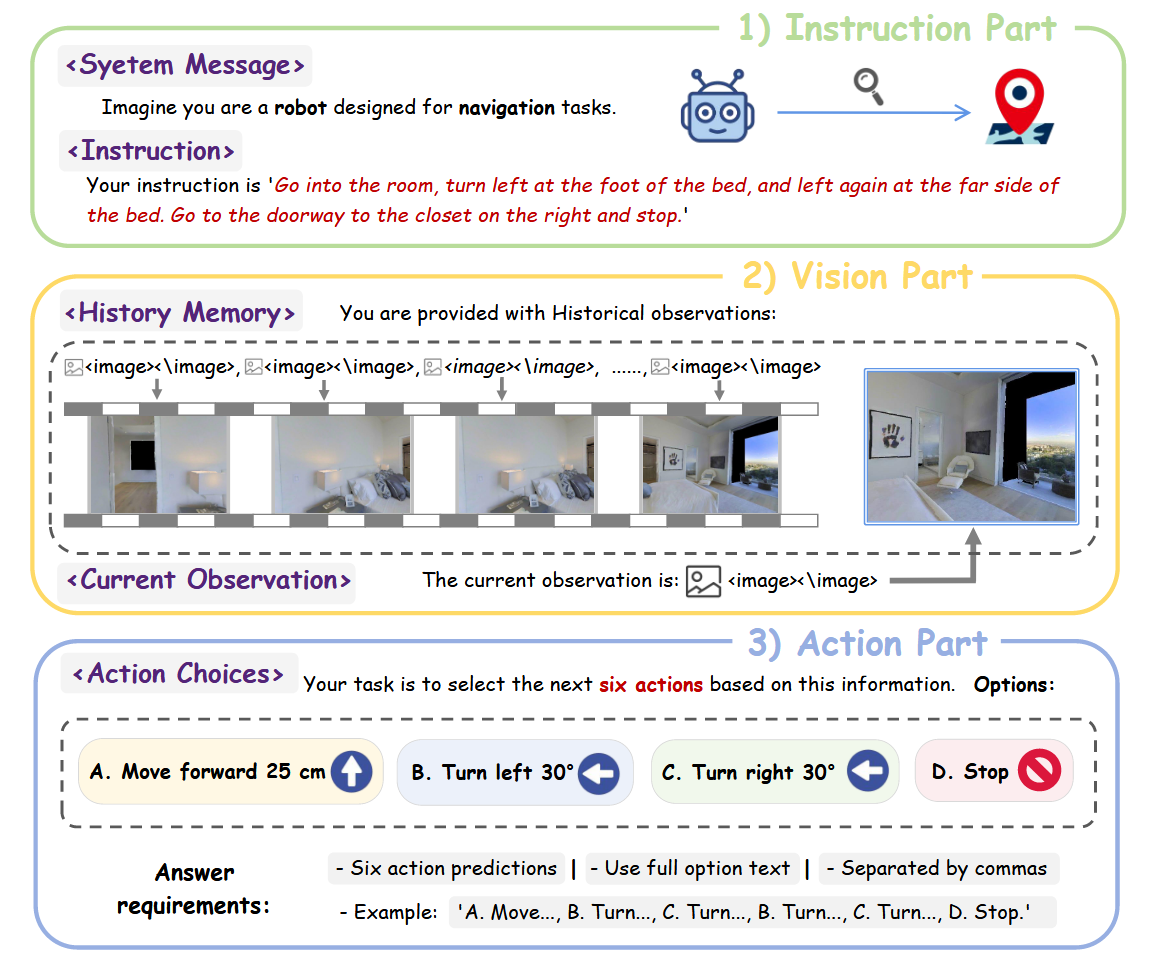

VLN-R1提出了一种创新的端到端框架,利用大型视觉-语言模型(LVLM)直接处理自我中心视频流,生成连续的导航动作。

核心设计理念:

- 构建能够实时处理自我中心视频流并生成连续导航动作的端到端框架

- 与传统方法依赖导航图或额外传感器不同,VLN-R1直接将视觉输入和自然语言指令转化为动作输出

- 提高系统通用性,增强在未见过环境中的适应能力

主要组件:

VLN-Ego数据集:

- 数据生成:通过Habitat模拟器生成,包含自我中心视频流与未来动作预测的配对数据

- 三部分文本注释:

- 指令部分:自然语言导航指令(如”走到客厅的沙发旁”)

- 视觉部分:包括历史帧和当前观察,提供自我中心的视觉信息

- 动作部分:未来动作选择(前进、左转、右转、停止四种基本动作)

- 数据规模:

- 从Room-to-Room生成了60K个训练样本

- 从Room-Across-Room生成了1.2M个训练样本

- 覆盖了61个训练场景

长短期记忆采样:

- 新颖的视频输入处理策略,用于动态平衡历史帧的重要性与当前观察的实时性

- 确保模型既能利用历史信息,又能快速响应当前环境变化

- 相比单一动作预测,多步动作预测结合历史上下文显著提升性能

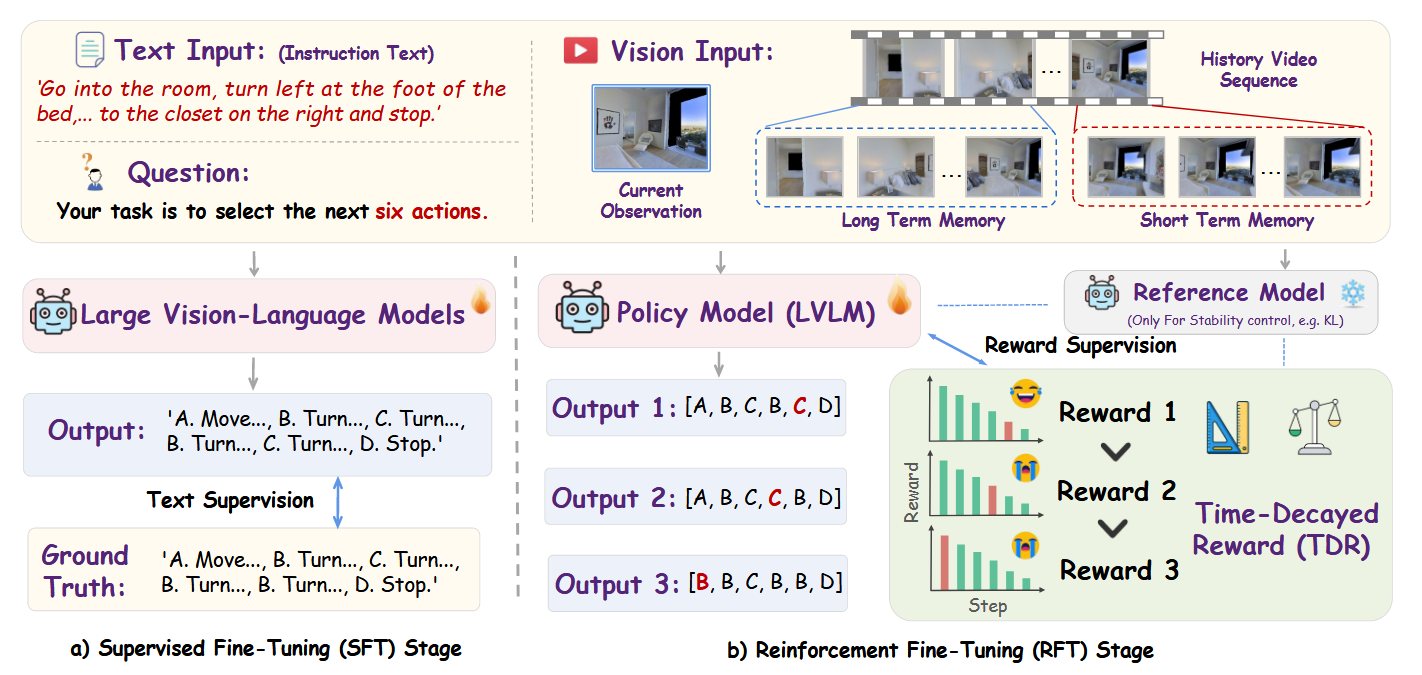

两阶段训练策略:

监督微调(SFT)阶段:

- 模型的动作序列预测与专家演示对齐,通过监督学习优化输出文本

- 模型生成的多步动作序列文本与地面真值对齐,通过交叉熵损失进行优化

- 给定历史观察序列H_t、指令Z和当前观察O_t,模型预测n步未来动作序列

强化微调(RFT)阶段:

- 引入基于GRPO(Group Relative Policy Optimization)的强化学习方法

- 结合时间衰减奖励机制(TDR),进一步优化模型在长时程导航中的性能

- 超参数经过消融实验确定,生成次数选择8作为默认值

时间衰减奖励机制(TDR):

- 核心思想:通过引入衰减因子,平衡短期和长期奖励

- 作用机制:使模型能够更关注近期的动作,同时考虑长期目标

- 优势:用于评估多步动作预测的长期效果,优化长时程导航性能

模型架构:

- 输入:自我中心视频流和指令

- 输出:多步未来动作序列

- 端到端设计:消除了对导航图的依赖,使其在连续环境中表现出色

核心结果/发现

VLN-R1在VLN-CE(视觉-语言导航连续环境)基准上进行了全面测试:

测试平台:

- Room-to-Room(R2R):要求智能体在单个房间内导航

- Room-Across-Room(R4R):要求智能体跨房间导航,任务更具挑战性

性能表现:

- R2R数据集:展现了高效的导航能力和准确的任务完成率

- R4R数据集:通过强化微调显著提升了跨域适应性,小型2B模型的性能甚至接近7B模型

- 模型可扩展性:证明了端到端框架在不同模型规模下的有效性

消融实验验证:

- 长短期记忆采样:多步动作预测结合历史上下文显著提升性能,优于单一动作预测

- TDR机制:与传统奖励函数相比,TDR显著提高了长时程任务的成功率

- 生成次数:从6增加到8时性能提升有限,因此选择8作为默认值

技术优势:

- 端到端设计实现了实时导航

- 结合LVLM的视觉-语言理解能力和强化学习的优化策略

- 展示了在任务特定推理中的潜力

局限性

论文内容相对简短,未详细说明具体的性能指标数值(如SR、SPL等)和与其他SOTA方法的详细对比。此外,对于Real-world部署的讨论较少,主要集中在仿真环境(Habitat)测试,缺乏真实机器人平台上的验证实验。

7. LagMemo (2025)

——Language 3D Gaussian Splatting Memory for Multi-modal Open-vocabulary Multi-goal Visual Navigation

📄 Paper: arXiv:2510.24118

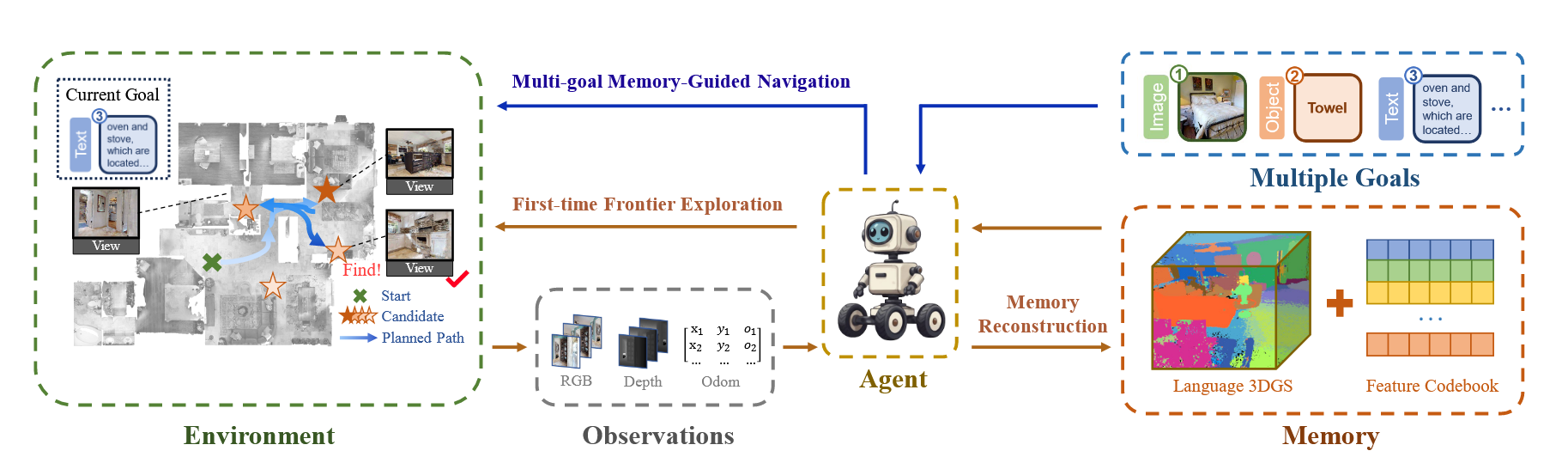

研究背景/问题

传统视觉导航方法受限于单目标、单模态和封闭类别设置,无法满足实际应用中多模态开放词汇表多目标导航的需求。现有方法如端到端强化学习依赖隐式状态编码导致泛化能力差,而模块化方法基于2D语义地图仅支持预定义类别,无法适应开放词汇场景。

主要方法/创新点

LagMemo提出了首个将语言特征融入3D Gaussian Splatting(3DGS)的视觉导航系统:

语言3DGS记忆重建:

前沿探索与几何重建:

- 前沿探索策略:智能体首先进行基于前沿的环境探索,收集RGB-D图像和姿态信息

- 3DGS几何重建:3D高斯由空间位置μ、颜色c、半径r和不透明度o参数化,通过颜色和深度渲染的几何损失优化

- 关键帧检索机制:针对导航场景中帧间重叠有限导致的遗忘和表面空洞问题,引入帧池存储历史帧,周期性渲染并按PSNR评估,优先优化低保真帧

语言特征注入:

- 实例级特征提取:使用SAM生成实例掩码,通过特征splatting渲染逐像素语义特征,聚合掩码级特征并优化

- 两级码本量化:粗分区联合考虑3D位置和语言特征,细分区仅基于语言特征细化类别

- 2D-3D特征关联:对每个实例类别,渲染其高斯并评估与2D实例掩码的空间语义一致性,将高维CLIP实例特征分配给离散化的3D高斯语言类别

- 码本构建:每个码本条目对应一簇3D高斯,富含CLIP特征,支持多模态查询(文本/图像)

记忆引导的视觉导航:

- 目标定位:多模态输入目标(文本/图像)通过CLIP编码器编码,与码本计算余弦相似度定位候选实例,计算高斯质心并投影到2D障碍地图生成路径点

- 路径点导航:使用Fast Marching Method(FMM)从当前位置规划无碰撞路径至路径点

- 目标验证与匹配:到达路径点后全景扫描验证目标,对象/文本目标使用SEEM开放词汇实例分割和CLIP相似度二次验证,图像目标使用LightGlue特征匹配

- 终点导航:确认目标可见后,利用SEEM掩码和深度信息将目标点投影到障碍地图,再次使用FMM导航至终点并执行STOP

GOAT-Core基准数据集:

- 针对GOAT-Bench质量问题策划高质量核心子集:每集20个子任务(原7.88个),平均13.37个独特类别(原4.82个),子任务间平均距离6.89m(原5.18m)

- 手动修正不准确文本描述,优先语义清晰的对象,限制所有子任务在单层楼

- 包含480个多模态子任务(163图像、158对象、159文本目标)

核心结果/发现

目标定位任务:

- 在GOAT-Core上总体成功率70.8%,显著优于VLMaps(58.8%)

- 分模态性能:对象88.4% vs 69.7%,图像56.4% vs 43.3%,文本66.8% vs 61.0%

- 语言3DGS保留详细3D空间上下文,实现精确定位,而VLMaps的2D网格压缩丢失关键几何信息

多模态多目标视觉导航:

- 平均成功率SR=56.3%,SPL=35.3%,在所有四个场景中均取得最高成功率

- 相比次优基线CoWs*,SR提升10%,相比Modular GOAT提升18%

- 文本导航任务优势尤为显著,充分展现丰富3D语义表示的优势

- 消融实验验证:移除关键帧机制导致PSNR从27.20降至21.15,定位准确率从70.8%降至66.3%;移除码本定位准确率骤降至34.6%

- 目标验证机制至关重要:无验证SR=41.3%,通用CLIP验证SR=46.7%,模态特定验证SR=56.3%

局限性

当前方法依赖静态固定容量记忆,在动态环境(重新排列、增删物体)中适应性不足。全场景3D表示内存密集,需要层次化或多分辨率高斯、不确定性感知剪枝和特征压缩。此外,目标定位能力依赖几何保真度,视角覆盖不足会留下盲区,未来需开发记忆感知的主动探索策略。

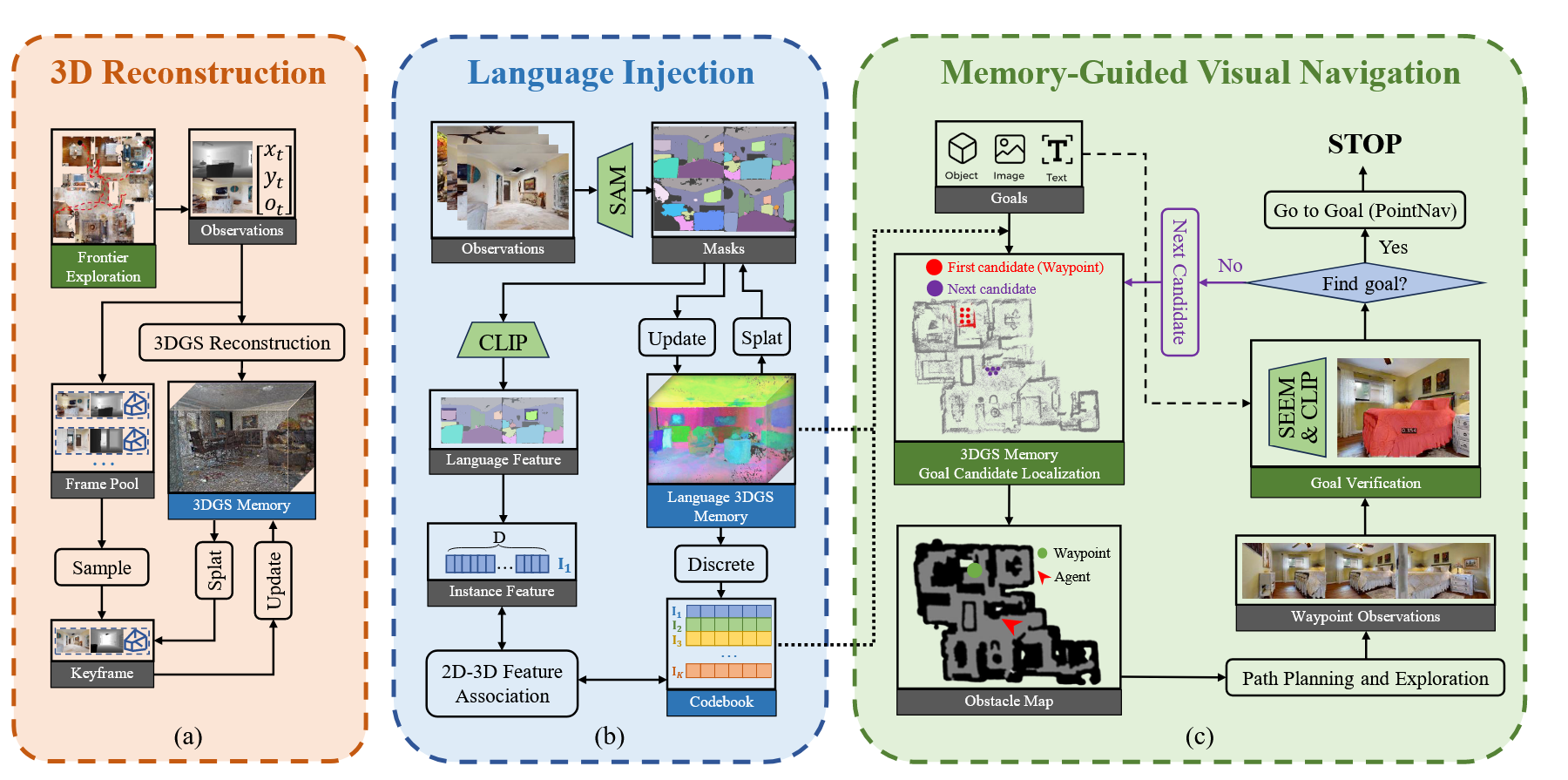

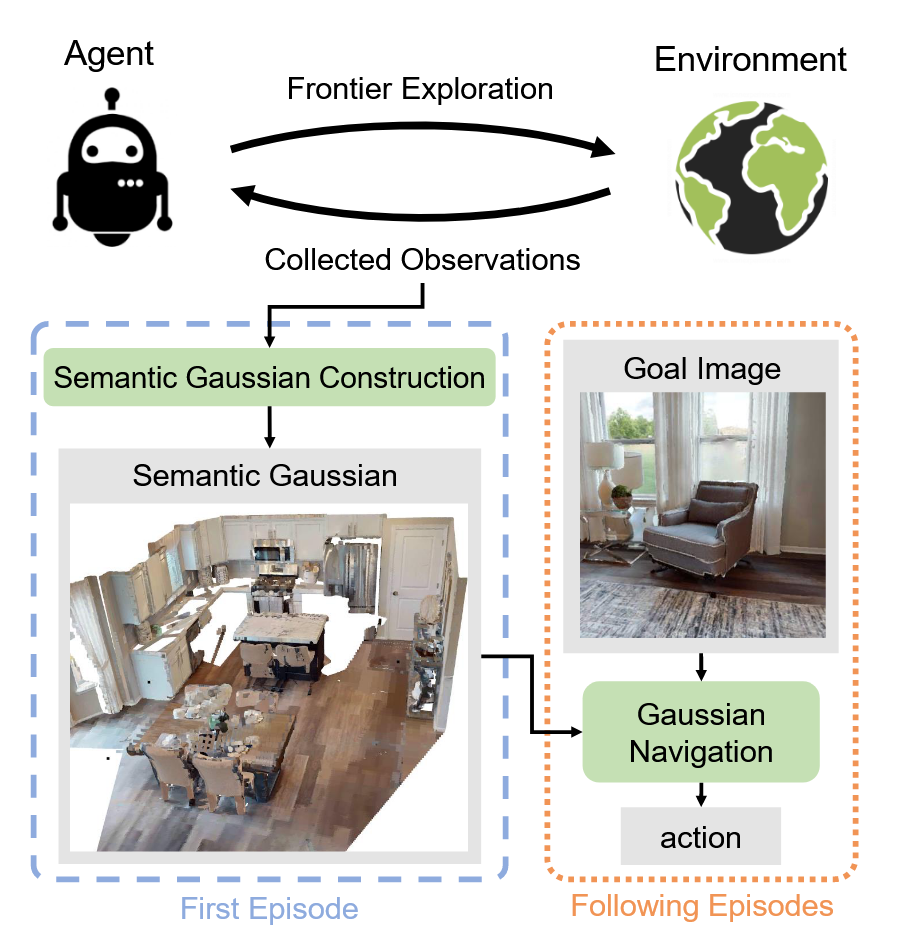

8. GaussNav (2025)

——Gaussian Splatting for Visual Navigation

📄 Paper: arXiv:2403.11625

研究背景/问题

Instance ImageGoal Navigation (IIN)要求智能体在未探索环境中定位并导航至目标图像所描绘的特定对象实例,需要跨视角识别目标对象同时忽略干扰物。现有基于BEV地图的导航方法缺乏详细纹理表示,难以胜任实例级任务,无法保留场景的实例感知特征,不足以区分同类别的多个对象。

主要方法/创新点

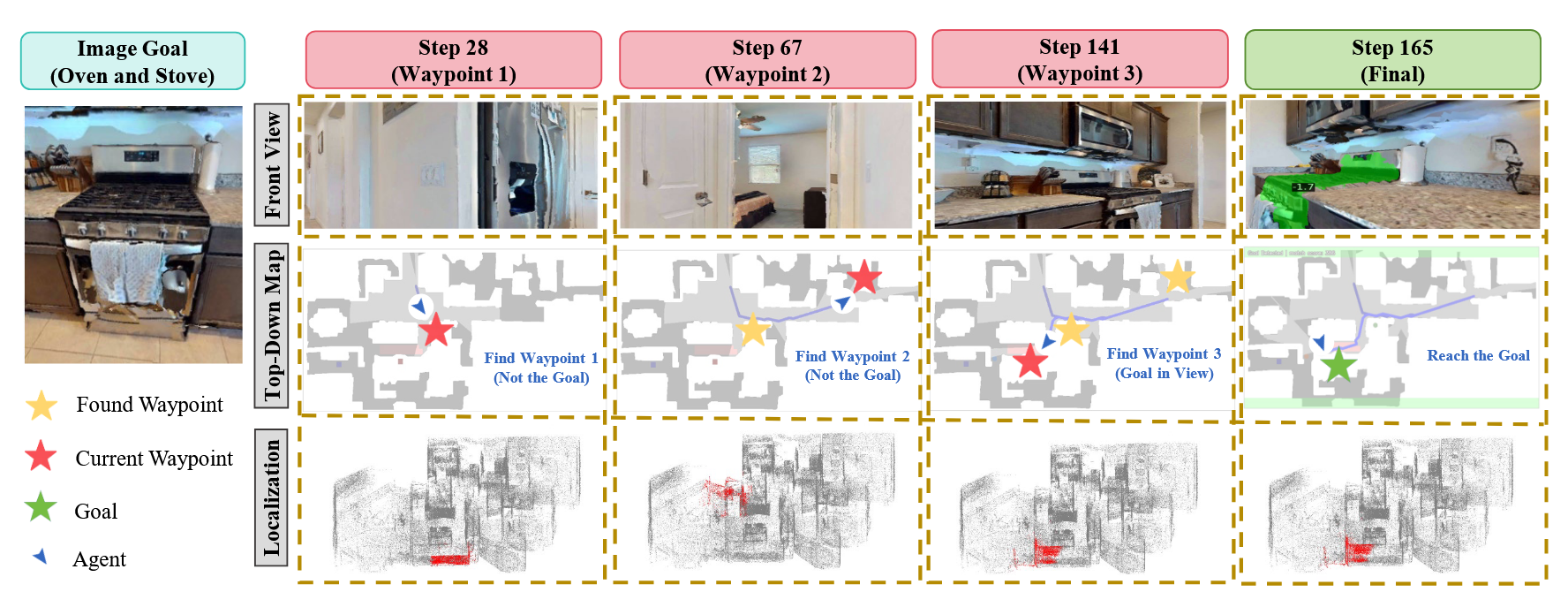

GaussNav首次将3D Gaussian Splatting(3DGS)引入具身视觉导航,提出语义高斯地图表示:

前沿探索(Frontier Exploration):

- 智能体同时维护探索地图和障碍地图,探索地图标记已探索区域,障碍地图标记场景中的障碍物

- 检测探索地图轮廓并排除障碍地图区域,将最近的前沿点设为路径点,迭代覆盖整个环境

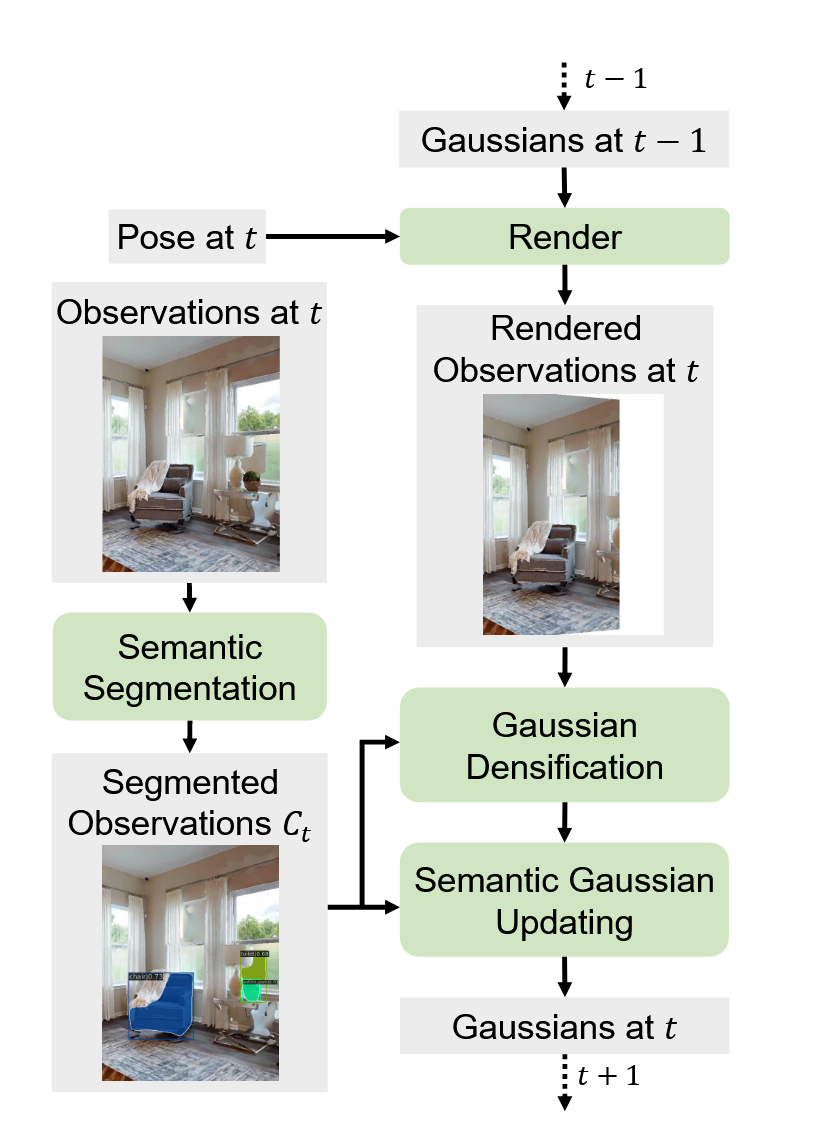

语义高斯构建(Semantic Gaussian Construction):

几何重建:

- 3DGS简化表示:每个高斯由9个参数特征化:RGB颜色向量c、质心µ∈R³、半径r、不透明度o∈[0,1]、类别标签l

- 可微渲染:通过alpha合成渲染RGB、深度和轮廓图像,支持新视角合成(NVS)

- 关键帧检索机制:针对导航场景帧间重叠有限问题,存储历史帧并周期性渲染评估PSNR,优先优化低保真帧,采用两阶段优化(p1=30迭代新视点,p2=60迭代关键帧视点)

语义特征注入:

- 实例分割:使用Mask-RCNN为每个高斯分配语义标签

- 特征优化:通过特征splatting渲染逐像素语义特征,优化特征损失以鼓励实例内一致性和实例间可分性

- 高斯聚类:基于语义标签和3D位置聚类高斯,将场景中的对象分割为不同语义类别下的不同实例

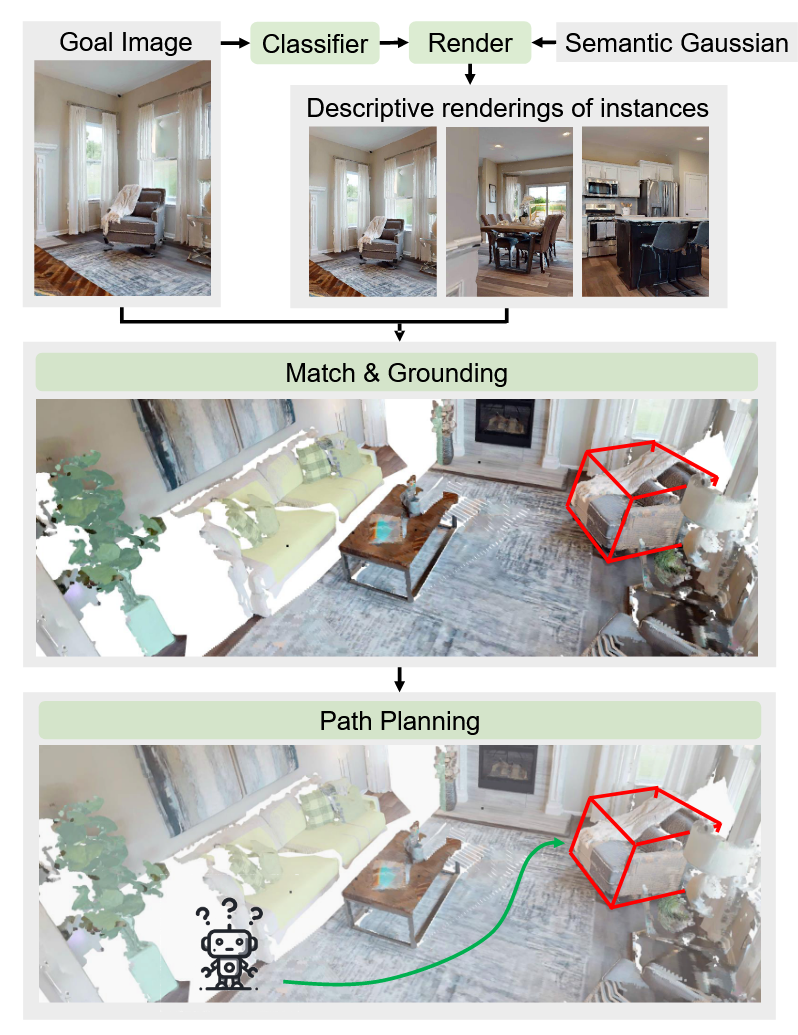

高斯导航(Gaussian Navigation):

- 分类器:使用ResNet50对目标图像分类预测语义标签ˆlg,显著缩小搜索空间(如场景CrMo8WxCyVb从648个潜在观测减少到33个)

- 匹配与定位:

- 为每个候选实例通过NVS生成描述性图像(nv=1/3/5,θ=±15°/±30°水平和垂直旋转)

- 使用DISK提取关键点和特征描述符,通过LightGlue匹配,选择匹配关键点数最多的候选对象

- 使用DBSCAN聚类去除语义分割误差导致的离群点,精确定位目标实例

- 路径规划:将语义高斯转换为点云并体素化投影到2D BEV网格,使用FMM生成最短距离场并规划路径

创新要点:

- 统一几何、语义和实例感知特征的地图表示,首次将3DGS应用于具身视觉导航

- 通过渲染描述性图像直接定位目标对象,无需额外探索或验证步骤

- 关键帧检索机制有效缓解导航场景中的遗忘和表面空洞问题

核心结果/发现

- HM3D数据集性能:SPL从0.347大幅提升至0.578(提升66.6%),成功率达72.5%,显著超越所有基线方法

- 效率优势:运行帧率超过20 FPS,在模块化方法中效率最高,搜索空间优化显著(如CrMo8WxCyVb场景从648个观测点减少至33个)

- 消融实验验证:

- 移除分类器导致Success降至37.5%,SPL降至29.1%,但使用分类器后匹配时间减少2.5倍

- 移除匹配模块Success降至44.4%,SPL降至35.3%

- NVS对识别成功率有益,GT NVS可进一步提升性能(Success从72.3%升至74.7%)

- 使用GT匹配模块Success提升至85.0%,GT目标定位Success达94.6%

- 渲染质量分析:在HM3D验证集上PSNR最高可达40,深度渲染误差接近零,但部分高纹理场景重建质量欠佳

- 跨场景泛化:在36个验证场景中表现稳定,语义高斯可视化展示了对多种场景复杂度和对象组成的鲁棒性

局限性

当前方法在高纹理环境中重建质量欠佳,导致NVS可能产生孔洞等伪影。错误源分析显示匹配失败和目标定位不准确仍有改进空间。语义高斯不适合直接路径规划,需转换为2D BEV网格,增加了计算开销。

9. VLFM (2023)

——Vision-Language Frontier Maps for Zero-Shot Semantic Navigation

📄 Paper: arXiv:2312.03275

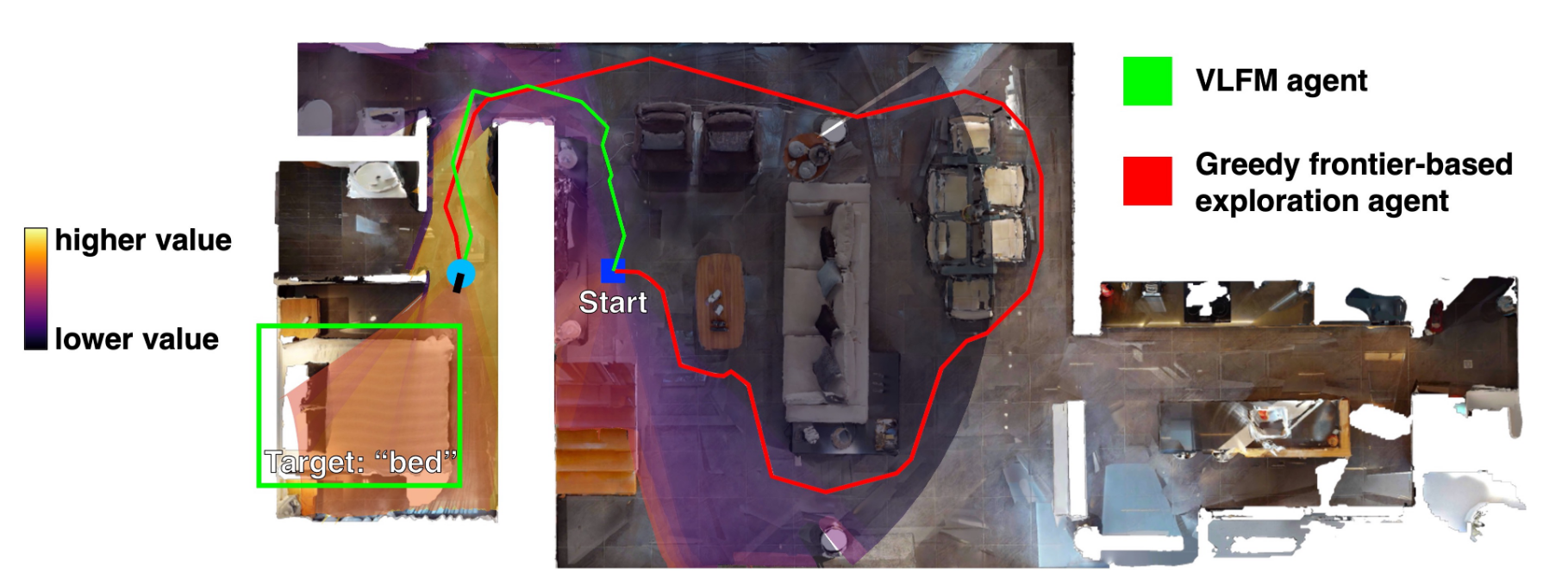

研究背景/问题 零样本语义导航要求机器人在未见环境中高效定位目标对象,现有方法(如ESC、SemUtil)依赖物体检测器将视觉线索转化为文本后再用LLM/BERT进行语义推理,存在计算瓶颈且无法充分利用视觉-语言联合表征。如何直接从RGB观测中提取语义价值以指导前沿探索成为关键挑战。

主要方法/创新点

VLFM提出语言驱动的前沿价值图框架,实现端到端视觉-语义推理:

核心机制:

- 前沿航点生成(Frontier Waypoint Generation)

- 利用深度和里程计构建2D占用地图,识别已探索与未探索区域边界作为前沿候选点

- 每个前沿中点作为潜在导航航点

- 价值图生成(Value Map Generation)

- 使用预训练BLIP-2视觉-语言模型直接从RGB图像计算语义价值分数

- 文本提示:”Seems like there is a

ahead" - 输出余弦相似度分数并投影到俯视图价值图(双通道:语义分数+置信度分数)

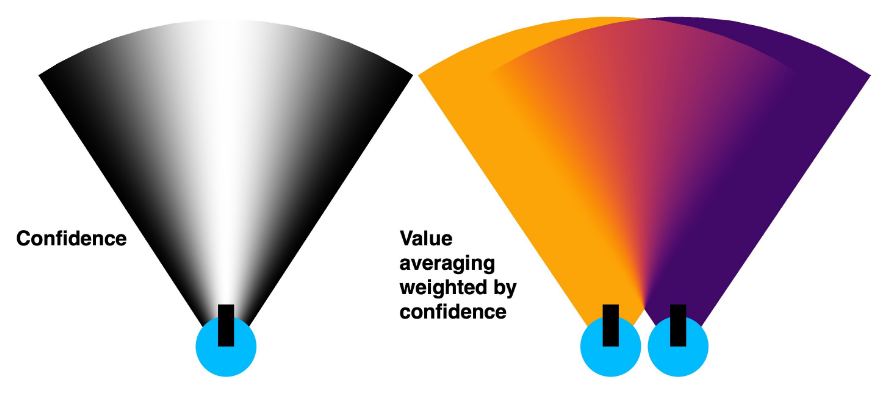

- 置信度加权更新(Confidence-Weighted Averaging)

- 置信度分数基于像素相对光轴位置:$c_{i,j} = \cos^2(\theta/(\theta_{fov}/2) \times \pi/2)$

- 重叠区域的语义值更新:$v_{i,j}^{new} = (c_{i,j}^{curr}v_{i,j}^{curr} + c_{i,j}^{prev}v_{i,j}^{prev})/(c_{i,j}^{curr} + c_{i,j}^{prev})$

- 置信度更新偏向高置信值:$c_{i,j}^{new} = ((c_{i,j}^{curr})^2 + (c_{i,j}^{prev})^2)/(c_{i,j}^{curr} + c_{i,j}^{prev})$

- 物体检测与导航

- YOLOv7用于COCO类别,Grounding-DINO用于开放词汇检测

- Mobile-SAM提取目标轮廓,确定最近点作为目标航点

- 使用VER训练的PointNav策略执行航点导航(纯几何理解,不依赖语义)

关键创新:

- 直接视觉-语义推理:绕过物体检测器,BLIP-2直接从RGB生成语义分数

- 空间化价值表征:将语义价值映射到俯视图网格,支持前沿选择

- 置信度驱动融合:动态平衡当前观测与历史信息

核心结果/发现

- 基准测试表现:在Gibson、HM3D、MP3D三个数据集上均达到SOTA零样本性能

- Gibson:SPL 52.2%、SR 84.0%(相比SemUtil提升+11.7% SPL、+14.7% SR)

- HM3D:SPL 30.4%、SR 52.5%(相比ESC提升+8.1% SPL、+13.3% SR)

- MP3D:SPL 17.5%、SR 36.4%(相比ESC提升+3.3% SPL、+7.7% SR)

- 超越部分有监督方法:在Gibson和MP3D数据集上优于SemExp、PONI等ObjectNav训练方法

- 消融实验:置信度加权平均(Weighted avg.)在所有数据集上均优于简单替换(Replacement)和无权平均(Unweighted avg.)

- 真实世界部署:成功在Boston Dynamics Spot机器人上部署,在办公楼环境中高效导航至未见目标对象,所有模型(BLIP-2、GroundingDINO、MobileSAM、ZoeDepth)实时运行于RTX 4090 MaxQ笔记本

局限性 仅支持单层楼导航(缺少z坐标里程计导致价值图重置困难),HM3D和MP3D中14.6%和9.6%的跨楼层任务失败;假定目标物体在默认相机高度可见,未来可探索主动相机控制、操作式搜索(如打开抽屉)及可复用的语义地图表征以支持长时程多任务规划。

10. Motus (2025)

——A Unified Latent Action World Model

📄 Paper: arXiv:2512.13030

研究背景/问题

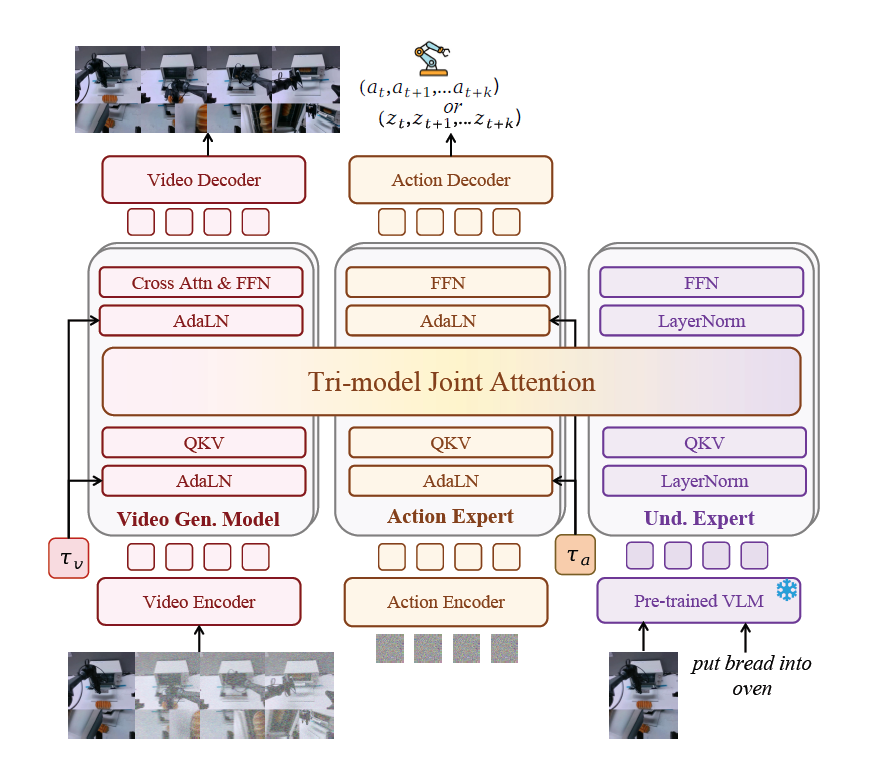

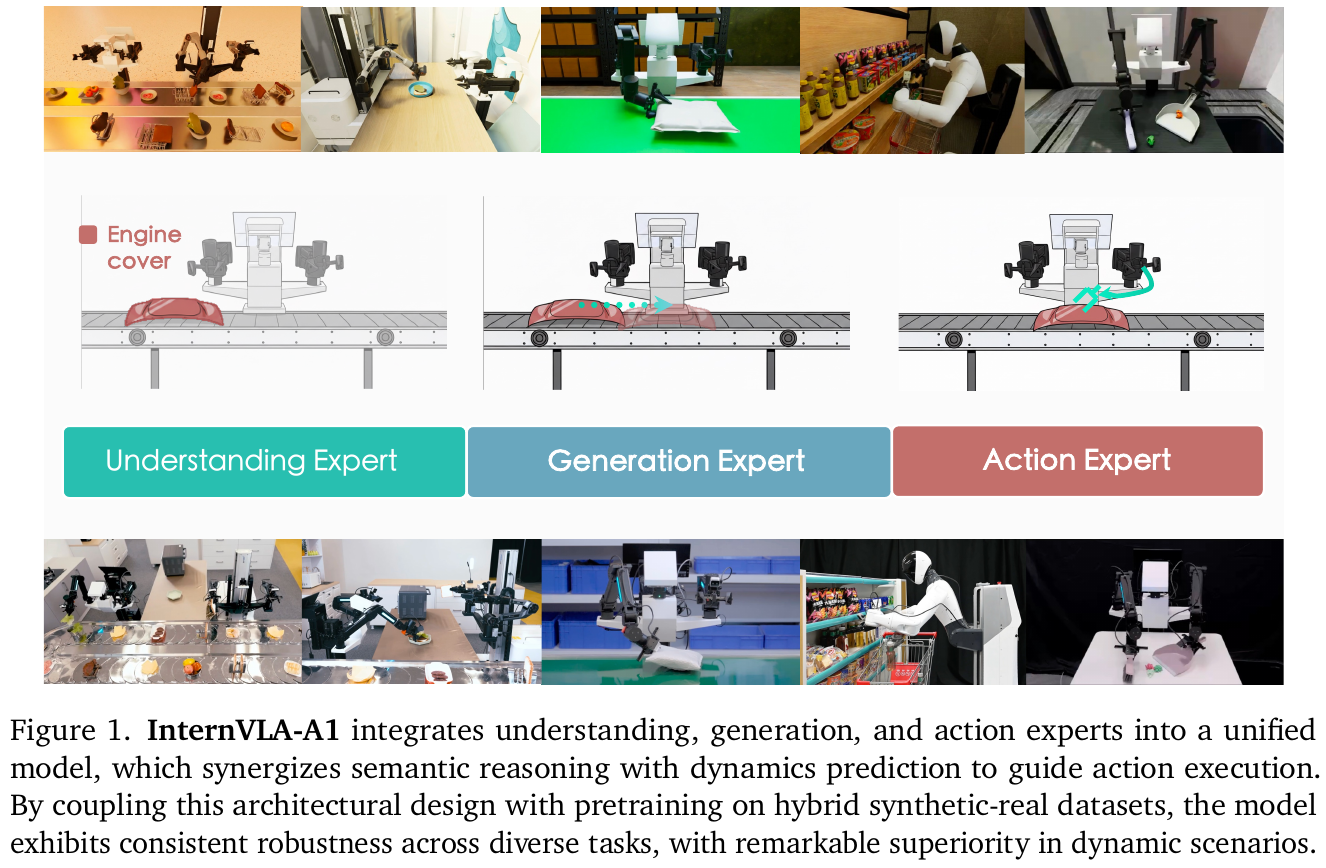

当前具身智能体的理解、世界建模和控制能力被孤立地建模在不同模型中,这种碎片化阻碍了统一多模态生成能力的实现,也限制了从大规模异构数据中学习。现有方法将本应统一的系统分割为5个独立的建模任务:VLA(视觉-语言-动作模型)、WM(世界模型)、IDM(逆动力学模型)、VGM(视频生成模型)和视频-动作联合预测模型。两个核心挑战包括:如何在单一框架中统一这些多模态生成能力,以及如何利用大规模异构数据(互联网视频、自我中心人类演示、多机器人轨迹)进行动作专家的预训练。

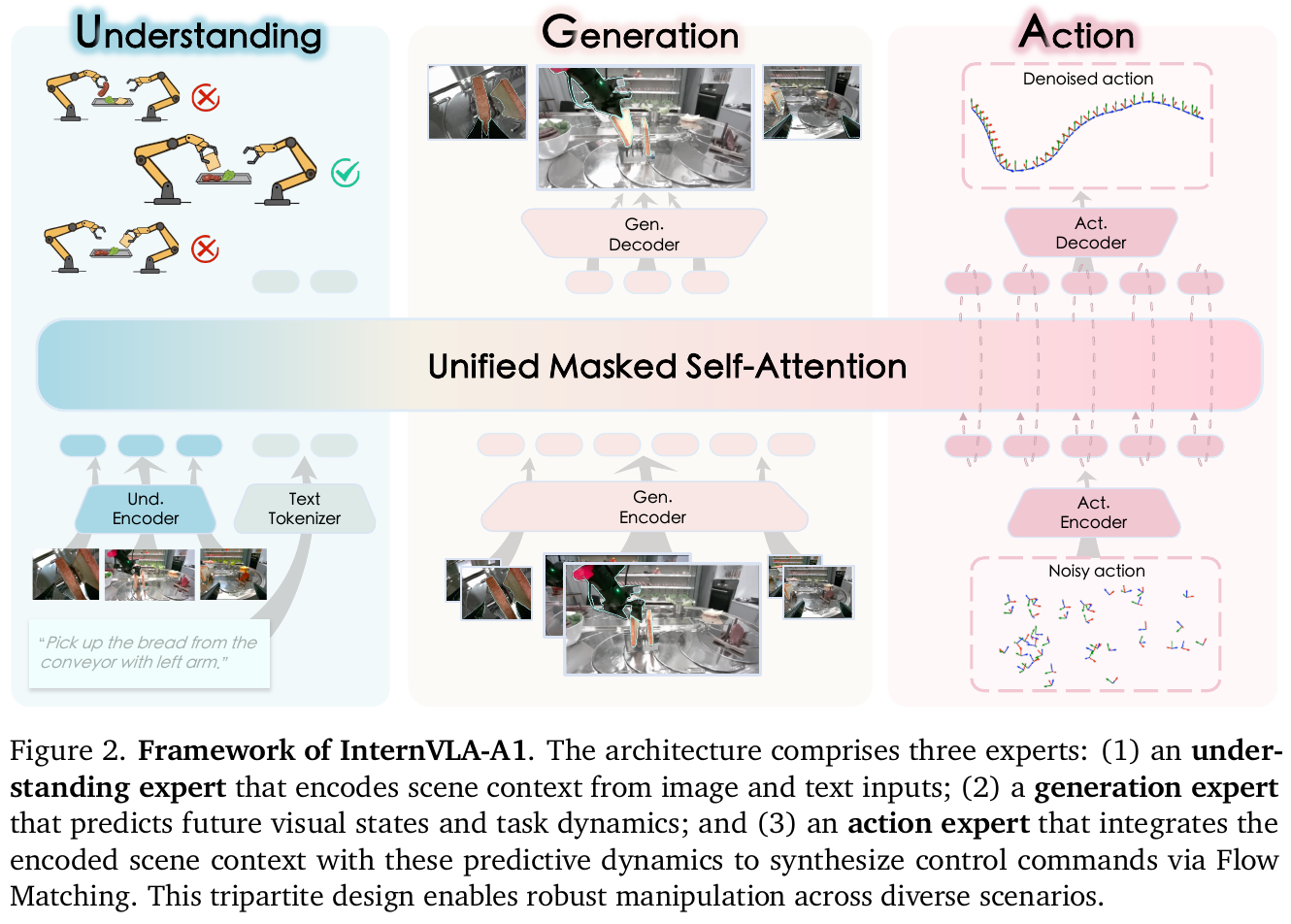

主要方法/创新点

Motus提出了统一的潜在动作世界模型,通过以下创新实现五种建模范式的融合:

1. Mixture-of-Transformer (MoT)架构:

- 三模态联合注意力(Tri-model Joint Attention):将三个专家的多头自注意力层连接起来,在保留各专家特定功能的同时实现跨模态知识融合

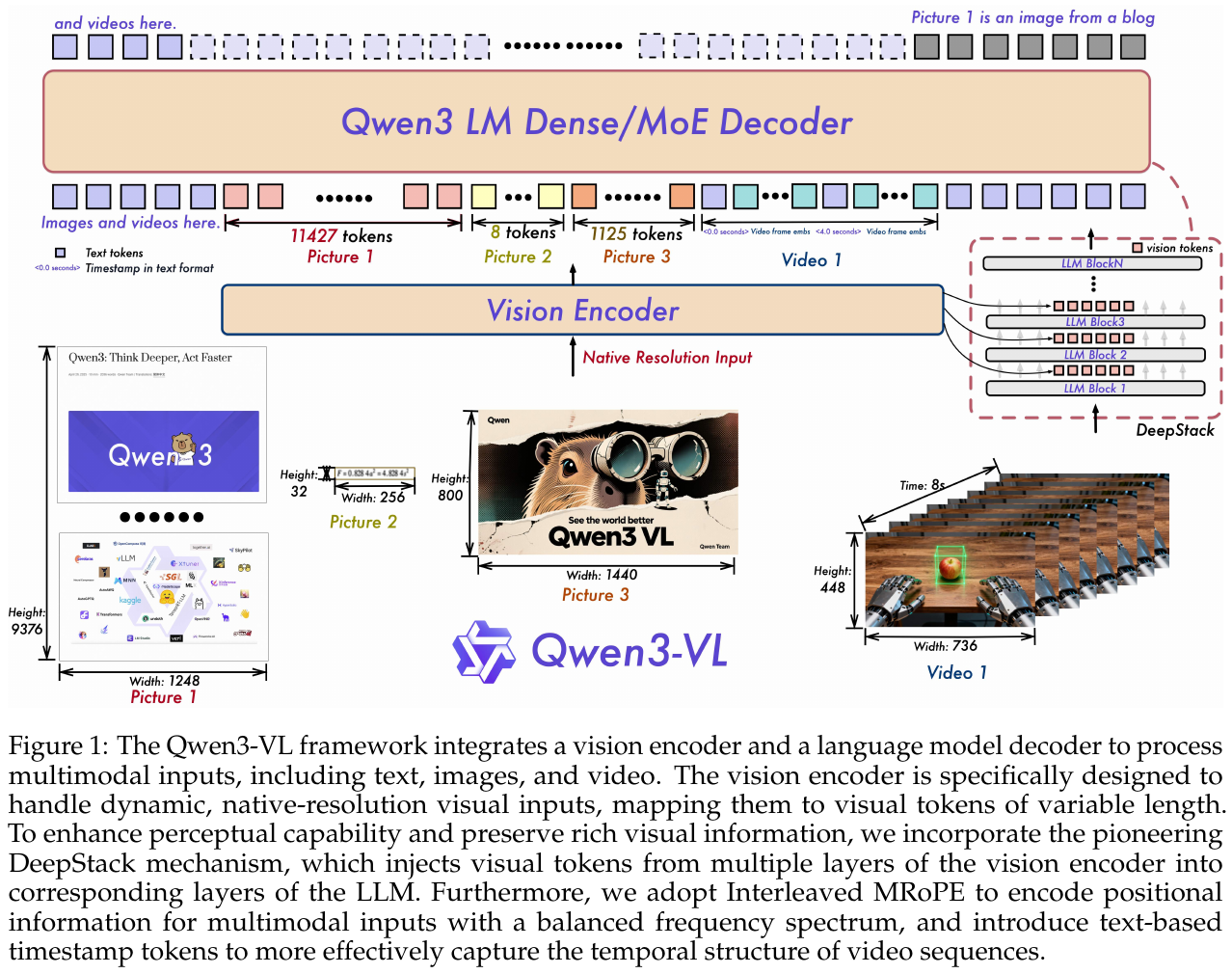

- 理解专家(Understanding Expert):基于Qwen3-VL-2B(253.5M参数),具备3D定位和空间理解能力

- 视频生成专家(Video Generation Expert):采用Wan 2.2 5B作为视频基础模型

- 动作专家(Action Expert):Transformer结构(641.5M参数),与Wan相同深度

- 总模型规模:8B参数(VGM 5.00B + VLM 2.13B + Act Expert 641.5M + Und Expert 253.5M)

2. UniDiffuser式调度器:

- 为视频和动作分配不同的时间步τ_o、τ_a和噪声尺度

- 支持五种推理模式的灵活切换:VLA、世界模型、IDM、VGM、视频-动作联合预测

- 使用rectified flow目标函数:

- \[l_{\text{action}} = \mathbb{E} \left[ \left\| v^{\theta_a} - (\epsilon_a - a_{t+1:t+k}) \right\|^2 \right]\]

- \[l_{\text{obs}} = \mathbb{E} \left[ \left\| v^{\theta_o} - (\epsilon_o - o_{t+1:t+k}) \right\|^2 \right]\]

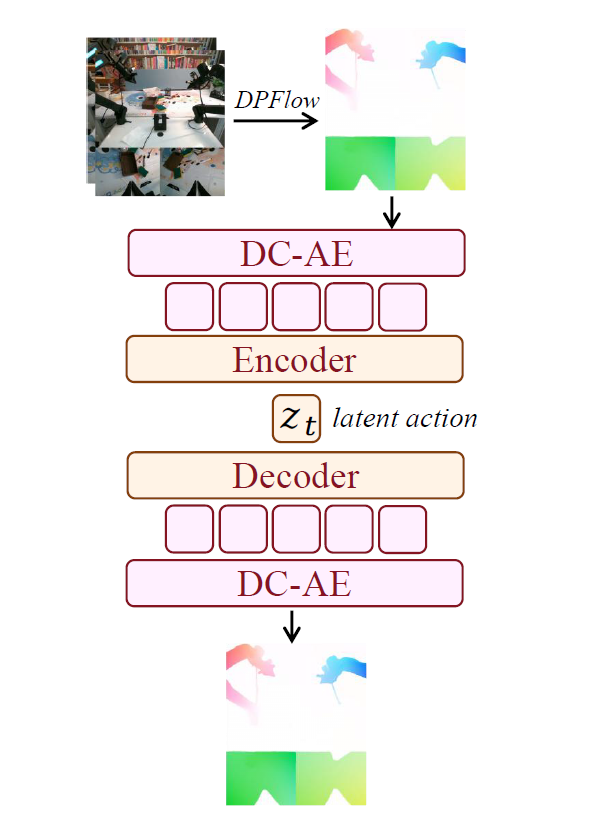

3. 潜在动作(Latent Actions) - 像素级”增量动作”:

- 光流表示:使用DPFlow计算光流作为通用运动表示,将其转换为RGB图像

- 深度压缩自编码器(DC-AE):将高维光流压缩为4×512维token,再通过轻量级编码器投影到14维潜在动作向量

- 训练策略:混合90%无标注数据(自监督重建)+10%有标注轨迹(任务无关数据+标准演示)

- 分布对齐:引入任务无关数据(AnyPos方法),使用Curobo随机采样目标机器人动作空间

- 损失函数:\(\mathcal{L} = \mathcal{L}_{\text{recon}} + \lambda_a \left\| a_{\text{real}} - a_{\text{pred}} \right\|^2 + \beta \mathcal{L}_{\text{KL}}\)

4. 动作密集-视频稀疏预测策略:

- 视频帧率:8帧 @ 5Hz

- 动作块:48步 @ 30Hz

- 通过下采样视频帧平衡token数量,防止过拟合视频预测而削弱动作预测能力

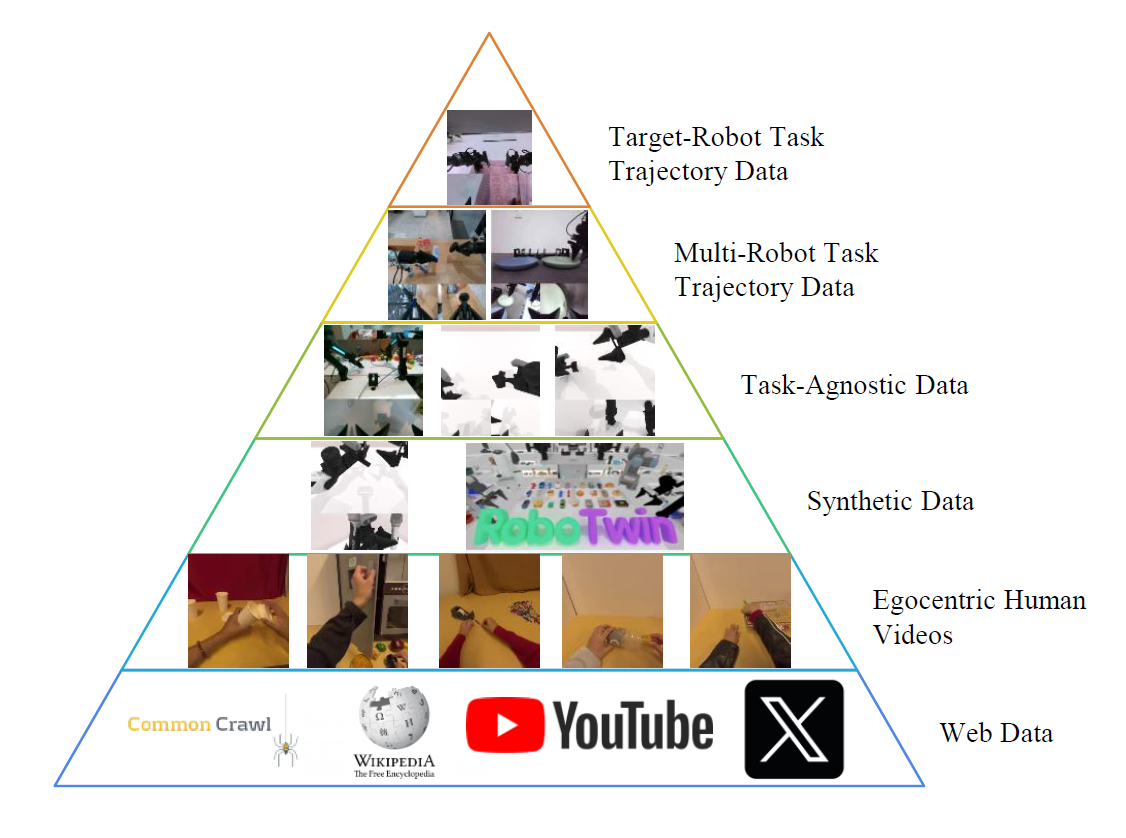

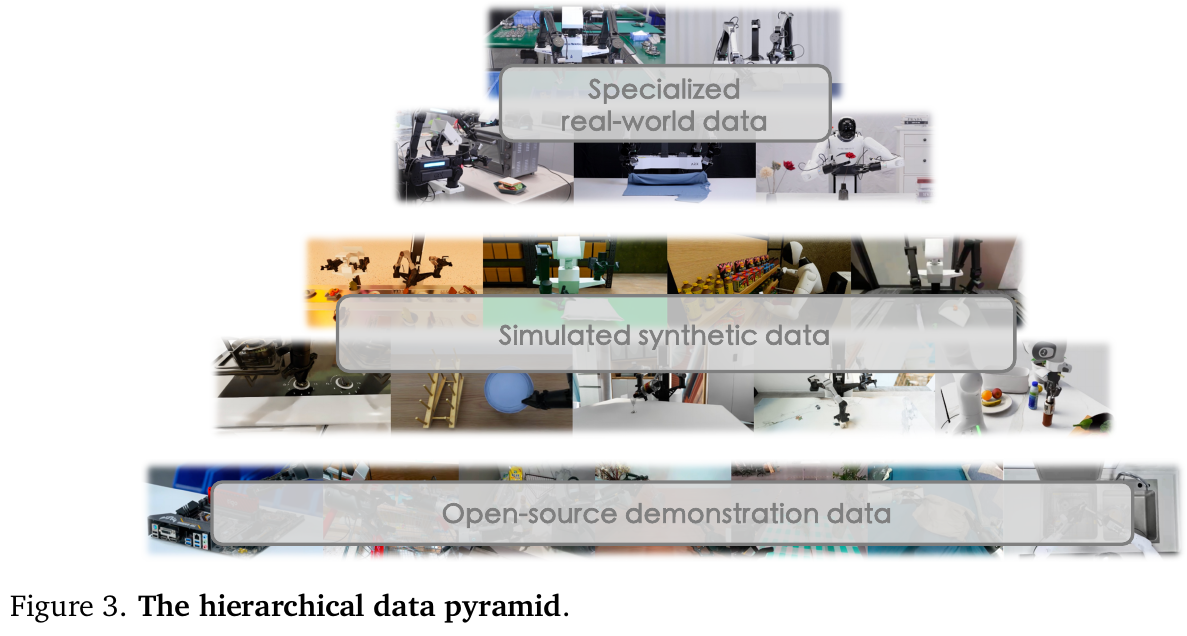

5. 三阶段训练流程:

- 阶段1(视频生成):使用多机器人轨迹、自我中心人类视频和合成数据适配VGM(仅训练VGM,约8000 GPU小时)

- 阶段2(潜在动作统一训练):冻结VLM,在视频、语言和潜在动作上预训练整个Motus模型(约10000 GPU小时)

- 阶段3(监督微调):在目标机器人数据上使用真实动作微调(约400 GPU小时)

6. 六层数据金字塔:

- Level 1: Web数据(VGM和VLM预训练)

- Level 2: 自我中心人类视频(Egodex: 230,949样本)

- Level 3: 合成数据(RoboTwin: 27,500样本)

- Level 4: 任务无关数据(AnyPos: 1,000样本)

- Level 5: 多机器人任务轨迹数据(Agibot: 728,209 + RDT: 6,083 + RoboMind: 16,861)

- Level 6: 目标机器人任务轨迹数据(In-house: 2,000样本)

核心结果/发现

仿真环境(RoboTwin 2.0)性能:

- 随机化场景平均成功率:87.02%(Motus) vs 72.84%(X-VLA) vs 43.84%(π0.5)

- 相比X-VLA提升15%,相比π0.5提升45%

- 在50个任务上评估,包含强背景和环境随机化(随机背景、杂乱桌面、桌高扰动、随机光照)

- 清洁场景成功率:88.66%(Motus) vs 72.80%(X-VLA) vs 42.98%(π0.5)

真实世界实验:

- 两个平台:AC-One和Agilex-Aloha-2双臂机器人

- 9个复杂任务:测试空间理解、可变形物体操作、精确流体控制、视觉理解、长时域规划

- 任务包括:叠毛巾、使用滴滤咖啡机煮咖啡、研磨咖啡豆、将面包放入烤箱、从饮水机取水、倒水浇花、按键盘按键

- AC-One平台:平均部分成功率63.22%(Motus) vs 25.86%(无预训练) vs 14.79%(π0.5)

- 突出任务:研磨咖啡豆92% vs 0%(无预训练),煮咖啡62% vs 0%,放立方体入盘100% vs 60%

- Agilex-Aloha-2平台:平均59.30%(Motus) vs 26.60%(无预训练) vs 48.60%(π0.5)

- 突出任务:从饮水机取水96% vs 8%(无预训练),叠毛巾39% vs 0%

其他基准测试:

- LIBERO-Long:97.6%成功率(与X-VLA并列最优,达到state-of-the-art)

- VLABench: In Distribution平均0.48(vs π0.5的0.43),Cross Category平均0.25(vs π0.5的0.22)

消融实验验证:

- 训练阶段重要性:完整Motus(阶段2预训练) 87.02% vs 仅阶段1 81.86%(+10.02%提升)

- IDM模式性能:动作MSE 0.014(Motus) vs 0.044(ResNet18+MLP) vs 0.122(DINOv2+MLP),显著优于专门训练的IDM基线

- VLA模式竞争力:83.90%成功率,与联合模式87.02%性能接近

- 世界模型生成质量:FID 11.209,FVD 61.209,SSIM 0.866,PSNR 25.07(在两个平台上评估)

五种统一模式实证验证: \(\begin{aligned} \text{1. VLA:} & \quad p(a_{t+1:t+k} \mid o_t, \ell) && \text{--- 从观察和语言预测动作} \\ \text{2. 世界模型:} & \quad p(o_{t+1:t+k} \mid o_t, a_{t+1:t+k}) && \text{--- 从当前观察和动作预测未来观察} \\ \text{3. IDM:} & \quad p(a_{t+1:t+k} \mid o_{t:t+k}) && \text{--- 从观察序列推断动作} \\ \text{4. VGM:} & \quad p(o_{t+1:t+k} \mid o_t, \ell) && \text{--- 从观察和语言生成未来视频} \\ \text{5. 联合预测:} & \quad p(o_{t+1:t+k}, a_{t+1:t+k} \mid o_t, \ell) && \text{--- 同时生成视频和动作} \end{aligned}\)

局限性

当前方法需要大量计算资源(总计约18,400 GPU小时训练)。某些复杂任务(如叠毛巾)的性能仍有限,部分成功率仅为39%。尽管通过潜在动作改进了跨具身泛化,但仍需进一步研究。未来工作将探索更先进的统一模型架构,追求更通用的运动先验,并从互联网规模的通用视频中学习潜在动作。此外,需要研究如何降低部署成本并提升模型在极端条件下的鲁棒性。

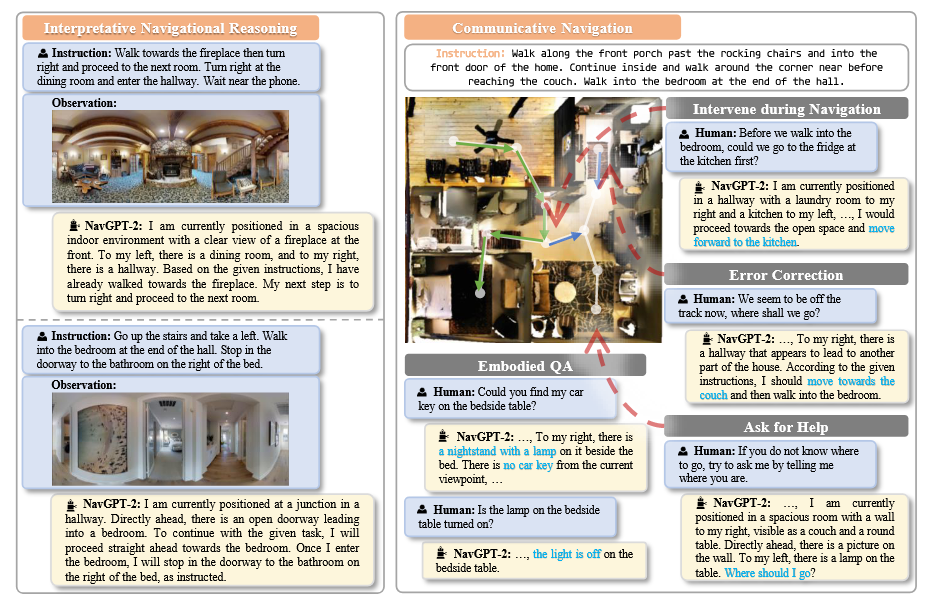

11. NavGPT (2024)

——利用大语言模型进行视觉语言导航的显式推理 📄 Paper: arXiv:2305.16986

研究背景/问题

现有的视觉语言导航(VLN)方法虽然性能较好,但其决策过程是隐式的、不可解释的。大语言模型(LLMs)在训练中展现出强大的推理能力和知识储备,但其在具身导航任务中的推理能力尚未被充分探索。研究的核心问题是:LLMs能否理解以文本形式描述的交互世界、动作及其后果,并利用这些信息解决导航任务?

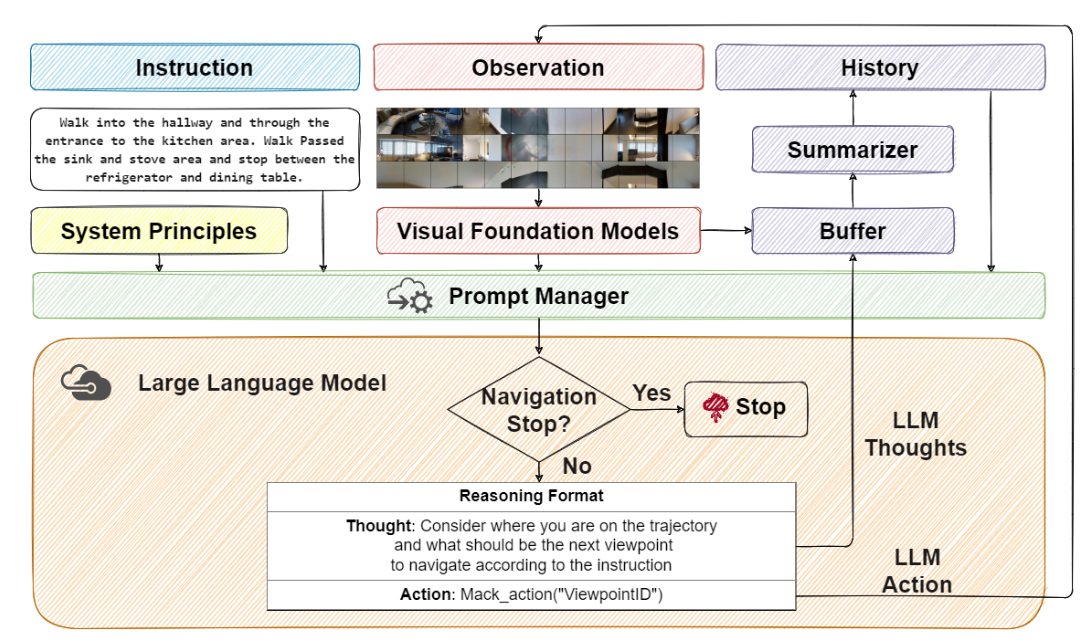

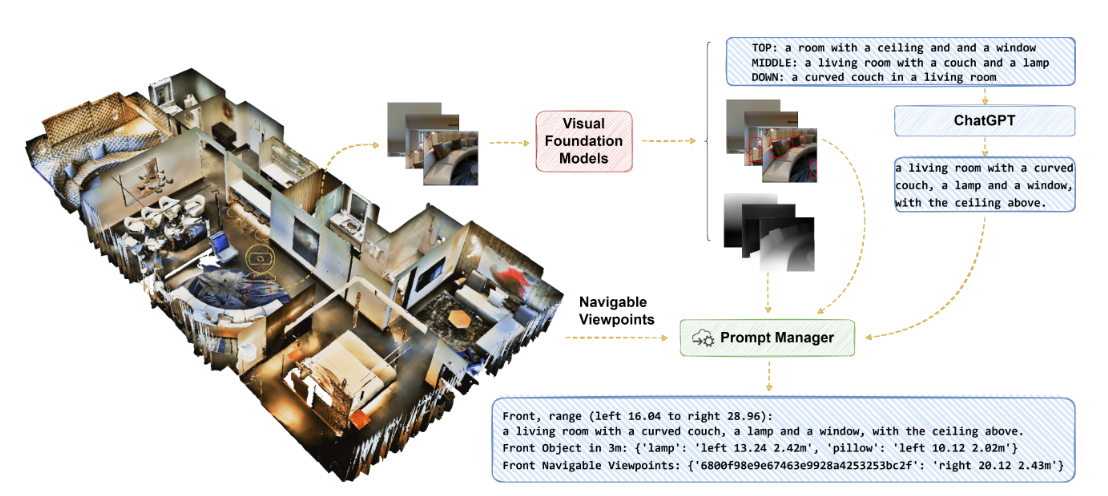

主要方法/创新点

NavGPT是一个完全基于LLM的指令跟随导航系统,通过零样本方式执行视觉语言导航任务。系统包含四个核心组件:

- 导航系统原则(Navigation System Principle): 定义VLN任务和LLM的基本推理格式与规则

- 视觉基础模型(Visual Foundation Models): 使用BLIP-2将视觉观察转换为自然语言描述,使用Faster-RCNN检测物体并提取深度信息

- 导航历史(Navigation History): 维护观察、推理和动作的三元组历史,使用GPT-3.5进行摘要以控制长度

- 提示管理器(Prompt Manager): 将所有信息整合为LLM可理解的自然语言提示

关键创新在于协同推理与动作(Synergizing Reasoning and Actions):

- 扩展动作空间为 A˜ = A ∪ R,其中R为推理轨迹

- 在每步导航前先生成推理(Thought),再做出动作决策(Action)

- 推理不触发环境交互,但能增强LLM的问题解决能力

NavGPT展现出多种高级导航规划能力:

- 将指令分解为子目标

- 整合与导航相关的常识知识

- 从观察场景中识别地标

- 跟踪导航进度

- 处理异常情况并调整计划

核心结果/发现

在R2R val unseen数据集上的实验结果(使用GPT-4):

- Success Rate (SR): 34%

- SPL: 29%

- Oracle Success Rate (OSR): 42%

虽然与训练模型仍有约40%的性能差距,但NavGPT展示了LLM的强大能力:

- 高级规划能力: 能够分解指令、识别地标、跟踪进度、适应异常

- 生成能力: 可根据导航历史生成高质量的导航指令

- 空间意识: 能够绘制准确的俯视图轨迹

人类评估显示LLM生成的推理质量可接受但仍有提升空间(准确性1.66/3.0,信息量1.93/3.0,合理性1.78/3.0)。

局限性

主要瓶颈在于:(1)视觉信号转换为自然语言时的信息损失;(2)历史观察摘要时的信息损失;(3)零样本性能与训练模型相比仍有较大差距(SR差距约40%)。未来方向建议采用多模态输入的LLMs或利用LLMs的高级推理能力来增强基于学习的模型。

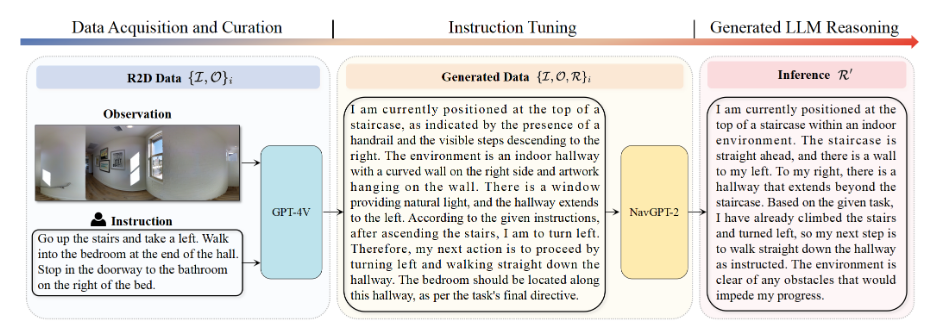

12. NavGPT-2 (2024)

——释放大型视觉语言模型的导航推理能力 📄 Paper: arXiv:2407.12366

研究背景/问题

虽然有将LLMs集成到VLN任务的努力,但存在两个极端方法的局限:(1)零样本方法依赖复杂的提示工程,存在信息损失且性能差距大(约40% SR);(2)微调方法虽然使用大规模LLMs,但性能仍落后于VLN专用模型,且丧失了LLMs的语言能力和可解释性。研究目标是在保持LLMs解释能力的同时,消除LLM-based agents与SOTA VLN专用模型之间的性能差距。

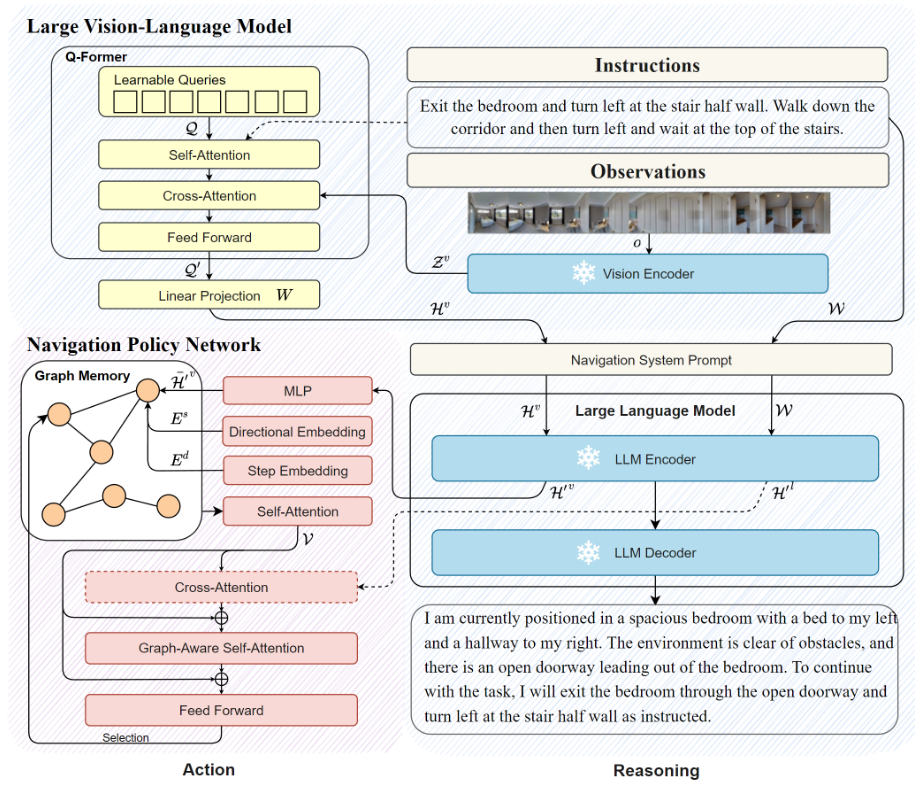

主要方法/创新点

NavGPT-2采用冻结LLM + 导航策略网络的混合架构,分两阶段训练:

阶段一:视觉指令调优(Visual Instruction Tuning)

- 基于InstructBLIP架构,使用Q-former将多视图图像编码为固定长度的视觉tokens

- 使用GPT-4V自动生成10K导航推理数据

- 仅微调Q-former和投影层,保持LLM和视觉编码器(EVA-CLIP ViT-g/14)冻结

阶段二:图基础导航策略学习

- 提取LLM隐藏层表示作为视觉-语言表征

- 采用拓扑图导航策略网络(源自DUET),包含:

- 节点嵌入(Node Embedding):整合视觉特征、方向嵌入、步数嵌入

- 跨模态编码(Cross-Modal Encoding):图感知自注意力(GASA)机制

- 全局动作预测(Global Action Prediction):从整个构建的图中选择下一步

- 使用DAgger损失训练,保持VLM冻结

关键创新点:

- VLM隐表示作为视觉-语言表征:将视觉特征投影到LLM的语言空间,实现更强的跨环境对齐

- 数据高效:利用LLM预训练权重,在50%数据量下即可达到DUET全量数据的性能

- 保留语言能力:冻结LLM使其保持生成导航推理和与人类交互的能力

核心结果/发现

在R2R数据集上的性能(NavGPT-2FlanT5-XXL, 5B参数):

| Split | SR | SPL | NE | OSR |

|---|---|---|---|---|

| Val Unseen | 71% | 60% | 3.18 | 80% |

| Test Unseen | 72% | 60% | 3.33 | 80% |

主要发现:

- 消除性能差距:在相同训练规模下,超越所有LLM-based方法,与DUET(SOTA VLN专用模型)性能相当

- 数据效率:使用50% R2R数据即可达到DUET使用全量数据的性能

- 泛化能力:

- RxR数据集(细粒度指令):SR提升3.67%

- HM3D数据集(未见环境):SR提升21.6%(47.2% vs 25.6%)

- 可解释性:能够生成描述周围环境、识别导航进度、规划下一步的自然语言推理

消融实验表明:

- 移除导航策略网络后性能大幅下降(SR从68%降至21%)

- FlanT5系列模型优于Vicuna系列(编码器-解码器架构优于纯解码器架构)

- 更强的视觉编码器对性能提升有限,主要增益来自LLM隐表示

局限性

(1)导航推理基于局部观察,未在VLM中建模历史,一致性有待提高;(2)推理与动作预测未严格同步;(3)存在幻觉问题(识别不存在的物体或误判方向);(4)交互能力未经充分评估。未来工作应聚焦于推理-动作同步机制、历史建模以及交互导航能力的开发。

系列对比总结

| 维度 | NavGPT (AAAI-2024) | NavGPT-2 (ECCV-2024) |

|---|---|---|

| 核心思路 | 纯LLM零样本导航 | 冻结LLM + 微调导航策略 |

| 训练方式 | 无需训练(零样本) | 两阶段训练(VLM微调+策略学习) |

| 性能(R2R SR) | 34% | 72% (test unseen) |

| 推理能力 | 显式,基于提示工程 | 显式,基于指令调优 |

| 主要贡献 | 揭示LLM导航推理能力 | 消除LLM-agent与SOTA的性能差距 |

| 局限 | 性能差距大,信息损失严重 | 推理-动作同步不足,存在幻觉 |

两篇工作共同展示了LLMs在具身导航中的巨大潜力,从探索性的零样本方法发展到实用的混合架构,为构建可解释、可交互的通用导航智能体指明了方向。

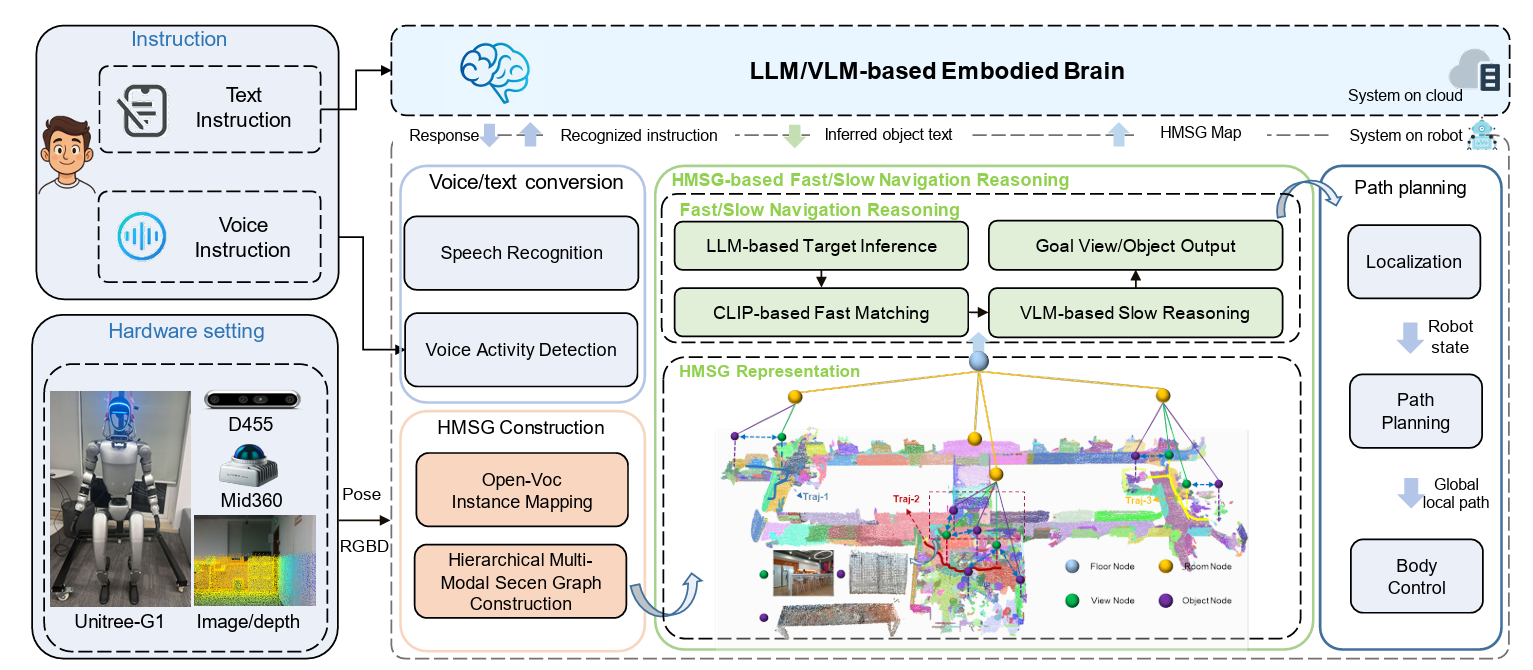

13. FSR-VLN (2025)

——基于层次化多模态场景图的快慢推理视觉语言导航

📄 Paper: arXiv:2509.13733

研究背景/问题

视觉语言导航(VLN)是具身智能中的基础任务,但现有方法在长距离空间推理方面存在严重局限,特别是在长距离导航任务中表现出较低的成功率和较高的推理延迟。关键瓶颈在于缺乏持久的长距离空间记忆来编码、组织和检索环境知识。现有几何语义地图和3D场景图依赖预提取的视觉特征,缺乏与VLM的直接交互;而基于图像的拓扑方法虽然成功率高,但由于依赖视频字幕处理长序列而效率低下。

主要方法/创新点

FSR-VLN提出了结合两大核心创新的新型导航系统:

1. 层次化多模态场景图(HMSG)表示

HMSG将环境组织为四个层级:

- 楼层节点(Floor nodes):存储楼层标识符、名称、最小/最大高度、PLY点云以及所含房间节点的引用

- 房间节点(Room nodes):包含ID、2D多边形边界、点云、语义属性(名称、CLIP嵌入)以及关联的视图和对象节点链接

- 视图节点(View nodes)(新颖贡献):表示房间内的特定视觉视角,存储CLIP嵌入、VLM生成的描述、相机位姿以及与对象的可见性关系。该层支持使用VLM对图像视图进行推理,同时增强对象级定位能力

- 对象节点(Object nodes):表示离散实例,具有几何属性(3D边界框、点云)、语义嵌入以及与父房间和可见视图的链接

每个节点编码多模态特征,包括几何属性、语义信息和拓扑连接。HMSG使用FAST-LIVO2 SLAM系统提取RGBD数据和位姿来构建,然后进行开放词汇实例映射。GPT-4o从图像视图推断房间名称,系统计算每个对象的平均深度以选择最佳代表视图。

2. 快慢导航推理(FSR)

受人类认知双过程理论启发,FSR分三个阶段运行:

阶段1:基于LLM的用户指令理解

- 对于空间指令(如”办公室里的蓝色圆柱形凳子”):LLM充当层次化概念解析器,将输入分解为楼层、区域和对象组件

- 对于非空间指令(如”我累了”):LLM充当目标推理代理,根据用户意图识别最相关的对象或区域

阶段2:快速匹配(直觉检索)

- 在查询文本与HMSG视图层嵌入之间进行基于CLIP的相似度匹配以识别目标视图

- 并行进行对象级匹配,使用查询文本与对象嵌入之间的CLIP特征

- 通过层次化特征匹配高效检索候选房间、视图和对象

阶段3:慢速推理(深思熟虑的精化)

- VLM(GPT-4o)验证匹配的对象是否出现在其最佳视图中

- 如果验证失败,系统会:

- 使用LLM对未匹配视图的文本描述进行推理

- 比较快速匹配视图与LLM选择的视图

- 应用VLM推理确定最终最优目标图像

- 通过重新计算与最终视图中对象的CLIP相似度来更新目标对象

这种多阶段架构无缝集成了高效的特征空间匹配与鲁棒的VLM驱动视觉验证。慢速推理仅在快速直觉失败时激活,大幅减少推理时间的同时提高准确性。

核心结果/发现

FSR-VLN在长距离真实室内环境中对87条机器人采集的指令进行评估,涵盖四个不同类别(无需推理、需要推理、小物体、空间目标):

- 成功率(SR):92%(80/87),显著优于基线方法:

- 比MobilityVLA(34.5%)高167%

- 比OK-Robot(60.9%)高51%

- 比HOVSG(51.7%)高77%

-

检索成功率(RSR@Top1):在4-5米距离阈值下达到96.6%,在所有距离阈值下始终保持最佳性能

- 响应时间:使用慢速推理平均5.5秒,仅使用快速匹配平均1.5秒

- 与MobilityVLM(30秒)相比响应时间减少82%

- 通过仅在快速匹配失败时激活慢速推理,实现高效实时性能

-

HM3D-SEM数据集:RSR@Top1在1米处达到87%,显著优于HOVSG(52%)和osmAG-LLM(28%)

- 消融实验:添加空间目标(ST)指令使RSR从72.4%提升到81.6%,结合导航推理(NR)进一步提升到92%,验证了两个组件的有效性

该系统已成功集成到Unitree-G1人形机器人的语音交互、规划和控制模块中,展示了具备自然语言交互能力的真实世界部署能力。

局限性

HMSG构建耗时,不适合实时建图。系统假设静态环境,限制了在动态场景中的适用性。未来工作将重点提高场景图构建效率、扩展对动态环境的鲁棒性,以及集成探索性导航能力以处理新颖或模糊的场景。

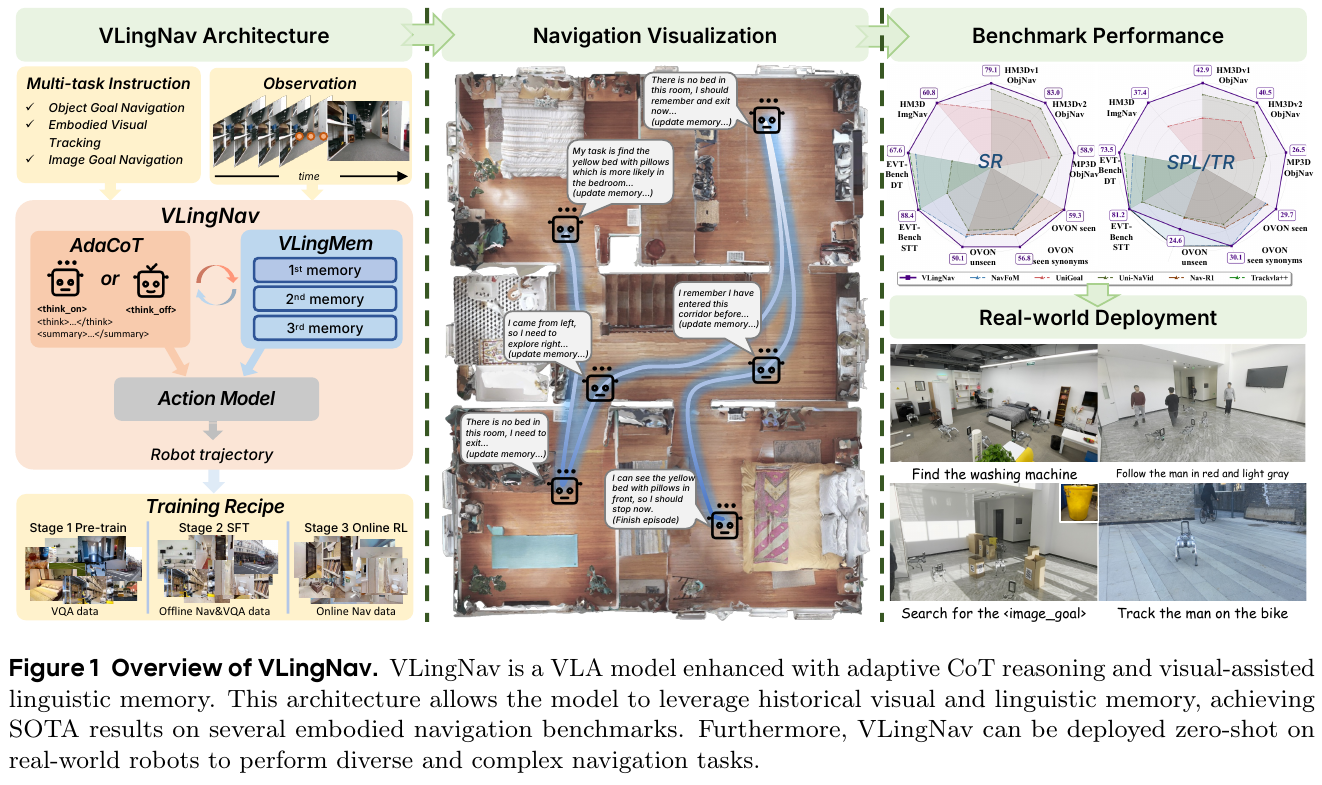

15. VLingNav (2026)

Embodied Navigation with Adaptive Reasoning and Visual-Assisted Linguistic Memory ——A Unified VLA Model with Adaptive CoT and Visual-Assisted Linguistic Memory

📄 Paper: Project Page

精华

该论文提出了VLingNav框架,通过自适应链式思考(AdaCoT)和视觉辅助语言记忆(VLingMem)赋予具身智能体认知能力,实现了高效且可解释的具身导航。其核心亮点在于动态推理机制和跨模态记忆,使其在各种具身导航基准测试中达到SOTA性能,并展示了强大的零样本迁移能力和跨任务泛化能力,为资源受限机器人平台上的智能导航提供了启发。

研究背景/问题

当前的具身导航VLA模型在复杂、长周期任务中缺乏明确的推理能力和持久性记忆,难以泛化到不同环境和任务变体。现有模型多为被动式系统,缺少自适应推理机制,并且依赖有限的上下文窗口,导致在复杂场景下无法有效规划和避免重复探索。

主要方法/创新点

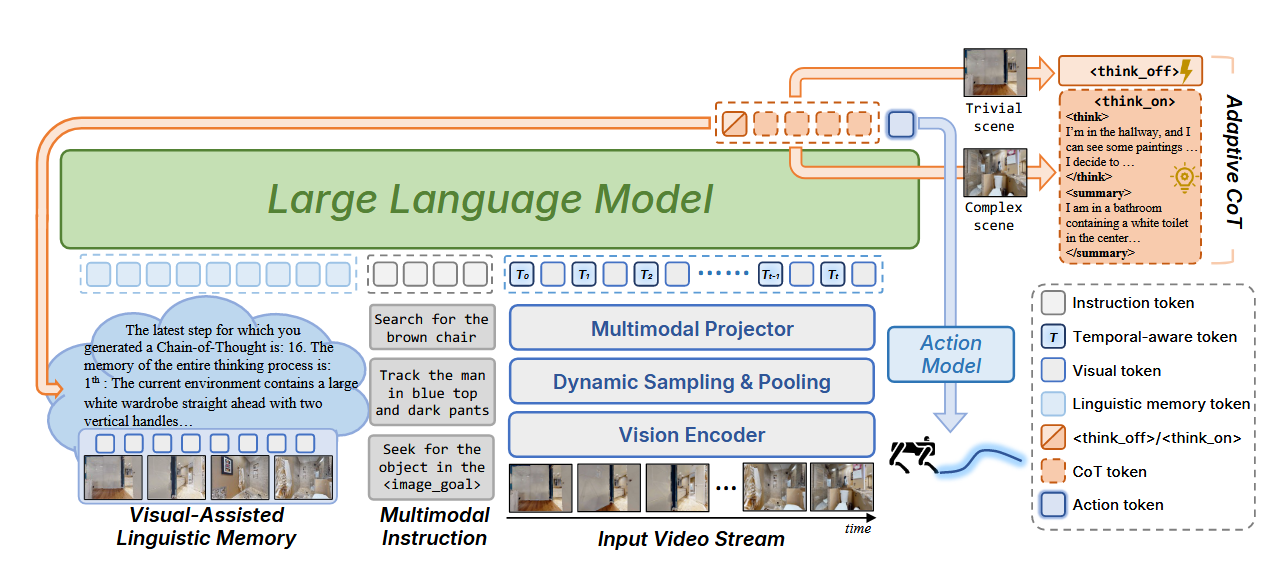

本文提出了VLingNav,一个以语言驱动的VLA框架,旨在通过两个核心组件赋予具身智能体认知能力:

- 自适应链式思考 (Adaptive Chain-of-Thought, AdaCoT): 受人类双进程理论启发,AdaCoT机制在必要时动态触发显式推理,使智能体能够根据任务复杂性在快速、直观执行和缓慢、深思熟虑的规划之间灵活切换。这解决了现有CoT方法中推理频率固定导致效率低下的问题。

- 视觉辅助语言记忆 (Visual-Assisted Linguistic Memory, VLingMem): 为了处理长周期的空间依赖性,VLingMem构建了一个持久的、跨模态的语义记忆,使智能体能够回忆过去的观察结果,防止重复探索,并推断动态环境中的移动趋势,从而确保在长时间交互中的连贯决策。

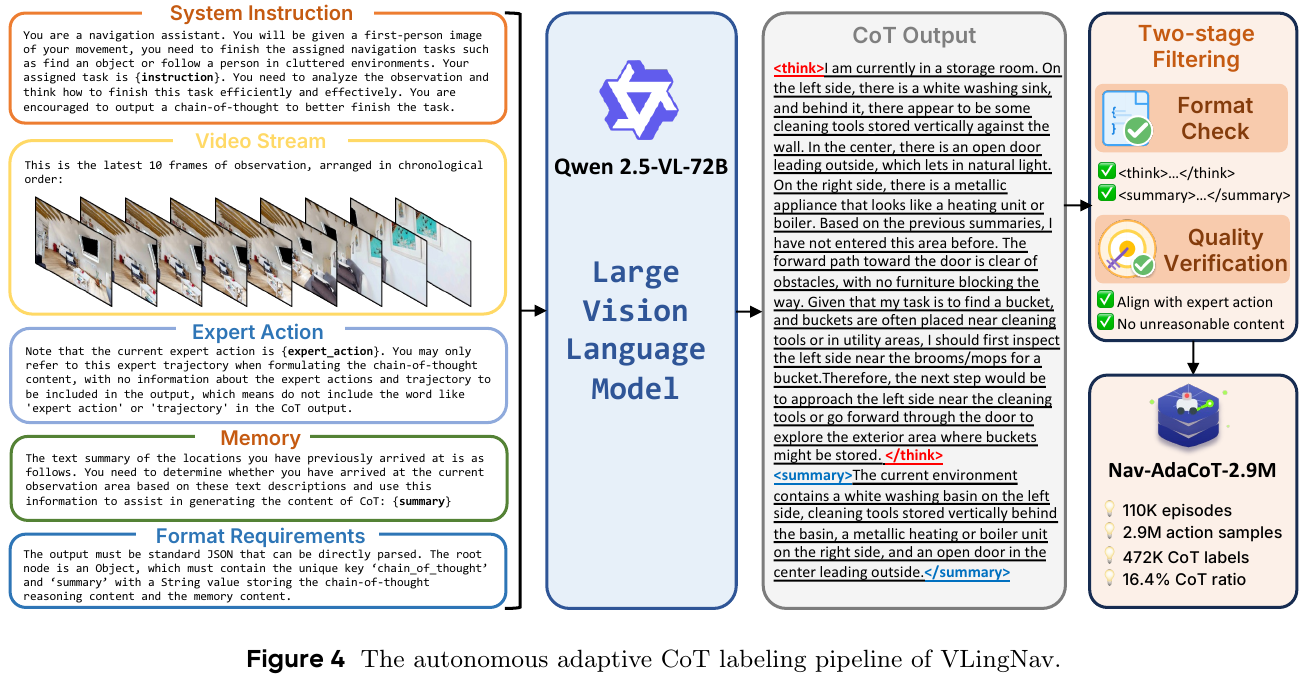

训练数据和策略:

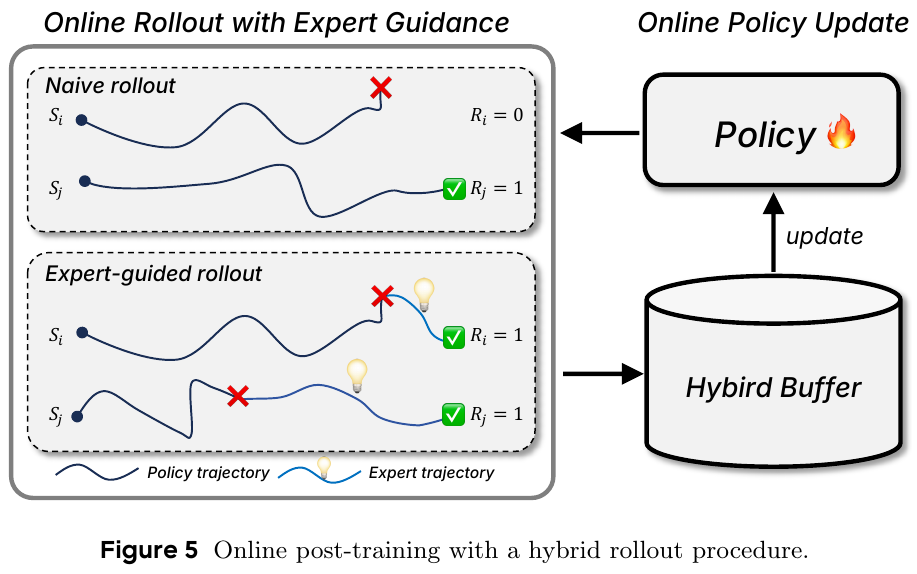

- Nav-AdaCoT-2.9M数据集:构建了目前最大的具身导航数据集,包含推理标注和自适应CoT标注。

- 在线专家引导强化学习 (Online Expert-guided RL):在模仿学习(SFT)之后引入了在线专家引导RL阶段,使模型能够获得更鲁棒、自探索的导航行为,超越监督演示的局限性。

核心结果/发现

- VLingNav在多项具身导航基准测试(如ObjectNav, EVT, ImageNav)上实现了最先进的性能。

- 在HM3Dv1 ObjectNav上,SR和SPL显著优于Uni-NaVid,展现了强大的探索和记忆能力。

- 在HM3D OVON上,VLingNav在所有测试拆分中均表现最佳,证明了其强大的跨领域泛化能力。

- 在EVT-Bench上,VLingNav在单目标跟踪和分心跟踪任务中均达到SOTA性能,尤其在复杂混乱场景中优势明显。

- 在Image Goal Navigation上,VLingNav的成功率和导航效率显著高于UniGoal,表明其先进的推理和规划能力。

- 在真实世界机器人平台上实现了零样本迁移,成功执行了未见过的导航任务,展示了强大的真实世界泛化和实用性。

局限性

- 当前模型主要依赖单目自我中心观测,这限制了其感知能力。未来工作可以探索多视角观测以提高导航效率。

- 模型采用单系统架构,限制了预测频率,可能影响在高度动态环境中的快速决策和障碍物处理。未来可升级为双系统结构以支持高频动作输出。

- 当前方法仅使用基于MPC的路点控制器,缺乏更灵活的运动模型,未来可集成更多运动能力。

16. Slow4fast-VLN (2026)

——General Vision-Language Navigation via Fast-Slow Interactive Reasoning

📄 Paper: arXiv:2601.09111

精华

这篇论文的核心借鉴价值在于其提出的动态交互式快慢脑(Fast-Slow Interactive Reasoning)导航框架。它通过模拟人类的“快思考”(直觉决策)和“慢思考”(深度反思),实现导航策略的持续优化。其亮点在于,慢脑系统能够从历史经验中提炼出可泛化的“导航知识”,并用其“赋能”快脑,从而有效提升了智能体在未知环境(OOD场景)中的泛化能力和决策效率,解决了传统方法中快慢系统割裂、经验无法沉淀的问题。

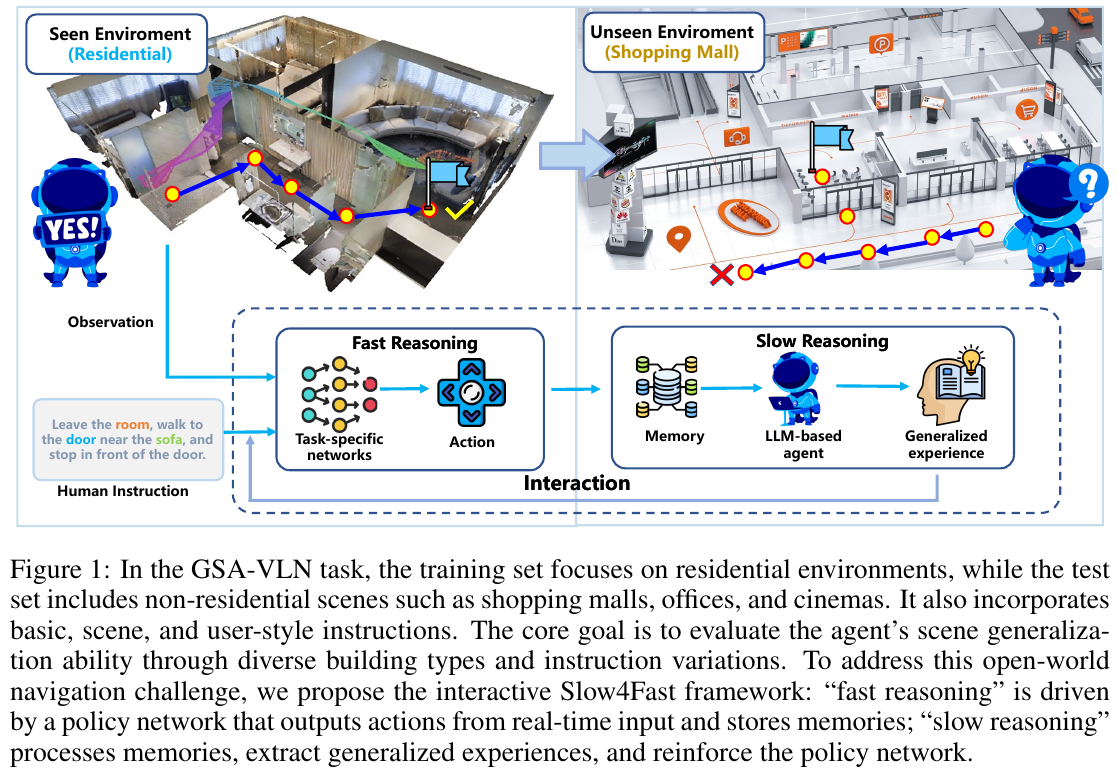

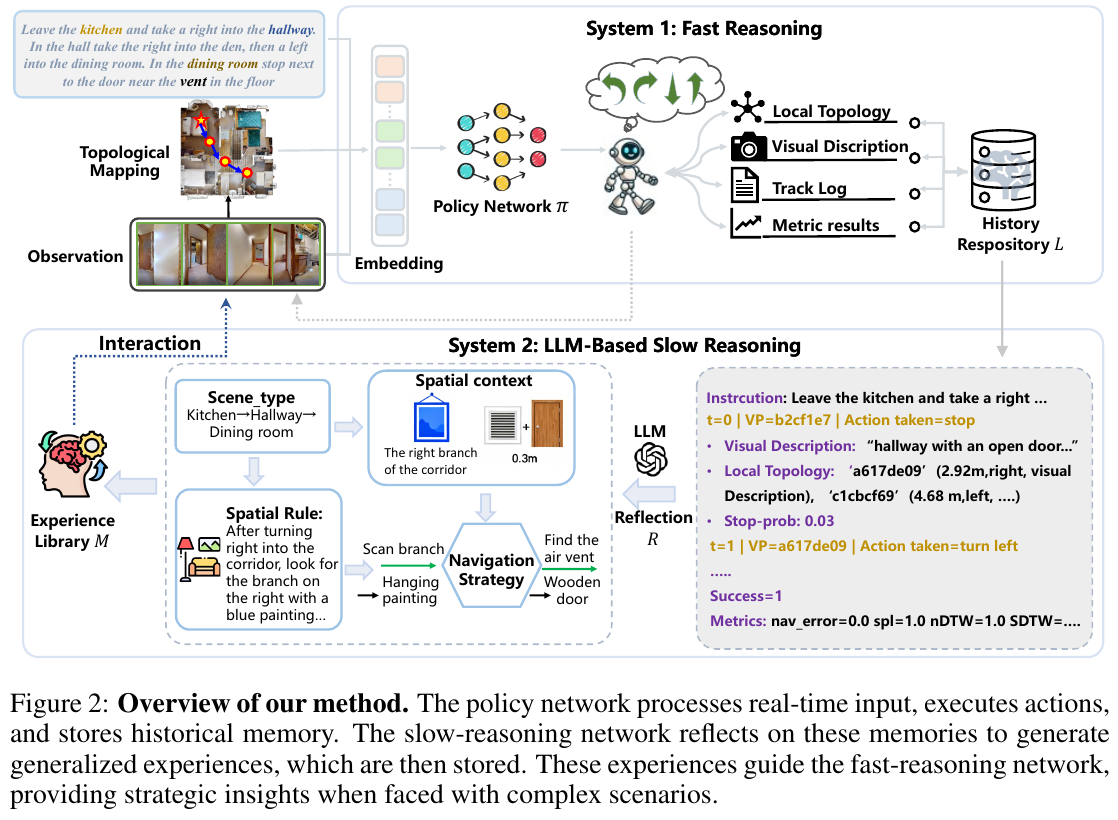

1. 研究背景/问题

传统的视觉-语言导航(VLN)方法在封闭环境下表现良好,但在面对环境和指令风格多变的开放世界时,其泛化能力严重不足。GSA-VLN任务通过引入多样化的场景和指令,对模型的场景适应性提出了更高要求。当前方法的主要挑战在于如何让智能体在导航过程中动态生成可泛化的策略,以应对前所未见的场景和指令。

2. 主要方法/创新点 (Core content, most detailed)

论文提出了一个名为 slow4fast-VLN 的动态交互式快慢推理框架,以应对开放环境下的视觉语言导航挑战。该框架包含快慢两个核心模块:

-

快推理模块 (Fast Reasoning):这是一个端到端的策略网络(基于DUET),负责根据实时的视觉和指令输入,快速生成导航动作。同时,它会记录导航过程中的所有执行记录(如观测、动作、度量等),形成历史记忆(History Repository)。

-

慢推理模块 (Slow Reasoning):该模块是整个框架的核心创新点。它利用大语言模型(LLM)对快推理模块产生的历史记忆进行深度“反思”(Reflection),从中提取出结构化、可泛化的导航经验(Structured Experience),并存入一个经验库(Experience Library)。这些经验包含了场景类型、空间上下文、空间规则、导航策略等关键信息。

-

快慢交互机制 (Interaction):这是区别于以往工作的关键。在导航决策时,快推理模块会从经验库中检索与当前场景最相关的经验,并将这些经验特征与实时视觉特征进行融合(通过Attention机制),从而“赋能”快脑,使其做出更精准、更泛化的决策。这种交互使得慢脑提炼的经验能够持续优化快脑的性能。

-

指令风格转换 (Instruction Style Conversion):为了应对多样的指令风格(如场景化、用户个性化),论文还设计了一个基于LLM的指令转换模块,通过CoT提示工程,将不同风格的指令实时转换为统一的“基础风格”指令,降低了模型对指令变化的敏感度。

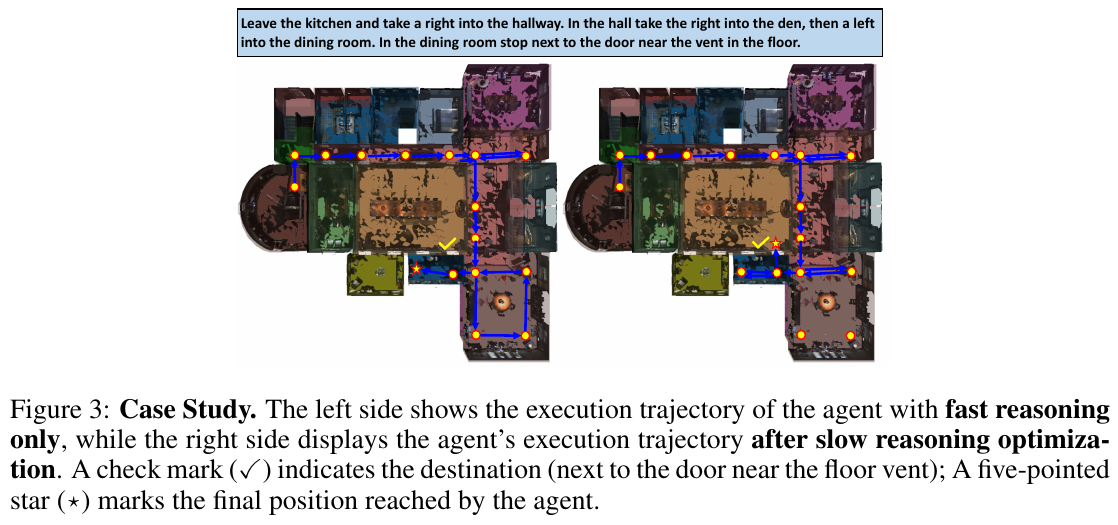

3. 核心结果/发现 (Key findings)

- 环境适应性:在GSA-R2R数据集上,使用基础指令进行测试时,slow4fast-VLN在住宅(ID)和非住宅(OOD)场景中的成功率(SR)分别比基线方法GR-DUET提升了1.5%和2.2%,证明了快慢交互框架对于提升场景泛化能力的有效性。

- 指令适应性:在面对用户个性化指令和场景化指令时,该方法同样全面优于基线。例如,在用户指令测试中,其SR和SPL指标在多种角色(如Child, Keith, Moira等)下均达到SOTA水平。这得益于其指令风格转换模块和动态经验反馈循环。

- 消融实验:实验证明,快慢推理(FSR)框架和指令风格转换(ISC)模块都是有效的。当两者协同工作时,模型在最具挑战的Test-N-Scene任务上达到了最佳性能。

- 案例研究:通过可视化导航轨迹,论文展示了在引入慢脑反思后,智能体能够修正初始的错误路径,并基于经验(如“寻找蓝色画作”作为线索)更高效、更准确地完成导航任务,避免了不必要的探索。

4. 局限性 (Brief, 1-2 sentences)

论文指出的一个局限是,慢脑推理产生的知识是隐式地编码在策略网络的权重中,这种“黑盒”形式使得学习到的经验难以解释和直接干预。未来的一个研究方向是让慢脑生成显式的、结构化的知识库(如语义地图或知识图谱),以供快脑在导航时直接查询。

17. FantasyVLN (2026)

———统一多模态Chain-of-Thought推理用于视觉-语言导航

📄 Paper: arXiv:2601.13976

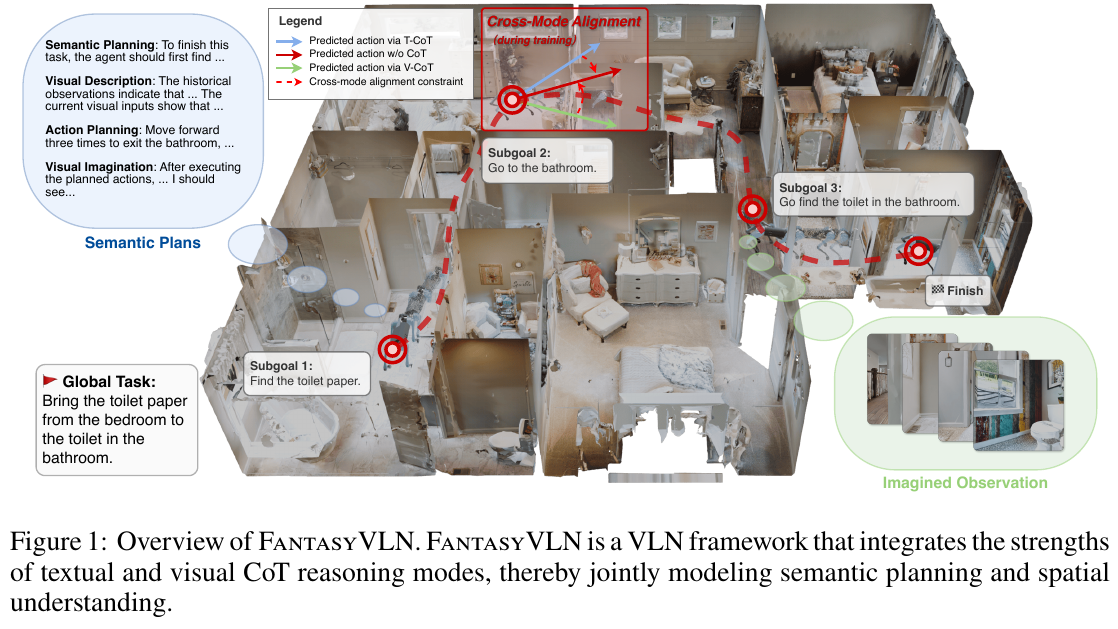

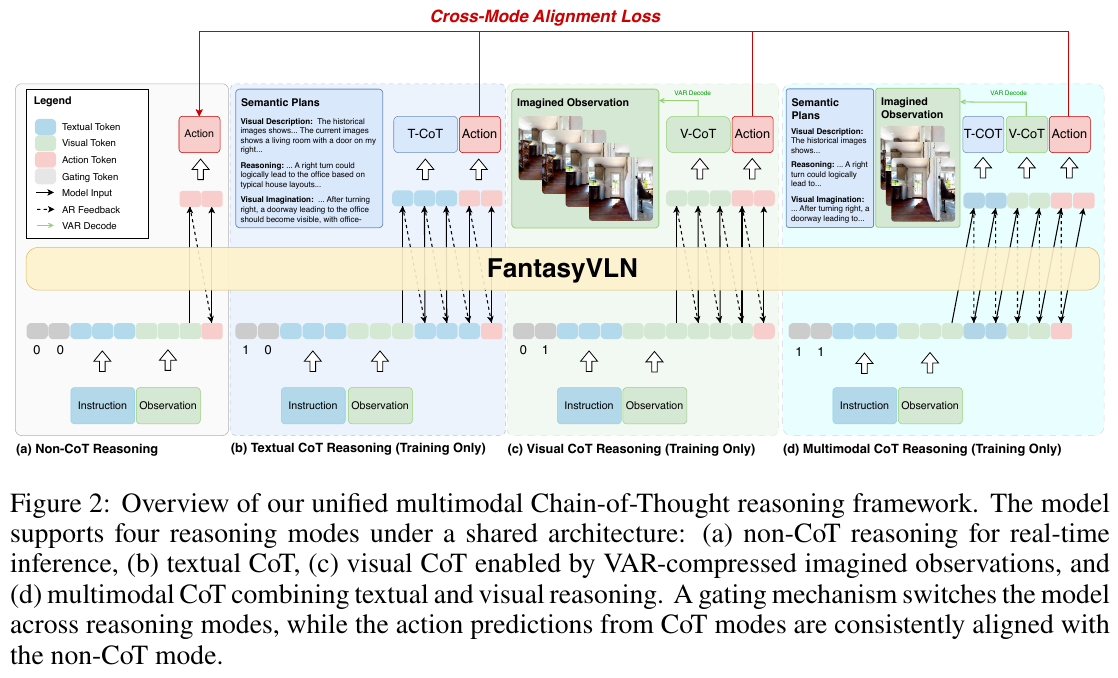

精华 这篇论文展示了如何通过统一框架整合文本、视觉和多模态CoT推理模式,值得借鉴的点包括:(1) 训练时使用CoT监督、推理时直接预测的隐式推理范式,避免了显式CoT的token膨胀问题;(2) 使用预训练VAR模型将想象的视觉观测压缩到紧凑潜在空间,大幅降低序列长度;(3) 通过跨模态对齐约束统一不同推理模式,学习模态不变的推理表示;(4) 门控机制实现单一模型灵活切换多种推理模式。这种设计在保持推理能力的同时实现了实时导航,为具身智能任务提供了实用的解决方案。

研究背景/问题 现有VLN方法面临关键挑战:纯文本CoT缺乏空间理解且容易过拟合稀疏标注;多模态CoT通过生成想象的视觉观测引入严重的token膨胀,导致推理延迟增加数个数量级,无法实现实时导航。这在长时域、多阶段导航场景中尤为突出。

主要方法/创新点

FantasyVLN提出了统一的隐式推理框架,核心创新包括:

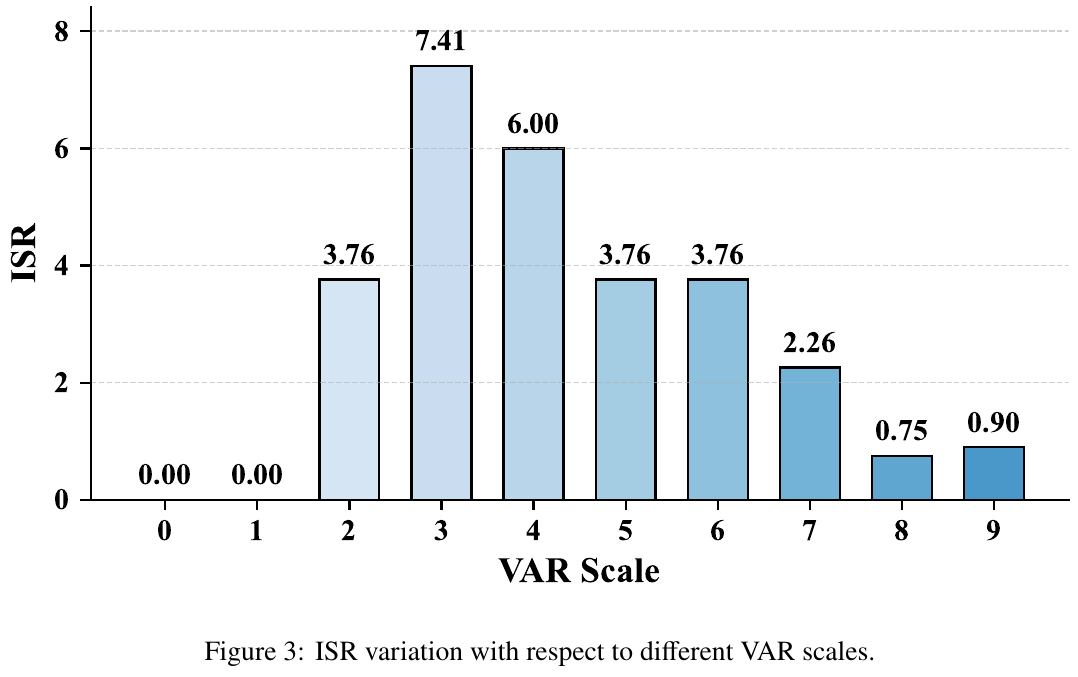

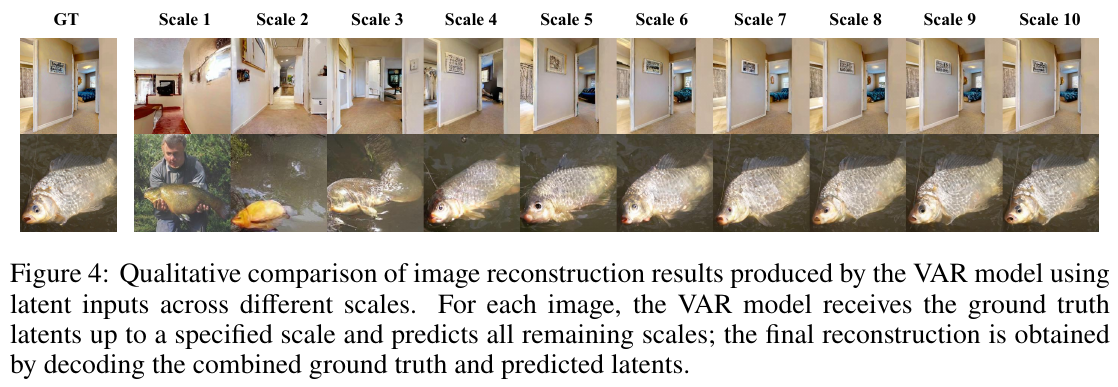

1. Compact Visual CoT (CompV-CoT)

- 使用预训练的Visual AutoRegressor (VAR)模型将想象的视觉观测编码到紧凑潜在空间

- VAR采用next-scale预测范式,256×256图像仅需30个视觉token即可精确重建,压缩比达1/2185

- 训练时VLM直接生成VAR潜在表示,推理时无需显式VAR解码,大幅提升效率

2. 统一多模态CoT (UM-CoT)框架

- 通过二元门控信号 gT 和 gV 控制文本和视觉推理的激活

- 四种推理模式:(a) Non-CoT (gT=0, gV=0) 直接预测动作;(b) T-CoT (gT=1, gV=0) 生成文本推理步骤;(c) V-CoT (gT=0, gV=1) 生成压缩视觉想象;(d) MM-CoT (gT=1, gV=1) 联合生成文本-视觉推理

- 单一模型共享参数,通过数据混合实现端到端联合训练

3. 跨模态对齐约束 (Cross-Mode Alignment)

- 将Non-CoT模式的动作预测作为软监督信号,对齐所有CoT变体的动作输出

- 交替优化Non-CoT目标和跨模态对齐的联合目标,嵌入多样化推理模式到统一潜在策略

- 防止不同推理模式间的冲突,学习一致的模态不变表示

4. 隐式推理机制

- 训练时:联合学习文本、视觉和多模态CoT模式

- 推理时:采用Non-CoT模式直接指令到动作映射,无需生成显式CoT序列

- 借鉴Aux-Think的”train-with-CoT, infer-without-CoT”范式,模型隐式保留推理感知表示

训练细节

- 基础模型:Qwen2.5-VL (7B参数)

- 数据:LH-VLN训练集18,554个导航轨迹切片(每5步一个切片)

- T-CoT标注:使用Qwen-VL-Max生成,包含语义规划、视觉描述、动作规划和视觉想象四部分

- 优化:LoRA微调,AdamW优化器,学习率1e-4,64×H20 GPUs,DeepSpeed ZeRO-2

核心结果/发现

导航精度 (LH-VLN benchmark)

- SR (成功率): 2.44% (所有基线中最佳)

- ISR (独立成功率): 11.01% (显著优于所有方法)

- CSR (条件成功率): 9.64%

- CGT (加权CSR): 8.99%

- 显著超越次优方法Aux-Think (仅T-CoT): SR提升3.75×,ISR提升3.5×

推理效率

- APS (每秒动作数): 1.03,与WorldVLA (1.02)和Aux-Think (0.97)相当

- 比显式CoT方法CoT-VLA (0.19 APS)快5.4×,推理延迟降低一个数量级

- 隐式推理每次预测仅解码单个token,而显式CoT需生成3k-5k个token

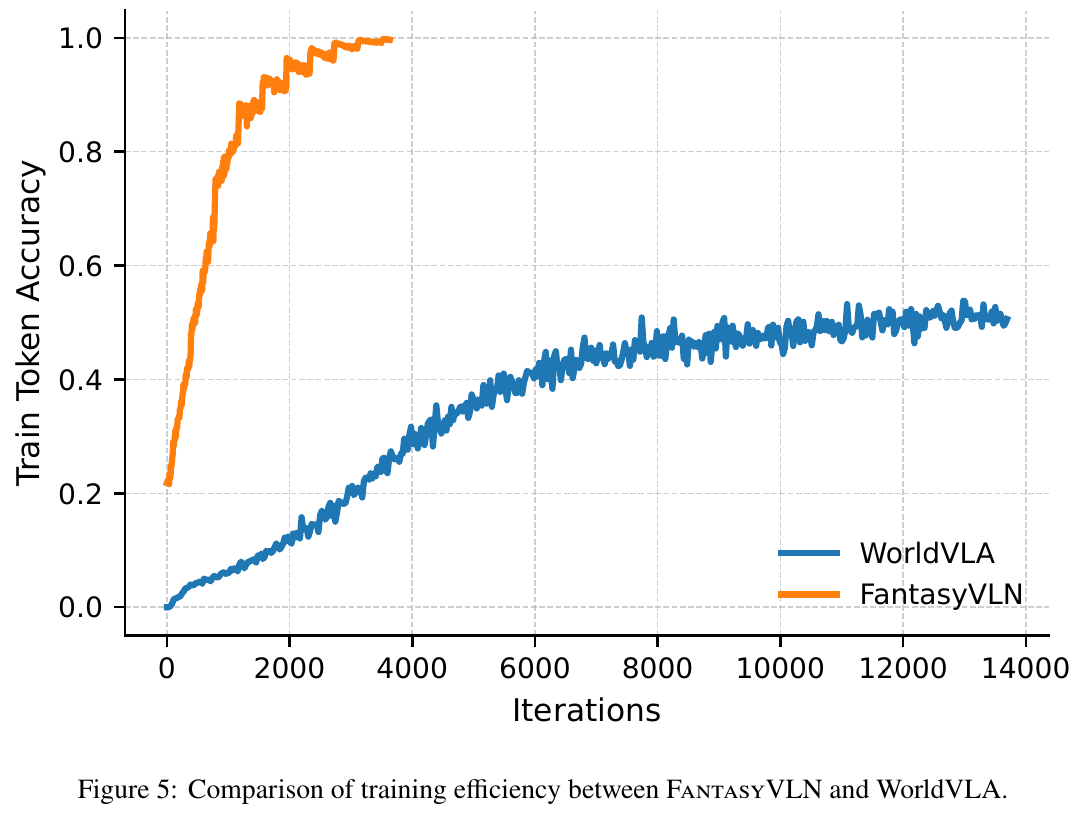

训练效率

- FantasyVLN在few thousand迭代内快速收敛,token预测准确率达到1.0

- WorldVLA (像素级V-CoT)需10k+迭代才能达到0.5准确率,且训练不稳定

- CompV-CoT通过潜在空间推理提供更强梯度信号和更稳定的学习动态

消融实验

- 各推理模式贡献:结合任何CoT模式与Non-CoT都能提升性能,四模式联合训练效果最佳

- VAR scale选择:scale 4最优(ISR 7.41%),更小scale信息不足,更大scale冗余

- 跨模态对齐:关键组件,移除后SR从2.44%降至0,ISR从11.01%降至2.39%

- 显式vs隐式推理:隐式推理在多模态设置下表现最佳(MM-CoT隐式:SR 2.44 vs 显式0.98)

局限性 该方法在LH-VLN这种小规模数据集(18k轨迹切片)上训练,显式CoT容易过拟合并产生累积误差;在更大规模数据集上的表现有待验证。此外,绝对成功率仍较低(SR 2.44%),表明长时域多阶段导航仍是极具挑战性的任务。

18. VL-Nav (2025)

——实时零样本 Vision-Language 导航系统,融合像素级视觉-语言特征与启发式空间推理

📄 Paper: arXiv:2502.00931

精华

这篇论文展示了如何将像素级 vision-language 特征与启发式探索策略结合,实现高效的零样本导航。值得借鉴的核心思想包括:(1) 使用 Gaussian 混合模型将像素级 VL 特征转换为空间分布,而非依赖单一图像级相似度分数;(2) 引入 instance-based target points 模拟人类搜索行为,允许机器人接近并验证潜在目标;(3) 通过 rolling occupancy grid 和 partial frontier detection 优化计算开销,使系统能在低功耗平台上实时运行;(4) 结合 distance weighting 和 unknown-area heuristic 避免反复移动,提升大规模环境中的导航效率;(5) 证明了模块化方法在真实世界中的泛化能力优于端到端学习方法。

研究背景/问题

当前的 vision-language navigation 系统面临三大挑战:难以解释像素级 vision-language 特征、在不同环境中泛化能力差、无法在低功耗平台上实时运行。现有方法如 VLFM 依赖计算密集型模型且仅使用单一图像级相似度分数进行目标选择,限制了其利用细粒度 vision-language 线索的能力。

主要方法/创新点

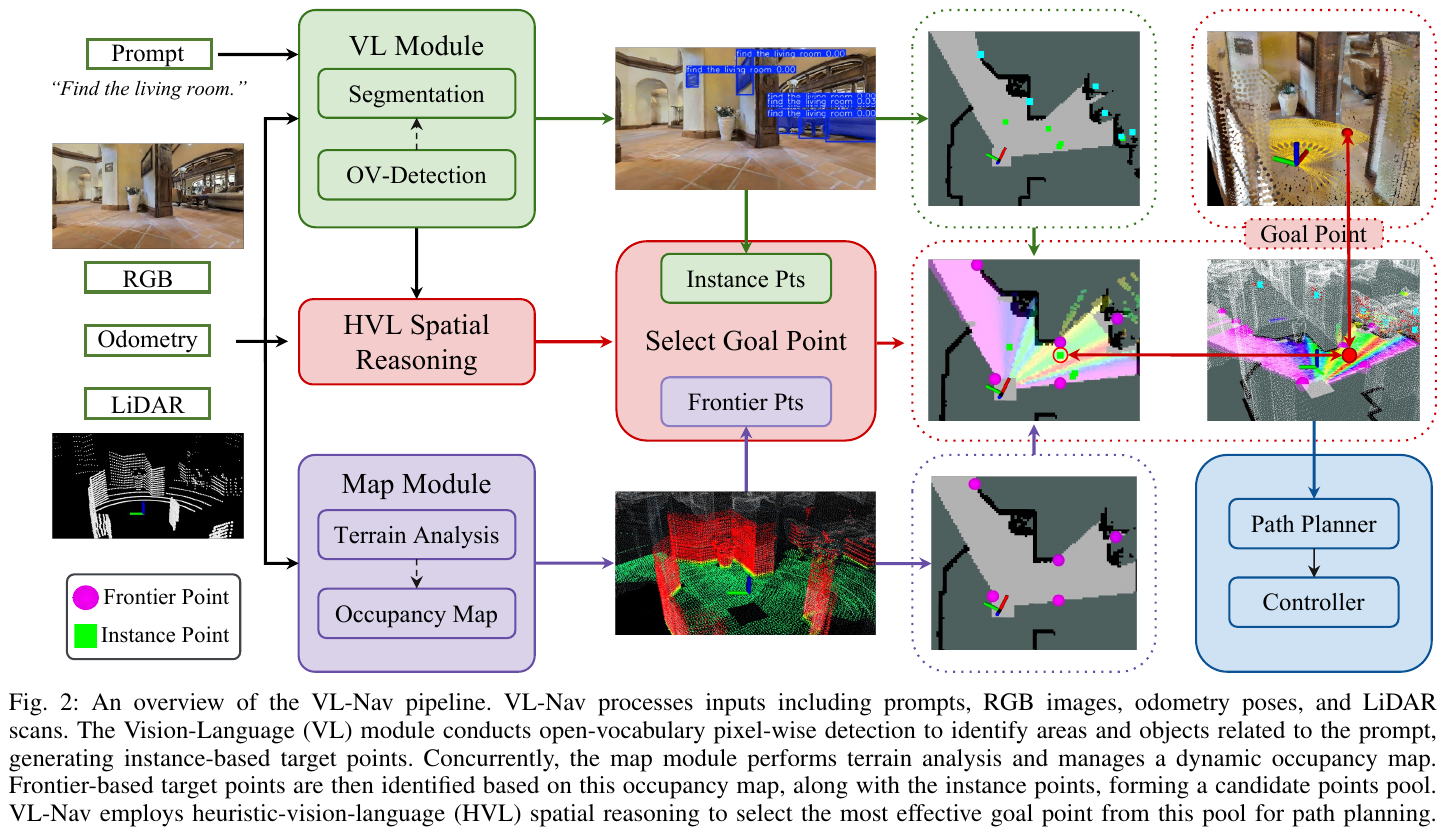

VL-Nav 提出了一个针对低功耗机器人优化的 vision-language navigation 框架,在 Jetson Orin NX 上实现 30 Hz 实时性能。核心创新在于 Heuristic-Vision-Language (HVL) 空间推理,将像素级 vision-language 特征与启发式探索策略相结合。

Rolling Occupancy Map:系统维护一个动态 2D 占用栅格地图,每个单元格标记为 free (0)、unknown (-1) 或 occupied (100)。与传统固定大小全局栅格不同,VL-Nav 采用 rolling grid,仅在新传感器数据需要时动态扩展,降低内存使用和 BFS/cluster 计算开销。更新过程包括:(1) 根据需要扩展地图;(2) 清除前向 FOV 内的过时障碍物;(3) 膨胀新障碍物;(4) 使用 raycasting 将 unknown cells 标记为 free。

Frontier-based 与 Instance-based Target Points:系统生成两类候选目标点。Frontier-based points 通过 partial frontier detection 在前向楔形区域内识别,仅测试满足角度和距离约束的单元格,并使用 BFS 聚类。Instance-based target points (IBTP) 来自 vision-language 检测器周期性报告的候选实例中心,保留置信度高于阈值 τdet 的检测结果。IBTP 模拟人类搜索行为:看到可能匹配的目标时会靠近确认,而非忽略中间检测结果。

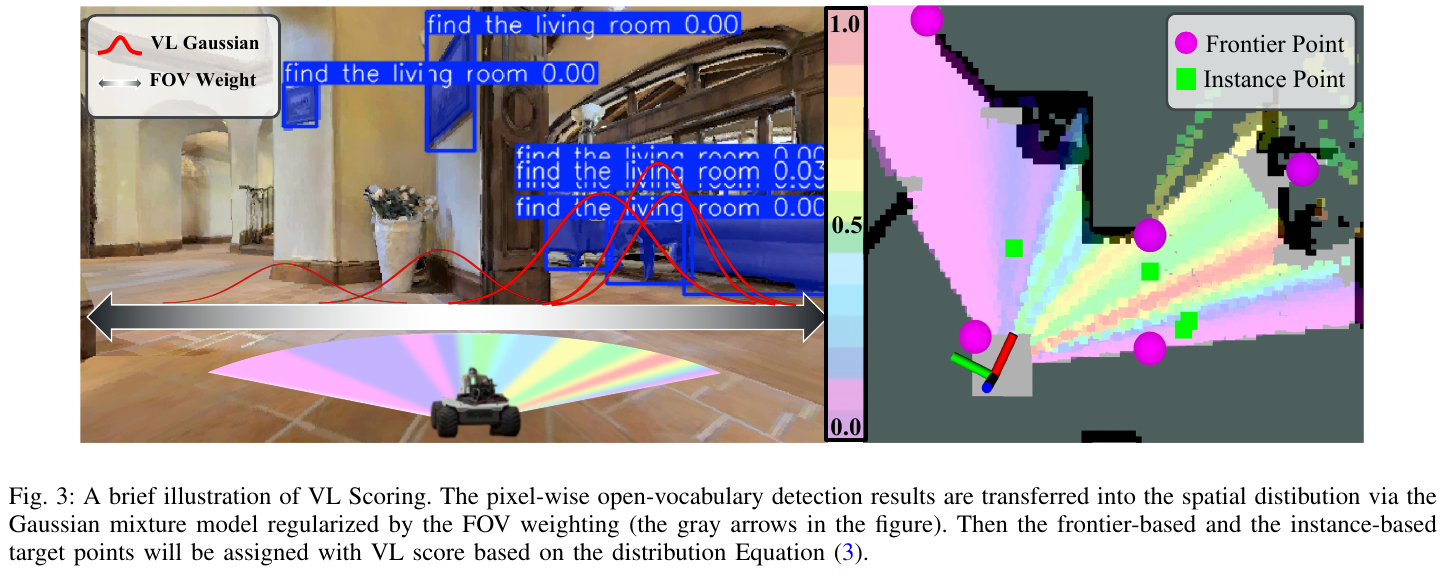

HVL 空间推理:这是 VL-Nav 的核心创新。对每个候选目标 g,系统计算 HVL score。VL Score 使用 Gaussian 混合模型将像素级 vision-language 特征转换为机器人水平 FOV 上的分布。假设开放词汇检测模型识别出 K 个可能方向,每个由 (μk, σk, αk) 参数化,其中 μk 表示 FOV 内的平均偏移角度,σk 编码检测的角度不确定性(固定为 0.1),αk 是基于置信度的权重。VL score 计算为:

S_VL(g) = Σ(k=1 to K) αk * exp(-1/2 * ((Δθ - μk)/σk)²) * C(Δθ)

其中 C(Δθ) = cos²(Δθ/(θ_fov/2) * π/2) 是视野置信度项,降低大角度偏移检测的权重。

Heuristic Cues 包括两个启发式项:(1) Distance Weighting: S_dist(g) = 1/(1+d(xr,g)),使较近目标获得更高分数,减少能量消耗和不必要的徘徊;(2) Unknown-Area Weighting: S_unknown(g) = 1 - exp(-k*ratio(g)),其中 ratio(g) 是局部 BFS 中 unknown cells 与可达 cells 的比率,鼓励探索可能揭示大量未知空间的目标。

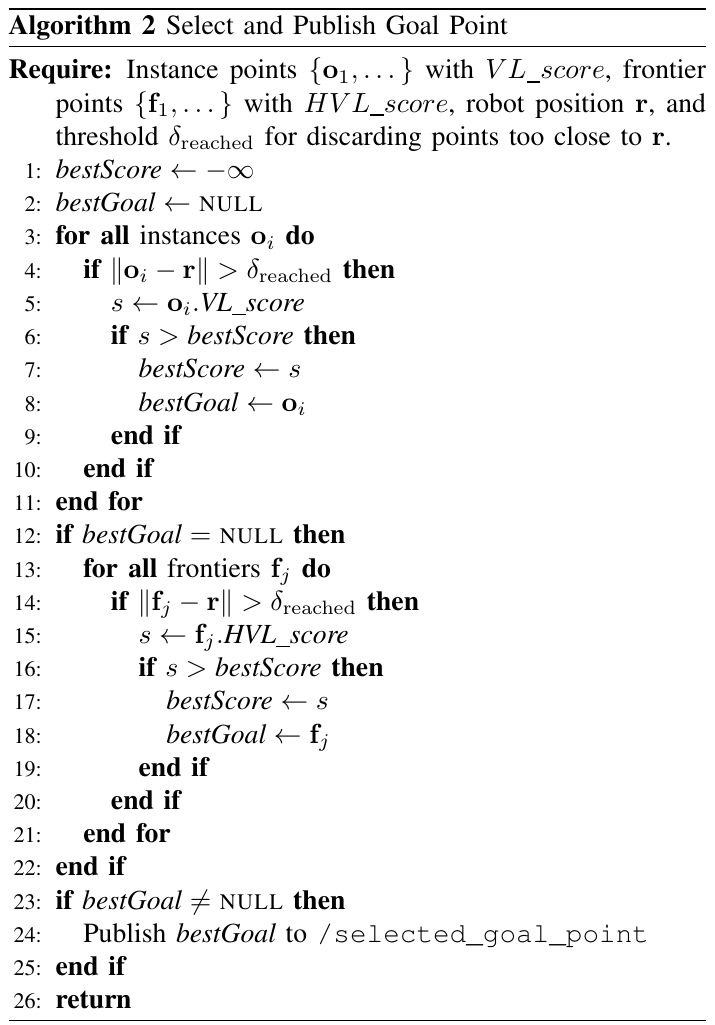

最终 HVL score 为:S_HVL(g) = w_dist * S_dist(g) + w_VL * S_VL(g) * S_unknown(g)。系统优先选择 instance-based goals(基于 VL score),若无则选择得分最高的 frontier goal(基于 HVL score)。

Path Planning:选定 HVL goal 后,系统使用 FAR Planner 进行 point-goal 路径规划,以多边形表示障碍物并实时更新可见性图,支持部分未知环境中的高效重规划。局部规划器将 FAR Planner 的路径点细化为短时域速度命令,确保对新障碍物的快速反应。

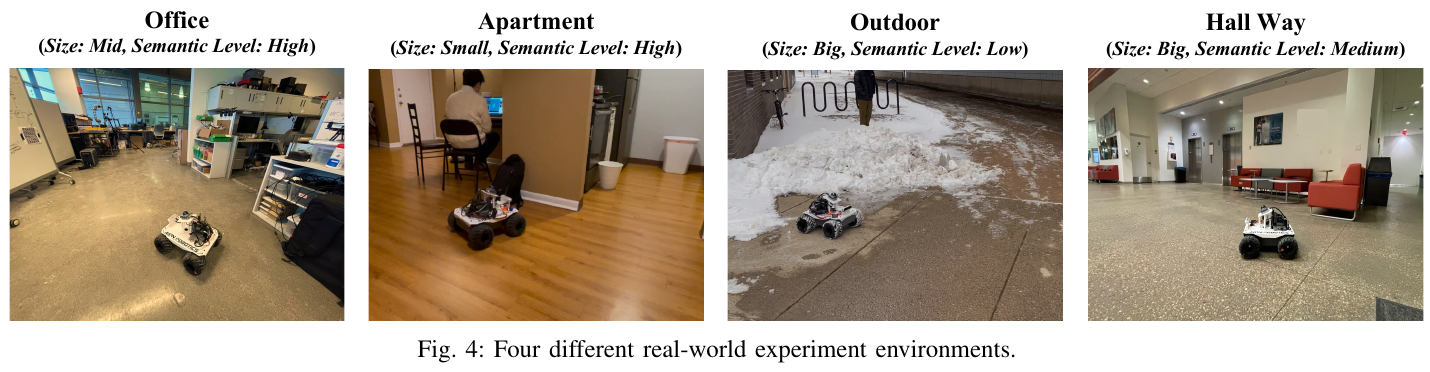

核心结果/发现

VL-Nav 在四个真实世界环境(Hallway、Office、Apartment、Outdoor)上进行了全面评估,每个环境具有不同的语义复杂度(High、Medium、Low)和规模(Big、Mid、Small)。主要发现包括:

- 整体性能:VL-Nav 达到 86.3% 的总体成功率 (SR),比先前方法提升 44.15%。在所有四个环境中,VL-Nav 的 SR 和 SPL(Success weighted by Path Length)均为最高。

- Instance-based Target Points 的影响:去除 IBTP 后性能显著下降,特别是在复杂环境(Apartment 和 Office)中,证明了允许机器人接近并验证潜在检测结果的重要性。

- Heuristics 的贡献:去除启发式项后 SR 和 SPL 均下降,特别是在大规模环境中,表明 distance weighting 和 unknown-area heuristic 对提升效率至关重要。

- 相比 VLFM:VL-Nav 在所有环境中均超越 VLFM,特别是在语义复杂(Apartment)和开放区域(Outdoor)环境中,优势更加明显,证明了像素级 VL 特征和 HVL 空间推理的有效性。

- 环境规模影响:经典 Frontier Exploration 在大规模环境中性能急剧下降(Big 环境中 SR 仅 36.7%),而 VL-Nav 保持鲁棒(82.3% SR),证明了其在各种规模环境中的适应能力。

- 语义复杂度影响:所有方法在语义更丰富的环境中表现更好,因为结构化室内空间提供了更强的检测和分割线索。VL-Nav 能够充分利用语义上下文,在高复杂度环境中获得更显著的优势。

- 实时性能:VL-Nav 在 Jetson Orin NX 上以 30 Hz 运行,通过选择高效的 YOLO-World 模型变体(256×320 输入,标准 GPU runtime)和 rolling occupancy grid 实现了真实世界部署的可行性。

局限性

系统在处理包含隐藏对象引用和特定文本注释的复杂语言描述时存在困难。此外,系统依赖于手动定义的阈值(如光照条件等),这些阈值可能无法在不同环境和场景中很好地泛化,需要进一步研究自适应或基于学习的阈值调整方法。

19. StreamVLN (2025)

——— 通过慢-快上下文建模实现流式视觉-语言导航

📄 Paper: arXiv:2507.05240

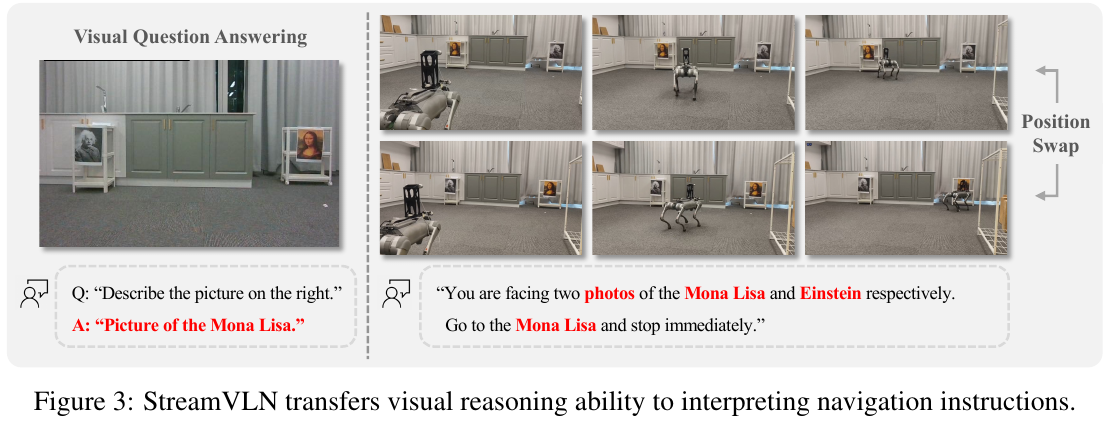

精华

这篇论文提出了一个适用于真实世界部署的流式 VLN 框架,值得借鉴的核心思想包括:(1) 采用慢-快双通道上下文建模策略,平衡全局场景理解和实时响应能力;(2) 利用 3D 几何信息进行智能 token 剪枝,在保持性能的同时显著降低计算开销;(3) 通过 KV cache 复用机制利用时间连贯性,支持长视频流的高效推理;(4) 将上下文大小和推理成本控制在有界范围内,为 embodied AI 的实际部署提供了可行方案;(5) 采用多源数据联合训练策略(VLA数据+通用VL数据+DAgger数据),同时保持通用推理能力和导航专业性能。这些设计思路可以迁移到其他需要处理长序列多模态输入的具身智能任务中。

研究背景/问题

现有的 Vision-and-Language Navigation 方法在处理真实世界连续环境时面临关键挑战:如何在长视频流中高效进行多模态推理,同时保持低延迟以支持实时交互。现有 Video-LLM 基于的 VLN 方法往往在细粒度视觉理解、长期上下文建模和计算效率之间存在权衡。本文旨在设计一个既能捕捉全局场景理解,又能快速响应的流式导航框架。

主要方法/创新点

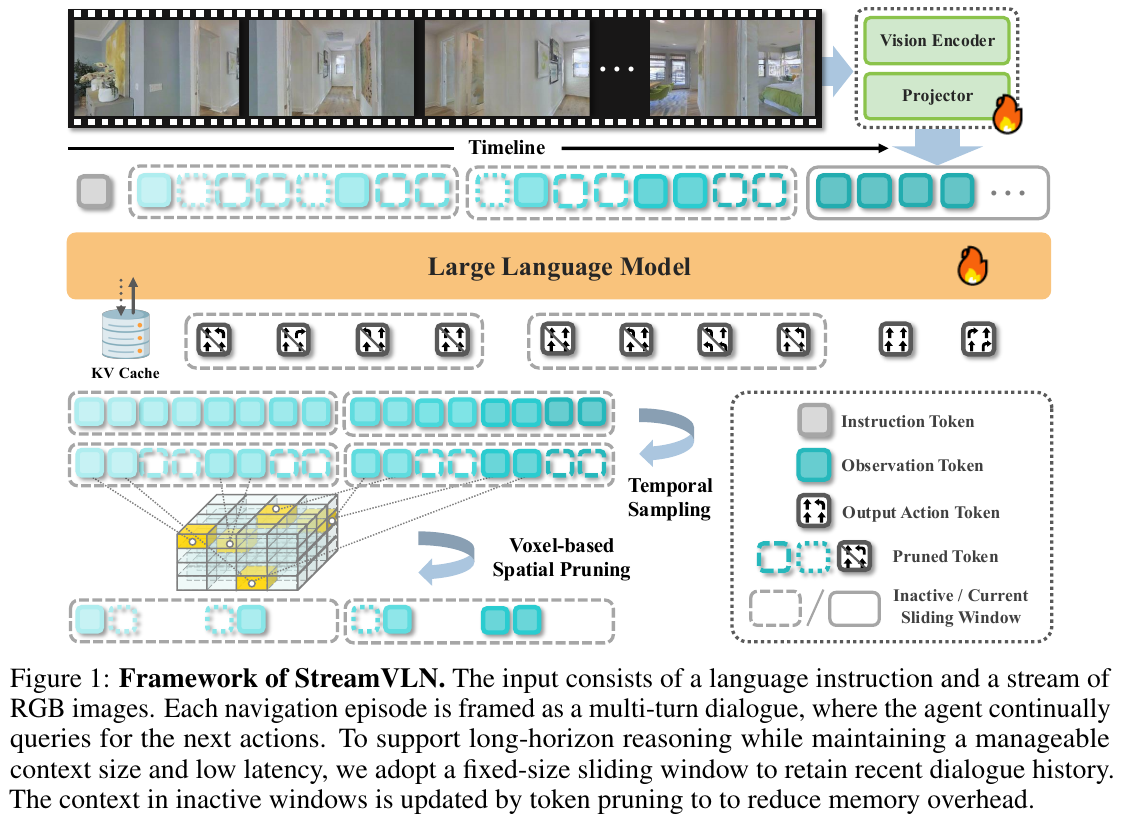

论文提出了 StreamVLN,一个基于慢-快上下文建模的流式视觉-语言导航框架,将 Video-LLM 扩展为交错的 vision-language-action 模型。

1. 连续多轮自回归生成

VLN 的多轮对话会话由一系列交错的观测和动作组成。在每个对话 $d_i = (o_i, a_i)$ 中,VLN 模型接收新观测 $o_i$ 并生成动作响应 $a_i$,条件于当前输入和对话历史。完整输入序列构造为:$o_1a_1o_2a_2…o_{i-1}a_{i-1}$。Transformer 基于 LLM 首先执行 prefill 阶段(预填充阶段)编码输入 token 并缓存 key/value(KV)状态,然后在 decoding 阶段使用缓存的 KV 对生成新 token。

2. 快速流式对话上下文 (Fast-Streaming Dialogue Context)

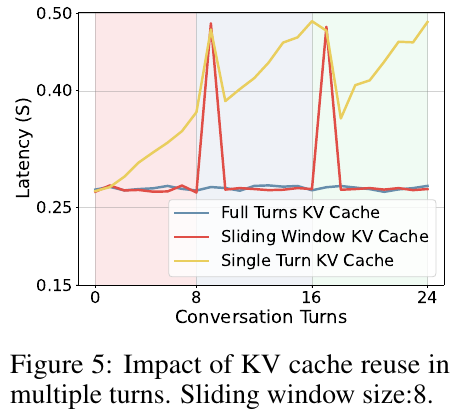

虽然跨轮次复用 KV cache 可以消除超过 99% 的 prefilling 时间,但会引入巨大的内存开销。随着对话数量增加,KV cache 呈线性增长(例如 2K token 可能消耗约 5GB 内存),使长会话变得不切实际。此外,现有 Video-LLM 在处理过长上下文时推理性能会下降。

StreamVLN 采用 滑动窗口 KV cache 管理对话上下文,保留固定数量 $N$ 的最近对话在活跃窗口中:$W_j = [o_{(i-N+1)}a_{(i-N+1)}…o_ia_i]$。当窗口达到容量时,key/value 状态从 LLM 中卸载,非观测对话 token(如提示词和生成的动作)的状态立即丢弃。对于新的滑动窗口,来自过去窗口的 token 状态被处理为记忆 token 状态 ${M_0, …, M_j}$。

3. 慢速更新记忆上下文 (Slow-Updating Memory Context)

在有限的上下文长度内平衡时间分辨率和细粒度空间感知仍然是 Video-LLM 的关键挑战。StreamVLN 不在特征层面压缩视频 token(如通过平均池化),而是保留高图像分辨率的同时选择性地丢弃空间和时间冗余 token,以更好地保持 Video-LLM 的可迁移性。

- 时间采样: 采用简单的固定数量采样策略,避免不同长度的记忆 token 引入时间持续偏差

- 体素化空间剪枝 (Voxel-based Spatial Pruning): 使用深度信息将视频流中的 2D 图像patches 反投影到共享 3D 空间,离散化为均匀体素。通过跟踪 patch token 在时间上的体素索引,如果给定时长内的多个 token 投影到同一体素,仅保留最新观测的 token。该剪枝掩码用于选择保留的 token 状态(详见 Algorithm 1)。

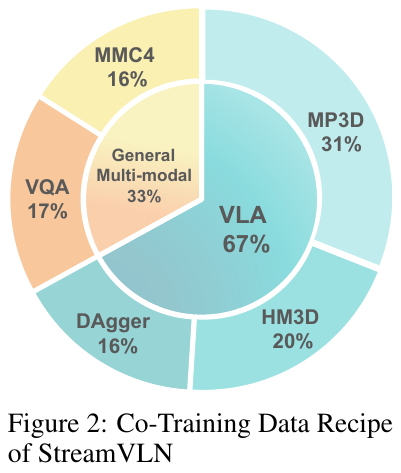

4. 多源数据联合训练

- Vision-Language Action (VLA) 数据:

- 使用 Habitat 模拟器收集 450K 样本(来自 60 个 Matterport3D 环境的 R2R、R2R-EnvDrop 和 RxR 数据集)

- 额外 300K 样本来自 ScaleVLN(涵盖 700 个 HM3D 场景)以提高场景多样性

- 采用 DAgger 算法收集 240K 纠正示范样本以增强鲁棒性和错误恢复能力

- 通用Vision-Language数据: 为保持预训练 Video-LLM 的通用推理能力,引入:

- 248K 视频基础 VQA 样本(来自 LLaVA-Video-178K 和 ScanQA)

- 230K 交错图像-文本样本(来自 MMC4)以增强多轮视觉-语言交互能力

主要创新点:

- 首次提出针对实时 VLN 的慢-快上下文建模策略

- 设计了基于 3D 几何的智能 token 剪枝方法,优于通用的均匀剪枝

- 实现了低延迟、可扩展的流式多模态推理框架,支持 KV cache 高效复用

- 通过交错 vision-language-action 建模支持连贯的多轮对话

- 有界的上下文大小和推理成本,适合长视频流处理

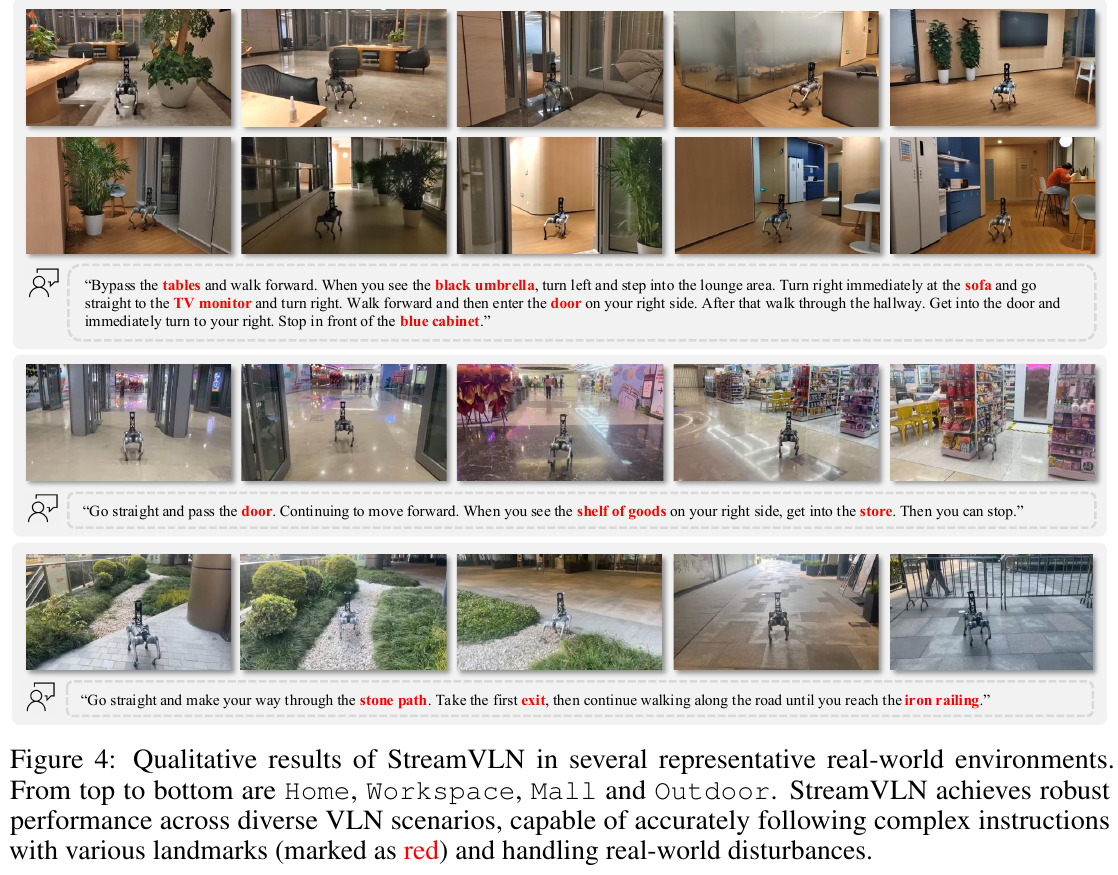

核心结果/发现

- VLN-CE 基准测试上取得 state-of-the-art 性能:

- R2R Val-Unseen: SR 56.9%, SPL 51.9%(无额外数据)

- RxR Val-Unseen: SR 52.9%, SPL 46.0%, nDTW 61.9%

- 性能与 ETPNav 相当,但不依赖全景视图或航点监督

-

ScanQA 3D 问答基准测试:超越 NaVILA 和 NaviLLM,Exact Match达到 28.8%

- 真实世界部署验证:

- 在 Unitree Go2 机器狗上成功部署

- 平均推理延迟 0.27s(4个动作)+ 通信延迟 0.2s(室内)/ 1.0s(室外)

- 支持实时物理部署

- 关键消融实验发现:

- KV cache 复用在多轮对话中消除超过 99% 的 prefilling 时间

- 滑动窗口大小为 8 个对话轮次时实现最佳平衡

- 记忆上下文大小从 2×196 增加到 8×196 tokens 时,SR 从 37.3% 提升到 45.5%

- 体素化空间剪枝减少约 20% 的输入 token,同时提升性能(R2R +1.2% SR,RxR +1.1% SR)

- DAgger 数据对性能提升至关重要(+5.5% SR / +3.8% SPL)

- 通用 VL 数据(VideoQA + MMC4)的联合训练带来显著增益(+7.3% SR / +5.6% SPL)

局限性

- 直接从原始视觉观测生成低级动作对视点和遮挡变化的鲁棒性较弱,在真实世界环境中可能导致次优控制

- 当前的混合上下文建模策略在更长视野的导航场景中仍然面临挑战,保持扩展序列上的一致推理较为困难

- 依赖显式动作历史作为对话上下文的一部分,为异步推理和部署带来额外复杂性,需要同步过去的动作以保持对话连贯性

20. NavFoM (2025)

——Embodied Navigation Foundation Model

📄 Paper: arXiv:2509.12129

精华

这篇论文展示了如何构建跨任务、跨具身体的导航基础模型,值得借鉴的核心思想包括:(1) 引入 Temporal-Viewpoint Indicator (TVI) tokens 来统一编码不同相机配置和时间信息,使模型能够处理多视角输入;(2) 提出 Budget-Aware Temporal Sampling (BATS) 策略,通过遗忘曲线动态采样历史帧,平衡性能和推理速度;(3) 在 8.02M 导航样本(包括四足机器人、无人机、轮式机器人、汽车等多种具身体)上联合训练,展示了大规模多任务训练对泛化能力的提升;(4) 采用视觉特征缓存机制加速训练 2.9 倍;(5) 证明了无需针对特定任务微调即可在多个基准测试上达到 SOTA 或竞争性能。

研究背景/问题

当前导航系统主要聚焦于特定任务设定和具身体架构,缺乏跨任务和跨具身体的泛化能力。现有 VLM 虽然在零样本任务上表现出色,但导航任务仍然局限于狭窄的任务领域、固定的相机配置和特定的具身体平台。本文旨在构建一个统一的导航基础模型,能够处理来自不同具身体(四足机器人、无人机、轮式机器人、汽车)的多视角输入,并跨越多个导航任务(VLN、目标搜索、目标追踪、自动驾驶)。

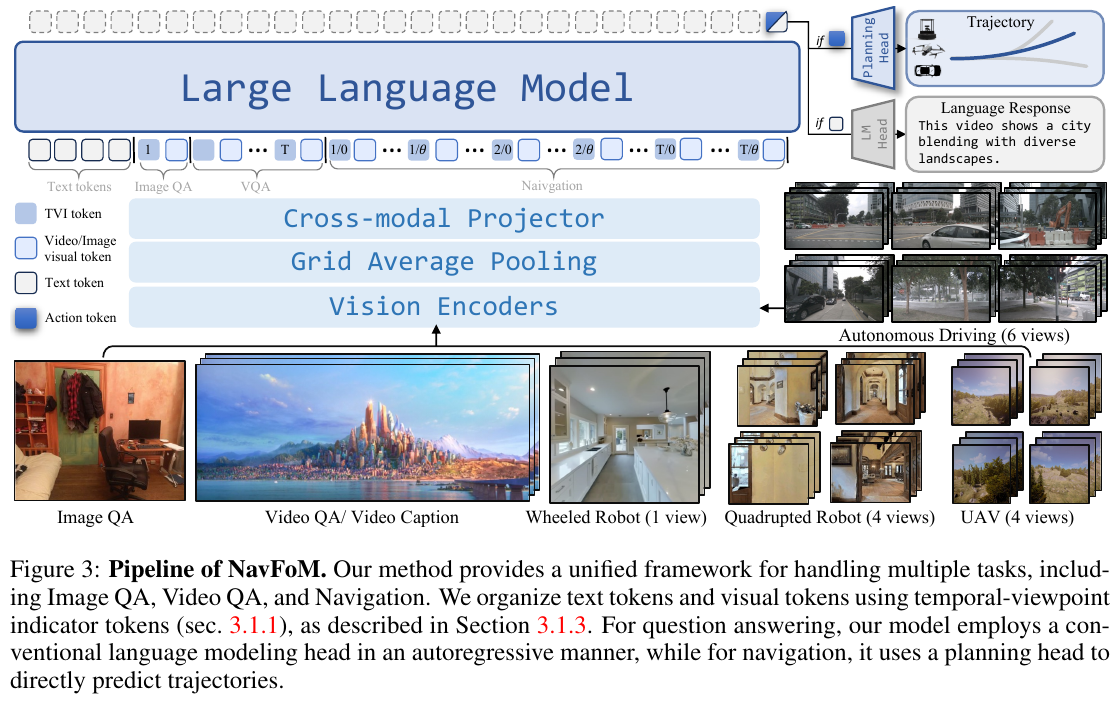

主要方法/创新点

NavFoM 基于 Vision-Language Model 架构,扩展为双分支系统:一个用于导航,一个用于问答。核心创新包括:

1. Temporal-Viewpoint Indicator (TVI) Tokens

- 引入特殊 indicator tokens 来编码相机视角和时间信息,每个 TVI token 由三部分组成:

- 可学习的 base embedding (E_Base)

- 时间编码 (Time PE): 使用正弦位置编码标识帧的时间顺序

- 视角编码 (Angle PE): 使用正弦/余弦编码保持方位角的循环连续性

- 对于导航任务,使用: E_TVI = E_Base + Time PE + Angle PE

- 对于 Video QA,仅使用时间信息;对于 Image QA,仅使用 base embedding

- TVI tokens 使 LLM 能够区分不同时间步和不同视角的 tokens,实现多视角导航

2. Budget-Aware Temporal Sampling (BATS)

- 解决在线导航时视觉 tokens 数量激增的问题

- 基于遗忘曲线(exponential decay)的采样概率: P(t) = (1 - ε)e^(k(t-T)/T) + ε

- 动态调整历史帧采样,越近的帧采样概率越高

- 在 token budget 约束下,平衡短期上下文和长期历史信息

- 相比 Uniform Sampling,BATS 在保持性能的同时显著降低推理时间

3. 观测编码

- 使用预训练 vision encoders (DINOv2, SigLIP) 提取视觉特征

- 采用 Grid Average Pooling 策略生成两种分辨率的视觉 tokens:

- Fine-grained (64×C): 用于当前最新观测和 Image QA

- Coarse-grained (4×C): 用于导航历史和 Video QA

- 通过 cross-modality projector 将视觉特征映射到 LLM latent space

4. Token 组织策略

- 不同任务采用不同的 token 组织方式:

- Image QA: fine-grained visual tokens + base TVI embedding

- Video QA: coarse-grained visual tokens + base + time embedding

- Navigation: coarse-grained + fine-grained tokens + base + time + angle embedding

- 这种设计实现了导航和 QA 数据的联合训练

5. 轨迹预测

- 使用三层 MLP 作为 planning head 从 LLM 隐藏状态预测轨迹

- 轨迹归一化到 [-1, 1] 分布,针对不同具身体(室内导航 vs 户外驾驶)采用不同的 scaling factor

- 对于室内机器人,预测 8 个航点;对于汽车和无人机,预测更长的轨迹

6. 数据规模与来源

- 导航数据 (8.02M): VLN-CE R2R/RxR (2.94M), OpenUAV (429K), 目标导航 (1.02M), 主动视觉追踪 (897K), 自动驾驶 (681K), Web 导航伪标签 (2.03M)

- QA 数据 (4.76M): Image QA (3.15M) + Video QA (1.61M)

- 总计 12.7M 训练样本,覆盖四足机器人、无人机、轮式机器人、汽车等多种具身体

7. 训练优化

- 视觉特征缓存: 预先计算并缓存 coarse-grained visual tokens,训练加速 2.9 倍,GPU 内存减少 1.8 倍

- 使用 Qwen2-7B 作为 LLM backbone

- 单次训练所有参数(仅 designated trainable parameters),无需多阶段训练

核心结果/发现

VLN 性能:

- VLN-CE R2R (single-view): SR 5.01% → 64.9%, SPL 56.2%,无需任务特定微调即达到 SOTA

- VLN-CE RxR (four-view): SR 5.51% → 57.4%, SPL 49.4%,超越所有基线方法

- OpenUAV (四视角,UM split): SR 6.38% → 14.05%, OSRL 5.68% → 18.65%,显著优于 TravelUAV

目标搜索:

- HM3D-OVON (zero-shot): VAL SEEN SR 55.0%, VAL UNSEEN SR 45.2%,超越 MTU3D baseline

主动视觉追踪:

- EVT-Bench (four-view, zero-shot): Single Target SR 85.1%/TR 80.5%, Distracted Target SR 62.0%/TR 67.9%

自动驾驶:

- NAVSIM (eight-view): PDMS 84.3%, 与 SOTA 方法竞争性能

- nuScenes (six-view): CR 93%, 接近 SOTA

Ablation 研究:

- 多任务训练带来显著增益:联合训练使 VLN SR 从 57.3% 提升到 64.4%

- 相机数量对性能的影响:从单视角到四视角,SR 从 58.3% 提升到 65.8%,但增加到六视角略有下降

- BATS 相比 Uniform Sampling,在 RxR 上 nDTW 仅下降 1.4%,但保持稳定推理速度

- TVI tokens 相比其他替代方案(learned special tokens, handcraft tokens)显著提升性能

实际部署:

- 在 110 个真实世界测试场景(50 VLN + 30 搜索 + 30 追踪)中验证,成功率达到 72%~93%

- 支持跨具身体部署:四足机器人(Unitree Go2)、类人机器人、无人机、轮式机器人

- 0.5 秒内生成 8 航点轨迹(1600 token budget)

局限性

该方法在训练时需要大量计算资源(56 NVIDIA H100 GPUs,72 小时)。尽管引入了视觉特征缓存等优化策略,大规模训练仍然是资源密集型任务。此外,在需要遍历 300 米复杂邻域的 Unseen-Map 场景中表现较差,表明模型在大规模环境探索和长距离规划方面仍有改进空间。作者也指出 NavFoM 只是一个起点,未来需要更高质量的数据、更先进的技术以及新一代基准测试来推动泛化导航研究的发展。

21. DGNav (2026)

———动态拓扑感知:打破视觉-语言导航中的粒度刚性

📄 Paper: arXiv:2601.21751

精华

这篇论文解决了 VLN-CE 中的”粒度刚性”问题,值得借鉴的核心思想:

- 自适应结构调整:不仅调整模型参数,还动态调整数据结构本身(拓扑图的节点密度),实现”简单场景保效率、复杂场景保安全”的自适应平衡,这一思路可迁移到其他需要精度/效率权衡的规划任务(如 SLAM、点云处理)。

- 条件干预设计:引入”稳定性门槛”(中位数离散度 σ_med),只在高不确定性场景触发动态调整,而非全局自适应,有效避免了在简单场景引入不必要的噪声——这是一种极具工程实用性的设计思想。

- 多模态软硬约束融合:将几何硬约束(物理可达性)与视觉语义和语言指令软约束通过可学习权重动态融合,使图连接从”物理近邻关系”升级为”语义近邻关系”,为多约束优化提供了优雅解法。

- 线性映射的理论优越性:基于信息论论证了线性映射是保持最大熵属性的最优一阶近似,既优于 Sigmoid 的梯度饱和,又优于 Exponential 的保守偏差——理论驱动设计的典范。

- 结构与训练解耦:Scene-Aware Adaptive Strategy 仅在推理阶段激活,训练阶段使用固定阈值,实现了稳定的特征学习与灵活的测试时推理之间的解耦。

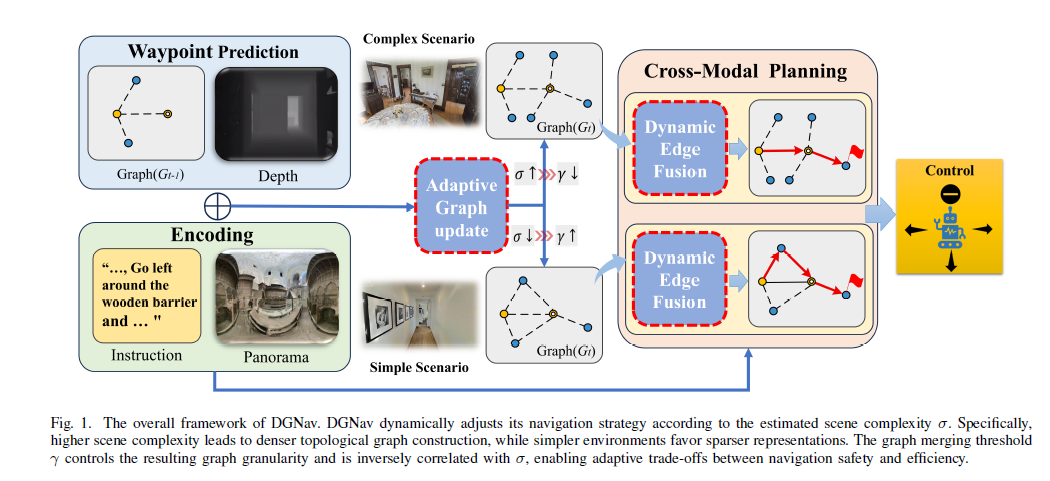

1. 研究背景/问题

VLN-CE(连续环境中的视觉-语言导航)中,现有拓扑规划方法(如 ETPNav)依赖固定的图构建阈值 γ 和静态欧式距离边权重,导致”粒度刚性”问题:在简单低不确定性区域产生大量冗余节点,在复杂高不确定性区域图过于稀疏导致导航失败。更严重的是,纯几何边权重使智能体优先连接物理距离近但语义无关的节点(”导航性近视” Navigational Myopia),无法遵从指令中的语义意图。

主要方法/创新点

论文提出 DGNav (Dynamic Graph Navigation) 框架,包含两大核心模块:

1. 场景感知自适应策略 (Scene-Aware Adaptive Strategy)

针对物理结构层面的粒度刚性问题,提出动态调整图构建阈值的方法:

- 场景复杂度度量:通过分析预测路径点的角度离散度 (angular dispersion) σ 来量化局部场景复杂度:

σ_t = sqrt(1/N_c * Σ(θ_i - θ̄)²)其中 θ_i 是候选节点相对于智能体朝向的角度。高 σ 表示复杂决策边界(如交叉路口),低 σ 表示简单几何结构(如走廊)。

- 条件线性映射控制律:基于统计校准的高斯分布特性,采用线性映射动态调整合并阈值 γ:

γ_t = γ_fix if σ_t ≤ σ_med γ_t = γ_fix - (σ_t - σ_med)/(σ_max - σ_med) * (γ_fix - γ_min) if σ_t > σ_med

- 理论依据:选择线性映射而非 Sigmoid/指数映射的原因是线性变换保持高斯源分布的最大熵特性。非线性映射会在分布尾部引入饱和区域(梯度消失),导致高不确定状态的信息丢失。条件映射策略仅在 σ > σ_med 时激活自适应机制,在稳定场景中保持拓扑稳定性。

2. 动态图 Transformer (Dynamic Graph Transformer)

针对语义逻辑层面的导航近视问题,融合多模态线索动态重构图连接性:

1.Scene-Aware Adaptive Strategy(场景感知自适应策略)

通过计算当前时刻候选节点的角度离散度 $\sigma_t$ 来量化场景复杂度:

\[\sigma_t = \sqrt{\frac{1}{N_c} \sum_{i=1}^{N_c} (\theta_i - \bar{\theta})^2}\]基于 $\sigma_t$,采用条件线性映射动态调整图合并阈值 $\gamma_t$:

\[\gamma_t = \begin{cases} \gamma_{fix} & \text{if } \sigma_t \leq \sigma_{med} \\ \gamma_{fix} - \dfrac{\sigma_t - \sigma_{med}}{\sigma_{max} - \sigma_{med}}(\gamma_{fix} - \gamma_{min}) & \text{if } \sigma_t > \sigma_{med} \end{cases}\]- 简单场景($\sigma_t \leq \sigma_{med}$):$\gamma_t = \gamma_{fix} = 0.5\text{m}$,保持稀疏效率

- 复杂场景($\sigma_t > \sigma_{med}$):线性降低 $\gamma_t$(最低至 $\gamma_{min} = 0.1\text{m}$),生成密集拓扑

$\sigma_{med}$ 和 $\sigma_{max}$ 通过在 ETPNav 基线模型上统计推断得到(数据驱动校准),线性函数的选择基于信息论证明其是保最大熵的最优一阶近似。

2.Dynamic Graph Transformer(动态图 Transformer)

Dynamic Edge Fusion:融合三种信息流构造动态邻接矩阵:

\[\mathbf{E}_{dynamic} = \mathbf{E}_{geo} + \omega_1 \cdot \mathbf{E}_{sem} + \omega_2 \cdot \mathbf{E}_{inst}\]- $\mathbf{E}_{geo}$:归一化欧式距离(物理可达性硬约束)

- $\mathbf{E}_{sem}$:CLIP-ViT 提取的视觉特征通过 MLP 计算的成对相似度

- $\mathbf{E}{inst}$:节点特征与全局指令 token $\mathbf{W}_L$ 的外积相关性分数,即 $w_i = \text{MLP}([v_i; \mathbf{W}_L])$,$E{inst}^{(i,j)} = w_i \cdot w_j$

Graph-Aware Self-Attention (GASA):

\[\text{GASA}(\mathbf{H}^l, \mathbf{E}_{dynamic}) = \text{Softmax}\!\left(\frac{(\mathbf{H}^l \mathbf{W}_Q)(\mathbf{H}^l \mathbf{W}_K)^\top}{\sqrt{d_k}} + \mathbf{E}_{dynamic}\right)\!(\mathbf{H}^l \mathbf{W}_V)\]将 $\mathbf{E}{dynamic}$ 直接叠加到注意力分数上,强制模型关注语义相关($\omega_1 \cdot \mathbf{E}{sem}$)且指令对齐($\omega_2 \cdot \mathbf{E}{inst}$)的节点,同时 $\mathbf{E}{geo}$ 保证物理约束不被完全忽略,实现从纯几何到语义驱动的平滑过渡。

训练策略:采用两阶段训练,Adaptive Strategy 仅在推理阶段激活,训练阶段固定 $\gamma = 0.5\text{m}$ 确保稳定的特征学习。

3. 核心结果/发现

R2R-CE 数据集:

- Val-Unseen:SR 64.82%,SPL 50.08%,超越 ETPNav 基线(+4.66% SR,+2.21% SPL)

- Test-Unseen:SR 64%(+1% vs ETPNav),SPL 47%,NE 下降 0.2m

- 超越所有 End-to-End 方法和显式地图方法(含 GridMM, Safe-VLN, OVL-MAP)

RxR-CE 数据集(多语言,更长路径):

- Val-Unseen:SR 53.78%,nDTW 62.04%(+0.55%),SDTW 44.49%(+0.57%)

- 路径保真度指标全面超越 ETPNav,证明在长时域细粒度指令遵从上的优越性

消融实验关键发现:

- 条件线性映射 vs 全局线性映射:SR +1.52%(稳定性门槛机制的贡献)

- 动态 $\gamma$ vs 固定 $\gamma$(0.25/0.40/0.50m):SR 最高提升 +1.63%,且计算开销仅增加 0.4 个节点

- 完整 $\mathbf{E}_{dynamic}$ vs 仅几何:SR 大幅提升,验证语义软约束的关键作用

- 定性分析(Fig.9):在”绕过木质围栏”场景中,仅几何模型因物理距离过近而提前错误转向,DGNav 正确识别指令语义并忽略了几何干扰,成功到达目标

4. 局限性

自适应策略的核心参数($\gamma_{fix}, \gamma_{min}, \sigma_{med}, \sigma_{max}$)通过在 R2R-CE 训练集上进行统计校准获得,在分布外场景(如户外环境、高度动态场景)中的泛化能力尚未验证;同时,随着导航轨迹增长,拓扑图规模持续膨胀,论文未讨论图压缩和历史节点管理策略,在超长路径任务中可能面临内存和计算的挑战。

22. MapNav (2025)

———A Novel Memory Representation via Annotated Semantic Maps for Vision-and-Language Navigation

📄 Paper: arXiv:2502.13451

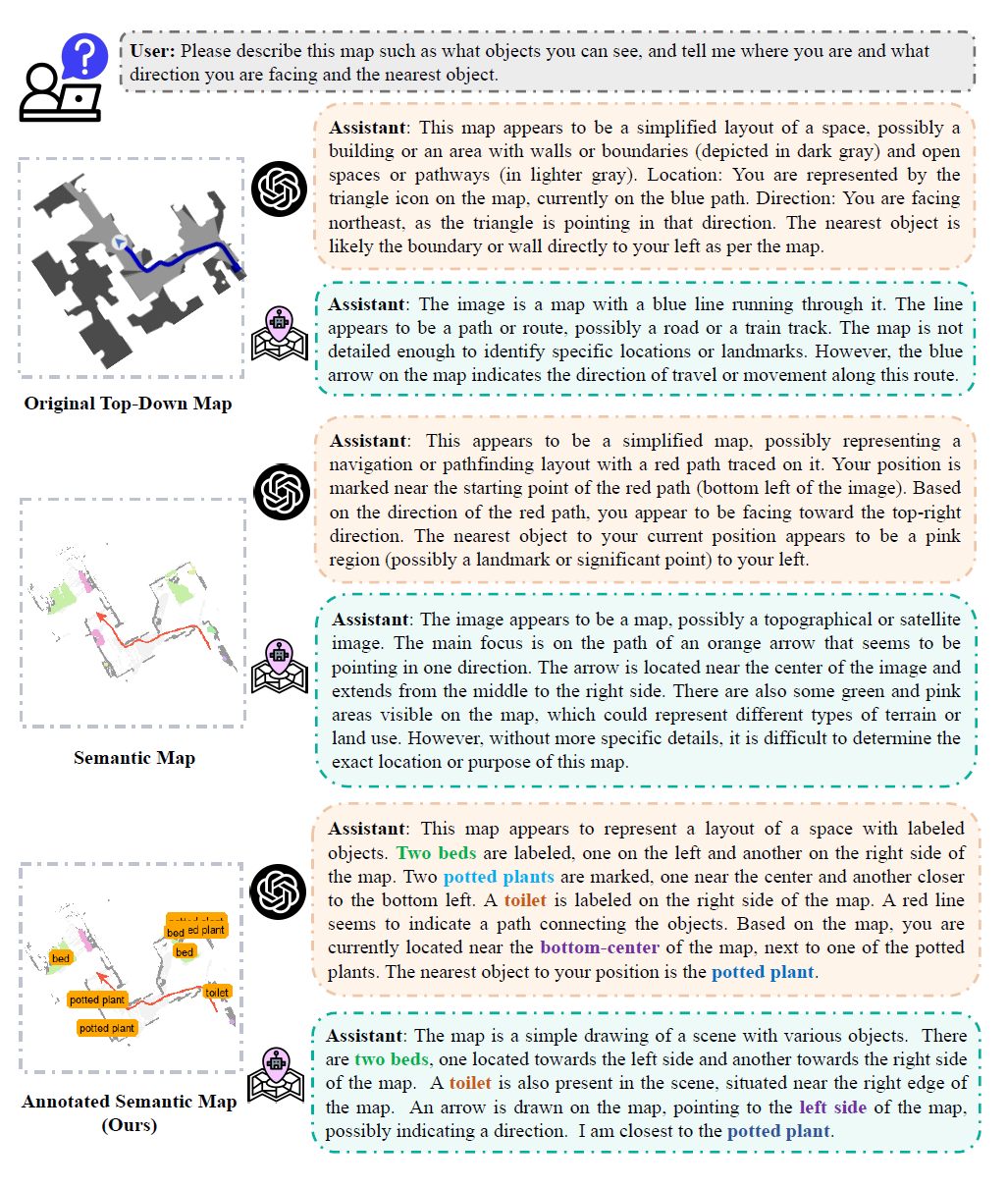

精华

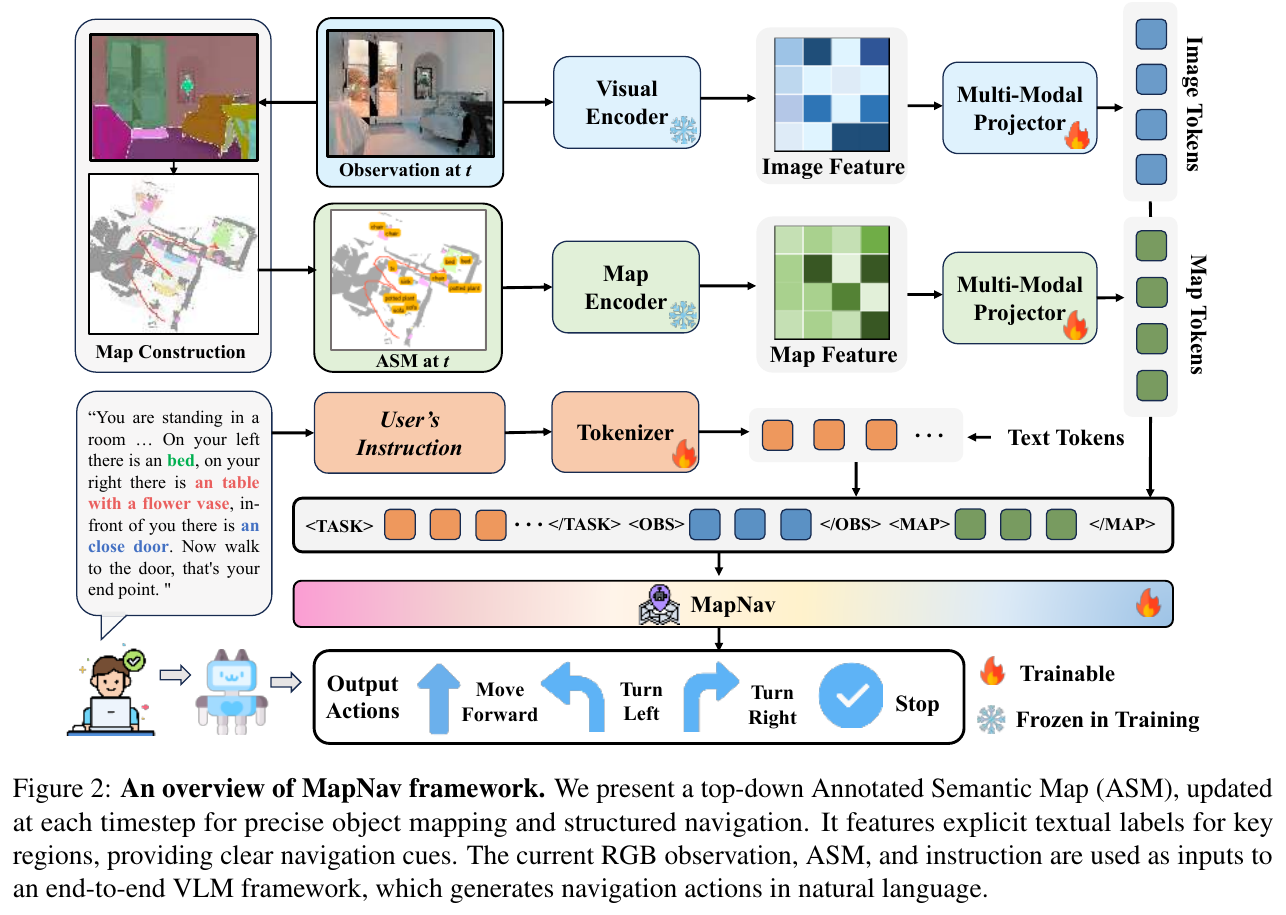

MapNav 的核心创新在于用轻量级的 Annotated Semantic Map (ASM) 替代传统的历史 RGB 帧序列作为记忆表示,实现了恒定 0.17MB 的内存占用(与步数无关),推理速度提升 79.5%。值得借鉴的关键思想:将语义地图与自然语言标注相结合,使 VLM 能够直接理解空间信息,而无需额外的解码器;用结构化的 top-down 地图取代时序帧,把”历史信息”从时间维度转移到空间维度,大幅降低计算开销。这种”语言化地图”的思路为 VLM 赋能导航提供了一个清晰且高效的范式。

研究背景/问题

Vision-and-Language Navigation (VLN-CE) 要求 agent 在连续三维环境中跟随自然语言指令导航。现有方法大量依赖历史 RGB 帧作为时序上下文,导致内存随轨迹长度线性增长(Navid 在 300 步时高达 276MB),且无法充分利用 VLM 对语言的理解能力。设计一种高效的记忆表示以替代历史帧,成为本工作的核心动机。

主要方法/创新点

MapNav 提出一个端到端的 VLM-based VLN 框架,核心组件是在线更新的 Annotated Semantic Map (ASM)。

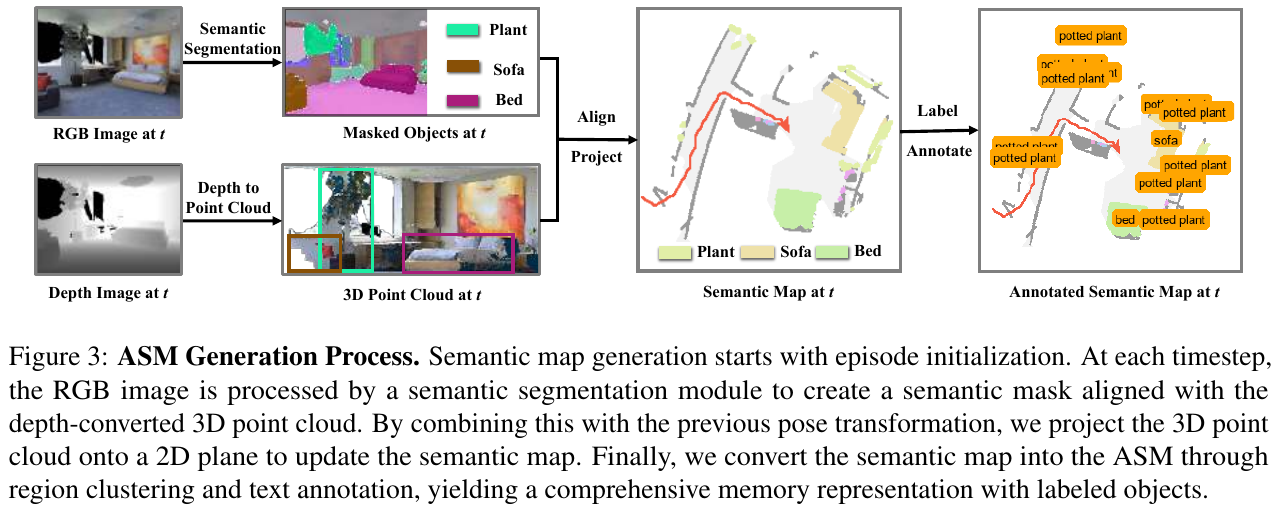

ASM 生成流程

ASM 是一个多通道张量 M(维度 $C \times W \times H$,$C = C_n + 4$),其中:

- 基础通道(1-4):编码障碍物分布、已探索区域、agent 当前位置、历史轨迹

- 语义通道(n个):存储各目标物体的空间分布

生成流程:

- 用 Mask2Former 对当前 RGB 帧做语义分割,提取目标 mask

- 结合深度图将 3D 点云投影到 2D 俯视平面,对齐语义 mask

- 对每个语义区域做连通分量分析,计算区域质心并在地图上添加文字标签(如 “chair”、”potted plant”)

- 生成最终 ASM,包含物体位置、轨迹、障碍物等结构化信息

为什么 ASM 优于普通语义地图?

实验证明,VLM(GPT-4o 和 MapNav)处理 ASM 时表现出对物体位置的精准理解(注意力峰值 > 0.8),而处理原始 top-down 地图(峰值 < 0.3)或语义地图(峰值 < 0.4)时注意力极为分散。ASM 通过显式文字标注将抽象语义转化为语言基础,充分激活 VLM 预训练的语言理解能力。

双流编码器架构

MapNav 基于 LLaVA-Onevision 框架,使用 SigLIP-so400m 视觉编码器:

\[\mathbf{F}_t = \Phi_{spatial}(\mathbf{X}_t, \mathcal{G}), \quad \mathbf{F}_t^M = \Phi_{spatial}(\mathbf{X}_t^M, \mathcal{G})\]两路特征分别通过 MLP 投影对齐到语言空间,最终拼接为统一表示:

\[\mathbf{V}_t = [\text{TASK}; \mathbf{E}_t; \text{OBS}; \mathbf{E}_t^M; \text{MAP}]\]动作预测

VLM 直接输出自然语言动作,通过正则表达式匹配解析为 {前进, 左转, 右转, 停止} 四类动作,无需额外动作解码器。

训练数据(~1M 样本)

三阶段数据收集:

- Phase I:来自 R2R + RxR 的 GT 轨迹(~300k × 2)

- Phase II:DAgger 在线交互采集(~200k × 2)

- Phase III:碰撞恢复专项数据(~25k × 2)

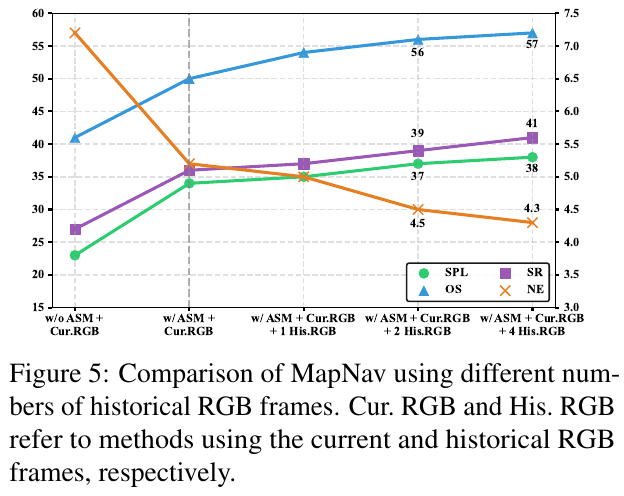

历史帧数量的消融

加入 ASM 后,SR 从 27% 提升至 36%,SPL 从 23% 提升至 34%;继续增加历史 RGB 帧带来的提升则相当有限,说明核心增益来自 ASM 的空间表示能力,而非时序帧累积。

核心结果/发现

模拟环境(R2R-CE & RxR-CE Val-Unseen)

| 方法 | R2R SR↑ | R2R SPL↑ | RxR SR↑ | RxR SPL↑ |

|---|---|---|---|---|

| NaVid (All RGB Frames) | 49.1 | 37.4 | 23.8 | 21.2 |

| MapNav (w/o ASM + Cur. RGB) | 41.2 | 27.1 | 15.6 | 12.2 |

| MapNav (w/ ASM + Cur. RGB) | 50.3 | 36.5 | 22.1 | 20.2 |

| MapNav (w/ ASM + Cur. + 2 His. RGB) | 53.0 | 39.7 | 32.6 | 27.7 |

- 仅用 ASM + 单帧 RGB,性能即可媲美使用全部历史帧的 NaVid

- 加入 2 帧历史 RGB 后超越所有 SOTA,R2R SPL 提升 1.3%,RxR SPL 提升 6.5%

效率对比(关键优势)

| 方法 | 1步 | 10步 | 100步 | 300步 | 平均推理时间 |

|---|---|---|---|---|---|

| Navid | 0.92MB | 9.2MB | 92MB | 276MB | 1.22s |

| MapNav | 0.17MB | 0.17MB | 0.17MB | 0.17MB | 0.25s |

- 内存占用恒定 0.17MB,与轨迹长度完全解耦

- 推理速度提升 79.5%(1.22s → 0.25s)

真实世界(5种室内场景)

在 Office、Meeting Room、Lecture Hall、Tea Room、Living Room 中,MapNav 在简单指令和语义指令下均全面超越 WS-MGMAP 和 Navid,SR 提升最高达 30%。

局限性

语义分割模块在遮挡或光照变化等复杂条件下可能产生不准确的物体标签,从而影响 ASM 质量。未来计划扩展到更复杂的具身 AI 任务(如交互导航和操作),需将物体可供性和物理交互能力整合进 ASM 表示。

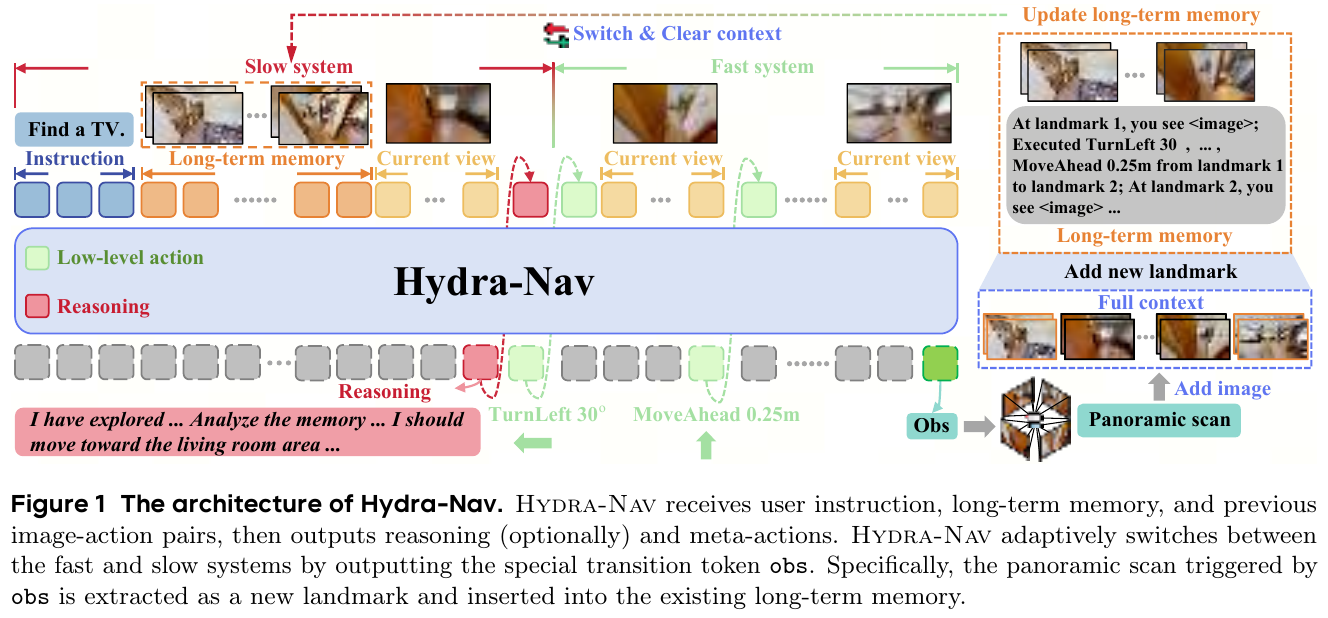

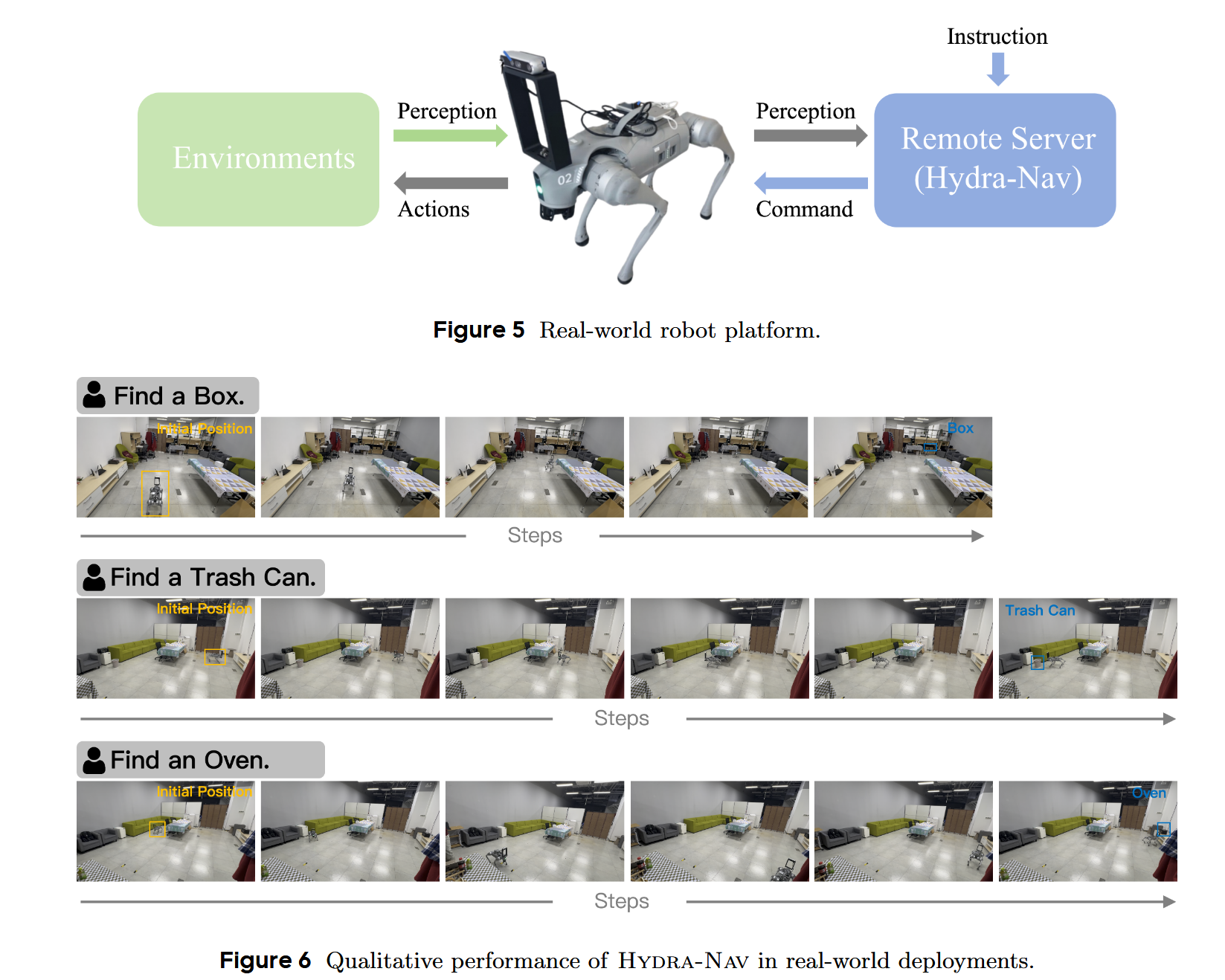

23. Hydra-Nav (2026)

——Object Navigation via Adaptive Dual-Process Reasoning

📄 Paper: arXiv:2602.09972

精华

Hydra-Nav 最值得借鉴的核心思想是:将”慢思考”(CoT 推理)与”快行动”(低级反应控制)统一在单个 VLM 内,避免了多模型架构的碎片化问题。其关键创新在于通过 Iterative Rejection Fine-Tuning (IRFT) 让模型自主学习”何时触发推理”,而非固定频率触发,从而在成功率与推理开销之间取得最优平衡。三阶段课程训练(空间-动作对齐 → 记忆-推理集成 → 自适应推理)的渐进式设计,为构建具身导航智能体提供了可复用的训练范式。新提出的 SOT 指标(Success weighted by Operation Time)将推理延迟纳入评估,比 SPL 更贴近实际部署需求,值得在其他具身任务中推广使用。

研究背景/问题

Object goal navigation 要求机器人仅凭自我中心感知在真实环境中主动探索并定位目标物体。当前 VLM-based 方法存在两大核心缺陷:(1)时空推理能力不足,导致对已探索区域的记忆维护失效,引发重复探索;(2)在每步推理(chain-of-thought)的做法带来大量不必要的计算开销,而在关键”停滞点”又未能及时触发推理。现有双系统架构(slow-fast paradigm)依赖独立模型,存在架构割裂和切换灵活性不足的问题。

主要方法/创新点

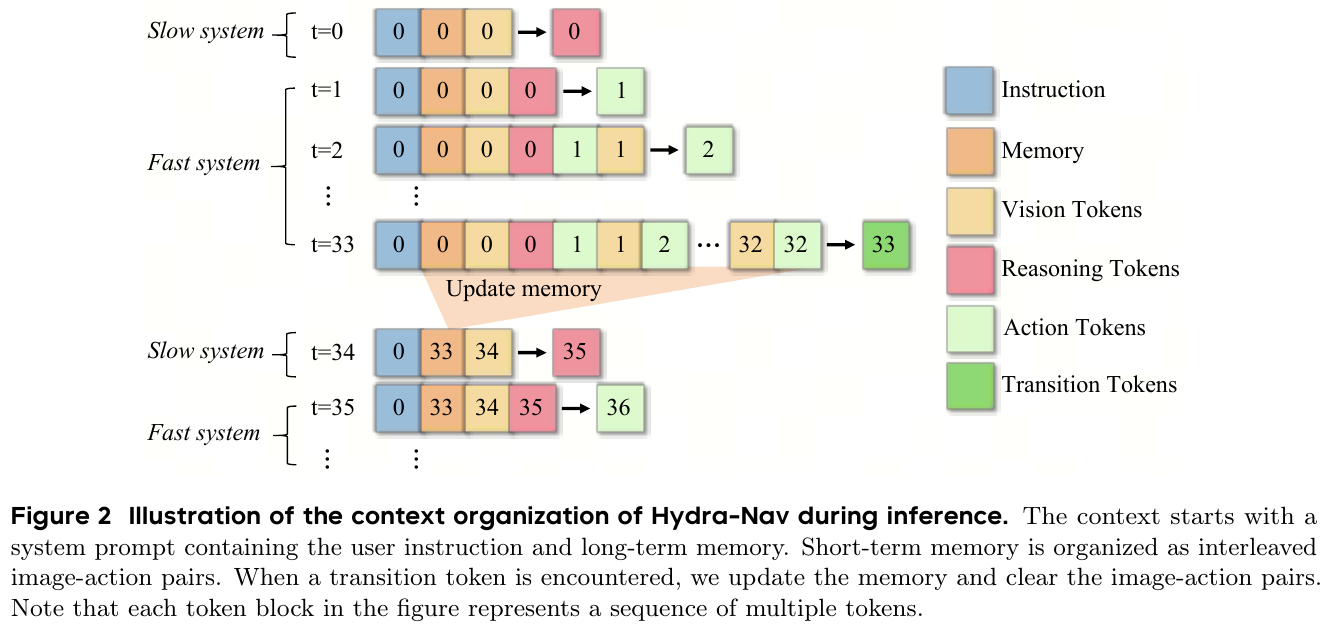

Hydra-Nav 将高层规划与低层元动作统一在单一 VLM(基于 Qwen2.5-VL-7B)内,通过输出特殊 transition token obs 自主触发从快系统到慢系统的切换。

双过程系统(Dual-process System)

- 慢系统(Slow system):接收目标指令、当前全景观测(4 张 90° 间隔 RGB 图)和结构化长期记忆,生成 CoT 推理文本与高层计划,随后输出第一个元动作。

- 快系统(Fast system):基于上一慢系统的对话历史,利用 KV-caching 仅编码最新自我中心帧,自回归解码低级原子动作(MoveAhead 0.25m、TurnLeft/Right 30°),避免重复处理完整历史上下文。

- 自适应切换机制:当智能体完成子目标或当前观测与现有计划矛盾时,输出

obs触发全景扫描,构建新的地标节点并更新长期记忆,随后重新进入慢系统。

三阶段课程训练(Curriculum Training Pipeline)

Stage 1 — 空间-动作对齐(Spatial-Action Alignment)

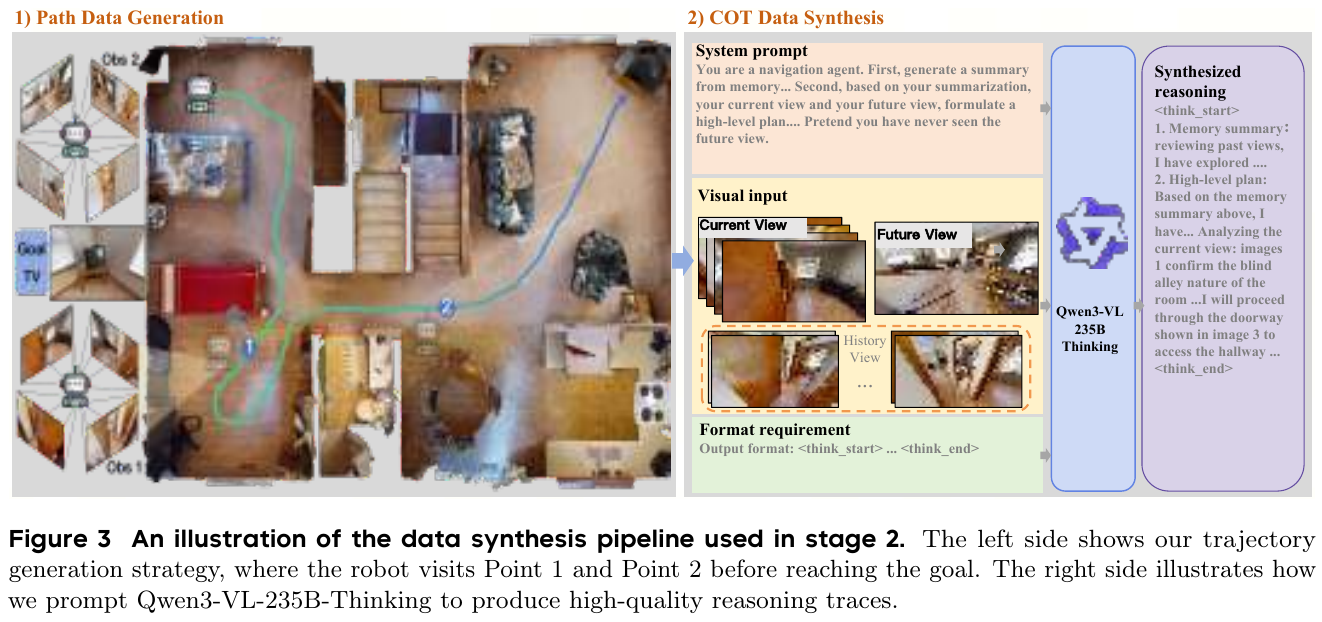

使用 A* planner 在 HM3D、MP3D、OVON 训练集上生成 500K 条轨迹(20.1B tokens),训练 Qwen2.5-VL-7B 学习基本导航动作执行。每条轨迹格式化为多轮对话,通过单次前向-反向传播完成梯度计算。

Stage 2 — 推理-记忆集成(Reasoning-Memory Integration)

- 使用启发式路点选择策略生成包含探索行为的轨迹(而非仅最短路径),每条轨迹选取分数最高的两个探索路点。

- 将轨迹分段(固定长度 16 步),在每段开头插入长期记忆和推理文本,段尾插入

obstoken。 - 推理文本合成:先用 Qwen3-VL-235B-Thinking 对历史图像进行记忆摘要,再结合当前视图与”未来正确视图”(信息泄漏防止)生成前瞻性规划文本。

- 共生成 565K 条混合样本(8.3B tokens),同时混入 VQA 数据防止过拟合。

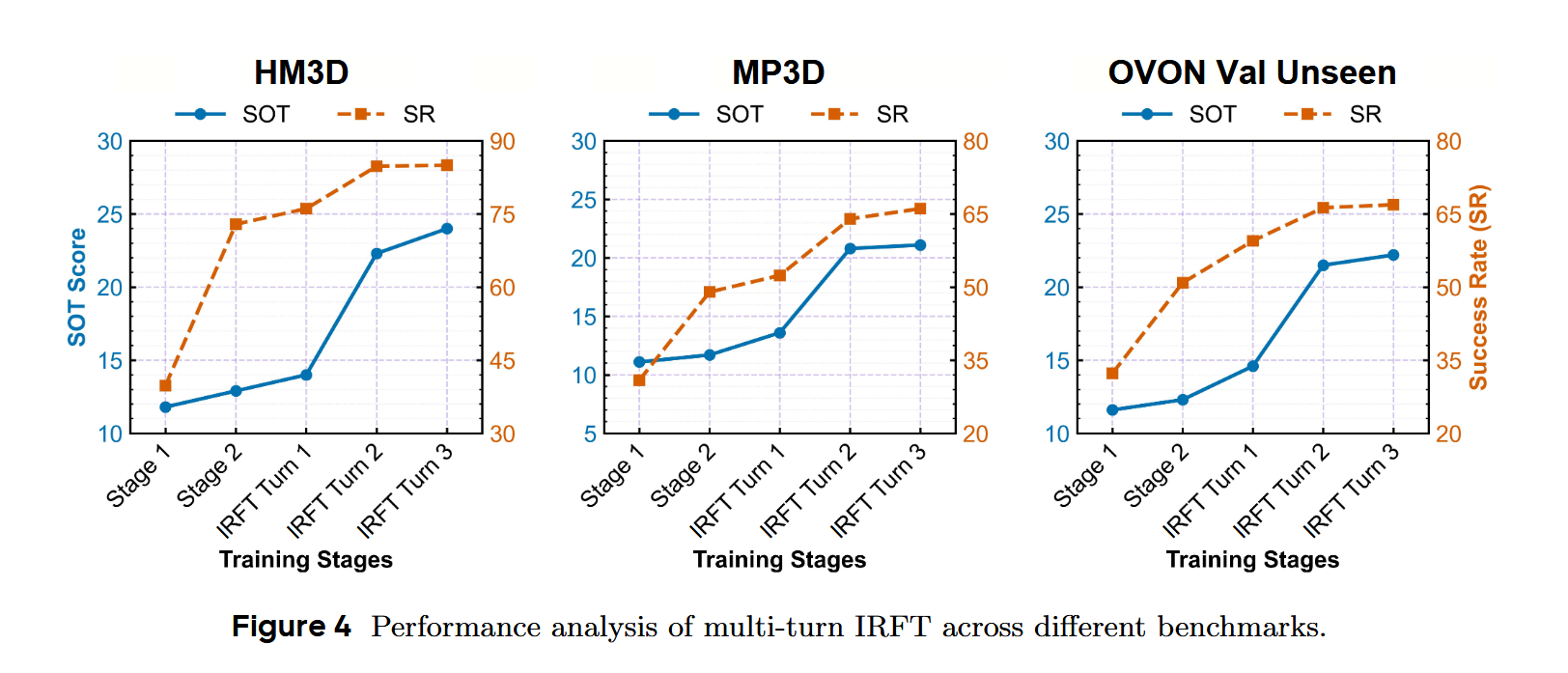

Stage 3 — 自适应推理(Adaptive Reasoning via IRFT)

定义两类停滞点(Stagnation Points):

- 重复探索:智能体在过去 $T_{stag}=20$ 步内回到距离 $\delta_{stag}=0.5$m 内的位置。

- 缺乏进展:在随机时间窗口 $\Delta t \sim \mathcal{U}(20,35)$ 内到目标距离未缩短。

IRFT 流程:在快系统模式下运行,于停滞点触发慢系统;对失败轨迹(超时或目标误识别)进行”拒绝-修复”——找到干预时间戳 $t^$,用 A 最优路径替换后续轨迹,重新合成修正段的推理文本;使用最新 checkpoint 迭代执行,每轮生成约 60K 条轨迹(4.5B tokens)。

核心结果/发现

与 SOTA 对比(Table 2):

| Benchmark | 指标 | Hydra-Nav-IRFT | 第二名 | 提升 |

|---|---|---|---|---|

| HM3D Val | SR | 84.8% | 73.7% | +11.1% |

| MP3D Val | SR | 64.0% | 46.6% | +17.4% |

| OVON Val-Unseen | SR | 66.3% | 45.2% | +21.1% |

SOT 指标分析(Table 5):

- Hydra-Nav-IRFT 推理触发比例仅 3.0%(HM3D),而 VLMnav/Nav-R²/WMNav 均为 100%。

- SOT 得分:Hydra-Nav-IRFT 24.0(HM3D)vs Nav-R² 1.9(最高 SR 竞争者),提升约 12×。

- 说明频繁推理虽提高 SR,但严重拖累效率;自适应推理是实际部署的关键。

消融实验关键发现:

- 记忆模块对 SPL 提升显著(无记忆 SPL=13.9 vs 有记忆 28.8),说明长期空间记忆是路径效率的核心。

- 探索性轨迹数据 vs 最短路径数据:SR 下降 25.4%(HM3D),说明探索能力对高成功率不可或缺。

- Co-training with VQA 防止导航专有数据过拟合,维持泛化性(SR: 69.1→72.9,HM3D)。

局限性

评估仅在 Habitat 模拟器(HM3D/MP3D/OVON)中进行,缺乏在 Isaac Sim 等更高保真度仿真环境中的验证;当前框架专为 object navigation 设计,向移动操作等更复杂具身任务的扩展有待探索。

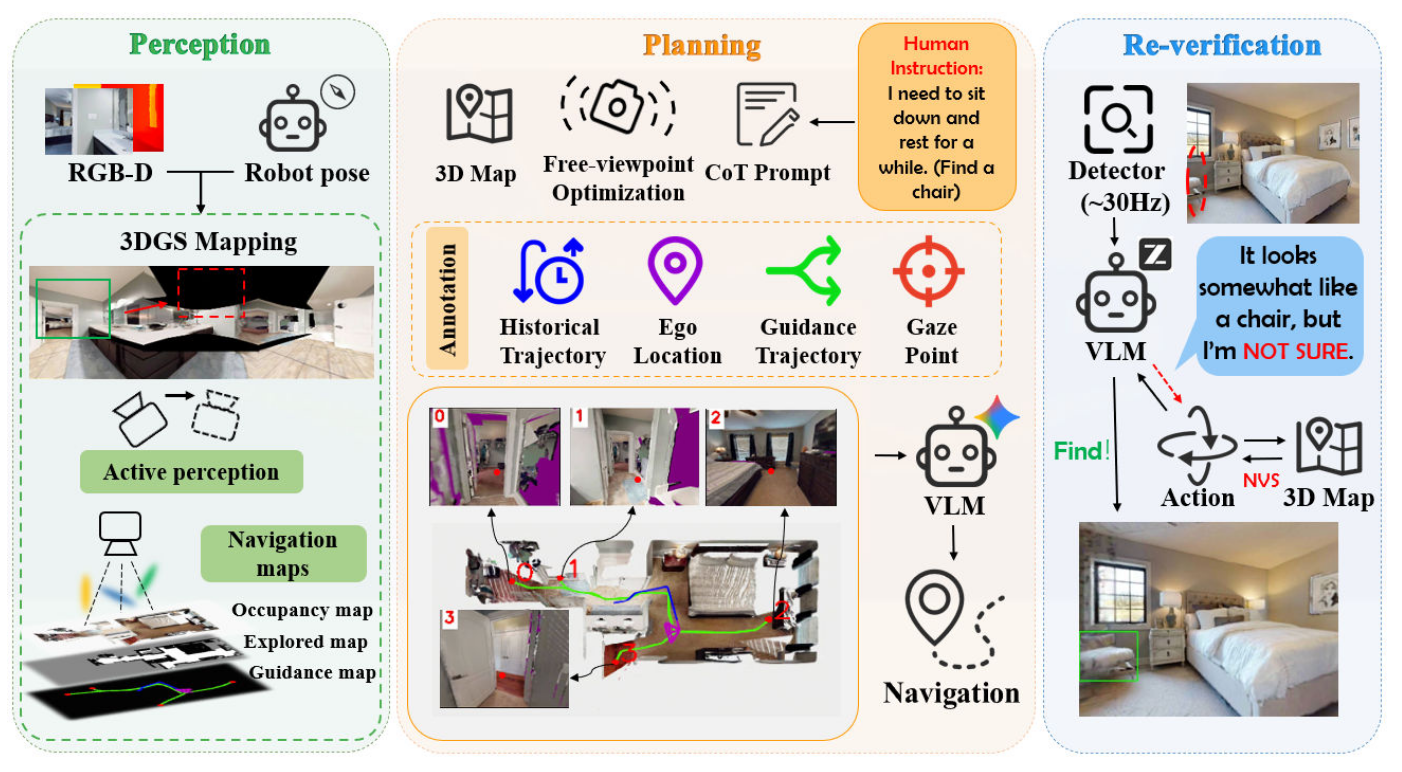

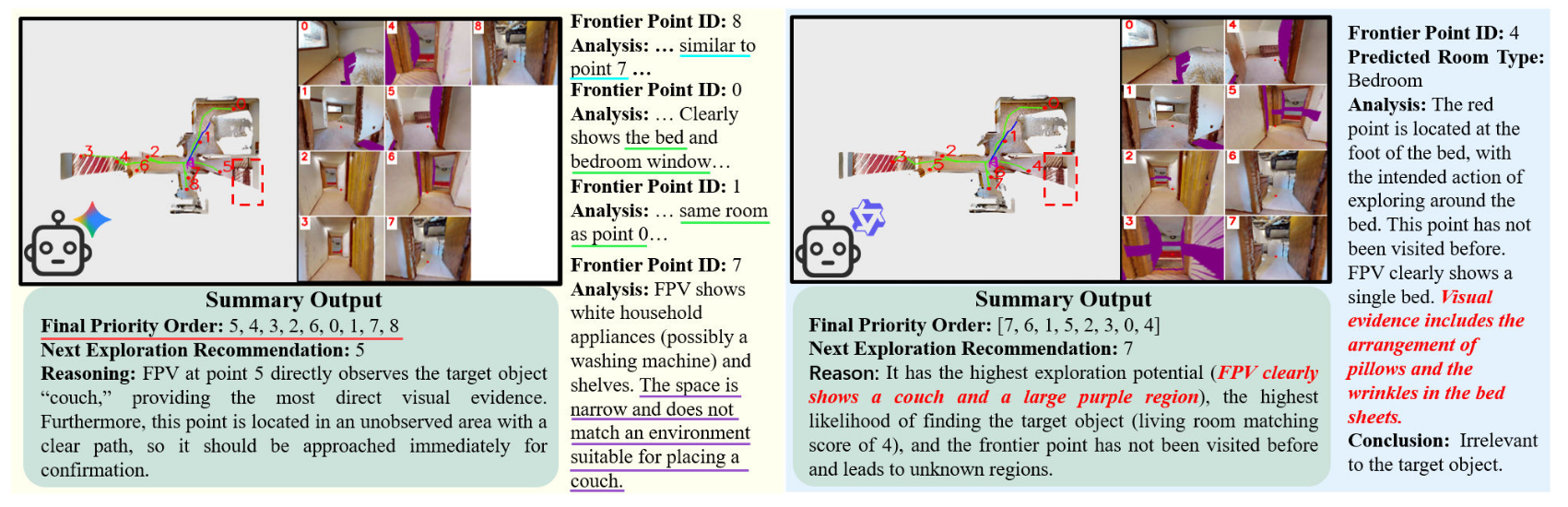

23. 3DGSNav (2026)

———用主动 3DGS 记忆增强 VLM 空间推理,实现零样本目标导航

📄 Paper: arXiv:2602.12159

精华

3DGSNav 最值得借鉴的核心思想:

- 将 3DGS 作为持久记忆替代语义地图/文字描述,让 VLM 直接”看”到几何连续的场景,而非依赖中间抽象层,从而释放 VLM 本身的视觉空间推理能力。

- 主动感知(Active Perception)+ 自由视角优化:代理不被动旋转扫描,而是通过不透明度场(opacity field)主动定位视觉盲区,再利用 3DGS Novel View Synthesis 渲染最优视角——这种”按需生成观测”的模式可推广到其他需要视角控制的具身任务。

- 结构化视觉提示(Structured Visual Prompts)+ CoT 融合:在渲染图像上叠加注释(gaze point、未探索区域标注),配合 Chain-of-Thought,让 VLM 的长程规划推理能力得到充分激活,无需额外训练。

- 实时检测 + VLM 重验证(Re-verification):先用轻量检测器初筛候选目标,再用 VLM 主动切换视角确认——分两阶段解耦效率与可靠性,是目标确认模块的通用设计范式。

研究背景/问题

现有零样本目标导航(ZSON)方法通常将环境转换为语义地图或文字描述,导致高层决策被低层感知精度所制约,VLM 的视觉空间推理能力无法充分发挥。如何让 VLM 直接基于高质量视觉观测进行空间推理,而非依赖降维后的语义抽象,是本文解决的核心问题。

div align=”center”>

</div>

主要方法/创新点

3DGSNav 是一个基于 3D Gaussian Splatting 的 ZSON 框架,核心由三个模块组成:

1. 主动感知(Active Perception)模块

- 使用虚拟相机渲染全景不透明度场(panoramic opacity field),定量估计当前观测完整性

- 利用 DBSCAN 聚类低不透明度区域,识别视觉盲区,计算最优俯仰角 θ* 和偏航角 ϕ*,驱动真实相机主动补偿缺失视角

- 避免机械旋转带来的定位误差与冗余观测

2. 自由视角规划(Free-Viewpoint Planning)模块

- 前沿点提取与聚类:在 3DGS 空间构建探索地图,提取 frontier points(已探索与未探索边界),通过距离场 + 分水岭分割(watershed segmentation)自适应聚类冗余前沿点,选代表性点降低 VLM 分析开销

- 引导轨迹(Guidance Trajectory):基于 Dijkstra + 指数惩罚障碍物距离的代价函数,为每个前沿点生成安全路径,作为自由视角优化的参考基准

- 虚拟视角初始化:利用轨迹曲率 κ 和距离 d 加权得分选最优初始位置,确保既不过近(优化不稳定)也不过远(信息量低)

- 多约束视角优化:最小化复合损失函数 ℒ = λ_opa·ℒ_opa + λ_vis·ℒ_vis + λ_cos·ℒ_cos + λ_traj·ℒ_traj,包含:

- Opacity Loss:控制可见/不可见区域比例

- Ray Occlusion Loss:确保虚拟相机视线直达前沿点(无遮挡)

- Cosine Loss:约束视角方向与前沿点方向一致

- Trajectory Loss:约束相机位置在轨迹附近

3. 结构化视觉提示 + VLM 推理

- 渲染 Bird’s-Eye View(BEV)+ 多个前沿点的 First-Person Views(FPVs)

- 在图像上叠加结构化注释:注视点(gaze point)、未观测区域表示(unobserved region)

- 配合 Chain-of-Thought(CoT)提示,驱动 planner VLM(Gemini 3)对候选前沿点进行空间语义推理,选择最优探索目标

4. 实时检测 + VLM 主动重验证(Re-verification)

- 导航过程中使用轻量实时检测器(YOLOE)初步筛选候选目标

- 当检测置信度不足时,action-decision VLM(GLM-4.1V-Thinking)主动切换视角——将所选动作投影回 3DGS 渲染新视角,获取更具判别力的观测,完成目标二次确认

- 有效降低漏检率和误停率

核心结果/发现

div align=”center”>

</div>

- 在 HM3D、MP3D、Gibson 等多个 ObjectNav 标准 benchmark 上取得 SOTA 或竞争性性能

- 消融实验验证:自由视角优化、结构化注释、CoT、Re-verification 模块均对最终 Success Rate 有显著贡献

- 不同 VLM(Gemini 3、GPT-4V、GLM-4.1V 等)可灵活替换,框架具备良好兼容性

- 在四足机器人真实环境实验中成功复现(定位厕所等目标),验证了 sim-to-real 迁移能力

- Runtime 分析显示主动感知显著优于被动旋转扫描,探索效率更高

局限性

3DGS 的在线增量重建和自由视角优化带来一定计算开销,在计算资源受限的嵌入式平台上实时性仍有挑战;此外,真实场景的动态物体、运动模糊和视觉感知噪声会影响 3DGS 质量,进而影响导航可靠性。

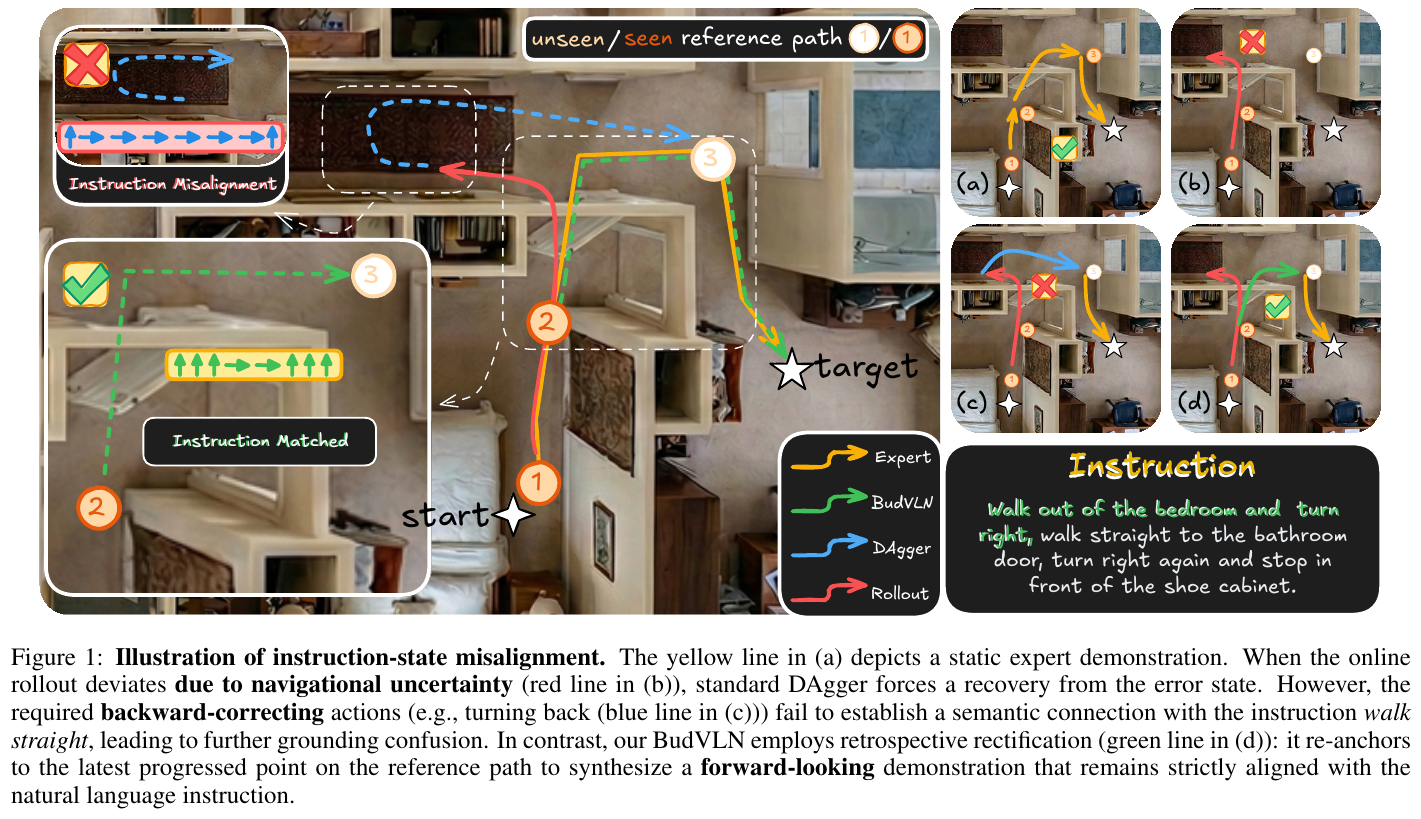

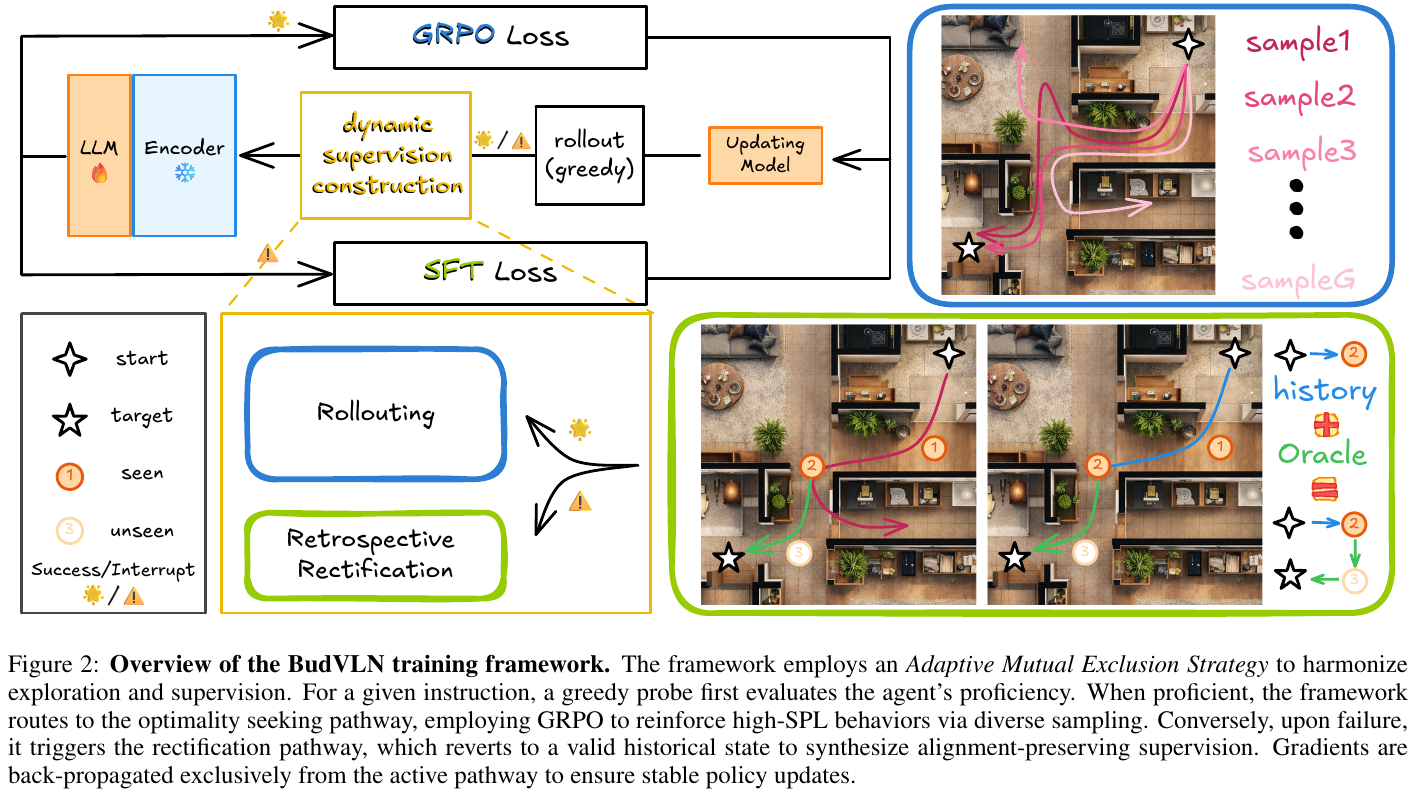

24.BudVLN (2026)

———Nipping the Drift in the Bud: Retrospective Rectification for Robust Vision-Language Navigation

📄 Paper: arXiv:2602.06356

精华

- 核心思想:通过“回顾式纠偏”(Retrospective Rectification)解决 Vision-Language Navigation (VLN) 中的指令-状态不一致问题。

- 训练范式:引入了 Adaptive Mutual Exclusion Strategy,将样本动态分流为效率路径和鲁棒性路径,实现了精准训练。

- 纠偏机制:利用“回锚”机制合成语义一致的修正轨迹,避免了传统方法中强制回归导致的语义冲突。

- 极致效率:采用 GRPO 算法(借鉴自 DeepSeek-R1),无需价值网络,训练成本仅为传统 DAgger 的约 25%。

- 性能卓越:在 R2R-CE 和 RxR-CE 基准测试上刷新 SOTA,尤其在处理偏差和鲁棒性方面表现突出。

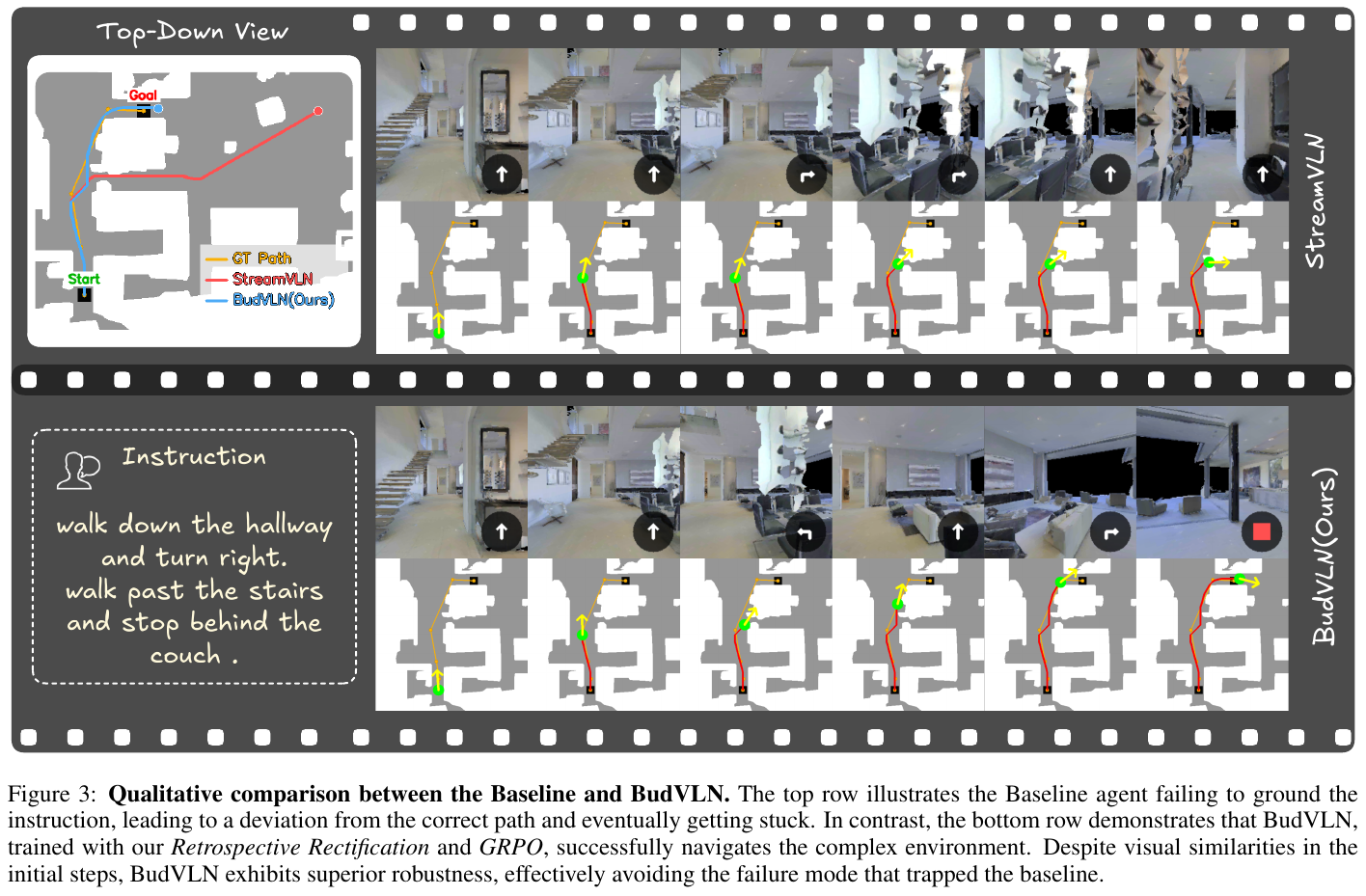

1. 研究背景/问题

当前的视觉-语言导航(VLN)系统面临严重的曝光偏差(Exposure Bias)问题:推理时的细微偏差会导致严重的累积误差。虽然 DAgger 类方法尝试通过纠正错误状态来缓解这一问题,但论文指出这些方法存在指令-状态不一致(Instruction-State Misalignment)的致命局限。如图 1 所示,强制智能体从离群状态回归往往会生成与其原始语言指令相冲突的监督信号(例如:指令要求直行,但为回归正轨必须掉头),这会损害智能体的指令遵循能力。

2. 主要方法/创新点

论文提出了 BudVLN,一个旨在通过统一的在线回顾式纠偏框架解决上述挑战的系统。

Adaptive Mutual Exclusion Strategy (自适应互斥策略)

BudVLN 并不对所有样本一视同仁,而是采用一种自适应策略进行动态路由:

- Proficiency Pathway (效率路径):通过 Greedy Probe 评估。若智能体已能熟练完成任务,则利用 GRPO (Group Relative Policy Optimization) 进行组内相对优势学习,进一步优化路径效率。

- Rectification Pathway (纠偏路径):若智能体在任务中失败,则触发回顾式纠偏。

Retrospective Rectification (回顾式纠偏)

针对失败样本,BudVLN 执行以下操作:

- 回锚(Anchor Identification):将状态回溯到发生偏差前的最后一个有效路径点(Valid Anchor)。

- 语义一致性合成:利用 Oracle 合成从该锚点出发的正确轨迹,以此作为 SFT 的监督信号。 这种方法确保了监督信号与原始指令的语义一致性,彻底解决了 DAgger 的语义冲突问题。

GRPO 优化

受到大规模推理模型成功的启发,BudVLN 引入了 GRPO 算法。它通过在一个采样组内计算相对优势,摆脱了对昂贵价值网络(Value Network)的依赖,极大地降低了计算开销,同时提升了探索效率。

3. 核心结果/发现

- SOTA 性能:在 R2R-CE 和 RxR-CE 两个主流基准测试中,BudVLN 全面超越了现有模型。在 R2R-CE 上,成功率 (SR) 达到 57.6%,SPL 达到 51.1%。

- 训练效率:得益于 GRPO 算法和高效的纠偏机制,BudVLN 仅需 27 GPU 小时 即可完成训练,相比 DAgger 的 114 小时,效率提升了近 4 倍。

- 消融研究:实验证明,单独添加纠偏机制能显著提升 SR,而 GRPO 算法则对 SPL 的提升和训练效率的优化起到了关键作用。

4. 局限性

虽然 BudVLN 在离散和连续环境中均表现出色,但其鲁棒性目前仍受限于预定义 Oracle 的质量。在极度复杂的极端环境下,如何自主生成更高质量的“回顾性”知识仍是未来研究的方向。

25. Open-Nav (2025)

———Zero-Shot VLN in Continuous Environment with Open-Source LLMs

📄 Paper: https://arxiv.org/abs/2409.18794

精华

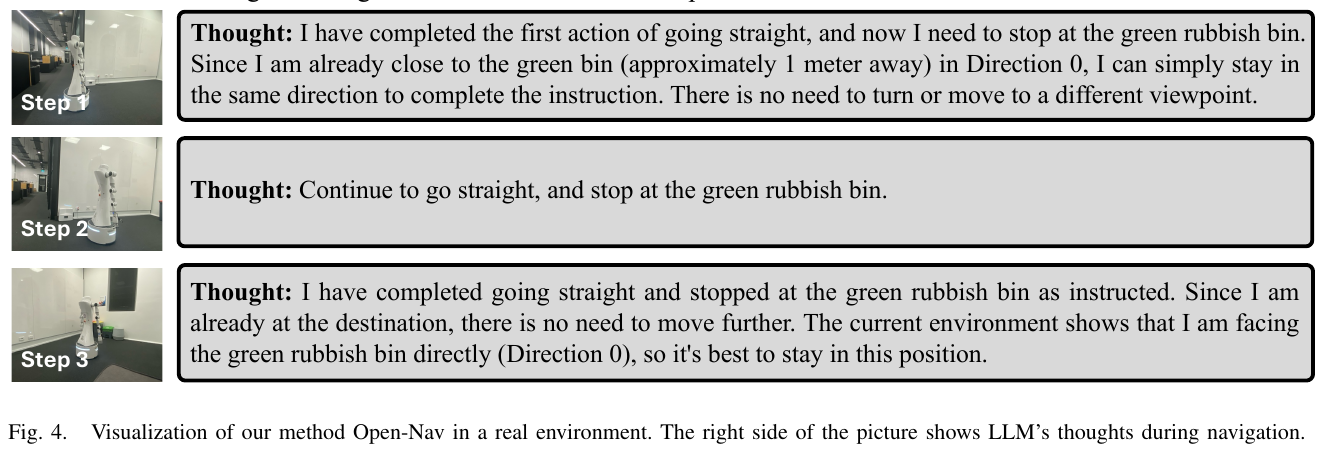

Open-Nav 的核心贡献在于将昂贵的 GPT-4 API 替换为本地部署的开源 LLM,同时维持竞争力性能,这对隐私敏感的真实场景机器人部署有重要意义。论文设计的三阶段空间-时序 CoT(指令理解 → 进度估计 → 决策制定)是一种可复用的 LLM 导航推理框架,值得借鉴。用 SpatialBot + RAM 联合增强视觉感知的思路——一个负责空间关系理解,一个负责细粒度目标识别——有效弥补了开源 LLM 相比 GPT-4 在视觉感知上的差距。真实世界评估结果显示,无训练的 Open-Nav 甚至超越了有监督训练的 SOTA 方法,说明 LLM 的泛化能力在分布外场景中优势显著。

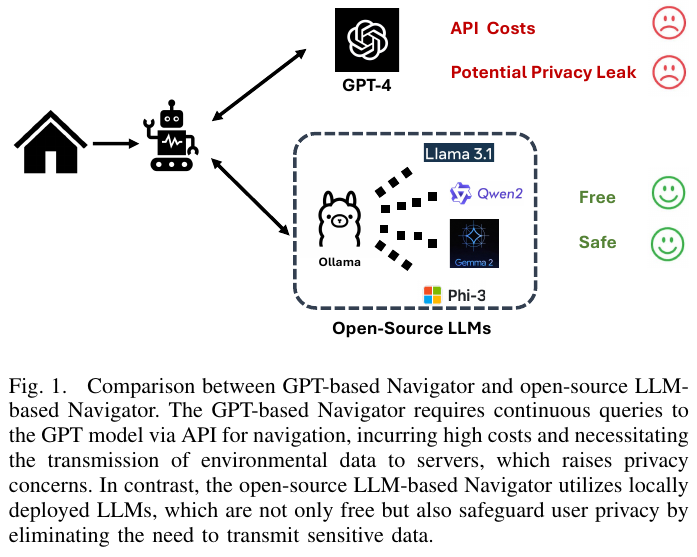

1. 研究背景/问题

Vision-and-Language Navigation in Continuous Environments (VLN-CE) 要求 agent 在未见过的 3D 室内环境中,根据自然语言指令进行导航。现有基于 LLM 的零样本方法(如 NavGPT、DiscussNav)严重依赖 GPT-4 API,存在高昂 token 费用和用户环境数据隐私泄露风险,且主要在离散环境中验证,难以直接应用于连续真实场景。

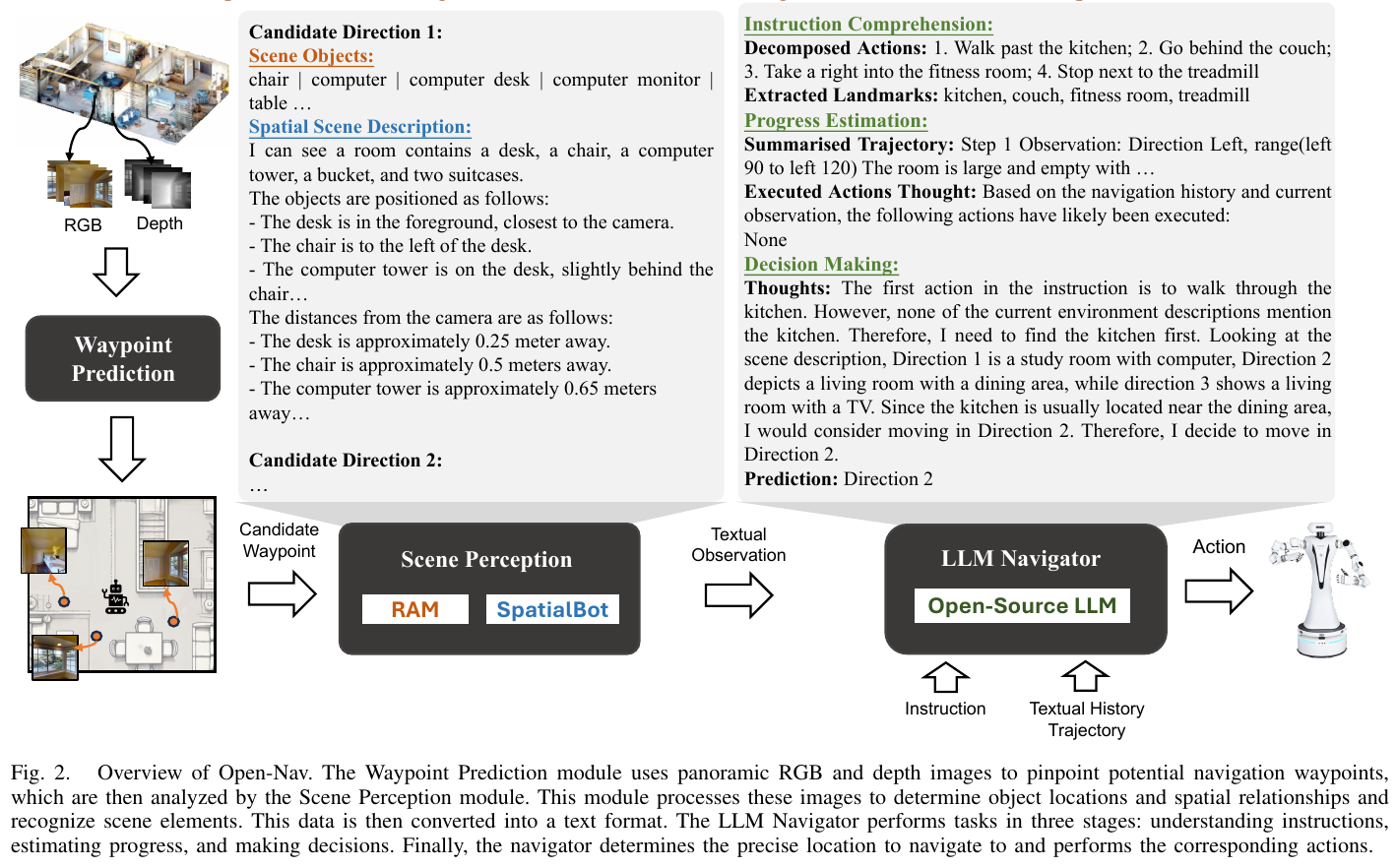

2. 主要方法/创新点

Open-Nav 框架由三个核心模块组成:

1. Waypoint Prediction 模块

使用基于 Transformer 的路径点预测模型,融合 RGB 和深度图像特征(两个专用 ResNet50 分支):

\[v_i^{rgbd} = W_m(f_{\text{ResNet-RGB}}(I_i^{rgb}) \| f_{\text{ResNet-Depth}}(I_i^d))\]经 Transformer 处理后生成候选路径点热力图,再通过 NMS 筛选出 K 个候选方向点 $\Delta W = {\Delta w_i}_{i=1}^K$,每个候选点由角度和距离表示。

2. Scene Perception 模块

针对连续环境中需要精确空间理解的挑战,使用两个互补模型增强场景描述:

- SpatialBot:空间理解 VLM,输入 RGB+深度图,输出包含物体间距离和空间关系的文本描述

- RAM(Recognize Anything Model):细粒度目标检测,识别场景中所有物体的类别和三维位置

两者输出合并为统一的文本化场景观测 $O_{text} = \langle D_{spatial}, {o_i}\rangle$,为 LLM 提供丰富的空间语境。

3. LLM Navigator:三阶段空间-时序 Chain-of-Thought

这是 Open-Nav 的核心创新。每个导航步骤,LLM 按顺序完成三个推理阶段:

- 指令理解(Instruction Comprehension):将导航指令分解为动作序列和地标列表,使用专用 prompt 提取结构化信息

- 进度估计(Progress Estimation):综合历史轨迹和当前观测,通过地标验证、方向分析、动作完成度评估四步判断已完成哪些子任务

- 决策制定(Decision Making):整合当前候选路径点的空间描述、历史轨迹摘要和进度估计结果,生成推理过程并选择最优方向点

框架通过 Ollama 在本地部署四种开源 LLM:Llama3.1-70B、Qwen2-72B、Gemma2-27B、Phi3-14B。

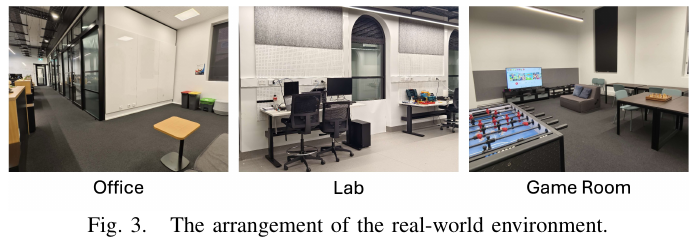

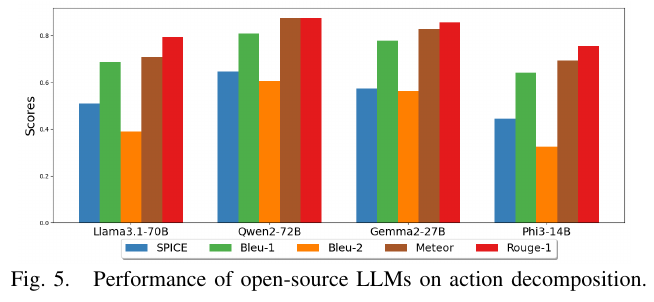

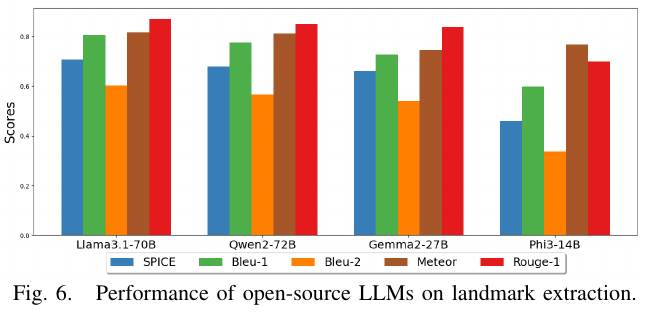

3. 核心结果/发现

模拟环境(R2R-CE 数据集):

| 方法 | SR↑ | SPL↑ | nDTW↑ |

|---|---|---|---|

| DiscussNav-GPT4 | 15 | 10.51 | 42.87 |

| Open-Nav-Llama3.1(本文) | 16 | 12.90 | 44.99 |

| Open-Nav-GPT4(本文) | 19 | 16.10 | 45.79 |

Open-Nav 使用开源 LLM 在 SR 和 SPL 上均超过 DiscussNav-GPT4,证明开源 LLM 配合良好的感知增强可媲美闭源方案。

真实世界环境(Office / Lab / Game Room):

在全部真实场景中:Open-Nav-Llama3.1 达到 SR=35, NE=2.39,超越有监督训练的 CMA(SR=23)、RecBERT(SR=27)、BEVBert(SR=20),验证了 LLM 泛化能力在分布外场景的优越性。

不同开源 LLM 对比(模拟环境导航性能):

4. 局限性

当前开源 LLM 的推理速度较慢,在真实环境中计算效率仍有待提升;论文未探索针对导航任务微调开源 LLM 的潜力,未来可进一步缩小与 GPT-4 的性能差距。

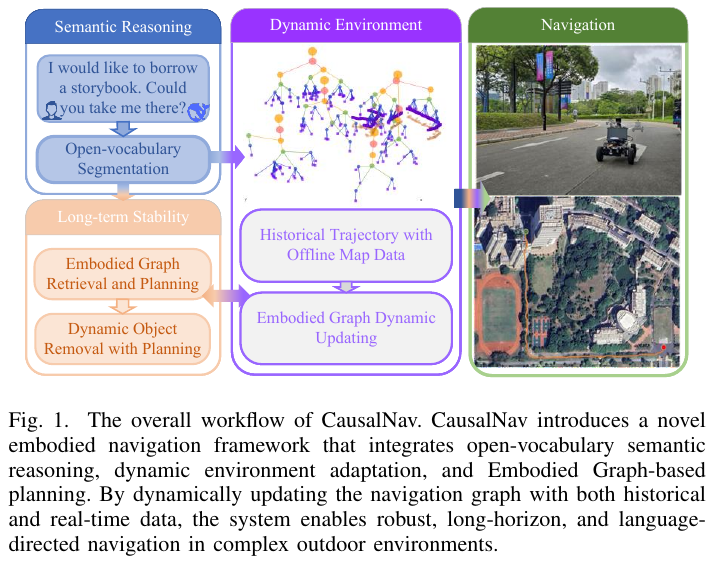

27. CausalNav (2026)

———First Scene Graph-based Semantic Navigation for Dynamic Outdoor Environments

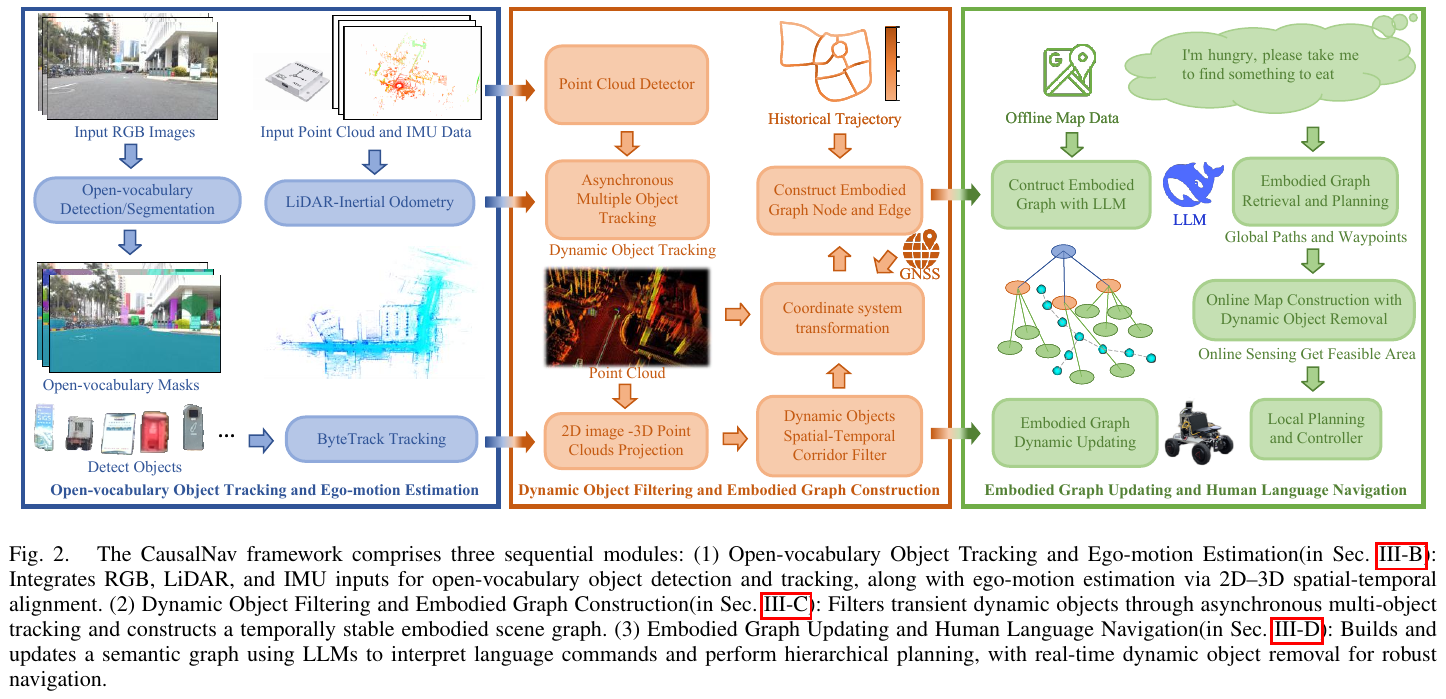

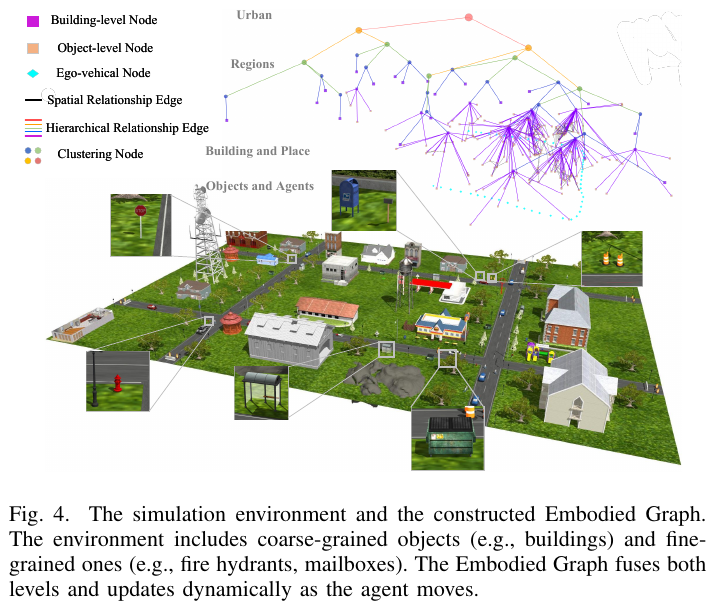

📄 Paper: https://arxiv.org/abs/2601.01872

精华

CausalNav 的核心亮点在于将多层级场景图(Embodied Graph)与 RAG 机制深度结合,实现了支持开放词汇查询的长程语义导航——”图即知识库”的设计范式值得借鉴。其次,层次化 Embodied Graph 构建策略(从细粒度对象节点到粗粒度建筑物与聚类节点)展示了如何在多空间尺度上统一语义表示与检索。第三,基于时空走廊(Spatial-Temporal Corridor)的动态对象过滤机制,无需额外标注即可区分静态、准静态与动态障碍物,是处理室外动态场景的实用方案。第四,使用本地开源 LLM 替代商业 API 完成层次语义检索,证明了在自主平台上脱离云端仍可实现高质量语义推理。

1. 研究背景/问题

室外大规模动态环境中的自主语义导航面临三大挑战:开放词汇的语义理解、动态环境适应(行人、车辆等移动障碍物)以及长期稳定性。现有 VLN 研究主要聚焦于静态室内场景,依赖高精度地图或大规模训练数据,在真实室外动态场景中的长程导航鲁棒性未得到充分验证。

2. 主要方法/创新点

CausalNav 提出了一个由三个核心模块构成的语义导航框架:

模块一:开放词汇目标跟踪与自我运动估计

使用 YOLO-World 从 RGB 图像中提取开放词汇的 2D 检测框和分割掩码,通过 ByteTrack 进行多目标跟踪。结合 LiDAR 点云将 2D 检测投影至 3D 空间,获得目标的 3D 姿态 $^w\mathbf{T}_{obj}$。自车运动通过 LiDAR-IMU 里程计(FAST-LIO2)估计,提供精确的定位与坐标变换基础。

模块二:动态对象过滤与 Embodied Graph 构建

-

时空走廊过滤:将每个目标的历史轨迹编码为时空走廊 $\mathcal{T} = {^w\mathbf{T}^n_{obj}, \text{3DBBox}i, t_i}{i=1}^n$。若目标在 $k$ 步内位移超过阈值,则认定为动态目标并从图中移除,有效消除运动引起的虚假节点。

-

Embodied Graph 层次构建:静态环境由两类节点组成——建筑物节点 $\nu_i^{build}$ 来自离线地图,对象节点 $\nu_i^{obj}$ 来自实时感知。使用 LLM 对节点进行层次聚类(spatial-semantic similarity),形成多级抽象:对象层(Level $L-1$)→ 建筑物/Place 层(Level $L$)→ 聚类节点(Clustering Node)。每次自车移动超过距离阈值 $d$,新增自车节点 $\nu_i^l$ 记录历史轨迹。

-

RAG 语义检索:基于 LLM 打分的层次化检索,结合空间相似性 $\kappa^{spatial}$ 和语义相似性 $\kappa^{semantic}$,在图中逐层选择最匹配查询的节点路径,支持开放词汇目标定位。

模块三:Embodied Graph 动态更新与自然语言导航

-

全局规划:解析自然语言指令,通过 RAG 检索 Embodied Graph 推断目标位置,优先使用历史轨迹中的 Dijkstra 最短路径;若目标不可达,则调用离线地图或 Google Maps 生成粗粒度路线,结果表示为路点序列 $\mathcal{W} = {w_1, w_2, \ldots, w_n}$。

-

局部规划:采用 RH-Map 进行实时动态局部地图构建,通过 Informed-RRT* 生成初始轨迹,再使用 NMPC-CBF(Nonlinear Model Predictive Control with Control Barrier Function)进行轨迹跟踪与动态避障,保证对移动行人/车辆的安全性。

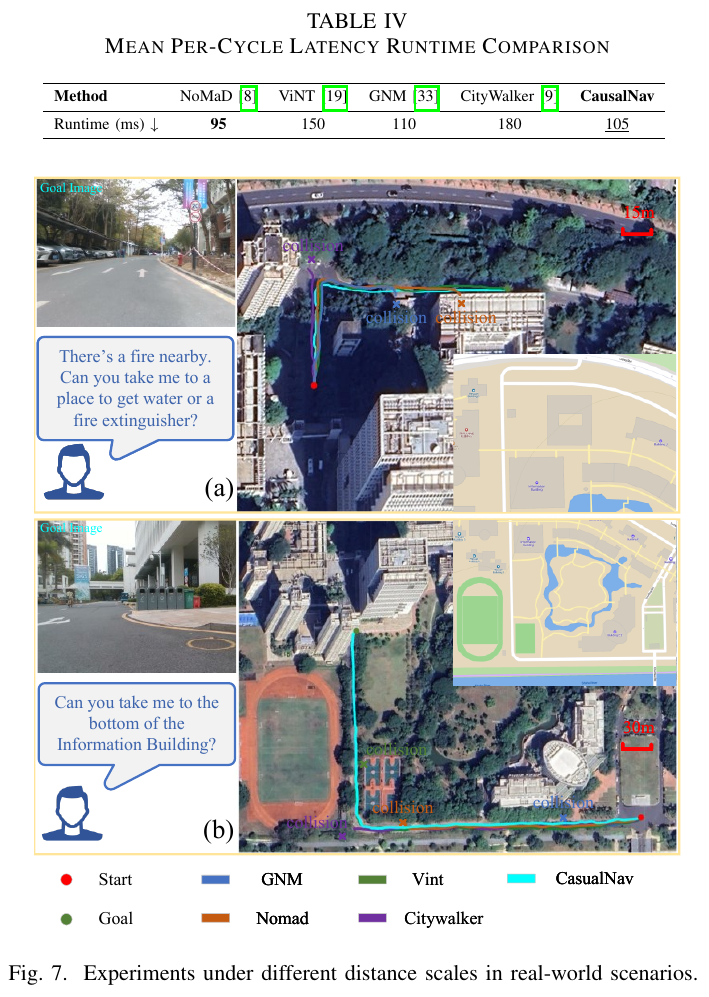

3. 核心结果/发现

仿真实验(对比 ViNT、NoMaD、GNM、CityWalker):

- Small 任务:SR 100%,SPL 88.9%,CC 0.2(所有方法中最优)

- Medium 任务:SR 92%,SPL 82.2%

- Large 任务:SR 80%,SPL 66.0%,CC 1.2,TL 141.82m

真实世界实验:

- 短程(130m):ViNT 和 CausalNav 均成功,其他方法失败

- 长程(512m):仅 CausalNav 成功完成任务,其他方法因碰撞失败

- CityWalker 在真实世界表现显著差于仿真,对光照变化和动态障碍物敏感

消融实验:

- 启用 Embodied Graph 动态更新:SR 从 78% 提升至 90%,SPL 从 54.7% 提升至 80.1%

- 最优超参数:$\alpha=\beta=0.5$,$\gamma=1.5$(空间-语义平衡点)

- 运行时延:105ms/cycle(10Hz),比 NoMaD 仅多 11% 开销

4. 局限性

CausalNav 在极端光照/天气条件下的鲁棒性有待提升,且长程图记忆的压缩与遗忘机制尚未完善,可能在超长时间运行后出现图膨胀和检索精度下降问题。

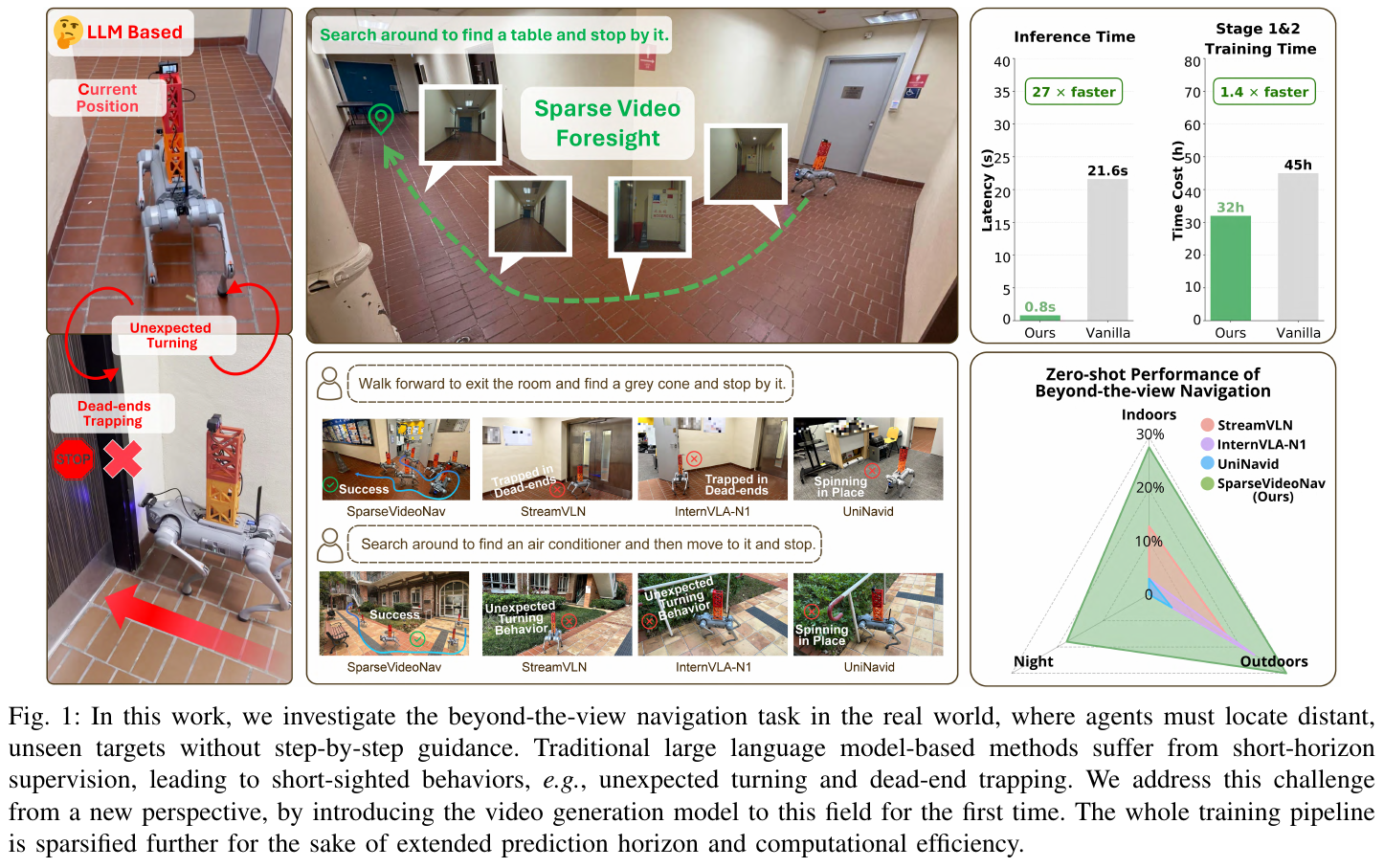

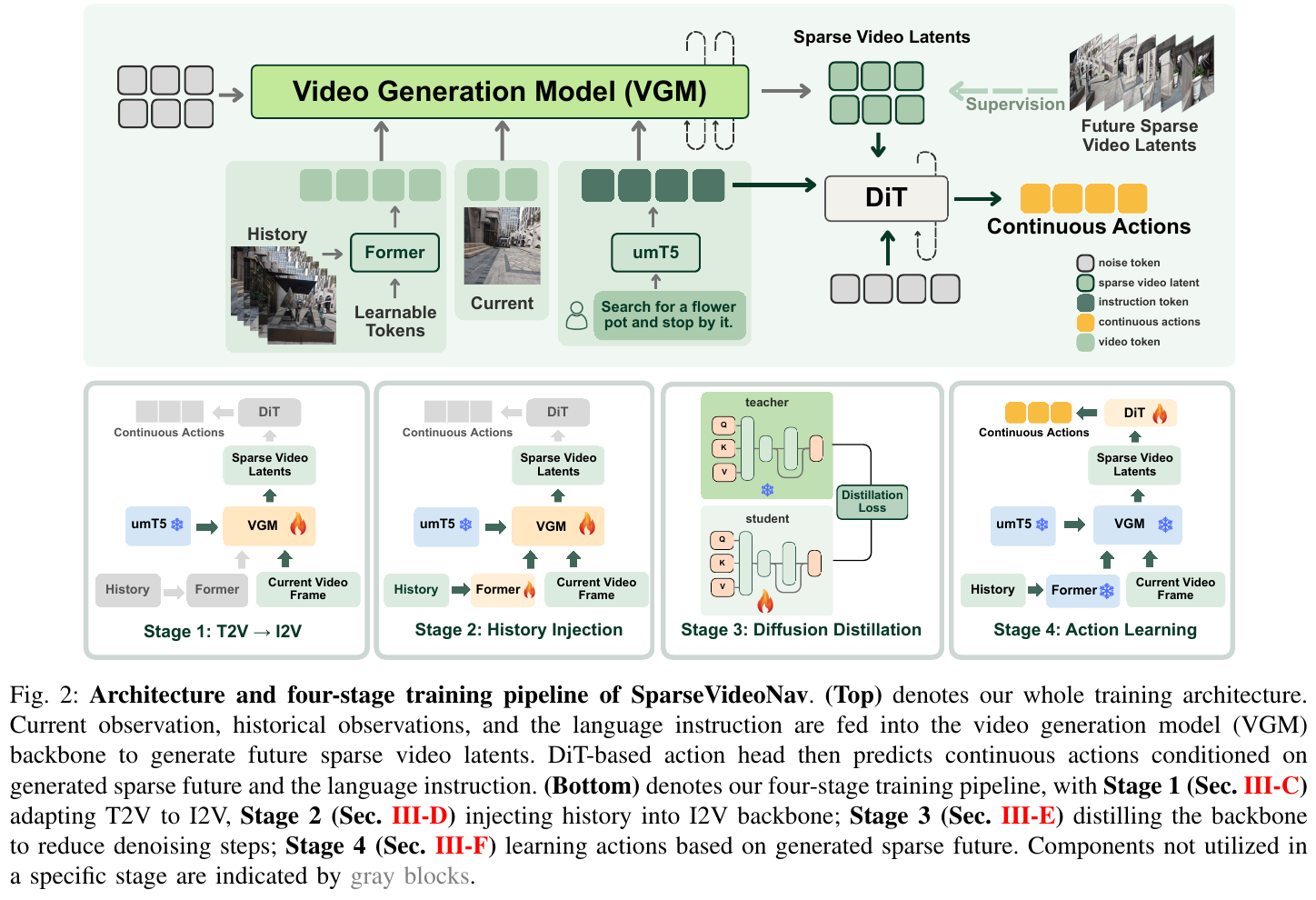

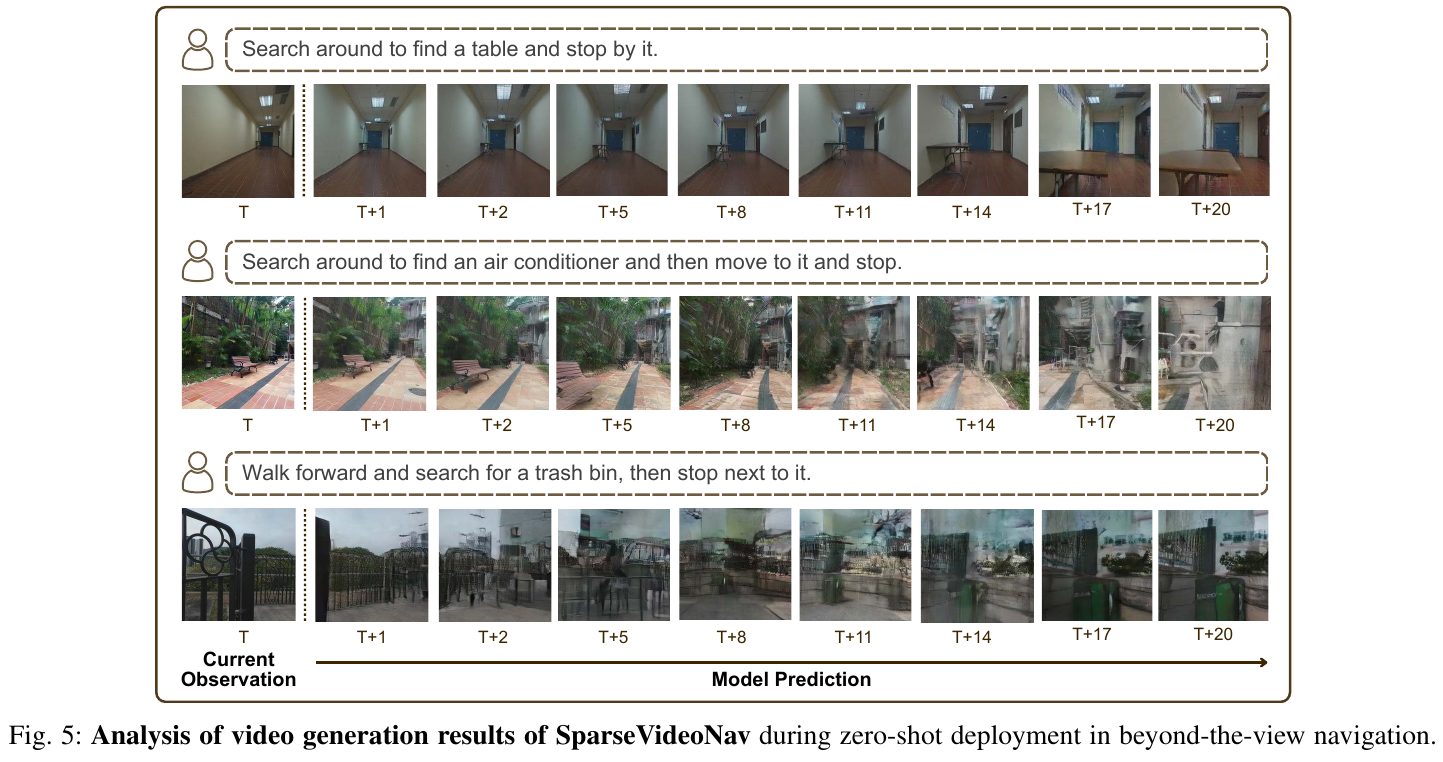

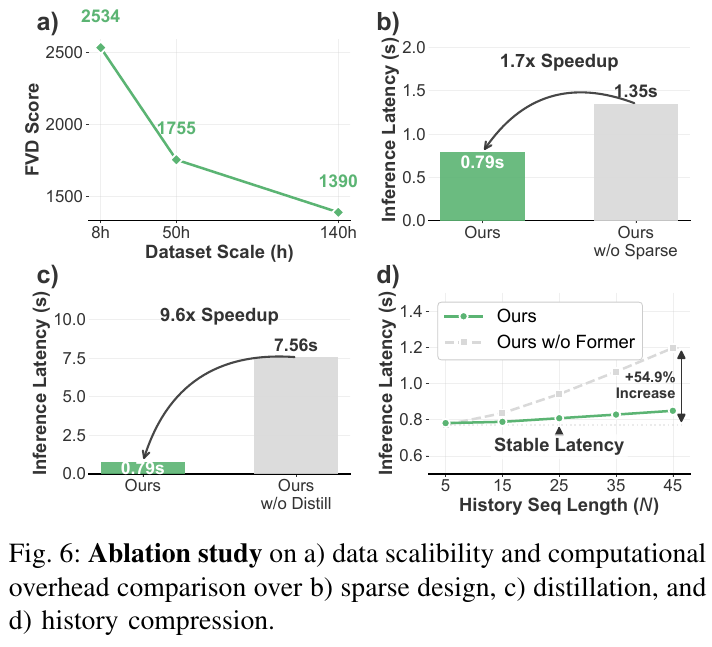

28. SparseVideoNav (2026)

———Sparse Video Generation Propels Real-World Beyond-the-View Vision-Language Navigation

📄 Paper: https://arxiv.org/abs/2602.05827

精华

SparseVideoNav 最值得借鉴的核心思想:视频生成模型(VGM)天然具备长视野预测能力,可以替代 LLM 作为导航的”大脑”,彻底解决 LLM 短视野导致的短视行为。稀疏化(sparse video generation)是兼顾长预测视野与计算效率的关键设计——不需要预测连续帧,只需关键时间戳处的帧即可提供有效导航指引。四阶段渐进式训练(T2V→I2V→历史注入→扩散蒸馏→动作学习)将大规模预训练视频模型迁移到导航领域,是一套通用的 VGM 适配范式。Diffusion Distillation 将推理步数从 50 步压缩到 4 步(9.6× 加速),使实时部署成为可能。此外,Q-Former + Video-Former 的历史压缩策略解耦了推理延迟与历史长度的关系,保证了稳定的推理效率。

1. 研究背景/问题

现有视觉-语言导航(VLN)系统依赖 LLM,受限于短视野监督(4-8步),在 Beyond-the-View Navigation(BVN)任务中表现欠佳:智能体需要在没有逐步指引的情况下,仅凭高层语义指令(如”找一张桌子并停在旁边”)定位远处不可见目标,LLM-based 方法因此频繁出现意外转向和死路困陷。简单延长监督视野会破坏 LLM 训练稳定性,而视频生成模型天然对齐长视野语言理解,成为解决 BVN 的关键突破口。

2. 主要方法/创新点

核心思路: 利用视频生成模型(VGM)预测未来稀疏帧序列作为导航预见,将预测视野延伸到 20 秒(20s × 4FPS = 80帧),而非 LLM 仅能处理的 4-8 步。稀疏间隔设为 3 时(sparse interval = 3),在预测视野与视觉保真度之间取得最优平衡。

整体架构:

架构由三个核心组件构成:

- VGM Backbone(Wan 2.1-1.3B):接收当前帧、历史嵌入(h_T)和语言指令(umT5),输出未来稀疏视频 latents

- Former 模块:Q-Former 处理时间维度历史压缩,Video-Former 处理空间维度,联合生成固定维度的历史嵌入,使推理延迟不随历史长度增长

- DiT Action Head:以生成的稀疏未来 latents 和语言指令为条件,通过 cross-attention 预测连续动作序列(DDIM 重建)

四阶段训练流程:

-

Stage 1 — T2V → I2V 适配:保留 Wan 的 flow matching 目标,将文本到视频模型适配为图像条件的视频生成(Image-to-Video),引入稀疏帧监督,以稀疏 chunk latents

[c_{T+1}, c_{T+2}, c_{T+5}, c_{T+8}, ..., c_{T+20}]作为训练目标 -

Stage 2 — 历史注入:在 Wan backbone 每个 transformer block 中新增 cross-attention block,注入历史信息 h_T(Q-Former + Video-Former 编码);新增层以零初始化保留预训练生成先验

-

Stage 3 — Diffusion Distillation:采用 PCM(Phased Consistency Models)进行蒸馏,以 history-injected I2V 模型为 teacher,训练结构相同的 student 模型,将推理步数从 N=50 压缩至 M=4,实现 9.6× 推理加速,同时保持视觉保真度

-

Stage 4 — 动作学习:冻结蒸馏后的 I2V 模型,采用逆动态范式(inverse dynamics paradigm),利用 DA3 对生成的稀疏未来帧重新标注动作标签,确保动作监督与合成动态精确对齐;训练 DiT action head 以去噪方式预测连续动作

数据采集: 使用手持 DJI Osmo Action 4(RockSteady+ 稳像)采集 140 小时真实室外导航视频,处理为约 13,000 条轨迹(均值 140 帧 × 4FPS),使用 DA3 估计相机位姿提取连续动作标签;语言指令由人工专家标注——构建了目前最大规模的真实世界 VLN 数据集。

3. 核心结果/发现

零样本真实世界性能:

- SparseVideoNav 在 6 种真实场景(室内 Room/Lab、室外 Yard/Park、夜间 Square/Mountain)上全面超越所有 LLM-based 基线

- IFN 任务平均成功率 50.0%(vs StreamVLN 35.0%、UniNavid 10.0%)

- BVN 任务平均成功率 25.0%(vs 所有基线几乎为 0%,StreamVLN 仅 10.0%)

- 夜间场景成功率 17.5%(LLM 基线在夜间 BVN 全部失败)

效率提升:

- 推理延迟 9.8s vs 基线 21.6s(27× 加速对比未优化版本)

- Stage 1+2 训练时间 32h vs 从头训练 64h(2× 加速)

- 稀疏设计带来 1.7× 推理加速,Distillation 带来 9.6× 加速

鲁棒性: 在训练高度(1m)与部署高度(50cm)不一致时仍能正确导航,展示出对相机高度变化的强鲁棒性;能够动态规避行人障碍(emergent ability,非显式训练)。

4. 局限性

当前 140 小时数据集相较于网络规模数据仍然有限,数据扩展是进一步提升的关键方向;推理延迟(9.8s)仍略高于现有 LLM-based 导航范式(StreamVLN),加速蒸馏与 VGM 量化是未来研究的重要课题。

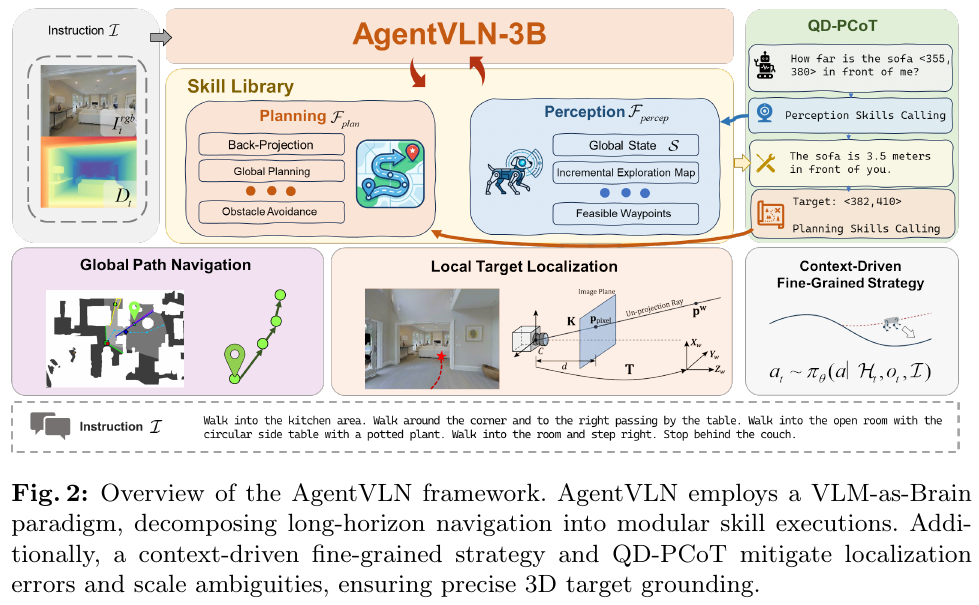

29. AgentVLN (2026)

———Towards Agentic Vision-and-Language Navigation

📄 Paper: https://arxiv.org/abs/2603.17670

精华

AgentVLN 最值得借鉴的思想是 VLM-as-Brain 范式:将 VLM 作为大脑纯做高层语义推理与技能调度,把感知、规划、控制等低层能力封装成模块化、即插即用的技能库,彻底解耦了认知与执行。跨空间表示映射(将 3D 拓扑路点反投影为像素对齐的 2D 视觉提示)是一个无需额外参数就能弥合 2D VLM 与 3D 物理世界之间鸿沟的精妙设计。QD-PCoT 展示了如何赋予模型元认知能力:当面对空间歧义时主动提问、调用感知技能获取深度信息,而非盲目输出坐标。3B 参数量在 R2R/RxR 双榜均超越 7B+ 的先前 SOTA,证明结构化分层推理远比暴力扩参数更高效。该框架可直接部署于 Jetson 嵌入式边缘平台,具备极强的落地价值。

1. 研究背景/问题

Vision-and-Language Navigation (VLN) 要求具身智能体将复杂自然语言指令转化为长时域、连续空间的导航行为。当前 VLN 系统面临三大核心瓶颈:VLM 固有的 2D 语义理解与 3D 几何感知之间的跨空间失配;单目 RGB 图像引起的尺度歧义导致局部目标定位失败;以及大参数量模型无法满足边缘设备实时推理需求。

2. 主要方法/创新点

VLM-as-Brain 范式与 POSMDP 建模

AgentVLN 将 VLN 任务形式化为 Partially Observable Semi-Markov Decision Process (POSMDP) $\mathcal{M} = \langle \mathcal{S}, \mathcal{O}, \mathcal{F}, \mathcal{T}, \mathcal{I}, \mathcal{H} \rangle$。VLM 作为中央控制器,在每个决策步 $t$ 基于历史上下文 $\mathcal{H}_t$、视觉观测 $o_t$ 和自然语言指令 $\mathcal{I}$ 生成技能调用指令:

\[c_k \sim \pi_\theta(f \mid \mathcal{H}_{t_k}, o_{t_k}, \mathcal{I}), \quad f \in \mathcal{F}\]技能库 $\mathcal{F}$ 分为两类:感知技能 $\mathcal F_{percep}$($\tau=0$,无延时地从环境提取几何/语义特征,更新全局状态 $\mathcal{S}$)和规划技能 $\mathcal F_{plan}$($\tau>0$,执行多步物理动作序列)。具体包括:Back-Projection、Global Planning、Obstacle Avoidance、Incremental Exploration Map、Feasible Waypoints 等模块。这种分层设计使 VLM 完全不接触低层运动细节,专注高层语义-空间匹配。

跨空间表示映射(Cross-Space Representation Mapping)

为解决 VLM 无法直接感知 3D 几何的问题,AgentVLN 设计了一套逆透视投影机制。感知技能首先将 RGB-D 观测通过反投影构建全局占据栅格地图,生成三维路点 $\mathbf{P}^w_{path} = [X_{path}, Y_{path}, 0]^T$;随后通过相机内参矩阵 $K$ 和当前位姿 $T_t$ 将 3D 路点投影回像素坐标:

\[s \cdot \mathbf{p}^{img}_{path} = KR_t^{-1}(\mathbf{P}^w_{path} - \mathbf{t}_t)\]这样 VLM 只需在 2D 像素空间中根据语义选择最匹配的路点,再由规划技能将其恢复为 3D 控制信号,实现了 2D 视觉语义与 3D 物理结构的无缝桥接。

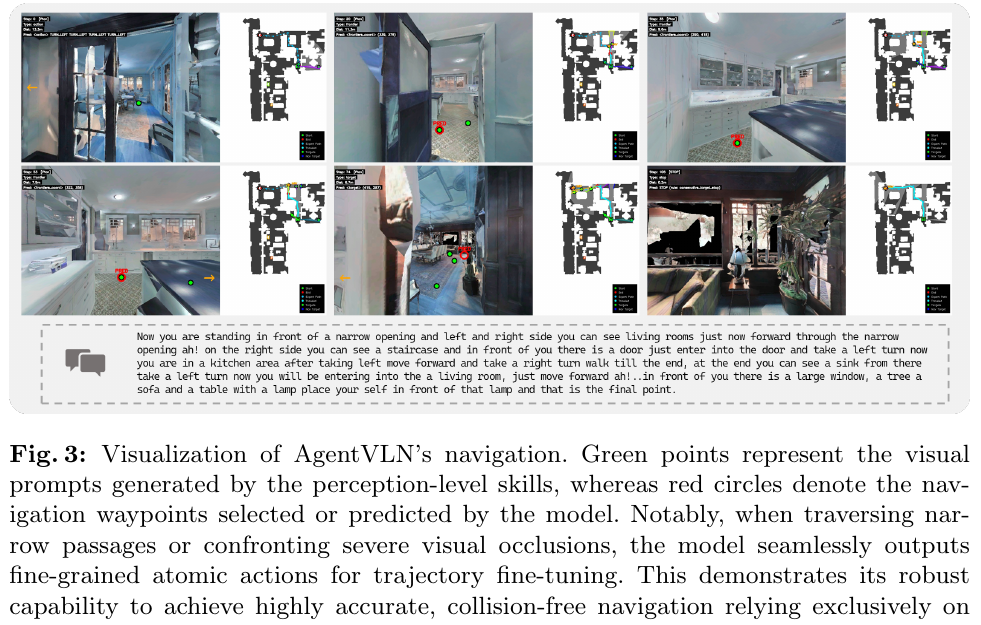

上下文感知的细粒度自校正与主动探索

当当前观测 $o_t$ 中不存在满足指令语义的可行路点时(如遮挡、盲区、轨迹偏差),AgentVLN 不强制执行长距离盲位移,而是输出细粒度原子动作 $a_t \sim \pi_\theta(a \mid \mathcal{H}_t, o_t, \mathcal{I})$,$a \in {\text{Forward, Left, Right}}$,自主环顾恢复可见路点后切回宏观技能调用,有效抑制长轨迹误差累积。

Query-Driven Perceptual Chain-of-Thought (QD-PCoT)

针对局部目标定位阶段的单目尺度歧义,AgentVLN 引入 QD-PCoT 机制。当模型检测到空间歧义时,不盲目回归像素坐标,而是生成中间自然语言查询(如 “How many meters is the chair in front of me?”)并调用感知技能 $\mathcal F_{percep}$ 获取精确深度反馈。该反馈以增量文本提示形式注入上下文,引导模型最终输出准确的目标像素坐标 $\mathbf p_{target}^{img} = [u_{target}, v_{target}, 1]^T$,再经深度图反投影转换为 3D 目标坐标 $\mathbf{P}^w_{target}$,实现精准对接。

AgentVLN-Instruct 数据集

构建了大规模指令调优数据集 AgentVLN-Instruct(基于 Habitat 仿真器),包含四个关键组件:目标可见性驱动的动态阶段路由机制(模拟人类”先粗导航、再精定位”的认知模式)、可泛化技能调用标注、局部化推理数据,以及主动问答交互对。基础模型为 Qwen2.5-VL-3B,训练时冻结视觉编码器,以 AdamW 优化,使用 32 块 NVIDIA A100 GPU。

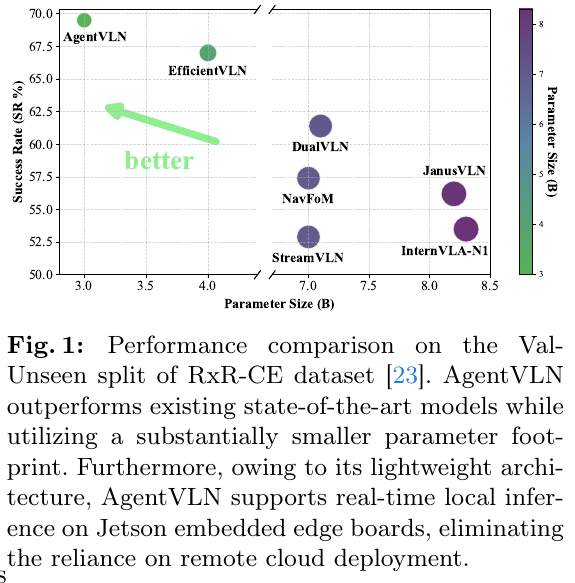

3. 核心结果/发现

- R2R-CE Val-Unseen: AgentVLN-3B 达到 SR=67.2%, SPL=64.7%,超越同类 SOTA InternVLA-N1-8.3B(SR+9.0%,SPL+10.7%),以不到一半的参数量实现全面超越

- RxR-CE Val-Unseen: SR=69.5%, SPL=61.3%, nDTW=74.6%,同样刷新 SOTA

- 消融分析:仅引入 VLM-as-Brain + 跨空间映射,SR 从基线 38.6% 提升至 59.7%;加入 CDFG 细粒度自校正后达 65.6%;最终集成 QD-PCoT 达 67.2%

- 时序上下文:最优历史帧数 K=8(SR=67.2%,SPL=64.7%),过短则短视,过长则注意力稀释

- 真实世界部署:基于 Unitree Go2 四足机器人 + Intel RealSense D455,结合 RTAB-Map SLAM,在室内外场景均实现准确导航,支持 Jetson 边缘实时推理

4. 局限性

AgentVLN 当前依赖深度传感器(RGB-D)支持精确的 3D 反投影,在纯 RGB 单目场景下的尺度歧义处理能力仍受限;此外,技能库的扩展和维护需要一定的工程成本,对全新场景的零样本适配能力尚待系统评估。

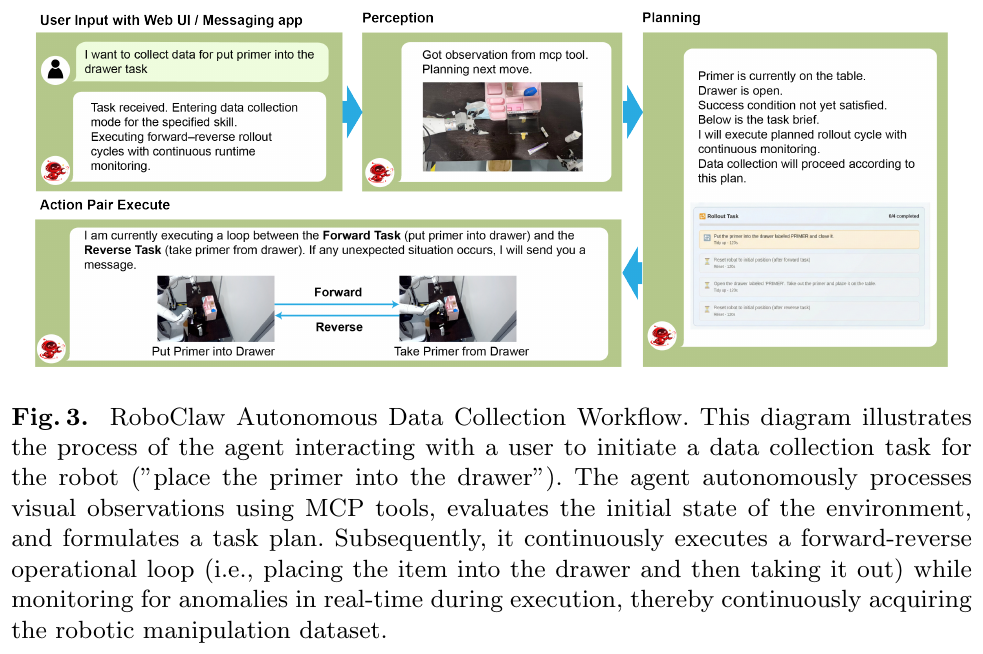

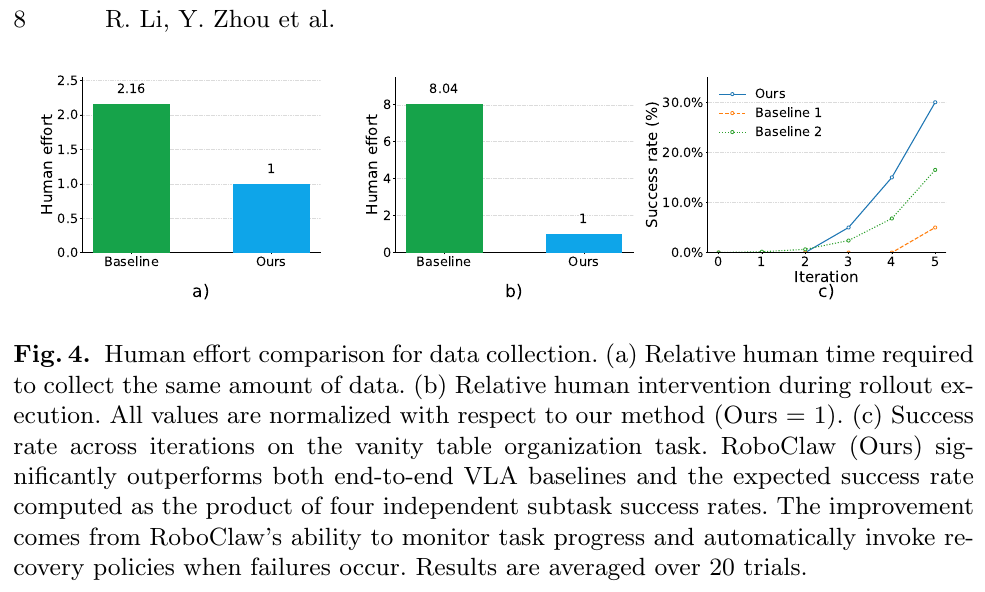

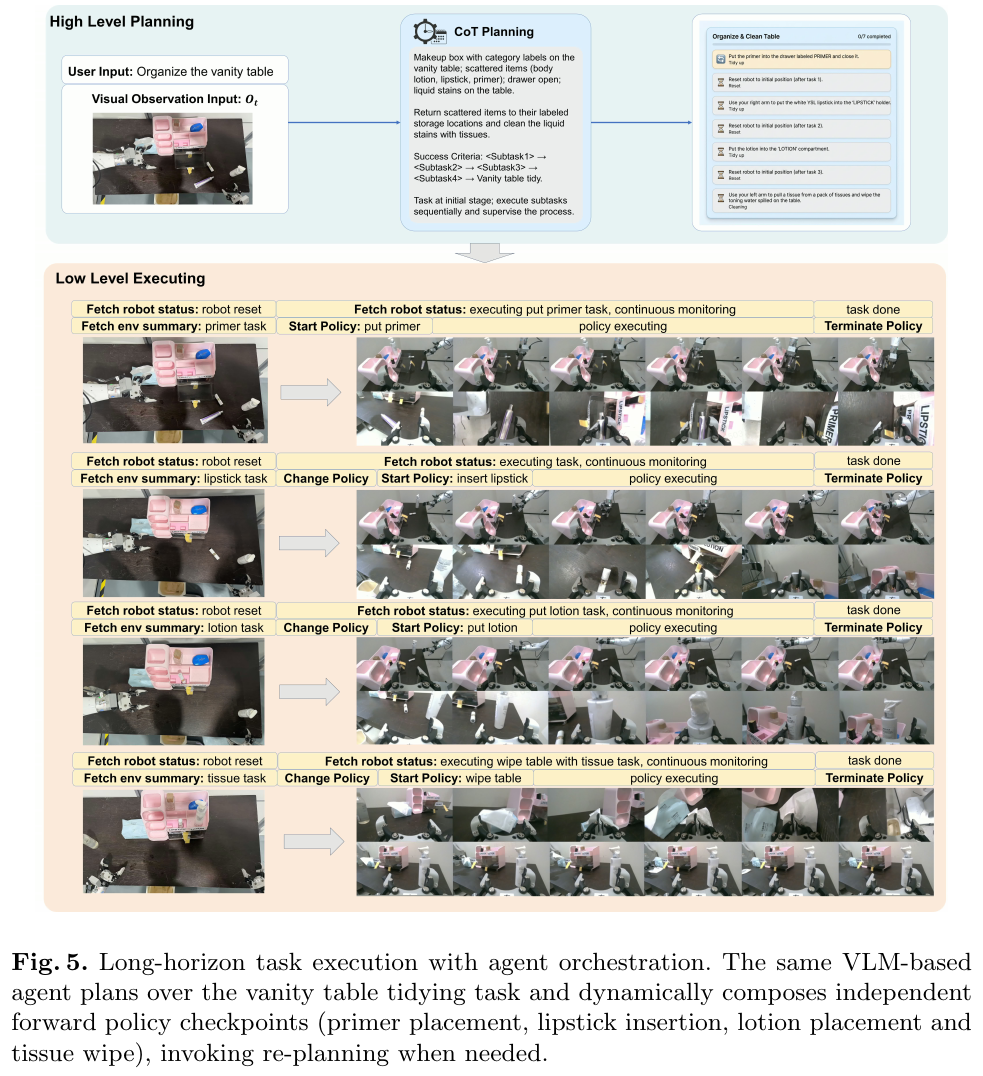

30. RoboClaw (2026)

———An Agentic Framework for Scalable Long-Horizon Robotic Tasks

📄 Paper: https://arxiv.org/abs/2603.11558

精华

RoboClaw 最核心的贡献是将数据采集、策略学习和任务执行统一在同一个 VLM agent 控制环下,从根本上消除了三个阶段之间的语义漂移问题。Entangled Action Pairs (EAP) 机制通过将正向操作与逆向复位动作配对,实现了环境的自动重置,无需人工干预即可持续采集 on-policy 数据——这一思路对所有需要大量真实机器人数据的场景都有借鉴价值。结构化记忆(角色身份、任务级记忆、工作记忆三层)使 VLM 能够有效追踪长时程任务进度,是 VLM 作为 meta-controller 的关键工程实现。MCP (Model Context Protocol) 接口将 VLM 的高层推理与底层策略执行解耦,使系统对具体 VLA 模型无依赖,具有良好的可扩展性。部署阶段产生的轨迹数据可以直接回流训练管线,形成真正的闭环生命周期学习。

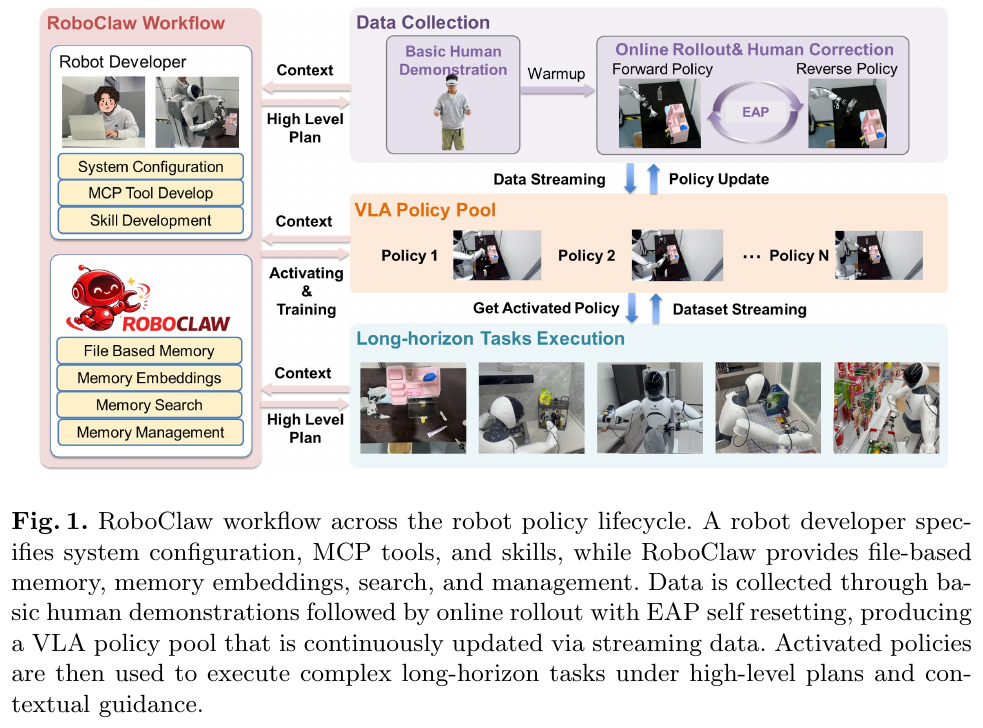

1. 研究背景/问题

现有 VLA 系统的数据采集、策略训练和任务执行通常由独立流程完成,导致三个阶段之间存在语义不一致和分布偏移,使得长时程机器人操作任务极为脆弱。此外,每次数据采集后都需要人工重置环境,导致数据获取成本高、规模化困难。

2. 主要方法/创新点

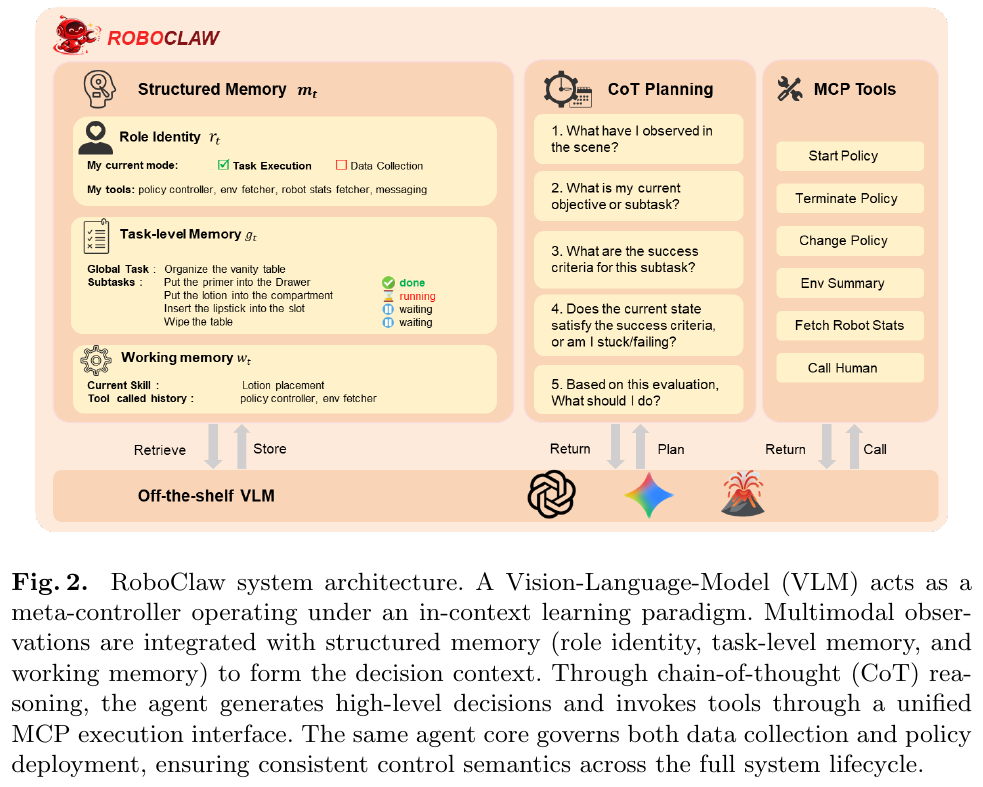

RoboClaw 是一个统一的 agentic 机器人框架,核心思想是用同一个 VLM 驱动的 agent 覆盖机器人的完整生命周期。

系统架构

VLM 作为 meta-controller,通过 in-context learning (ICL) 对多模态观测和结构化记忆进行推理,输出高层决策并通过 MCP 接口调用工具执行。

系统维护三层结构化记忆状态 $m_t = (r_t, g_t, w_t)$:

- 角色身份 $r_t$:指定当前运行模式(数据采集 / 任务执行)和可用工具集

- 任务级记忆 $g_t$:记录全局任务及子任务分解与执行状态,用于追踪长时程进度

- 工作记忆 $w_t$:存储当前激活技能和工具调用历史等短期上下文

VLM 通过 Chain-of-Thought (CoT) 规划对当前场景进行五步结构化推理:观察场景 → 确定当前子任务 → 评估成功标准 → 判断当前状态 → 决定下一步行动。MCP 工具接口提供 Start/Terminate/Change Policy、Env Summary、Fetch Robot Stats、Call Human 等调用能力。

Entangled Action Pairs (EAP):自重置数据采集

EAP 是 RoboClaw 的核心数据引擎:对每个操作策略 $k$,同时学习正向执行策略 $\pi_{\theta_k}^{\rightarrow}$(完成操作)和逆向复位策略 $\pi_{\phi_k}^{\leftarrow}$(恢复初始状态)。两条轨迹构成 entangled pair $\tau_k = (\tau_k^{\rightarrow}, \tau_k^{\leftarrow})$,使环境无需人工介入即可自动复位,从而持续、循环地采集 on-policy 数据。

底层操作策略使用 $\pi_{0.5}$ VLA 模型实现,通过 flow matching 目标训练,预测短时程动作序列 $A_t = \pi_{0.5}(o_t, l_t, q_t)$,其中语言指令 $l_t$ 由 RoboClaw agent 动态生成而非人工提供。

部署阶段:过程监督与技能调度

部署时 RoboClaw 切换为任务执行模式,同一 agent 通过 CoT 推理动态选择并调度已学策略。agent 定期查询环境状态和机器人状态以监控子任务进度;当子任务失败时,可重试同一策略、切换备选策略,或在重复失败时触发 Call Human。部署产生的轨迹直接回流训练数据集,实现持续改进。

3. 核心结果/发现

- 数据采集效率:与纯人工采集基线相比,RoboClaw 将所需人力时间减少至 1/2.16,将 rollout 过程中的人工干预减少至 1/8.04

- 策略迭代提升:4 个操作任务的正向策略成功率随迭代均稳步提升(例如 Body Lotion: 21→43/50,Lipstick: 2→23/50,经 5 次迭代)

- 长时程任务:在梳妆台整理任务上,RoboClaw 比端到端 VLA 基线(Baseline 1)和独立子任务成功率乘积估计(Baseline 2)显著更高,最终成功率提升约 25%

- 逆向复位策略:4 个任务的逆向策略成功率均在 36-43/50 之间,保障了 EAP 循环的稳定性

- 故障学习:系统将运行故障分为非降级故障(可直接重试)和降级故障(需恢复动作),后者随迭代逐渐被纳入策略库,减少对人工干预的依赖

4. 局限性

云端 VLM 推理引入额外延迟,影响实时控制性能;EAP 机制依赖逆向复位行为在实践中确实可行这一假设,对部分操作任务可能难以设计合理的逆向策略。

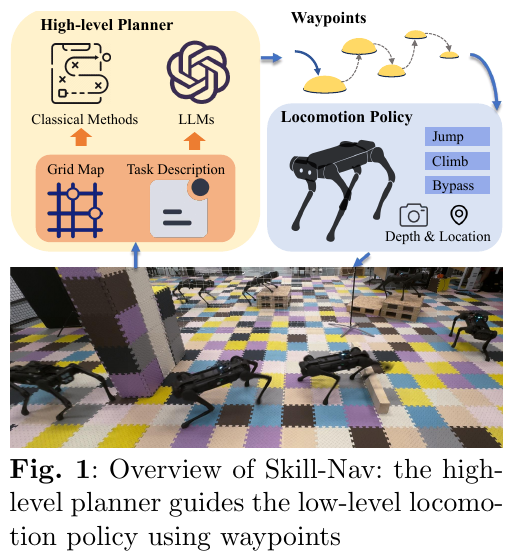

31. Skill-Nav (2025)

———Enhanced Navigation with Versatile Quadrupedal Locomotion via Waypoint Interface

📄 Paper: https://arxiv.org/abs/2506.21853

精华

Skill-Nav 的核心贡献在于用 waypoint(路标点) 作为高层规划器与低层运动控制器之间的接口,相比速度命令接口,waypoint 对追踪误差更不敏感,且天然兼容 LLM 和经典路径规划算法。两阶段训练策略(WP-Fixed 先学技能、WP-Random 再强化泛化)解决了单阶段训练的跌步或过度跳跃问题,值得在其他层级化机器人控制任务中借鉴。Teacher-Student 蒸馏架构通过在 Student 训练时引入膨胀虚拟障碍(inflated virtual obstacles),使 Student 策略在不接触特权信息的条件下保持安全导航能力。

1. 研究背景/问题

四足机器人通过 RL 已能完成极限 parkour 等高难度运动,但将丰富的运动技能集成到长距离导航任务中仍未充分探索。现有方法大多以速度命令为接口,高层规划器难以精确跟踪,且与多样化通用规划工具(LLM、A*)耦合困难。

2. 主要方法/创新点

Waypoint 接口设计

Skill-Nav 以 2D 相对位置(相对于机器人 base frame 的坐标)作为 waypoint 命令替代速度命令。高层规划器通过 $\mathcal{W} = \mathcal{H}(\mathbf{M}, p_e, p_s)$ 生成从起点到终点的 waypoint 序列,$\mathcal{H}$ 可以是 A* 算法或 LLM,$\mathbf{M}$ 为粗粒度环境信息(如占用地图或房间布局)。

两阶段训练策略

-

WP-Fixed 场景(技能学习):障碍物按行排列,waypoint 预置。策略从零开始学习攀爬箱体、跨越间隙、越过护栏等基础运动技能。设计 $r_{\text{reach}} = n_p/(t + \epsilon)$ 鼓励机器人快速到达更多 waypoint,同时引入 $r_{\text{stay}}$ 使机器人在到达 waypoint 后等待下一条指令。

-

WP-Random 场景(泛化增强):障碍物以矩阵形式随机分布,waypoint 根据机器人位置和偏航角动态选取。引入修改后的 $r_{\text{track}}$,当速度方向与 waypoint 方向余弦相似度 $< 0.1$ 时给予 $-1$ 惩罚,鼓励机器人向目标前进。Student 训练时在深度图中加入虚拟膨胀障碍,使学生策略保持安全距离。

双规划器高层架构

- 经典规划(A*):输入仅含墙体标注的占用地图,输出连续路径点序列,以 0.5–3m 间隔采样为 waypoint 输入低层控制器。

- LLM 规划:向 LLM 提供任务描述、粗粒度地形图、机器人运动能力(最高攀爬 0.45m、最大跨越 0.7m 间隙)等信息,由 LLM 生成 waypoint 索引序列(以 GPT-4 验证)。

3. 核心结果/发现

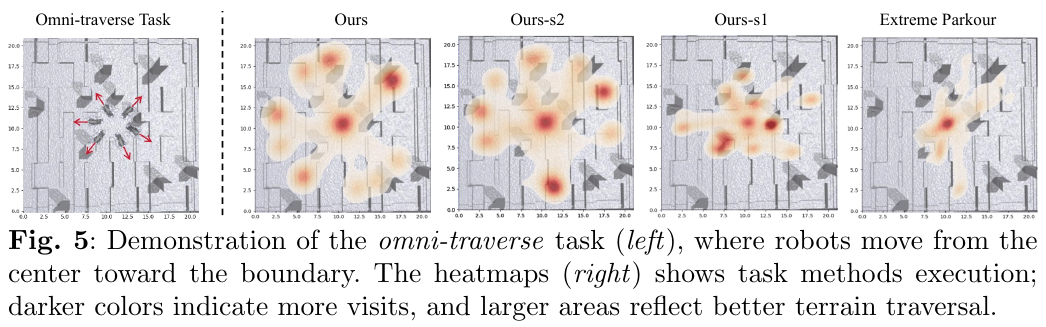

- Single-traverse 任务:在有无高障碍物场景中,Skill-Nav 均达到 SR=1.00、ATD=15.8m,是唯一在两种条件下均成功的方法。

- Omni-traverse 任务:SR=0.89、ATD=8.2m,超越所有对比方法(RMA SR=0.00,Extreme Parkour SR=0.44/0.28)。